План действий по лимитам API для стабильной загрузки списков потенциальных клиентов

План действий по лимитам API для поиска лидов: пагинация, ретраи, кеширование и логирование, которые делают выгрузки стабильными, повторяемыми и аудируемыми.

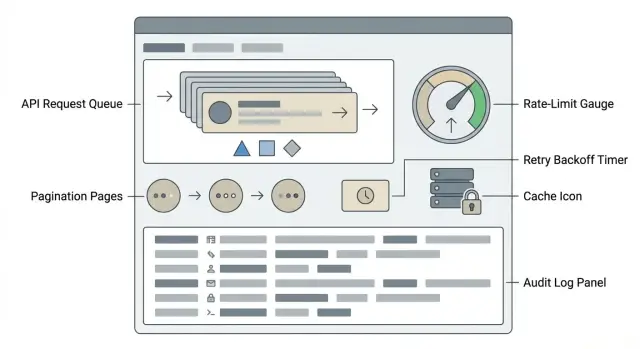

Почему загрузки списков лидов ломаются из‑за лимитов\n\nЗагрузки лидов обычно терпят неудачу скучными, предсказуемыми способами: интеграция упирается в лимит API, задача замедляется, и кто-то перезапускает её, не понимая, что уже произошло. Кажется, что «API флюктуирует», но настоящая проблема — загрузка не была спроектирована так, чтобы корректно вести себя под нагрузкой.\n\nКогда загрузка попадает под лимиты, несколько режимов отказа появляются снова и снова:\n\n- Пропущенные записи, потому что задача таймится посреди страницы и не возобновляется корректно\n- Дубликаты, потому что страницы ретраятся без идемпотентной стратегии\n- Частичные обновления, когда одни лиды обогащаются, а другие остаются пустыми\n- Тихие пробелы, когда ошибки проглатываются и загрузка «завершается» в любом случае\n- Трата кредитов, когда одни и те же эндпоинты вызываются многократно\n\nТакая нестабильность дорогая. Вы платите дважды (и больше) за одни и те же данные, последовательности путаются (тот же лид импортирован или отправлен дважды), и отчётность теряет доверие. В масштабе небольшие несоответствия списков нарастают до проблем с доставляемостью и запутанных follow‑up.\n\nЦель проста: загрузки, которые стабильны, повторяемы и аудируемы.\n\n- Стабильные: большие выгрузки завершаются без надзора.\n- Повторяемые: повторные запуски не меняют результата, если исходные данные не изменились.\n- Аудируемые: позднее можно ответить, какие вызовы были выполнены, что импортировано и почему.\n\nПрактические составляющие — пагинация, которая не пропускает и не считает дважды, безопасные ретраи, кеширование и инкрементальные загрузки, которые снижают нагрузку на API, и логирование, которое делает каждый запуск объяснимым. Если вы тянете лидов у провайдеров вроде Apollo в аутбаунд‑систему (например, чтобы заполнить последовательности в LeadTrain), эти предохранители не дадут росту превратиться в хаос.\n\n## Узнайте лимиты до запуска\n\nПрежде чем начать большую выгрузку, разберитесь, что позволит API. Этот «скучный» шаг предотвращает половинчатые списки, потерянные страницы и дубли позже.\n\nRate limits — это про скорость. Quotas — про общий объём. Concurrency limits — про число одновременных запросов.\n\n- Rate limit: макс. запросов в секунду или минуту (пример: 60 запросов/мин)\n- Quota: макс. запросов в день или месяц (пример: 10 000/день)\n- Concurrency limit: макс. одновременных запросов (пример: 5 параллельных)\n\nБольшинство API отдают сигналы лимитов в заголовках ответа и через несколько общих кодов состояния. При интеграции захватите эти сигналы в небольшой тестовой выгрузке.\n\nТипичные паттерны:\n\n- HTTP 429 (Too Many Requests) и иногда 403 для принудительного лимитирования\n- Retry-After, подсказывающий, как долго ждать\n- X-RateLimit-Limit, X-RateLimit-Remaining, X-RateLimit-Reset (названия варьируются)\n- Вендорные заголовки вроде RateLimit-* или X-Quota-*\n\nТакже следите за burst‑лимитами. Допустимо 60 запросов/мин, но вас всё равно могут заблокировать, если вы отправите 20 запросов в одну секунду. Всплески легко возникают при параллельных воркерах, ретраях или плотном цикле пагинации.\n\nДля планирования пропускной способности начинайте консервативно. Берите опубликованный лимит и целитесь в 60–80% от него. Если лимит 60/мин и каждый запрос возвращает 100 лидов, ориентируйтесь на примерно 40–45 запросов/мин (около 4 000–4 500 лидов/мин) и держите низкую параллельность (обычно 1–3), чтобы избежать пиков.\n\n## Пагинация, которая не пропускает и не дублирует лидов\n\nИменно пагинация порождает большинство «случайных» пробелов и дубликатов. Цель — детерминированная выгрузка страниц, даже когда за время чтения добавляются новые лиды.\n\nПагинация по смещению (offset) (page=7, limit=100) проста, но рискованна при изменяющихся данных. Если записи добавляются или редактируются во время работы, «7‑я страница» может сдвинуться, вызывая пропуски или повторы. Курсорная пагинация (токен next_cursor) обычно безопаснее, потому что даёт точку продолжения, но она всё равно зависит от того, чтобы API возвращал стабильный порядок.\n\nЧтобы страницы оставались консистентными, запрашивайте стабильную сортировку и фиксируйте фильтры на весь запуск. Частый подход — сортировать по монотонному полю, например created_at, с дополнительным ключом‑развязкой вроде id, чтобы две записи, созданные одновременно, не меняли порядок между вызовами.\n\nЕсли данные могут изменяться во время выгрузки, «заморозьте вселенную». Запишите cutoff‑метку времени в начале (например, created_at <= 2026-01-17T10:00Z) и применяйте её ко всем страницам. Новые записи могут появляться, но они не перестроят страницы, которые вы читаете.\n\nПравила остановки и проверки здравомыслия помогают понять, когда завершать и когда исследовать проблему:\n\n- Останавливайтесь только когда API возвращает ноль элементов или нет next_cursor.\n- Отслеживайте уникальные ID и сигнализируйте, если число дубликатов превышает небольшой порог.\n- Флагируйте резкие падения размера страниц.\n- Ведите накопительный счёт и сравнивайте с отчётным total API, когда он доступен.\n- Сохраняйте курсор (или последний ключ сортировки) после каждой страницы, чтобы возобновлять безопасно.\n\n## Ретраи, которые восстанавливают, не усугубляя ситуацию\n\nРетраи помогают при временных проблемах. Они усугубляют ситуацию, когда запрос некорректен или вы уже давите API слишком сильно. Делайте ретраи предсказуемыми, ограниченными и вежливыми.\n\nРазделяйте ошибки на те, которые стоит ретраить, и те, которые нужно исправить:\n\n- Ретрай: 429 (rate limited), 408 (timeout), большинство 5xx (ошибки сервера) и сетевые проблемы (сброс соединения, DNS).\n- Не ретрай: 400 (bad request), 401/403 (аутентификация/права), 404 (неверный эндпоинт или отсутствующий ресурс) и ошибки валидации.\n\nДля 429 уважайте инструкции сервера. Если приходит Retry-After, приостановитесь на это время (плюс небольшая случайность) и только затем продолжайте. Игнорирование Retry-After превращает замедление в простой или, что хуже, во временный бан.\n\nЭкспоненциальный backoff с jitter означает, что вы ждёте дольше после каждой неудачи и добавляете небольшой случайный сдвиг, чтобы много воркеров не ретраили одновременно.\n\n- Правило backoff: 1s, 2s, 4s, 8s, до предела (например, 30–60s)\n- Добавляйте jitter: рандомизируйте задержки на ~20–50%\n- Охлаждение: после повторяющихся 429 приостановьте всю задачу дольше (например, 2–5 минут)\n\nПоставьте жёсткий стоп на повторы. Правило типа максимум 5 попыток на запрос или максимум 10 минут общего времени повторов предотвращает бесконечные циклы.\n\nПример: вы тянете 50 000 лидов и страница 37 вернула 429 с Retry-After: 15. Спите 15–20 секунд, повторяете эту же страницу один раз и продолжаете. Если подряд идут три 429, сделайте короткую паузу вместо лавины повторов.\n\n## Сделайте загрузку перезапускаемой и безопасной для повторов\n\nСтабильная загрузка — та, которую можно остановить, перезапустить и повторить без изменения результата. Это важно при лимитах, таймаутах или развёртках фиксов посреди процесса.\n\nНачните с идемпотентных записей. Вместо «вставить каждую строку» используйте upsert с понятным ключом дедупации и фиксируйте, что произошло. Общие ключи: person ID провайдера, нормализованный email или fallback вроде домена + полного имени.\n\nНабор правил конфликтов, который остаётся предсказуемым:\n\n- Если совпадает provider ID — это тот же лидер, обновляйте поля.\n- Иначе, если совпадает нормализованный email — объединяйте, оставляя поля с самой поздней датой обновления.\n- Иначе создавайте новую запись и помечайте её ID задачи загрузки для трассировки.\n- Никогда не перезаписывайте флаг отписки или «не контактировать» при слияниях.\n\nСделайте загрузку перезапускаемой с чекпойнтами. Сохраняйте последний подтверждённый курсор/токен страницы и количество записей, сохранённых для этой страницы. Продвигайте контрольную точку только после полной обработки и фиксации страницы, чтобы при сбое максимум одна страница переигрывалась.\n\nДанные провайдера могут меняться: ID объединяются, удаляются или перепользуются. Ведите таблицу соответствий «виденный provider ID → ваш внутренний ID». Если ID внезапно указывает на другой email, поместите запись в карантин для проверки вместо тихого обновления.\n\nПример: вы тянете 50 000 лидов ночной задачей в аутбаунд‑стек или платформу вроде LeadTrain. Если задача упала на странице 380, вы рестартуете с последней контрольной точки, переигрываете страницу 380 безопасно и всё равно получаете те же 50 000 записей, а не 50 800 с дубликатами.\n\n## Кеширование и инкрементальные выгрузки для снижения нагрузки на API\n\nКеширование сокращает вызовы API без изменения результата. Оно помогает при повторных запусках, повторяющихся lookups (домены компаний, должности, локации) или при многократном обогащении одних и тех же людей. Рассматривайте кеш как предохранитель, а не только как трюк для скорости.\n\nПростой подход — кешировать по стабильному ключу, например provider prospect ID или email, и хранить только поля, которые вы реально используете для аутрича. Тогда пропускайте вызовы API для записей, которые уже есть, если они вряд ли изменились.\n\n### Основы TTL: как долго доверять кешу\n\nTTL должен соответствовать скорости изменений в источнике и риску устаревших данных. Контактные идентификаторы меняются медленно, а должность и компания — быстрее.\n\n- Жёсткие идентификаторы (provider ID, email, домен компании): длинный TTL (дни–недели)\n- Профильные детали (должность, seniority, локация): средний TTL (часы–несколько дней)\n- Статусы (отписался, bounce, do-not-contact): короткий TTL (минуты–часы)\n\n### Инкрементальные выгрузки: только новые или обновлённые\n\nВместо перетягивания всего храните чекпойнт вроде updated_at или курсора от последнего успешного запуска. В следующий раз запрашивайте только записи, обновлённые с той метки. Это сокращает нагрузку, уменьшает давление лимитов и делает повторы предсказуемыми.\n\nЧастая ловушка — утечка устаревших данных в аутрич. Защититесь валидацией критичных полей при отправке (например, флагов do-not-contact) и обновляйте записи прямо перед попаданием в кампанию.\n\nЕсли вы кормите лидов в аутбаунд‑систему вроде LeadTrain, инкрементальный синк вместе с короткими TTL для полей, связанных с отписками, помогает держать списки свежими и избегать лишних вызовов провайдера.\n\n## Логирование, которое делает загрузки аудируемыми\n\nКогда загрузка падает или выглядит «неправильно», логи — это как вы доказуете, что произошло. Хорошие логи быстро отвечают на простые вопросы: что мы запросили, что вернул API и на какой странице всё изменилось?\n\nЛогируйте единый набор полей для каждого API‑вызова. Держите структуру (часто JSON), чтобы искать и группировать по задаче.\n\n- Временные метки (начало и конец) и задержка\n- Эндпоинт и метод, ключевые параметры запроса (страница/курср, фильтры, сортировка)\n- Код статуса ответа и любые заголовки лимитов\n- Числа результатов (записей возвращено, next cursor, has_more)\n- Детали ошибок (сообщение, ретраийбельна или нет, номер попытки)\n\nДобавляйте корреляционные ID, чтобы трассировать одну выгрузку через сотни или тысячи вызовов. Простой паттерн — один job_id для всей загрузки и один request_id на каждый API‑вызов. Если вы также сохраняете последний успешный курсор с job_id, вы сможете соотнести логи с точками возобновления.\n\nРешите, сколько ответа хранить. Сырые ответы упрощают аудит, но могут быть дорогими и рискованными. Данные лидов могут содержать персональную информацию, поэтому учитывайте приватность.\n\nПрактический компромисс — хранить сводку для каждого вызова (числа, курсоры, хэши) и сохранять сырые тела только при ошибках или на короткий срок. Если храните сырые данные, редактируйте чувствительные поля и шифруйте на диске.\n\n«Аудируемо» на практике: sales ops спрашивает, почему 2 000 лидов отсутствуют в выгрузке прошлого вторника. С логами вы показываете точные параметры фильтра, страницу, где началось лимитирование, ретраи и финальный курсор, который был сохранён.\n\n## Мониторинг и алерты для стабильной работы\n\nЛимиты — это не только код. Если вы не следите за выгрузками во время выполнения, небольшой сбой API может тихо превратиться в пропущенные лиды, дубликаты или незавершающуюся задачу. Мониторинг должен быстро отвечать на один вопрос: здоров ли сейчас этот пул?\n\nИспользуйте несколько метрик, понятных не‑техническим командам:\n\n- Запросы в минуту (и насколько вы близки к лимиту)\n- Доля ошибок (4xx против 5xx)\n- Частота ретраев (как часто вы откатываетесь)\n- Отставание (насколько вы отстаёте от ожидаемого времени завершения)\n- Прогресс (страниц или записей в минуту)\n\nАлерты должны фокусироваться на паттернах, а не единичных событиях. Один 429 — нормально. Двадцать 429 подряд означают блокировку и траты времени. То же самое для повторяющихся 5xx, которые часто сигнализируют о падении.\n\nПолезные триггеры: всплеск 429, повторяющиеся 5xx больше нескольких минут и пагинация, которая перестала продвигаться (курср не меняется или количество записей не растёт).\n\nДашборды не обязаны быть навороченными. Простой вид с зелёным/жёлтым/красным статусом, текущей скоростью выгрузки, последней ошибкой и оценкой времени оставшегося достаточно для менеджера SDR, чтобы принять решение.\n\nРешите заранее, когда ставить на паузу автоматически, а когда уведомлять человека:\n\n- Автопауза при устойчивых 429 или когда прогресс стоит на месте в заданном окне\n- Уведомление человека, когда пул приостановлен или ошибки не проходят после cooldown\n- Автовозобновление только после падения ошибок и восстановления прогресса\n\nПример: вы тянете 50 000 лидов. Если 429 выросли с 1% до 40%, автопауза предотвращает частичные данные в аутрич‑системе и снижает риск неконсистентного импорта.\n\n## Пошагово: запуск стабильной выгрузки лидов\n\nСтабильная выгрузка — это воспроизводимый runbook. Те же входы должны давать тот же выход, даже если API замедлился или упал посреди работы.\n\nБазовый поток: \n\n- План: запишите точные фильтры, поля для запроса, порядок сортировки и временное окно (например, «created after 2026-01-01»). Решите уникальный ключ (обычно prospect ID).\n- Dry run: вытяните 1–2 страницы. Подтвердите форму ответа, обязательные поля и что ключ всегда присутствует.\n- Полный запуск: стартуйте с первой страницы с сохранённым курсором/offset. Сохраняйте каждую страницу и последний удачный курсор, чтобы можно было возобновить.\n- Проверка: сравните ожидаемые числа (из API, если есть) с тем, что вы сохранили. Проверьте дубликаты и отсутствующие поля.\n- Экспорт/импорт: экспортируйте финальный дедуплицированный файл и небольшой манифест запуска, чтобы кто‑то другой мог запустить это позже.\n\nРазмер батча и конкуррентность должны определяться сигналами, а не догадками. Начните с page size 50–100 и одного воркера. Если нет ответов с лимитами и задержки стабильны, увеличьте до 2–4 воркеров. Остановитесь, когда 429 станут частыми или среднее время ответа растёт.\n\nДля валидации сделайте быструю выборочную проверку (20–50 записей) и затем простую сверку: всего строк, уникальных prospect ID, процент отсутствующих email/name/company и были ли страницы сохранены дважды.\n\nДокументируйте каждый пул простым текстом: кто запускал, когда, какой API‑аккаунт использовался, точные параметры, размер страницы, конкуррентность и итоговый хэш или число строк.\n\n## Пример: реалистичная большая выгрузка, которая остаётся консистентной\n\nНужно забрать 50 000 лидов примерно за 2 часа, чтобы аутбаунд‑команда могла стартовать завтра. Вы ставите page size 500, то есть примерно 100 страниц. Провайдер применяет лимиты, поэтому вы задаёте темп запросов и рассчитываете на редкие 429 и случайные 5xx.\n\nПул выглядит так: запросить страницу 1, сохранить возвращённый курсор (или токен следующей страницы) и записать чекпойнт “last_cursor=abc, pulled=500”. Затем двигаться дальше. Если запрос падает, не перепрыгивайте вперёд. Ретрайте тот же курсор с экспоненциальным backoff (например, 2s, 4s, 8s), добавьте jitter и ограничьте число попыток, чтобы не забивать API.\n\nНа полпути страница 37 вернула 429. Ваш аудиторский лог в этот момент прост и конкретен:\n\n```json

{"run_id":"2026-01-17T10:00Z","cursor":"p37","status":"retry","error":"429","backoff_seconds":8,"attempt":3}

```\n\nПосле backoff страница 37 прошла. Чекпойнт обновился только после полной записи этой страницы.\n\nПозже кто‑то перезапускает тот же пул из‑за подозрения на баг. Рерун читает последний чекпойнт, продолжает с страницы 38 и использует идемпотентные записи (например, ключ prospect_id + source). Итоговый список совпадает при повторных запусках: ни пропусков, ни дубликатов и чёткая история, где были ретраи.\n\n## Частые ошибки и ловушки, которых стоит избегать\n\nБольшинство провалов из‑за лимитов самонаведены. Решение редко в умном коде — чаще это избегание предсказуемых ловушек.\n\nОдна ошибка — считать любую ошибку ретраибельной. Повторы некорректных запросов (неверные параметры, плохая авторизация, отсутствующие права) могут нагрузить API и выглядеть как злоупотребление. Ретраи должны фокусироваться на временных проблемах: 429 и 5xx, и быстро останавливаться, когда ошибка явно постоянная.\n\nЕщё одна ловушка — чрезмерная конкуррентность. Даже с экспоненциальным backoff 50 параллельных запросов могут держать вас выше лимита навсегда. Нужен стабильный темп, а не всплески. Общий лимитер (одна очередь для всех воркеров) часто лучше, чем независимые backoff в каждом потоке.\n\nПагинация — там же прячутся молчаливые проблемы данных. Offset‑пагинация на меняющемся наборе может пропускать или дублировать записи без ошибок. Предпочитайте курсор и стабильную сортировку, либо снимок по времени (pull только до фиксированного timestamp).\n\nНаконец, многие загрузки не перезапускаемы. Небольшой сбой на 80% заставляет перезапускать всё, что увеличивает нагрузку и повышает шанс дубликатов.\n\nКрасные флаги для наблюдения:\n\n- Ретрай 400/401/403 вместо быстрого провала\n- Неограниченная параллельность, игнорирующая глобальные лимиты\n- Offset‑пагинация без стабильного ключа сортировки\n- Нет чекпойнтов (последний курсор, последний ID или временная метка)\n- Отсутствие правил идемпотентности при записи результатов\n\nПример: вы тянете лидов из Apollo и задача падает — сохранённый курсор плюс правило «виденные ID» позволяют безопасно возобновить. Без этого вы перезапускаете всё, дублируете контакты и триггерите больше лимитов.\n\n## Быстрый чеклист перед следующим API‑pull\n\n### Пять проверок, которые предотвращают большинство сбоев\n\nПеред запуском подтвердите:\n\n- Лимиты записаны: запросы в минуту, дневные лимиты, правила всплесков и какие эндпоинты считаются «дорогими».\n- Пагинация детерминирована: один метод (курсоры предпочтительнее), стабильная сортировка, фиксированное окно фильтров.\n- Правила ретраев безопасны: экспоненциальный backoff, предел попыток и пауза‑и‑резюме для устойчивых 429 и временных 5xx.\n- Загрузка перезапускаема: сохранён чекпойнт (курсор или последняя timestamp/ID) и дедупликация по уникальному ключу.\n- Логирование пригодное: job ID, временное окно, счётчики запросов, значения страницы/курсора и простой итог по завершении.\n\n### Один быстрый тест на повторяемость\n\nСделайте маленькую выгрузку (например, 200 лидов) и перезапустите с теми же параметрами. Общее число должно совпасть, дубликатов быть не должно, а различия должны быть объяснимы (новые лиды за пределами фиксированного окна).\n\nЕсли вы загружаете лидов в аутрич‑систему, проверьте поведение записи: при появлении того же лида — обновляйте существующую запись, а не создавайте новую.\n\n## Следующие шаги: от стабильных выгрузок к согласованному аутричу\n\nСтабильная выгрузка важна только если она превращается в контролируемый процесс. Вопрос всегда один: как из проверенного списка перейти к отправке без изменения данных, вреда доставляемости и потери контроля?\n\n«Заморозьте» список для рассылки. Сохраните время выгрузки, применённые фильтры и итоговый счёт записей. Если нужно обогатить или дедуплицировать — делайте это один раз, фиксируйте правила и выпускайте готовый к отправке файл. Это становится источником правды для кампании.\n\nДоставляемость — следующий ворот. Даже идеальный список может не пройти, если настройка отправки кривовата. Используйте аутентифицированные домены (SPF/DKIM/DMARC), избегайте отправок с новых доменов на полную мощность и постепенно разгоняйте почтовые ящики.\n\nПрактичный хэнд‑офф от «данные готовы» к «аутрич запущен»:\n\n- Назначьте одного владельца за загрузку и одного — за кампанию (может быть тот же человек).\n- Сохраните короткий runbook: где лежит список, как он был выгружен и как его безопасно перезапустить.\n- Импортируйте только замороженный send‑ready файл в инструмент рассылки.\n- Начните с небольшой партии, затем наращивайте, оценивая ответы и bounces.\n- Отслеживайте результаты обратно к пулу: bounces, отписки и коэффициенты ответов по сегментам.\n\nЕсли хотите меньше инструментов, платформы вроде LeadTrain объединяют общие части аутрича (домены, почтовые ящики, разогрев, многошаговые последовательности и классификацию ответов), чтобы переход от построения списка к отправке оставался последовательным. Главное — повторять одни и те же правила выгрузки, ту же валидацию и те же шаги запуска, с чётким владельцем, который сможет перезапустить процесс без догадок.

Часто задаваемые вопросы

Почему загрузки списков лидов так часто ломаются при срабатывании лимитов?

Ограничение скорости обычно ломает загрузки не как явный сбой: задача прерывается посередине страницы, повторяет ту же страницу без дедупа или тихо завершается после проглатывания ошибок. В результате — пропущенные записи, дубликаты, частичное обогащение и растрата кредитов API.

В чём разница между rate limits, quotas и concurrency limits?

Rate limit — это скорость запросов, quota — это общий объём за длительный период, concurrency limit — это число одновременно выполняющихся запросов. Вы можете не превышать дневной квоты, но при всплеске конкуренции получить ошибки по минутным или burst-лимитам.

Как понять, что я упёрся в лимит API, а не в обычный аутейдж?

Логируйте коды статусов и заголовки лимитов при каждом вызове, особенно Retry-After и оставшиеся/сбросные сигналы. Сделайте небольшой тестовый pull, чтобы увидеть реальное поведение провайдера под нагрузкой — документация и практика часто отличаются.

Как пагинировать, чтобы не пропускать и не дублировать лидов?

Отдавайте предпочтение курсорной пагинации, когда она доступна, и всегда запрашивайте стабильную сортировку, чтобы порядок не менялся между вызовами. Если данные могут изменяться во время загрузки, примените фиксированный cutoff по времени, чтобы новые записи не сдвигали страницы.

Какая стратегия повторов безопасна при 429 и таймаутах?

Ретрайте только явно временные ошибки: 429, таймауты и большинство 5xx. Не ретрайте 400/401/403/404 и валидационные ошибки. При 429 следуйте Retry-After, добавьте небольшую рандомизацию и ограничьте общее время/число повторов, чтобы не застрять в цикле.

Как перезапустить упавшую загрузку, не создав дубликатов?

Делайте запись идемпотентной: используйте upsert по стабильному ключу (например, provider ID) и согласованные правила слияния, чтобы повторный запуск не менял результат. Сохраняйте контрольную точку после полной обработки страницы — при падении переигрывается максимум одна страница, поэтому дубликатов не будет.

Когда лучше использовать кэш и инкрементальные загрузки вместо повторного полного pull?

Кешируйте частые запросы и поля, которые редко меняются, с TTL, соответствующим скорости изменений. Для постоянной синхронизации используйте инкрементальные загрузки по updated_at или курсору — это снижает нагрузку и уменьшает вероятность срабатывания лимитов.

Что нужно логировать, чтобы загрузка была аудируемой?

Как минимум, логируйте job ID, параметры запроса, курсор или токен страницы, количество возвращённых записей, задержки, коды статусов и любые заголовки лимитов. Это позволит показать, что произошло на конкретной странице, и доказать, откуда произошли пропажи — от источника, загрузки или записи.

Какие метрики и алерты действительно ловят проблемы загрузок на ранней стадии?

Следите за скоростью прогресса, ошибками с разделением 4xx/5xx и частотой откатов — они показывают, движется ли загрузка вперед или застряла. Сигналы для алертов: устойчивые 429, повторяющиеся 5xx более нескольких минут или курсор, который перестал сдвигаться.

Как это влияет на рабочий процесс аутрича после импорта лидов в LeadTrain?

Медленный, стабильный темп обычно лучше всплесков, особенно когда повторные попытки накапливаются. Если вы отправляете лидов в систему аутрича вроде LeadTrain, стабильные загрузки важны: дубликаты дают двойные сообщения и запутанную аналитику, а пропуски — нарушают последовательности и follow-up.