Testes A/B de ofertas: um plano claro além das linhas de assunto

Aprenda um plano prático para testar ofertas A/B: controle variáveis, escolha tamanhos de amostra honestos e interprete resultados sem tirar conclusões barulhentas.

Por que testes de oferta A/B frequentemente dão resultados confusos

Testes de oferta em outreach frio muitas vezes parecem aleatórios porque a caixa de entrada é um lugar bagunçado. Você não está testando em laboratório. Está testando contra pessoas ocupadas, prioridades que mudam, filtros de spam e listas de leads que nunca são perfeitamente iguais.

Um motivo comum para os resultados parecerem confusos: as pessoas dizem que estão testando a oferta, mas mudam secretamente a cópia também. Se uma versão é mais curta, mais clara, mais confiante ou tem um chamado à ação mais forte, você não está mais aprendendo sobre a oferta. Está aprendendo sobre escrita.

Mesmo quando tenta isolar, a oferta está ligada ao contexto. Um “auditoria gratuita” pode parecer valiosa para um segmento e trabalho extra para outro. Se suas duas variantes acabarem chegando a cargos, tamanhos de empresa ou indústrias diferentes, os resultados oscilam e você culpa a oferta.

A maioria dos “vencedores dramáticos” é só ruído aparecendo como:

- Oscilações semana a semana porque os prospects eram diferentes, não porque a oferta era melhor.

- Amostras pequenas onde algumas respostas a mais criam um falso vencedor.

- Mudanças de entregabilidade (novos domínios, problemas de warm-up, alterações de autenticação) que mudam quem chega a ver o e-mail.

- Efeitos de timing como feriados, fim de trimestre ou um ciclo de notícias do setor.

- Tratamento inconsistente das respostas, onde uma versão recebe mais “agora não” e você conta isso como sucesso.

Um cenário familiar: você roda um teste de oferta, a Variante B recebe 6 respostas na segunda-feira, e você a declara vencedora. Depois percebe que essas respostas foram principalmente ausência temporária e adiamentos polidos, e o resto da semana fica quieto. Isso não foi mágica. Foi variância.

O objetivo não é certeza. Um teste de oferta limpo reduz a incerteza para que você possa fazer uma aposta melhor. Se tratar cada teste como evidência, não como veredito final, você para de perseguir vencedores falsos e começa a construir ofertas que se mantêm ao longo do tempo.

O que conta como oferta (e o que não conta)

Quando as pessoas dizem que querem testar ofertas, muitas vezes querem dizer “mudar o e-mail e ver o que acontece”. Isso geralmente mistura variáveis demais. Comece definindo a oferta.

Uma oferta é a troca que você propõe: o que você pede ao leitor fazer, o que ele recebe em troca e por que faz sentido agora.

As partes que são a oferta

Pense na oferta como um pacote pequeno. Mudar qualquer um destes muda a oferta:

- CTA (o pedido): “Responda SIM”, “Escolha um horário”, “Me envie o contato certo”, “Quer que eu dê uma olhada?”

- Ângulo de valor (a promessa): economizar tempo, reduzir custos, gerar mais leads, consertar entregabilidade, melhorar conversão

- Incentivo: auditoria gratuita, pacote de templates, relatório de benchmark, cartão-presente, teste estendido

- Nível de compromisso: “responda com um número” vs chamada de 5 minutos vs demo de 30 minutos

- Timing/urgência: “esta semana”, “antes do fim do mês”, “enquanto ainda temos 3 vagas”

Exemplos concretos de variantes verdadeiras de oferta:

- “Auditoria gratuita de 10 minutos dos seus e-mails outbound” vs “Demonstração do produto de 15 minutos”

- “Teste grátis de 7 dias” vs “Estudo de caso de uma página personalizado para sua empresa”

- “Vou enviar uma lista curta de ganhos rápidos” vs “Vou montar um mini plano para sua próxima sequência”

O que não é a oferta

Estes podem mudar muito os resultados, mas são testes separados:

- Linha de assunto e texto de pré-visualização

- Nome do remetente, endereço de envio, estilo de assinatura

- Fatores de entregabilidade: idade do domínio, warm-up da caixa, posicionamento em spam

- Mistura de audiência: indústria, senioridade, fonte do lead

- Horário de envio: dia da semana, hora do dia

Se seu objetivo é aprender qual oferta funciona, mantenha os itens não relacionados à oferta estáveis e mude apenas a troca que você está propondo.

Escolha uma métrica principal que você consiga medir claramente

Se você quer testar ofertas (não apenas linhas de assunto), escolha uma métrica primária de sucesso. Uma é suficiente. Múltiplas métricas “principais” convidam ao cherry-picking depois dos fatos.

Escolha a métrica que corresponde ao resultado que você realmente quer:

- Taxa de resposta positiva: qualquer resposta humana que não seja bounce ou unsubscribe

- Taxa de interesse qualificado: respostas que mostram um caso de uso real, não apenas “envie informações”

- Taxa de reuniões agendadas: o resultado de negócio mais limpo, mas mais lento para medir

- Custo por resposta qualificada: se você rastreia gasto por fonte de lead

Seja qual for a escolha, defina rótulos para que toda resposta seja contada da mesma forma. Escreva as regras antes de começar. Por exemplo:

- “Interessado” = pergunta sobre preço, cronograma, fit ou próximos passos

- “Não interessado” = recusa clara

- “Fora do escritório” = adiamento automático sem engajamento

Também defina sua janela de resposta desde o início. Uma regra prática para cold email é contar respostas que chegam dentro de 7 a 10 dias após o primeiro envio (ou dentro de 7 a 10 dias de cada etapa, se você estiver comparando ofertas dentro de uma sequência). Respostas tardias acontecem, mas adicionam ruído e podem favorecer a variante que rodou por mais tempo.

Evite usar aberturas e cliques como métrica principal de oferta. Aberturas são infladas por recursos de privacidade, e cliques podem refletir curiosidade em vez de intenção.

Como isolar a oferta e manter todo o resto estável

Testes de oferta limpos falham por uma razão simples: duas coisas mudam ao mesmo tempo. Se você quer que seus resultados signifiquem algo, precisa de uma diferença clara entre A e B, e todo o resto deve ser entediante e consistente.

Mantenha o contexto fixo

Trave o contexto antes de escrever uma linha. As mesmas pessoas devem receber A e B da mesma forma, durante a mesma janela. Caso contrário, você estará testando qualidade da lista, timing ou entregabilidade.

Mantenha estes pontos constantes:

- Fonte e filtros da lista: mesmo provedor, mesmos cargos, mesmo tamanho de empresa

- Persona e caso de uso: não misture founders com gerentes de marketing num mesmo teste

- Estrutura da sequência: mesmas etapas, mesmos atrasos, mesma lógica de follow-up

- Agendamento de envio: mesmos dias, mesmas horas, mesmos limites diários de volume

- Configuração de entregabilidade: mesmo domínio de envio e saúde da caixa

Também alinhe a estrutura do e-mail. Se a oferta A tem duas frases curtas e a oferta B é um parágrafo longo com prova extra, você mudou mais do que a oferta. Mantenha o formato alinhado: comprimento similar, número de linhas similar, mesma forma de CTA.

Mude uma coisa de propósito

Defina cada oferta em uma frase, depois edite apenas o mínimo de texto necessário para refletir a troca.

Exemplo:

- Oferta A: “Auditoria de 15 minutos com 3 correções”

- Oferta B: “Pacote de templates gratuito mais uma breve walkthrough”

Mantenha a abertura, a dor e o tom iguais. Só troque o que for a troca.

Se descobrir um problema não relacionado no meio do teste (campo de personalização quebrado, pico de bounces, problema no domínio), não corrija e continue. Pause, conserte e reinicie com um split novo e uma nota sobre o que mudou. Caso contrário você irá misturar “impacto da oferta” com “impacto do incidente”.

Passo a passo: configure o teste da ideia ao lançamento

Comece tendo cada oferta simples o suficiente para dizer em uma frase. Se você não consegue fazer isso, não consegue testar.

Escreva duas ofertas que diferem em valor, não apenas em palavras. Por exemplo:

- “Auditoria gratuita de 10 minutos dos seus e-mails outbound”

- “Vou enviar um plano de 3 slides para adicionar 10 reuniões qualificadas este mês”

Depois construa duas versões da mesma sequência. Mantenha a estrutura idêntica: mesmo número de passos, mesmos dias de envio, mesma abordagem de personalização, mesmo formato de CTA. Mude apenas a(s) linha(s) da oferta onde o valor é apresentado.

Um plano simples de construção:

- Redija a Oferta A e a Oferta B em uma frase cada.

- Duplique a sequência e mude apenas a(s) frase(s) relacionada(s) à oferta.

- Use a mesma definição de audiência e a mesma fonte de lista.

- Divida prospects 50/50 de forma aleatória para que cada variante veja pessoas comparáveis.

- Rode ambas as variantes ao mesmo tempo.

Defina suas regras antes de enviar:

- Regra de parada: uma data final fixa ou um tamanho de amostra entregue fixo por variante.

- Métrica de sucesso: a métrica que você escolheu.

- Rótulos de resposta: as definições que você usará.

Antes do lançamento, faça uma checagem final de sanidade:

- Ambas as versões pedem o mesmo tipo de resposta.

- A única diferença real é a oferta.

- O split é aleatório e simultâneo.

- A regra de parada está escrita e não mudará durante a execução.

Tamanho de amostra e timing que mantêm os resultados honestos

Testes pequenos adoram mentir. Com apenas algumas respostas, uma “sim” extra (ou uma resposta raivosa) pode alterar suas taxas em 50% ou mais.

Números práticos que geralmente se comportam

Se puder, mire em 300 a 500 prospects entregues por variante. Isso costuma ser suficiente para que algumas respostas aleatórias a mais não coroem um falso vencedor.

Se você não consegue alcançar esse volume:

- Não finja que está medindo diferenças pequenas.

- Confie apenas em oscilações grandes (por exemplo, uma oferta recebendo ~2x mais respostas positivas).

- Mantenha apenas duas variantes. Mais versões diluem demais seu volume.

O timing importa tanto quanto o volume. Performance de cold email muda por dia da semana, feriados e fadiga da caixa de entrada. Se rodar um teste por dois dias, pode estar medindo segunda vs quarta mais do que Oferta A vs Oferta B.

Um tempo mínimo mais seguro é 7 dias completos. Para audiências mais lentas a responder (enterprise, founders, líderes ocupados), 10 a 14 dias costuma ser mais realista.

A maior armadilha é espiar os resultados. Se você checa diariamente e para no momento em que uma oferta parece na frente, está escolhendo o vencedor no ponto mais ruidoso.

Escolha uma regra de parada e cumpra-a:

- Data final fixa (ex: 14 dias), ou

- Tamanho de amostra entregue fixo (ex: 400 entregues por variante)

Se o volume é baixo, ajuste o plano em vez de forçar um resultado “limpo”. Rode mais tempo, teste menos coisas ao mesmo tempo e aceite que você está buscando vitórias óbvias, não aumentos de 5%.

Como ler resultados sem reagir demais

Comece com a métrica que você escolheu antes do lançamento. Se a métrica era “respostas interessadas”, compare isso primeiro e ignore o resto por um momento. Misturar métricas extras é como convencer-se de um vencedor que não é real.

Depois separe impacto de confiança:

- Um efeito pode ser real mas pequeno demais para importar (2,0% para 2,3% de respostas interessadas pode não mover pipeline).

- Um aumento grande em uma amostra pequena ainda pode ser instável.

Antes de declarar um vencedor, verifique se os dois grupos foram realmente pareados. Distribuição desigual cria falsos aumentos, especialmente se uma variante atingiu mais cargos seniores ou uma indústria com melhor performance.

Checagens rápidas de sanidade:

- Split de audiência: cargos, tamanho da empresa, indústria, região

- Timing: alguma variante passou por semana de feriado ou dias diferentes de envio?

- Sinais de entregabilidade: bounces e reclamações de spam

- Mix de respostas, não só contagem de respostas

O mix de respostas importa porque “mais respostas” pode significar “mais objeções”. Se possível, revise respostas por categoria (interessado, não interessado, fora do escritório, unsubscribe). Uma variante que aumenta “não interessado” pode estar apenas sendo mais direta, não melhor.

Ao encerrar o teste, escreva uma nota curta de decisão:

- O que você acredita agora (com base na métrica primária)

- O que você ainda não sabe (tamanho da amostra, enviesamento, timing)

- O que fará em seguida (implementar, repetir ou estreitar a variação)

Isso mantém a experimentação calma e repetível quando os números estão próximos.

Erros comuns que criam conclusões ruidosas

A maioria dos testes “falhos” não falhou porque a oferta era ruim. Falhou porque o teste misturou sinais.

Mudar mais do que a oferta é o maior erro. Se ajustar a oferta, a linha de assunto e a audiência ao mesmo tempo, qualquer resultado vira um borrão.

Diferenças de entregabilidade são o assassino silencioso. Se a Variante A sai de uma configuração aquecida e a Variante B sai de um domínio novo ou caixa recentemente alterada, você não está testando a oferta. Está testando posicionamento na caixa de entrada. Trave sua configuração de envio durante o teste.

Desvio nos follow-ups é outro clássico. Você divide o Email 1 limpo, depois alguém edita o follow-up #2 só para uma versão ou muda o CTA. Agora você está comparando duas sequências diferentes, não duas ofertas.

Outras fontes comuns de ruído:

- Misturar audiências de forma que uma variante receba leads mais limpos ou contas maiores

- Enviar em dias diferentes ou volumes muito distintos

- Pausar uma variante no meio do teste porque resultados iniciais parecem “bons”

- Declarar vencedor porque uma grande conta respondeu (outliers mexem em amostras pequenas)

- Contar “respostas” sem separar interessado vs não interessado

Checklist rápido pré-lançamento

Antes de apertar enviar, confirme que você está realmente testando a oferta, não um amontoado de pequenas mudanças.

- Apenas uma diferença na oferta. Decida a única mudança (auditoria vs demo, teste grátis vs relatório, CTA de baixa fricção vs pedido de calendário). Mantenha o resto o mais parecido possível.

- Mesmas regras de audiência, mesma fonte de lista. Mesma origem de leads e filtros para ambas as variantes.

- Mesma sequência e cronograma. Mesmas etapas, mesmo timing, mesmos dias e volume.

- Regra de parada escrita. Decida data final ou tamanho de amostra entregue antes do lançamento.

- Rótulos de resposta claros. Defina o que conta como positivo e qualificado, incluindo casos fronteira como “agora não”.

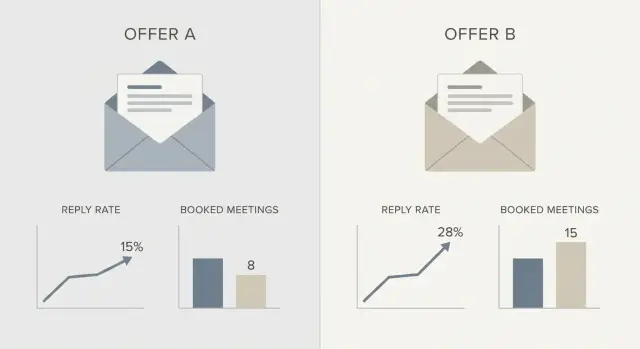

Exemplo: testar duas ofertas em uma sequência de cold email

Um SDR alcança líderes de finanças (VP Finance, Controller, Head of FP&A) em empresas SaaS de porte médio. O objetivo é aprender qual oferta gera mais interesse genuíno, não qual linha de assunto gera mais aberturas.

Duas ofertas:

- Oferta A: uma análise de 15 minutos dos e-mails outbound, seguida por 3 correções específicas que podem aplicar.

- Oferta B: um relatório curto de benchmark comparando com times SaaS similares, seguido de uma call de revisão de 10 minutos.

Para isolar a oferta, todo o resto permanece igual: filtros de audiência, configuração de envio e estrutura do e-mail. Só a troca muda.

Mantenha constante em ambas as variantes:

- Regras da lista de leads (cargo, tamanho da empresa, indústria, geografia)

- Esqueleto da cópia (linha de abertura, linha de credibilidade, formato do CTA, comprimento)

- Método de personalização (uma frase baseada em cargo ou stack de tecnologia)

- Cadência de follow-up (mesmos passos, mesmos atrasos, mesmos dias de envio)

- Identidade dos remetentes e saúde do domínio

Divida prospects 50/50 no início da sequência e rode ambos ao mesmo tempo.

Decida o vencedor usando dois números que você possa defender:

- Primário: taxa de interessados (respostas interessadas dividido por e-mails entregues)

- Secundário: reuniões agendadas, tratadas como feedback mais lento

Se a Oferta A tem taxa de interessados maior e gera pelo menos o mesmo número de reuniões agendadas após o mesmo número de dias, mantenha e itere. Se uma oferta recebe mais respostas mas a maioria é “não interessado”, provavelmente está atraindo o tipo errado de atenção.

Próximos passos: iterar com calma e facilitar testes

Uma vez que você tem um vencedor, trate-o como novo padrão, não como troféu. Faça dessa oferta a linha de base para a próxima rodada, e mude apenas um ângulo de oferta por vez.

Mantenha um log simples de experimentos para não repetir testes ou esquecer resultados:

- Hipótese

- Regras de audiência

- Datas e tamanho da amostra

- Resultados (métrica primária mais notas curtas)

- Decisão (manter, reverter, retestar)

Antes de julgar qualquer oferta, confirme que a entregabilidade está estável. Se o posicionamento na caixa de entrada estiver oscilando porque uma caixa é nova, o warm-up parou ou a autenticação mudou, corrija isso primeiro.

Se a medição consistente for um gargalo para seu time, uma plataforma tudo-em-um pode ajudar mantendo configuração e acompanhamento em um só lugar. Por exemplo, LeadTrain (leadtrain.app) combina domínios, warm-up, sequências multi-step e classificação de respostas para que você compare variantes sem muito trabalho manual.

Ao decidir o que testar a seguir, escolha a menor mudança de oferta que responda a uma pergunta real. Se seu vencedor atual gera respostas mas poucas reuniões, teste o nível de compromisso em vez de reescrever todo o pitch: CTA de menor atrito vs pedido de calendário, auditoria vs chamada de 10 minutos, ou a mesma oferta com prova diferente.

Mude um passo por vez. Aprendizado constante e estável vence movimento constante.

Perguntas Frequentes

Por que testes A/B de oferta em cold email parecem tão inconsistentes?

Os testes de oferta parecem aleatórios quando mais do que a oferta muda ou quando A e B alcançam tipos diferentes de prospects. Mantenha audiência, timing, estrutura de sequência e configuração de envio idênticos para que a única diferença significativa seja a troca que você está propondo.

O que exatamente conta como “oferta” em um cold email?

A oferta é a troca: o que você pede ao leitor, o que ele recebe e por que vale a pena agora. Mudar o CTA, o incentivo, o nível de compromisso ou a urgência é mudar a oferta, mesmo que a maior parte do e-mail permaneça igual.

Quais mudanças não fazem parte do teste de oferta, mesmo que mexam nos resultados?

Linhas de assunto, nome do remetente, comprimento do e-mail, tom, provas e fatores de entregabilidade não são a oferta, embora possam mover muito os números. Se você mudar qualquer um deles enquanto “testa a oferta”, acabará aprendendo sobre escrita ou colocação na caixa de entrada em vez da oferta.

Qual é a melhor métrica de sucesso para um teste de oferta?

Escolha um métrico primário que reflita o que você realmente quer, e mantenha-o durante todo o teste. Para a maioria das equipes, “interesse qualificado” ou “reuniões agendadas” é mais útil que taxa bruta de respostas, porque reduz a chance de premiar respostas vazias ou negativas.

Como devo rotular respostas para que os resultados não sejam distorcidos?

Escreva regras simples de rotulagem antes de enviar e aplique-as uniformemente a todas as respostas. Decida desde o início se fora do escritório, “agora não” ou “envie info” contam como sucesso, para não coroar um vencedor com pontuação inconsistente.

Como garanto que a Variante A e a B alcancem prospects comparáveis?

Execute ambas as variantes ao mesmo tempo, divida prospects aleatoriamente 50/50 e mantenha a fonte e os filtros da lista idênticos. Se uma variante recebe mais cargos seniores ou um segmento mais limpo, você estará testando a mistura da lista, não a oferta.

Quantos e-mails eu preciso por variante para confiar no resultado?

Se possível, mire em cerca de 300 a 500 entregues por variante, porque amostras pequenas variam demais. Se estiver abaixo disso, confie apenas em diferenças grandes e evite adicionar variantes extras que espalhem seu volume.

Quanto tempo devo rodar um teste de oferta antes de decidir?

Conte respostas em uma janela fixa como 7 a 10 dias após o primeiro envio, e mantenha o tempo total longo o suficiente para cobrir a variação normal dia a dia. Não pare cedo só porque uma versão parece à frente na segunda-feira; geralmente isso é ruído.

O que faço se entregabilidade ou cópia mudarem no meio do teste?

Pausa e reinicie se algo fundamental mudar, como um problema de entregabilidade, um campo de personalização quebrado ou edições em follow-ups em apenas uma variante. Se você consertar no meio do teste e continuar, vai misturar “impacto da oferta” com “impacto do incidente” e não saberá o que causou a mudança.

Como o LeadTrain pode me ajudar a rodar testes A/B de oferta mais limpos?

Use um fluxo de trabalho que mantenha a configuração de envio estável, faça cumprir sequências idênticas e aplique categorias de resposta consistentes entre variantes. O LeadTrain foi pensado para isso ao combinar domínios, caixas, warm-up, sequências e classificação automática de respostas num só lugar, para que você gaste menos tempo limpando dados e mais tempo comparando a oferta em si.