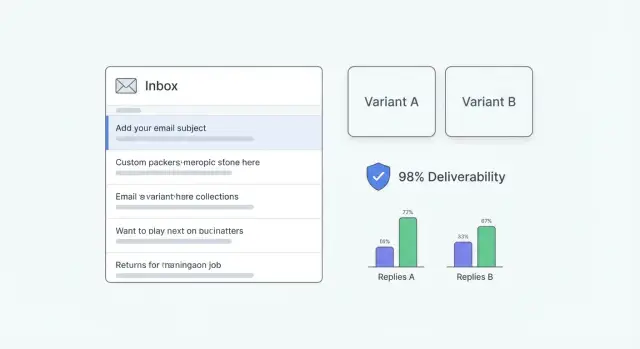

Teste A/B de emails frios com segurança: o que testar primeiro e como

Aprenda a testar A/B emails frios com segurança: o que testar primeiro, como manter variáveis limpas e como julgar resultados em amostras pequenas sem prejudicar a entregabilidade.

Por que testar A/B pode prejudicar a entregabilidade se feito de forma errada

Testar A/B em emails frios soa inofensivo, mas provedores de caixa observam padrões. Se seu “teste” for na verdade um monte de mudanças aleatórias entre listas, horários e estilos de mensagem, você gera sinais ruidosos. Isso pode parecer comportamento inconsistente do remetente, e inconsistência costuma ser tratada como risco.

Problemas de entregabilidade normalmente aparecem rápido e de forma silenciosa. Você nota menos respostas, depois as taxas de abertura caem, e mais mensagens vão para spam. Em casos piores, provedores atrasam a entrega (throttling), diferem mensagens por horas ou bloqueiam você totalmente. O perigoso é que você pode continuar enviando enquanto o desempenho piora porque nem sempre surge um erro claro.

Cold email tem margem pequena para erro. Um teste de linha de assunto que aumenta ligeiramente reclamações por spam pode apagar qualquer ganho em respostas. Uma nova variante de “oferta” que soa agressiva pode gerar deleções rápidas, outro sinal negativo.

O erro mais comum é testar muitas coisas ao mesmo tempo. Se a Variante B muda assunto, abertura, oferta e CTA, você não consegue saber o que causou o resultado. Além disso, corre o risco de criar uma versão que dispara mais sinais negativos e puxa a reputação de todo o domínio para baixo.

Pausa os testes e conserte o básico primeiro se você ver um pico súbito de bounces ou cancelamentos, mais colocações em spam do que o normal, mensagens chegando muito mais tarde que o habitual, variações diárias estranhas sem motivo claro, ou se estiver enviando de domínios ou caixas novas que ainda não foram aquecidos.

Exemplo: uma pequena equipe envia 500 emails e “testa” cinco ângulos diferentes em fontes mistas. Um ângulo gera algumas reclamações e agora todos os envios futuros daquele domínio performam pior, inclusive as boas versões.

Noções básicas de entregabilidade que você precisa antes de começar a testar

Entregabilidade é simples: provedores observam seu comportamento de envio e decidem se seus emails parecem confiáveis. Se muitas pessoas ignoram você, marcam como spam ou você atinge muitos endereços inválidos, seus próximos emails têm maior chance de ir para spam ou serem bloqueados.

Sua reputação é rastreada em mais de um lugar. A reputação de domínio é a confiança geral do domínio que você usa para enviar. A reputação de caixa (ou remetente) é a confiança ligada a uma conta específica e seu comportamento recente. Testes ficam confusos quando você mistura esses sinais. Se uma variante sair de uma caixa nova ou domínio diferente, você não está testando só o copy; está testando reputação.

Warm-up e ramp-up ajudam, mas não são mágicos. Warm-up constrói um padrão de envio normal e engajamento ao longo do tempo. Ramping significa aumentar volume gradualmente para não parecer um remetente novo disparando centenas de emails da noite para o dia. Nenhuma das duas salva você se sua lista for ruim ou se você mudar muitas coisas ao mesmo tempo.

A qualidade da lista é a maneira mais rápida de quebrar entregabilidade. Altas taxas de bounce indicam aos provedores que você não mantém seus contatos.

Antes de qualquer teste, faça uma higiene rápida: retire contas de função (info@, support@, sales@) a menos que tenha motivo real, evite leads estagnados, monitore bounces duros e pare de enviar para endereços similares, mantenha o direcionamento apertado para que as respostas combinem com a oferta, e não envie a mesma pessoa repetidamente em variantes diferentes.

Consistência vence copy esperta no começo. Se você está em um domínio novo, mantenha padrões de envio estáveis (volume, horário, from-name) e teste uma variável por vez. Se você dobrar o volume diário e mudar a linha de assunto na mesma semana, não saberá se o “vencedor” venceu porque era melhor ou porque a entregabilidade mudou.

O que testar primeiro: assunto, oferta ou CTA

Uma ordem prática é: linha de assunto primeiro, depois oferta, e por último CTA. É menos arriscado e mais fácil de aprender.

1) Linha de assunto primeiro (impacta principalmente aberturas)

Se as pessoas não abrem, nada mais importa. Testar assunto também é a mudança mais leve porque você pode manter o corpo do email idêntico.

Mantenha a hipótese simples e testável: “Adicionar um resultado concreto aumentará aberturas” ou “Assuntos mais curtos melhorarão aberturas.” Não mude o nome do remetente, horário de envio e a primeira linha ao mesmo tempo ou você não saberá o que causou a movimentação.

2) Oferta em seguida (impacta principalmente respostas)

Quando aberturas estiverem razoáveis, a oferta costuma gerar respostas. A oferta é o motivo para responder, não as palavras que você usa para pedir uma reunião. Pense: uma auditoria rápida, um benchmark curto, um case relevante ou uma promessa clara de tempo economizado.

Mantenha testes de oferta limpos mudando apenas o valor enquanto estrutura, comprimento e tom permanecem estáveis. Testes de oferta frequentemente produzem oscilações maiores que pequenos ajustes de texto.

3) CTA por último (impacta a qualidade das respostas)

O CTA define quão fácil é responder. Teste o menor compromisso primeiro: perguntas simples de sim/não, “Vale uma conversa?” vs “Consegue terça às 14h?”. Pequenas mudanças no CTA podem melhorar a qualidade das respostas sem mudar seu posicionamento.

Evite reescritas completas onde assunto, primeira linha, oferta e CTA mudam juntos. Se quiser aprendizado real, escolha uma variável e escreva o que espera mover (aberturas ou respostas) antes de enviar.

Como manter variáveis limpas e comparações justas

Testes justos são entediantes por design. Se duas versões diferem em mais de uma forma significativa, você não saberá o que causou o resultado.

“Mudar uma coisa” significa uma decisão que o leitor nota. Se você testa assunto, mantenha preview text, primeira sentença, oferta, CTA e agenda de envio iguais. Mesmo uma mudança de tom (amigável vs formal) pode virar uma segunda variável se altera a sensação do email.

Crie uma versão de controle que você possa manter por um tempo. Escolha seu email com melhor desempenho atual, bloqueie-o e nomeie claramente (Control v1). Trate-o como baseline que só substitui quando uma nova versão vencer mais de uma vez. Isso impede que você persiga ruído reescrevendo tudo toda semana.

Divida sua audiência aleatoriamente. Não envie Variante A para fundadores e Variante B para marketers e chame isso de teste. Se sua lista tem segmentos claros, estratifique: divida cada segmento ao meio para que ambas as variantes recebam uma mistura similar.

Durante o teste, mantenha iguais fonte e regras de filtragem de leads, dias de envio e janela de horário, passos e espaçamento de follow-up, domínio de envio e pool de caixas, e regras de supressão (bounces, cancelamentos, do-not-contact).

Um grupo holdout ajuda quando condições mudam. Manter 10% a 20% no controle enquanto testa variantes facilita notar se entregabilidade ou qualidade de leads mudou para todo mundo.

Passo a passo: rode seu primeiro teste A/B seguro

Um primeiro teste seguro é intencionalmente simples. Você quer uma mudança clara, uma divisão limpa e regras de parada para não trocar um pequeno ganho por problemas de entregabilidade no longo prazo.

-

Escolha uma métrica-alvo antes de escrever qualquer coisa. Aberturas podem enganar em listas muito frias. Uma escolha prática é taxa de resposta. Se sua equipe consegue etiquetar respostas de forma confiável, use taxa de resposta positiva (respostas interessadas divididas por emails entregues).

-

Escreva Variante A e Variante B com apenas uma diferença. Comece por uma alavanca, como a linha de assunto. Mantenha nome do remetente, abertura, oferta, CTA e assinatura idênticos.

-

Divida de forma justa. Mesma fonte de leads, mistura parecida de senioridade e região, e mesma janela de envio. Se tiver 400 prospects, divida 200/200 aleatoriamente. Se tiver só 80, divida 40/40 e ajuste expectativas.

-

Defina guardrails para não queimar uma caixa. Decida limites de pausa antes: se a taxa de bounce subir, reclamações por spam aparecerem ou cancelamentos aumentarem vs sua linha de base, pare e diagnostique.

-

Lance, cheque diariamente e siga suas regras de parada. Monitore entregues, bounces, reclamações, cancelamentos e respostas. Se os guardrails dispararem, pare o teste e corrija a causa raiz (qualidade da lista, direcionamento ou tom) antes de rodar outro.

Exemplo: um pequeno time de SDR testa duas linhas de assunto em um segmento novo. Mantêm o corpo e CTA idênticos, dividem a lista igualmente e rodam por três dias úteis. Uma sujeito vence por alguns replies, mas cancelamentos também aumentam, então eles mantêm o assunto que abriu menos e reescrevem a abertura do email em vez de seguir com o “vencedor”.

O que medir para não escolher o vencedor errado

Se você medir a coisa errada, pode “vencer” um teste A/B e ainda assim perder reuniões ou, pior, prejudicar sua reputação de envio. O objetivo não é mais atividade, é melhores conversas com as pessoas certas.

Aberturas: úteis às vezes, enganosas frequentemente

Taxas de abertura ajudam a detectar problemas óbvios (como um assunto que recebe quase zero de aberturas). Mas para escolher um vencedor, aberturas são instáveis. Muitos apps prefetch de imagens e algumas empresas bloqueiam tracking. “Aberto” nem sempre significa que um humano leu seu email.

Trate aberturas como alarme, não como placar. Se a Variante B tem um pouco mais de aberturas mas menos respostas, as respostas devem prevalecer.

Respostas, respostas positivas e rótulos consistentes

Defina resultados antes de enviar e mantenha os mesmos rótulos para cada teste. Um conjunto simples basta: resposta positiva (interesse claro ou sugestão de próximos passos), resposta neutra (agora não, tente depois), resposta negativa (não interessado), resposta administrativa (fora do escritório, pessoa errada), e cancelamento ou reclamação.

Acompanhe tanto a taxa de resposta (todas as respostas humanas) quanto a taxa de resposta positiva. A primeira mostra se sua mensagem convida à interação; a segunda mostra se sua oferta e direcionamento funcionam.

Também monitore a saúde da entregabilidade junto com os resultados. Não ignore bounces, bloqueios, reclamações e cancelamentos só porque “o teste é pequeno.” Uma variante que gera algumas respostas a mais mas dobra reclamações é um mau negócio.

Se puder, veja desempenho por caixa e por domínio, não apenas no total. Um remetente fraco pode puxar os resultados para baixo e esconder a história real.

Como avaliar resultados com amostras pequenas

Testes A/B pequenos podem enganar. Uma versão pode “vencer” porque recebeu leads melhores, ou porque um remetente estava com reputação ligeiramente melhor naquela semana. Com apenas algumas respostas, o acaso tem grande peso.

Não julgue um teste por envios ou aberturas. Mire em resultados que importam, como respostas positivas ou reuniões agendadas. Se você só tiver 1 a 3 respostas no total, não aprendeu de fato qual mensagem funciona.

Uma forma prática de interpretar resultados pequenos:

- Vitória direcional: claramente mais respostas positivas, mas totais ainda baixos (2 vs 0). Trate como pista.

- Vitória forte: diferença repetível após mais eventos (10 vs 4 respostas positivas). Geralmente suficiente para escolher um vencedor.

- Sem sinal: resultados próximos ou que mudam conforme o dia ou caixa. Chame de inconclusivo.

Agrupar dados por dias e caixas ajuda só quando condições se mantêm iguais: mesmas regras de audiência (mesmo ICP e fonte), agenda de envio similar (mesmos passos e espaçamento) e entregabilidade estável (sem domínio novo, sem mudanças de warm-up). Se você mudar algo importante como oferta, direcionamento ou volume, recomece o teste.

Rode até atingir um limiar de respostas, não um prazo no calendário. Pare cedo apenas para uma vitória forte. Caso contrário, continue até ter respostas suficientes para confiar na direção, ou declare inconclusivo e teste uma mudança maior.

Como testar sem danificar a reputação do remetente

A/B testing só é útil se sua reputação de envio se mantiver estável. Se a entregabilidade cair no meio do teste, você pode acabar “aprendendo” que uma versão é pior quando, na verdade, foi o posicionamento em caixa que desabou.

Controle o volume. Mantenha envios diários constantes e aumente em passos pequenos ao longo de dias em vez de pular de 50 para 500 da noite para o dia. Picos repentinos parecem não naturais e podem disparar throttling ou colocação em spam.

Se precisar de mais volume, aumente capacidade de forma segura: distribua envios por mais caixas aquecidas em vez de pressionar uma caixa só.

Enquanto testa o primeiro email, mantenha o restante da sequência consistente. Não mude timing de follow-up, copy de follow-up ou número de follow-ups no meio do teste. Caso contrário você testa o primeiro toque mais a “pressão da sequência”.

Evite mudanças ocultas que afetem colocação na caixa: trocar domínios, mudar horários, alterar configurações de tracking (especialmente rastreamento de abertura) ou mudar o comportamento de warm-up durante a janela do teste.

Se qualquer sinal de parada aparecer, pause e estabilize antes de continuar: salto na taxa de bounce vs baseline, aumento de reclamações, muitas mensagens adiadas ou diferidas, picos de cancelamento, ou respostas mencionando spam ou “por que estou recebendo isso?”.

Exemplo: uma agência de duas pessoas testa um novo assunto. Mantêm 40 envios por caixa por dia, rotacionam entre três caixas aquecidas e rodam o teste por uma semana. Pausam assim que bounces aumentam após carregar um segmento novo, limpam a lista e então retomam.

Erros comuns que tornam testes A/B inúteis ou arriscados

A maior parte das “vitórias” celebradas vem de setups confusos, não de copy melhor.

O erro maior é mudar várias coisas ao mesmo tempo. Se a Versão A tem novo assunto, oferta diferente e novo CTA, você não sabe o que causou a mudança. Mudanças grandes no texto entre variantes também podem parecer comportamento inconsistente, o que não é bom para entregabilidade de cold email.

Outros erros que arruinam testes:

- Mudar silenciosamente a audiência entre A e B (tamanho da empresa, cargos, geografia).

- Declarar vencedor por causa de 1 ou 2 respostas extras.

- Super-otimizar por aberturas com um assunto chamativo que não corresponde ao corpo.

- Ignorar cancelamentos, reclamações e bounces só porque as respostas parecem boas.

Também fique atento a drift de setup: enviar em horários diferentes, usar domínios distintos ou ajustar warm-up no meio do teste.

Se quiser resultados confiáveis, mantenha uma variável por teste, divida leads similares de forma igual e trate cancelamentos e reclamações como sinal de parada rígido.

Exemplo: uma pequena equipe testando emails frios em uma lista limitada

Um time de SDR tem 500 prospects. Enviam de duas caixas e rodam uma sequência simples de 3 passos para acompanhar resultados sem aumentar muito o volume.

Rodeiam o teste do jeito seguro: mudam uma coisa, mantêm todo o resto igual e dividem a lista ao meio. Atribuem 250 prospects para Versão A e 250 para Versão B, mantendo as mesmas indústrias e cargos em cada grupo.

Teste 1: assunto A vs B

Testam só a linha de assunto. Corpo, oferta, CTA, horários e follow-ups ficam idênticos.

Após alguns dias, o Assunto B tem mais aberturas. Ficaram tentados a decretar vencedor, mas respostas são basicamente as mesmas e a qualidade das respostas não melhorou. Isso geralmente significa que o assunto gerou curiosidade, mas o corpo/oferta não entregaram, ou o CTA pedia demais. Eles mantêm o assunto que abriu mais, mas não o tratam como grande avanço.

Teste 2: ajuste de oferta vs ajuste de CTA

A seguir, escolhem conforme o gargalo. Como as aberturas subiram mas as respostas não, focam no corpo e testam uma mudança limpa por vez, não as duas juntas.

Documentam cada teste em uma nota compartilhada: hipótese, cópia exata de A e B, regras de audiência, resultados (aberturas, respostas, respostas positivas, cancelamentos) e a decisão (manter, descartar ou retestar). Esse registro impede que repitam os mesmos experimentos.

Checklist rápido e próximos passos práticos

Antes de rodar A/B em cold emails, faça uma checagem rápida. Muitos “maus resultados” são problemas de lista ou entregabilidade.

Antes de enviar, confirme: autenticação em dia (SPF, DKIM, DMARC), caixas aquecidas e enviando com regularidade, lista limpa e relevante, ambas as versões saindo na mesma janela de dia/horário, e que sua sequência e tratamento de respostas funcionam do começo ao fim.

Depois, mantenha o teste simples: mude só uma coisa (assunto, oferta ou CTA), divida a audiência justamente, escolha uma métrica-alvo (frequentemente taxa de resposta positiva) e escreva uma regra de parada antecipada.

Depois do lançamento, não proclame vencedor após poucos envios. Limite volume enquanto testa, monitore bounces, cancelamentos e reclamações diariamente e garanta que os resultados não são puxados por uma única caixa. Se respostas forem poucas para decidir, estenda o teste ou faça uma mudança maior (geralmente na oferta).

Se quiser menos variáveis enquanto roda testes controlados, LeadTrain (leadtrain.app) mantém domínios, caixas, warm-up, sequências multi-step e classificação de respostas em um só lugar, assim você tem menos chances de mudar o setup sem querer enquanto tenta testar copy.

Perguntas Frequentes

How do I run an A/B test without hurting deliverability?

Comece com apenas uma mudança — normalmente a linha de assunto — e mantenha todo o resto idêntico: fonte de lista, janela de envio, domínio, pool de caixas e passos da sequência. Defina limites de pausa para bounces, cancelamentos e reclamações antes de lançar, assim uma variante “vencedora” não danifica a reputação sem que você perceba.

Why can A/B testing make deliverability worse?

Porque testar várias coisas ao mesmo tempo cria padrões inconsistentes entre envios, e provedores de inbox podem interpretar isso como comportamento de risco. Se uma variante gerar mais deleções, reclamações ou bounces, isso pode baixar a reputação de todo o domínio e fazer até os emails bons irem para spam.

What should I test first: subject line, offer, or CTA?

Teste a linha de assunto primeiro, depois a oferta e por último o CTA. Essa ordem reduz risco e facilita entender o que mudou: assuntos influenciam principalmente aberturas, ofertas tendem a gerar respostas, e o CTA afeta a qualidade da resposta.

What metric should I use to choose the winner?

Um padrão comum é usar taxa de resposta positiva (respostas interessadas divididas pelos emails entregues), pois alinha com resultados reais. Aberturas podem sinalizar problemas, mas não são confiáveis para escolher vencedores em cold outreach, já que tracking pode ser bloqueado ou inflado.

When should I pause testing and fix deliverability first?

Pause quando bounces ou cancelamentos aumentarem, mensagens chegarem muito atrasadas ou a colocação em spam aumentar. Também pause se você estiver enviando de domínios ou caixas novas que não foram aquecidas: mudanças de reputação podem sobrepor o efeito da copy.

How do I keep variables clean so the comparison is fair?

Se você está testando a linha de assunto, mantenha o preview text, a primeira frase, a oferta, o CTA, a assinatura e a programação de envio iguais. Divida a mesma audiência aleatoriamente (ou divida cada segmento ao meio) para que a Variante A e B recebam uma mistura similar de cargos, indústrias e regiões.

What is a control, and why do I need one?

É a versão base que você usa como referência (por exemplo Control v1). Mantenha-a inalterada por um tempo e só a substitua quando uma nova versão vencer mais de uma vez. Isso evita que você persiga ruído e fique redefinindo constantemente o que é “normal”.

How do I judge A/B test results with a small list?

Não confie em resultados vindos de poucas respostas; a aleatoriedade é grande com baixo volume. Trate ganhos pequenos como indicações direcionais e ou estenda o teste até ter respostas positivas suficientes para confiar ou considere o teste inconclusivo e faça uma mudança maior (geralmente na oferta).

How do I control volume so I don’t get throttled or flagged?

Mantenha o volume diário estável e evite picos repentinos, especialmente durante um teste. Se precisar de mais capacidade, espalhe envios por várias caixas aquecidas em vez de forçar uma única caixa, e não altere o comportamento de warm-up no meio do teste.

How can LeadTrain help me A/B test cold emails more safely?

LeadTrain reúne domínios, caixas, aquecimento, sequências e classificação de respostas em um único lugar, reduzindo o “setup drift” acidental durante testes. Assim fica mais fácil manter domínio e pool de caixas consistentes enquanto você muda apenas uma variável na sua copy.