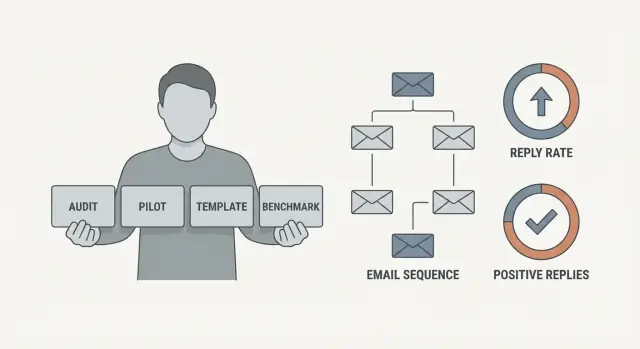

Testes de ofertas em cold email: auditoria, piloto, modelo e benchmark

Estrutura de teste de ofertas em cold email para comparar auditoria, piloto, modelo e benchmark de forma justa, usando a mesma qualidade de lista e métricas.

Por que testar a oferta, não apenas a linha de assunto

Uma linha de assunto pode ganhar a abertura, mas raramente garante a resposta. A maioria dos cold emails morre depois da abertura porque a oferta fica vaga, parece arriscada ou simplesmente não vale o tempo de alguém.

A oferta é a decisão real: “Quero isso o suficiente para responder a um desconhecido?” Você vê essa decisão na qualidade das respostas, não na taxa de abertura. Uma linha de assunto astuta pode aumentar aberturas, mas uma oferta fraca ainda resulta em silêncio, respostas vagas do tipo “talvez depois” ou recusas rápidas.

Ofertas diferentes também atraem tipos diferentes de “sim”. Uma auditoria atrai quem quer feedback rápido. Um piloto atrai compradores dispostos a testar. Um modelo apela para times que preferem fazer por conta própria. Um relatório de benchmark atrai prospects que querem contexto antes de conversar.

Quando você testa ofertas, acompanhe resultados que reflitam intenção real:

- Respostas positivas (interesse claro, perguntas, pedidos de detalhes)

- Intenção de reunião (disponibilidade, “podemos conversar?”)

- Interesse qualificado (persona certa, dor real)

- Sinais negativos (não é relevante, pare de enviar, descadastros)

Testes de oferta falham quando a qualidade da lista muda entre rodadas. Se uma oferta for enviada para contas melhores ou dados mais recentes, ela vai parecer vencedora mesmo que não seja. Isso gera confiança falsa e resultados que não são repetíveis.

Um exemplo simples: você testa uma “auditoria gratuita” em uma lista limpa de empresas de médio porte com contratações ativas, depois testa um “programa piloto” em uma lista mista que inclui empresas muito pequenas e contatos antigos. A auditoria “vence”, mas você testou principalmente a qualidade da lista, não a oferta.

Mantenha o objetivo claro: descobrir qual oferta gera mais respostas positivas do mesmo tipo de prospect.

As quatro ofertas e o que elas sinalizam para os prospects

Ao mudar a oferta, você muda o que o leitor pensa que você quer deles. Não é só dinheiro, é tempo, confiança e atenção. Um bom teste compara ofertas que parecem significativamente diferentes enquanto mantém o resto do e-mail igual.

Auditoria: diagnóstico de baixo compromisso

Uma auditoria é um convite do tipo “me mostre o que está errado”. Funciona melhor quando o escopo é estreito e a entrega é concreta, como “um checklist de entregabilidade de 1 página” ou “3 lacunas específicas na sua sequência de follow-up”.

O sinal é baixo esforço para eles e esforço moderado para você. Pode construir confiança rápido porque você oferece insight antes de pedir uma reunião. Mas se for vago (“auditoria gratuita”), pode soar como armadilha que leva direto a um pitch.

Piloto: teste com prazo definido

Um piloto diz “vamos testar isso de forma pequena e segura”. Pode ser pago ou gratuito, mas deve ser limitado por tempo ou tamanho, como “2 semanas”, “uma equipe” ou “um segmento”. Diga quem se qualifica para não soar como se você estivesse implorando para alguém participar.

O sinal exige mais confiança, mas tem maior valor percebido. Um piloto implica trabalho real e resultados. Também pode criar atrito se o próximo passo parecer pesado (contratos, setup, reuniões).

Modelo: ativo pronto para usar

Um modelo é “aqui está algo que você pode usar hoje”. Pense em scripts, checklists, calculadoras ou um playbook curto. Nomeie o trabalho que ele ajuda a fazer, não o tipo de arquivo, por exemplo “uma sequência de 5 e-mails para reativar leads inativos”.

O sinal é valor rápido com esforço muito baixo. Modelos podem gerar respostas rápidas, mas também atraem quem só quer aproveitos grátis. Ajuda tornar o modelo específico para o cargo ou situação deles.

Benchmark: relatório comparativo

Um benchmark é “veja como você se compara”. Pode se basear no seu conjunto de dados, fontes públicas ou em um pequeno conjunto de inputs que eles forneçam. O que importa é o enquadramento, como “taxa média de resposta no seu nicho” ou “motivos comuns pelos quais prospects dizem não”.

O sinal é credibilidade e autoridade, mas também escrutínio. Pessoas vão questionar a origem dos números. Se a fonte de dados não estiver clara, a oferta pode parecer inventada.

Em todas as quatro, você testa uma coisa: qual promessa vale uma resposta. Auditoria apoia-se na clareza, piloto na compromisso, modelo na rapidez e benchmark na prova.

Mantenha a qualidade da lista igual para que o teste seja justo

A forma mais rápida de obter um “vencedor” falso é enviar cada oferta para um tipo diferente de prospect. Uma auditoria parecerá incrível se for enviada para empresas que já estão procurando ajuda, enquanto um modelo parecerá fraco se for enviado para quem nunca lida com aquele problema.

Comece com um público bem definido e 1–2 personas. Mantenha simples: um cargo que você pode nomear, uma dor principal, uma razão para se importar agora.

Então trave a fonte da lista. Escolha um lugar de onde você vai puxar prospects e não misture fontes durante o teste. Fontes diferentes significam atualidade e precisão diferentes, o que pode alterar os resultados mais do que a oferta em si.

Anote regras de inclusão antes de montar a lista e aplique-as a todas as quatro variantes: cargo e senioridade, indústria, região/idioma e tamanho da empresa. Limpe a lista da mesma forma toda vez também. Remova clientes atuais, parceiros e qualquer pessoa com quem você teve uma conversa real recentemente. Essas pessoas respondem de forma diferente e podem distorcer os resultados.

Por fim, randomize uma vez e divida igualmente para que cada oferta receba uma mistura similar de indústrias, tamanhos e cargos.

Decida o que fica fixo e o que você vai medir

Testes de oferta só funcionam quando você os trata como um experimento controlado. Se você mudar três coisas de uma vez, não saberá se a auditoria “venceu” porque era melhor ou porque tinha um nome de remetente diferente, uma sequência mais longa ou um pedido mais forte.

Escolha uma métrica primária. Para a maioria das equipes, a escolha mais limpa é a taxa de resposta positiva: respostas que mostram interesse claro, não apenas “obrigado” ou “pare de enviar”. Ela mapeia intenção e é menos ruidosa que aberturas ou cliques.

Adicione algumas métricas secundárias para identificar custos ocultos: taxa total de respostas, reuniões agendadas (ou chamadas qualificadas), descadastros/queixas de spam (se disponível) e taxa de bounce como verificação rápida da qualidade da lista.

Mantenha a “plumbing” constante entre as quatro ofertas: mesma identidade do remetente e domínio de envio, mesmo comprimento de sequência e timing (por exemplo, 3 passos em 7–10 dias), mesmo estilo de CTA, mesmas regras de segmentação e volume diário semelhante para que a entregabilidade não oscile.

O que deve mudar? Apenas a oferta e um pequeno elemento de prova que a sustente.

Crie e-mails comparáveis para auditoria, piloto, modelo e benchmark

Para um teste justo, os e-mails devem parecer irmãos, não estranhos. Escreva um e-mail base e troque apenas o bloco da oferta.

Comece com uma declaração do problema que você possa reutilizar palavra por palavra. Escolha um problema específico e doloroso, mas comum em toda a lista. Mantenha isso idêntico nas quatro versões para que você esteja testando a oferta, não o enquadramento.

Mantenha o padrão de abertura, a forma do CTA, o comprimento, o tom e a identidade do remetente consistentes. Depois escreva o valor específico da oferta em 1–2 frases. Procure fazer cada oferta igualmente fáceis de entender e semelhantes em esforço para o leitor.

Linhas de oferta de exemplo com a mesma estrutura:

- Auditoria: “Posso fazer uma auditoria rápida dos seus e-mails de follow-up e apontar 3 lacunas específicas que estão custando respostas.”

- Piloto: “Posso configurar um piloto pequeno de 2 semanas com um segmento limitado para você ver resultados antes de se comprometer.”

- Modelo: “Posso compartilhar o modelo exato de follow-up que usamos, adaptado ao seu produto e público.”

- Benchmark: “Posso enviar um pequeno relatório de benchmark mostrando como ficam as taxas de resposta para times semelhantes, além de 2 correções práticas.”

Adicione um ponto de prova por oferta e mantenha simples (tempo de entrega, formato, escopo). Evite empilhar pontos de prova até que uma variante não pareça mais forte por razões alheias à oferta.

Mantenha o CTA idêntico em forma nas quatro versões. Uma pergunta clara geralmente funciona melhor: “Quer que eu envie?” ou “Posso enviar o rascunho?”.

Passo a passo: execute o teste de oferta como um único experimento controlado

Execute como um teste único, não quatro campanhas separadas

Comece com uma lista de prospects, embaralhe-a e então divida em quatro grupos iguais. Cada grupo deve parecer semelhante: mesma mistura de cargos, tamanhos de empresa, indústrias e geografias.

Atribua uma oferta por grupo (auditoria, piloto, modelo, benchmark) e não mude a atribuição durante o teste. Se você “ajuda” uma oferta dando-lhe contas melhores, você não está mais testando a oferta.

Um fluxo simples:

- Randomize a lista e divida em quatro buckets iguais

- Mapeie uma oferta a cada bucket e rotule-os

- Envie a mesma estrutura de sequência a todos os buckets (mesmos passos, mesmos intervalos)

- Congele outros experimentos durante a janela

- Termine o teste apenas depois que cada bucket atingir o tamanho de amostra planejado

Mantenha todo o resto fixo

Use os mesmos domínios e caixas postais de envio, o mesmo volume diário, o mesmo horário de envio e a mesma cadência de follow-up. Mantenha o nível de personalização consistente e o formato do CTA também.

Decida a regra de parada antes de começar

Escolha um tamanho mínimo de amostra por grupo e uma janela de tempo, depois cumpra isso. Parar cedo porque uma oferta “parece boa” é a forma de se enganar.

Procure executar pelo menos um ciclo completo de sequência para que respostas tardias contem.

Como interpretar resultados sem se enganar

Testes de oferta frequentemente são “vencidos” pelo e-mail errado quando equipes focam em aberturas ou respostas totais. Decida de antemão como é um bom resultado e então classifique todas as respostas do mesmo jeito.

Defina uma resposta positiva em termos claros. “Parece interessante” não é o mesmo que “sim, agende horário”. Se a definição mudar no meio do teste, você acabará escolhendo a oferta que pessoalmente prefere.

Uma forma prática de pontuar respostas:

- Positivo qualificado: pede ligação, preço, cronograma ou próximos passos

- Positivo brando: tem interesse mas precisa de mais info ou seguimento posterior

- Neutro: fora do escritório, respostas automáticas

- Negativo: não interessado, não é relevante, pare de enviar

- Redirecionamento: indica a pessoa certa

Monitore também negativos ocultos que podem prejudicar performance futura: descadastros, queixas de spam e respostas agressivas.

Depois compare resultados de duas maneiras: por oferta e por segmento de persona. Um modelo pode funcionar melhor para founders, enquanto um benchmark pode ressoar mais com um líder de marketing. Se você olhar apenas o total, pode perder um claro vencedor por persona.

Ao escolher o vencedor, pese volume e qualidade. Se a Oferta A recebe 12 positivos mas apenas 2 são qualificados, enquanto a Oferta B recebe 8 positivos com 6 qualificados, a Oferta B costuma ser melhor para gerar reuniões.

Cenário de exemplo: uma lista, quatro ofertas, um vencedor claro

Maya é uma SDR que vende software de RH para empresas de médio porte. Ela quer testar ofertas sem mudar a qualidade da lista, então ela puxa um segmento limpo: Diretores de RH em empresas de 200 a 1.000 funcionários nos setores de varejo e logística. Mesma fonte de dados, mesmos filtros, mesmo volume de envio.

Ela mantém um ponto de dor igual em todas as ofertas: times de RH perdem horas por semana correndo atrás de etapas de onboarding faltantes, e as transições quebram quando há picos de contratação.

Ela enquadra a mesma dor de quatro formas:

- Auditoria: “Posso revisar seu fluxo de onboarding e apontar onde etapas são perdidas (sem preparo, apenas uma rápida chamada).”

- Piloto: “Escolha uma localidade ou um gestor de contratação e rode um piloto de 14 dias para comprovar tempo economizado.”

- Modelo: “Posso compartilhar o checklist de onboarding mais modelos de e-mail que vemos funcionando para times semelhantes.”

- Benchmark: “Posso enviar um breve benchmark comparando seu processo com o de pares (tempo até o primeiro dia, taxa de conclusão, pontos de queda).”

Depois de duas semanas, as taxas de abertura são similares, mas as respostas não. O Modelo vence em total de respostas positivas e em tempo até a reunião mais rápido. A Auditoria gera curiosidade educada, mas menos agendamentos. O Piloto atrai empresas maiores, mas desacelera por questões de procurement. O Benchmark soa “de consultoria” e gera mais redirecionamentos.

Ela melhora a sequência vencedora sem reiniciar todo o teste: e-mail 1 oferece o modelo, e-mail 2 faz uma pergunta qualificadora (“O onboarding é gerido pelo RH ou por cada departamento?”), e o e-mail 3 introduz o piloto apenas depois de alguém interagir.

Erros comuns que tornam testes de oferta inúteis

A maioria dos testes falha porque mudam muitas coisas de uma vez ou escolhem um vencedor com base no sinal errado.

Erros comuns:

- Mudar a oferta e a linha de assunto (ou a primeira frase) ao mesmo tempo

- Dar a uma oferta uma fatia melhor da lista (cargos com maior intenção, dados mais limpos)

- Parar cedo após poucas respostas

- Julgar por aberturas ou cliques em vez de respostas positivas e reuniões

- Ignorar descadastros, queixas e dano à entregabilidade

Uma correção simples: escolha uma métrica primária (respostas positivas que podem levar a reunião), rastreie o lado negativo (descadastros e queixas), e mantenha condições de envio consistentes.

Também observe como respostas são rotuladas. Uma caixa de entrada bagunçada facilita contar “talvez” como vitória.

Checklist rápido e próximos passos

Antes de enviar, verifique se seu teste realmente é um teste:

- Divida a lista randomicamente e de forma igual

- Trave as constantes (remetente, cadência, número de follow-ups, estilo de CTA)

- Defina métricas de sucesso antecipadamente

- Concorde sobre o que conta como resposta positiva

- Faça um check de sanidade da entregabilidade (domínio autenticado, caixa aquecida, rastreamento funcionando)

Durante o envio, não mexa na cópia no meio do voo. Se você muda o motor enquanto dirige, não vai saber o que causou o resultado.

Depois do teste, use uma regra clara de vencedor: maior taxa de resposta positiva, com volume suficiente para confiar no resultado, e níveis aceitáveis de descadastros/queixas.

Se você quer menos variáveis enquanto roda testes assim, LeadTrain (leadtrain.app) reúne domínios, caixas, warm-up, sequências e classificação de respostas em um lugar para que cada variante de oferta rode sob as mesmas condições.

Perguntas Frequentes

Why should I test the offer instead of only testing subject lines?

Teste a oferta quando você se importa com respostas e reuniões, não apenas com aberturas. Uma linha de assunto pode chamar atenção, mas é a oferta que faz alguém decidir que vale a pena responder e dar o próximo passo.

How do I keep list quality the same across offer variants?

Comece com uma audiência limpa e uma única fonte de dados, depois randomize a lista uma vez e divida-a igualmente. Mantenha as mesmas regras de inclusão para cada variante para não acabar testando “contas melhores” contra “contas piores”.

What’s the best metric to pick a winning offer?

Use a taxa de resposta positiva como métrica principal, definida antecipadamente em linguagem clara. Depois verifique com intenção de reunião, respostas qualificadas, descadastros/queixas e taxa de bounce para não escolher um “vencedor” que prejudique envios futuros.

What exactly should stay constant in an offer test?

Mantenha tudo o resto igual: identidade do remetente, domínio de envio, comprimento da sequência, timing, regras de segmentação e volume. Troque apenas o bloco da oferta e um pequeno detalhe de prova correspondente para isolar a oferta em teste.

How many emails or prospects do I need per offer to trust the result?

Um padrão prático é executar pelo menos um ciclo completo de sequência para que respostas tardias contem. Defina um tamanho mínimo de amostra e uma data final antes de começar, e não pare cedo só porque uma variante aparenta liderar.

How should I score replies so I don’t fool myself?

Escreva uma regra simples de pontuação antes de lançar e aplique-a de forma consistente. Considere “agendar horário” e “enviar preço” como positivos reais, e coloque interesse brando, fora do escritório e brush-offs educados em buckets separados para não inflar resultados.

When should I use an audit vs a pilot vs a template vs a benchmark?

Escolha a oferta conforme a ação que você quer provocar a seguir. Auditorias funcionam quando você pode prometer um output concreto rápido, pilotos quando você pode limitar escopo e risco, modelos quando a velocidade importa, e benchmarks quando sua história de dados é crível e clara.

What if the “winning” offer also increases unsubscribes or angry replies?

Descadastros e reclamações são um custo, não apenas ruído — podem reduzir entregabilidade ao longo do tempo. Se uma oferta vence em respostas mas também gera muitos sinais negativos, aperte o direcionamento, esclareça a promessa e suavize o pedido antes de escalar.

How do I tell if results are skewed by deliverability or bad data?

Taxas de bounce mais altas normalmente indicam que a lista ou a fonte mudou, não que a oferta piorou. Pause a escalação, limpe e valide os dados, e rode o teste novamente com as mesmas regras de lista para comparar ofertas de forma justa.

What should I do after I find the best-performing offer?

Use o vencedor como novo controle e itere com uma mudança pequena de cada vez, por exemplo adicionando uma pergunta qualificadora nos follow-ups ou ajustando a linha de prova. Para consistência, plataformas como LeadTrain ajudam a manter domínios, warm-up, sequências e classificação de respostas uniformes enquanto você testa.