Rotulagem de respostas por IA com intervenção humana para relatórios confiáveis

Rotulagem de respostas por IA com revisão humana mantém relatórios de cold email precisos. Use amostragem, filas de revisão, categorias claras e feedback para reduzir rótulos errados.

Por que a rotulagem de respostas precisa de um respaldo humano

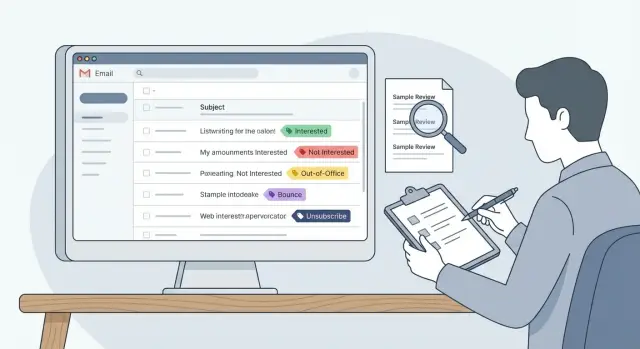

Rotular respostas significa classificar as respostas de e-mail recebidas em categorias para que você possa reportar o que aconteceu. Em cold email, essas categorias geralmente são: interessado, não interessado, out-of-office, bounce e unsubscribe. Os rótulos parecem simples. As respostas reais não são.

A IA é ótima em ler toda a mensagem e categorizá-la rápido. O problema é que as respostas mais difíceis de rotular costumam ser as mais importantes. Uma etapa leve de revisão humana não é por desconfiança. É como você mantém decisões e relatórios conectados à realidade.

Rótulos errados acontecem por motivos previsíveis:

- Respostas curtas como “não” ou “talvez” têm quase nenhum contexto.

- Intenção mista é comum: “Agora não, tenta no próximo trimestre” não é uma rejeição limpa.

- Pessoas usam sarcasmo (“Claro, eu adoro spam”) ou fazem uma pergunta enquanto ainda dizem não.

- Threads ficam bagunçados: respostas encaminhadas, auto-respostas que parecem humanas ou um colega respondendo em nome de outra pessoa.

Rótulos ruins não apenas deixam um dashboard ligeiramente impreciso. Eles mudam prioridades:

- Se “Interessado” for sobre-rotulado, a conversão parece ótima e você escala uma campanha fraca.

- Se “Não interessado” for sobre-rotulado, você interrompe follow-ups que poderiam virar reuniões.

- Se bounces forem sub-rotulados, você continua enviando de caixas que estão se prejudicando.

- Se unsubscribes forem mal interpretados, você corre risco de conformidade e queima confiança.

A revisão humana importa mais quando o sistema tem maior probabilidade de errar. Adicione um loop de revisão quando você:

- lançar uma nova campanha ou mudar a oferta

- entrar em um novo mercado com padrões de linguagem diferentes

- mudar o tom da sua copy (mais casual, mais direto, mais humor)

- começar a usar novas fontes de dados ou regras de segmentação

- notar mudanças métricas que não condizem com o que a equipe vê na caixa de entrada

Exemplo: após mudar para o primeiro e-mail mais curto e direto, uma equipe começa a receber mais respostas de uma linha como “envie detalhes.” Se isso for rotulado como “Interessado” em vez de “precisa de info”, a equipe comemora um aumento falso. Uma checagem humana rápida por amostragem pega isso cedo, atualiza as definições e mantém o reporting honesto, seja você rotulando manualmente ou usando uma plataforma como LeadTrain que classifica respostas automaticamente.

Defina metas e responsabilidade antes de mudar o fluxo

“Preciso de precisão suficiente” significa coisas diferentes para equipes diferentes. Antes de adicionar revisões, concorde com o que é um bom resultado em números claros. Por exemplo: “Em uma amostra semanal, os erros nos rótulos principais ficam abaixo de 3% e conseguimos explicar a deriva em um dia útil.” Isso te dá uma meta de erro e um tempo de resposta.

Decida também o que importa mais. Normalmente você não precisa de perfeição em todos os casos marginais. Foque nos rótulos que orientam decisões. Se seus dashboards controlam follow-ups e previsões, você se importa principalmente se “Interessado” é realmente interessado e se bounces e unsubscribes são contabilizados corretamente.

Mantenha o escopo simples:

- Rótulos principais (devem estar corretos): Interessado, Não interessado, Bounce, Unsubscribe

- Rótulos opcionais (bom ter): Out-of-office, Pessoa errada, Referral, Verificar depois

- Precisa de revisão: qualquer coisa confusa ou com intenção mista

- Uma regra para “Other”: o que inclui e quando é permitido

A responsabilidade é o passo decisivo. Se ninguém for dono das regras, cada revisor inventa seus próprios padrões e suas métricas oscilam. Escolha um responsável que possa decidir mudanças e documentá-las (frequentemente RevOps, um líder de SDR ou um gerente de vendas). Revisores podem sugerir atualizações, mas o dono publica a decisão final para que o reporting permaneça consistente.

Defina uma cadência que combine com seu volume e risco. Uma checagem diária pega falhas súbitas (como um novo template provocando mais auto-respostas). Uma auditoria semanal pega deriva mais lenta.

Uma cadência que muitas equipes conseguem manter:

- Diário: checagem rápida de 10 minutos em novos rótulos “Interessado” e “Unsubscribe”

- Semanal: revisão mais aprofundada de uma amostra maior e quaisquer itens “Needs review”

- Após mudanças: revisão extra por 2–3 dias depois de uma nova sequência, fonte de lista ou configuração de domínio

Se você usa um classificador de IA (incluindo ferramentas como LeadTrain), o objetivo permanece o mesmo: você não está revisando tudo. Você está determinando a definição de “correto” e checando com frequência suficiente para que o dashboard continue crível.

Construa uma taxonomia de rótulos que as pessoas consigam aplicar consistentemente

Um processo de revisão falha se as pessoas não concordam sobre o significado de cada rótulo. O objetivo é um conjunto pequeno de rótulos que permaneça estável ao longo do tempo, para que o reporting não mude cada vez que surge um caso marginal.

Comece com um núcleo enxuto que cubra a maioria das respostas. Mantenha rótulos mutuamente exclusivos quando possível e escreva uma definição de uma frase que um novo colega consiga seguir.

- Interessado: A pessoa pede reunião, preço, prazo ou um próximo passo claro.

- Não interessado: A pessoa recusa agora e não pede alternativas.

- Out-of-office: Uma mensagem automática de ausência com data de retorno ou um aviso claro de “estou fora”.

- Bounce: Falha de entrega ou caixa que não existe (linguagem de falha gerada pelo sistema).

- Unsubscribe: Qualquer pedido para parar de receber e-mails, incluindo “remova-me” ou “não me contacte”.

O rótulo que geralmente causa mais dano é “Interessado”. Defina-o estritamente para que a taxa de reuniões e o pipeline fiquem honestos. “Parece interessante” não é suficiente por si só. Uma regra simples: se não há um próximo passo claro, direcione para Needs review em vez de forçar um ganho ou uma perda.

Mantenha um rótulo de espera, como Needs review (ou Other) para respostas que não se encaixam claramente. Isso protege a taxonomia enquanto você aprende e dá uma fila focada para auditar quando as respostas mudarem.

Respostas com múltiplas intenções são comuns, então decida desempates com antecedência e siga-os:

- Se uma resposta inclui Unsubscribe, rotule como Unsubscribe independentemente do resto.

- Se for Out-of-office mais uma pergunta real, rotule como Out-of-office e sinalize para follow-up depois.

- Se for uma referência (“Email Alex”) mais “não sou eu”, rotule como Not interested (e rastreie a referência separadamente se você faz isso).

Se precisar adicionar um novo rótulo, faça de forma deliberada e refaça a rotulação de uma pequena amostra para que as tendências permaneçam comparáveis.

Escolha um método de amostragem que detecte os erros mais danosos

Uma pequena amostra aleatória de respostas te diz se, em geral, está tudo bem, mas pode perder os erros que distorcem decisões. Faça amostragem de forma a encontrar erros de alto custo: rótulos errados que mudam suas contagens de interessados, bounces e unsubscribes.

Uma configuração prática geralmente mistura três tipos de amostragem, além de gatilhos que forçam revisão extra quando algo muda.

Opções de amostragem (e para que servem)

A amostragem aleatória te dá uma linha de base e pega casos marginais estranhos ao longo do tempo.

A amostragem direcionada garante que você não dependa da sorte para capturar rótulos raros mas importantes:

- Amostra aleatória de todas as respostas para estimar correção geral

- Amostra estratificada por rótulo (especialmente Interessado, Unsubscribe, Bounce)

- Amostra baseada em risco de respostas que são fáceis de interpretar mal (mensagens muito curtas, gírias, línguas mistas, sarcasmo)

- Amostra acionada por mudança após uma alteração no fluxo (novo domínio, nova oferta, nova sequência, novo template)

- Amostra por discordância quando o modelo parece incerto ou troca categorias com frequência (se sua ferramenta expõe isso)

Se você usa uma plataforma como LeadTrain que auto-categoriza respostas, amostras estratificadas e baseadas em risco geralmente são onde você encontra problemas que silenciosamente enviesam seu dashboard.

Defina um tamanho de amostra semanal que sua equipe realmente fará

O melhor tamanho de amostra é aquele que de fato será feito toda semana. Comece pequeno, torne rotineiro e depois aumente.

- Escolha uma caixa de tempo fixa (por exemplo, 30 a 60 minutos por semana)

- Mire em 30 a 100 revisões por revisor por semana, dependendo do volume

- Garanta que cada rótulo chave receba uma contagem mínima (por exemplo, pelo menos 10 Interessado e 10 Unsubscribe, quando possível)

- Aumente a amostragem para novas campanhas durante as primeiras 1 a 2 semanas

Uma regra simples: se respostas “Interessado” são raras, a amostragem aleatória vai me-las. Coloque-as propositalmente na fila de revisão.

Um fluxo passo a passo de amostragem e revisão

Um bom fluxo torna erros visíveis sem transformar sua equipe em fiscais de rótulos em tempo integral. O objetivo é claro: detectar rótulos errados cedo, corrigir a regra que os causou e manter o reporting honesto.

O fluxo

Crie uma pequena e constante fila de revisão. Puxe da sua amostra diária e inclua qualquer item de risco (nova copy, picos incomuns, respostas que parecem incertas).

Um loop que a maioria das equipes roda em 15 a 30 minutos por dia:

- Monte a fila de revisão a partir da sua amostra e quaisquer respostas “Needs review”.

- Aplique as definições escritas, não opiniões pessoais.

- Registre o rótulo corrigido e acrescente uma nota de uma frase com a razão.

- Quando os revisores discordarem, decida rápido e atualize a regra em linguagem simples.

- Alimente as correções de volta nas regras de reporting e em qualquer processo de treinamento que você mantenha.

Após a passagem, procure padrões: “Interessado” está sendo confundido com “Agora não”? Mensagens de ausência estão sendo marcadas como “Não interessado”? Esses erros silenciosos mudam taxas de conversão.

Rastreie o que melhora (e o que não melhora)

Você precisa de poucos números:

- Taxa geral de erro na amostra

- Taxa de erro por rótulo (especialmente Interessado e Unsubscribe)

- Principais pares de confusão (como Interessado vs Não interessado)

- Tempo de resolução para discordâncias

- Volume diário de itens Needs review

Exemplo: você muda o assunto e vê um salto em “Interessado”. A fila de revisão mostra que muitas respostas são, na verdade, auto-respostas de ausência acionadas por uma nova palavra-chave. Você atualiza a regra, corrige a amostra e o dashboard para de contar a história errada.

Torne as revisões consistentes entre pessoas

As pessoas vão ler a mesma resposta e discordar, especialmente em e-mails curtos ou vagos. O objetivo não é acordo perfeito. É decisões previsíveis para que os relatórios se mantenham estáveis semana a semana.

Comece com checagens de duas pessoas em um pequeno subconjunto. Escolha 20–50 respostas por semana (ou por campanha) e peça que dois revisores as rotulem independentemente. Compare os resultados. Quando houver discordância, conversem rapidamente e escrevam a regra que faltou.

Use um rubrica pequena para que cada decisão deixe rastreio:

- Rótulo

- Confiança (alta ou baixa)

- Frase gatilho (as palavras exatas que motivaram a escolha)

- Nota de uma frase para casos marginais

Um pequeno “gold set” mantém os revisores calibrados. É uma pasta de respostas conhecidas com o rótulo esperado que novos revisores pontuam antes de tocar nos dados ao vivo. Atualize-o quando campanhas ou ofertas mudarem.

Uma abordagem prática de calibração:

- Mantenha 25–40 exemplos que cubram rótulos comuns

- Inclua pelo menos 5 casos difíceis (não educado, referência, talvez vago)

- Concorde sobre o rótulo esperado e uma razão em uma linha

- Re-teste novos revisores e quem estiver abaixo da meta de concordância

Por fim, registre casos marginais em uma nota compartilhada, escrita como regras. Com o tempo, isso vira seu guia e facilita retreinamentos ou ajustes de categorias com mais segurança.

Erros comuns que silenciosamente quebram suas métricas

A maioria dos problemas de reporting não vem de uma grande falha. Vêm de hábitos pequenos de rotulagem que lentamente curvam seus números até o dashboard parecer confiante, mas errado.

Rótulos errados que mais prejudicam

Esses erros tendem a ter impacto maior do que parecem:

- Misturar sentimento com intenção. “Obrigado, não é prioridade agora” pode soar educado, mas ainda é um não. Se for rotulado como “Interessado”, sua taxa positiva se infla.

- Tratar referências como rejeição. “Fala com a Sarah de operações” não é “não interessado”. Se você rastreia, rotule separado para medir quão frequentemente o e-mail encontra a pessoa certa.

- Jogar tudo em Other. Other é ok para casos raros, mas quando vira um balde comum, esconde padrões (rejeição por preço, timing ruim, lock-in com concorrente) que deveriam orientar sua próxima campanha.

- Mudar definições no meio do trimestre sem anotar. Se “Interessado” significava “fez uma pergunta” mês passado e “marcou reunião” este mês, suas linhas de tendência viram ficção.

- Ignorar bounces e unsubscribes por parecerem operacionais. Eles fazem parte de entregabilidade e saúde de lista. Se estiverem ausentes ou rotulados errado, você superestima alcance e subestima risco.

Uma salvaguarda simples: sempre que revisores virem o mesmo caso em “Other” 10–20 vezes, promova-o a categoria real e documente.

Checagens rápidas antes de confiar no dashboard

Dashboards parecem precisos, mas rótulos derivam em pequenas formas que somam. Antes de agir sobre um pico em “Interessado” ou uma queda em “Não interessado”, rode algumas checagens que levam minutos.

1) Procure picos súbitos de rótulos após mudanças

Um rótulo que pula logo depois de você lançar uma nova sequência, mudar a copy ou ajustar segmentação é um sinal de alerta. Mudanças reais de performance acontecem, mas mudanças de rotulagem são igualmente comuns.

Compare o dia anterior e o dia seguinte. Se apenas um rótulo cresceu muito (por exemplo, out-of-office dobrou enquanto o total de respostas ficou estável), provavelmente é um problema de rotulagem.

2) Cheque a dedo Interessado e Não interessado

Leia 10–20 respostas recentes marcadas como Interessado. Procure falsos positivos como:

- agradecimentos (“Obrigado”)

- adiamentos de agenda (“Próximo trimestre”)

- referências (“Fale com meu colega”)

- pedidos vagos (“Envie info”) sem próximo passo claro

Depois, escaneie 10–20 respostas marcadas como Não interessado e pergunte na prática: algum desses leads acabou marcando depois de um follow-up razoável? Se sim, sua definição de Não interessado pode ser muito ampla ou sua equipe pode estar tratando como ponto final quando não deveria.

3) Garanta que bounces e unsubscribes não estejam escondidos como out-of-office

Bounces e unsubscribes são sinais operacionais, não de conversa. Se forem rotulados como out-of-office, o reporting fica mais saudável do que realmente está.

Revise um pequeno lote de out-of-office e procure palavras reveladoras como “undeliverable”, “delivery failed”, “blocked”, “unsubscribe” ou “remove me”.

4) Revise respostas muito curtas

Respostas de uma a três palavras são a fonte mais comum de erros silenciosos: “Não.” “Talvez.” “Quem?” “Ok.” “Pare.” Elas dependem do contexto.

Pegue 15 respostas curtas entre seus principais rótulos e confirme se correspondem à intenção. Se houver confusão, adicione uma regra simples (por exemplo: “Ok” não é Interessado a menos que esteja concordando com um horário proposto).

Exemplo: corrigindo rótulos errados após uma mudança de campanha

Uma pequena equipe de SDR lança uma nova sequência de 3 passos. A copy ficou mais enxuta, o follow-up mais direto e a oferta é uma ligação curta. Dois dias depois, o dashboard mostra grande aumento em Interessado. Todo mundo fica feliz até que o número de reuniões não sobe.

Eles fazem uma checagem simples: amostram respostas Recentes rotuladas como Interessado e leem no contexto do thread. O padrão aparece. Muitas respostas não têm intenção de compra real. São “envie info” do tipo “Claro, me mande detalhes” ou “Pode enviar um deck?” Outras são adiamentos educados como “Agora não, mas me mantenha informado.”

O modelo não ficou ruim de repente. A mudança na campanha produziu mais respostas ambíguas, e a definição de Interessado da equipe era frouxa. Eles apertam a taxonomia e escrevem regras que as pessoas possam seguir.

Definições atualizadas:

- Interessado exige intenção de reunião ou um próximo passo claro (marcar chamada, sugerir horários, pedir proposta, confirmar fit).

- “Envie info” fica fora de Interessado a menos que a resposta inclua um próximo passo (por exemplo, “Envie detalhes e eu agendo esta semana”).

- “Talvez depois” cobre adiamentos de timing (próximo trimestre, após um lançamento, voltamos em alguns meses).

- Não interessado é um não claro, incluindo “pare” e “remova-me”.

Eles também adicionam uma regra de tratamento: “Talvez depois” é rastreado separadamente para não inflar relatórios de intenção de reunião. A ação de follow-up fica consistente: registrar a razão, definir lembrete e não empurrar por reunião no mesmo thread.

Nas próximas duas semanas, mantêm um loop de revisão leve. A cada dia, amostram algumas respostas Interessado e Talvez depois e confirmam se o rótulo está correto. Se usam uma ferramenta como LeadTrain, isso combina bem com classificação por IA porque os revisores podem focar nas poucas categorias que dirigem decisões.

Ao final da segunda semana, a taxa de erro em Interessado cai e o reporting de taxa de reuniões para de oscilar com pequenas mudanças de copy.

Próximos passos: comece pequeno e mantenha o loop

Execute um piloto que você consiga finalizar. Escolha uma campanha ativa e rode o loop de revisão por uma semana. Isso é tempo suficiente para ver padrões (novas objeções, mais out-of-office) sem transformar em trabalho em tempo integral.

Mantenha o setup com caixa de tempo. Em 15 minutos você alinha revisores escrevendo definições em linguagem simples e passando por 5–10 exemplos reais da sua caixa de entrada. Se alguém não consegue rotular com confiança após ler a definição uma vez, a definição precisa melhorar.

Um plano inicial manejável:

- Use o rótulo da IA como padrão e depois revise uma pequena amostra semanal (por exemplo, 30–50 respostas).

- Priorize categorias de alto impacto primeiro: Interessado, Unsubscribe, Bounce, Não interessado.

- Marque tudo que for incerto em vez de forçar um palpite e junte esses casos para uma rápida atualização de definições.

- Registre apenas duas coisas nas correções: o rótulo original e o rótulo corrigido.

- Pare após 30 minutos e agende a próxima sessão em vez de tentar limpar o backlog.

Se você usa LeadTrain (leadtrain.app), uma boa abordagem é tratar a classificação por IA como sua base e manter esse loop leve de revisão por cima. Você ainda ganha velocidade, mas suas categorias permanecem alinhadas com a forma como sua equipe vende agora.

Para manter o loop saudável, adicione um breve checkpoint mensal:

- Atualize definições com base nas respostas incertas mais comuns.

- Reveja os principais padrões de erro.

- Decida se a amostra deve crescer, diminuir ou permanecer igual.

- Compartilhe uma conclusão com a equipe para que todos rotulem com a mesma intenção.

Pequenas revisões, pequenas correções e métricas nas quais você pode confiar semana após semana.

Perguntas Frequentes

Eu realmente preciso de humanos revisando respostas rotuladas por IA?

Comece com IA como padrão e adicione um pequeno passo de amostragem humana focado em rótulos de alto impacto como Interessado, Unsubscribe e Bounce. O objetivo é pegar os erros que mudam decisões, não relabelar tudo manualmente.

Por que a IA rotula mal respostas de cold email com tanta frequência?

Porque as respostas mais valiosas geralmente são as mais ambíguas. Respostas de uma linha, sarcasmo, intenções mistas e threads confusos são fáceis de interpretar errado, e pequenos erros em Interessado ou Unsubscribe podem distorcer seu reporting e prioridades de follow-up.

Qual é a definição mais segura de “Interessado”?

Mantenha estreito: Interessado deve significar que a pessoa pede uma reunião, preço, prazo ou um próximo passo claro. Se não há um próximo passo, trate como Needs review ou uma categoria separada como “Needs info”, assim suas métricas de intenção de reunião permanecem honestas.

Como devemos rotular respostas com intenção mista (como “Agora não, tente no próximo trimestre”)?

Use uma regra simples de desempate e documente-a. Um padrão prático: se a resposta inclui “stop”, “remove me” ou algo similar, rotule como Unsubscribe independentemente do resto da mensagem.

Quais rótulos são mais importantes de acertar?

Priorize categorias que afetam entregabilidade e conformidade, e aquelas das quais seus dashboards tomam ações. A maioria das equipes deve considerar Interessado, Not interested, Bounce e Unsubscribe como “devem estar corretos”, mantendo o resto como opcionais ou Needs review.

Qual deve ser o tamanho da nossa amostra semanal de revisão?

Uma caixa de tempo semanal simples funciona bem: reveja 30–50 respostas, garantindo contagens mínimas para rótulos-chave (por exemplo, pelo menos 10 Interessado e 10 Unsubscribe, quando disponíveis). Se Interessado for raro, amostre-o deliberadamente em vez de confiar só em picks aleatórios.

Qual a melhor forma de amostrar respostas para capturar erros caros?

Misture amostragem aleatória com amostragem direcionada. A aleatória dá uma linha de base, enquanto a direcionada foca em áreas de risco como respostas muito curtas, picos de categoria após mudança de copy e tudo rotulado como Interessado, Unsubscribe ou Bounce.

Quem deve ser o responsável pelas regras de rotulagem e mudanças?

Atribua um dono (frequentemente RevOps, um líder de SDR ou um gerente de vendas) que publique as definições finais e desempates. Revisores podem sugerir mudanças, mas uma pessoa deve decidir e documentar atualizações para que as métricas não oscilem semanalmente.

Como posso saber se meu dashboard está sendo distorcido por rótulos errados?

Faça checagens rápidas: leia 10–20 respostas recentes marcadas como Interessado e confirme que existe um próximo passo real, e verifique Out-of-office por bounces ocultos ou pedidos de unsubscribe. Se um rótulo disparar logo após uma mudança de campanha, assuma que é uma mudança de rotulagem até provar que é uma mudança real de performance.

Podemos usar LeadTrain e ainda fazer revisão humana no processo?

Sim. A classificação por IA do LeadTrain pode ser sua linha de base, e um loop de revisão leve ajuda a manter as categorias alinhadas com a forma como sua equipe vende atualmente. Você ainda ganha velocidade, mas reduz falsos “ganhos”, follow-ups perdidos e problemas de conformidade por unsubscribes mal interpretados.