Playbook de limites de API para pulls estáveis de listas de prospects

Playbook de rate limit para prospecção: paginação, retries, cache e padrões de logging que mantêm pulls de listas estáveis, repetíveis e auditáveis.

Por que pulls de listas de prospects falham sob limites de taxa

Pulls de prospects normalmente falham de maneiras chatas e previsíveis: uma integração atinge um limite da API, o job desacelera, e alguém reexecuta sem saber o que já aconteceu. Parece que “a API estava instável”, mas o problema real é que o pull não foi construído para se comportar sob pressão.

Quando um pull encontra rate limits, alguns modos de falha aparecem repetidamente:

- Registros ausentes porque o job expira no meio de uma página e nunca retoma de forma limpa

- Duplicatas porque páginas são re-tentadas sem uma estratégia idempotente

- Atualizações parciais onde alguns prospects são enriquecidos e outros ficam em branco

- Lacunas silenciosas quando erros são engolidos e o pull “termina” mesmo assim

- Desperdício de créditos quando os mesmos endpoints são chamados repetidamente

Essa instabilidade é cara. Você paga duas (ou mais) vezes pelos mesmos dados, sequências ficam bagunçadas (o mesmo lead importado ou contatado duas vezes) e relatórios ficam pouco confiáveis. Em escala, pequenas inconsistências em listas viram problemas de deliverability e follow-ups confusos.

O objetivo é simples: pulls que sejam estáveis, repetíveis e auditáveis.

- Estável: grandes pulls terminam sem precisar de supervisão constante.

- Repetível: reexecuções não mudam o resultado, a menos que os dados-fonte tenham mudado.

- Auditável: depois, você consegue dizer quais chamadas aconteceram, o que foi importado e por quê.

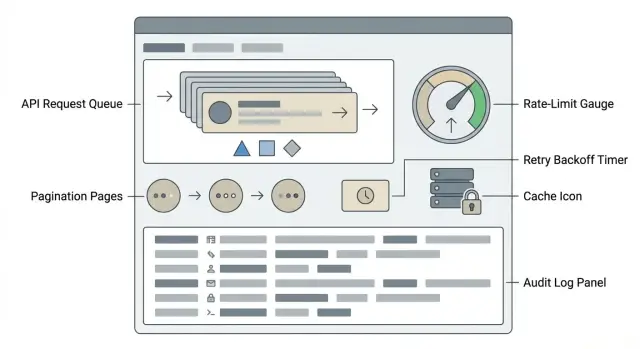

As peças práticas são paginação que não pula nem duplica, retries que recuperam com segurança, cache e pulls incrementais que cortam a carga da API, e logs que tornam cada execução explicável. Se você puxa prospects de provedores como Apollo para um sistema de outbound (por exemplo, para alimentar sequências no LeadTrain), essas salvaguardas impedem que crescimento vire caos.

Conheça os limites antes de puxar

Antes de iniciar um grande pull de prospects, esclareça o que a API permite. Esse passo “chato” evita listas pela metade, páginas perdidas e importações duplicadas depois.

Rate limits tratam da velocidade. Quotas tratam do volume total. Limites de concorrência tratam de quantas requisições simultâneas você faz.

- Rate limit: máximo de requisições por segundo ou por minuto (exemplo: 60 requests/min)

- Quota: máximo de requisições por dia ou por mês (exemplo: 10.000/dia)

- Limite de concorrência: máximo de requisições em voo (exemplo: 5 requisições paralelas)

A maioria das APIs expõe sinais de limite via headers de resposta e alguns códigos de status comuns. Ao integrar com um provedor, capture esses sinais cedo durante um pull de teste pequeno.

Padrões típicos:

- HTTP 429 (Too Many Requests) e, às vezes, 403 para enforcement de limites

Retry-Afterindicando por quanto tempo esperarX-RateLimit-Limit,X-RateLimit-Remaining,X-RateLimit-Reset(nomes variam)- Headers específicos do fornecedor como

RateLimit-*ouX-Quota-*

Também fique atento a limites de burst. Você pode ter 60 requests/min, mas ainda ser bloqueado se enviar 20 em um segundo. Bursts acontecem facilmente com workers paralelos, retries ou um loop de paginação apertado.

Para planejamento de throughput, comece conservador. Pegue o limite publicado e mire em 60% a 80% dele. Se o limite for 60/min e cada requisição retorna 100 prospects, vise cerca de 40 a 45 requests/min (aprox. 4.000 a 4.500 prospects/min) e mantenha requisições paralelas baixas (frequentemente 1 a 3) para evitar picos.

Paginação que não perde nem duplica prospects

A paginação é onde vêm a maioria das lacunas e duplicatas “aleatórias”. O objetivo é puxar páginas de forma determinística, mesmo que novos prospects sejam adicionados enquanto você lê.

Paginação por offset (page=7, limit=100) é simples, mas arriscada quando o dataset muda. Se registros são adicionados ou editados no meio da execução, a “página 7” pode se deslocar, causando itens pulados ou repetidos. Paginação por cursor (um token next_cursor) geralmente é mais segura porque diz exatamente onde continuar, mas ainda depende da API devolver uma ordem estável.

Para manter páginas consistentes, solicite uma ordenação estável e mantenha filtros fixos durante toda a execução. Uma abordagem comum é ordenar por um campo monotônico como created_at, com um tie-breaker como id para que dois registros criados ao mesmo tempo não troquem de posição entre chamadas.

Se os dados podem mudar durante o pull, congele o universo. Registre um timestamp de corte no início (por exemplo, created_at <= 2026-01-17T10:00Z) e aplique-o a toda página. Novos registros podem chegar, mas não vão reordenar as páginas que você está lendo.

Regras de parada e checagens de sanidade ajudam a saber quando terminar e quando investigar:

- Pare somente quando a API retornar nenhum item, ou não houver

next_cursor. - Acompanhe IDs únicos vistos e alerte se duplicatas excederem um limiar pequeno.

- Marque quedas súbitas no tamanho da página.

- Mantenha um total corrido e compare com o total reportado pela API quando disponível.

- Persista o cursor (ou última chave de ordenação) após cada página para poder retomar com segurança.

Retries que recuperam sem piorar a situação

Retries ajudam quando o problema é temporário. Eles pioram quando a requisição está errada ou quando você já está forçando a API demais. Faça retries previsíveis, limitados e educados.

Separe erros que você deve re-tentar de erros que você deve corrigir:

- Re-tentar: 429 (rate limited), 408 (timeout), a maioria dos 5xx (erros de servidor) e problemas de rede (reset de conexão, DNS)

- Não re-tentar: 400 (bad request), 401/403 (auth/permissão), 404 (endpoint errado ou recurso ausente) e erros de validação

Para 429s, respeite as instruções do servidor. Se receber Retry-After, pause por esse período (mais um pouco de aleatoriedade) e então continue. Ignorar Retry-After transforma uma desaceleração em uma indisponibilidade, ou pior, em um ban temporário.

Exponential backoff com jitter significa esperar mais tempo a cada falha e adicionar um pequeno atraso randômico para que muitos workers não tentem de novo exatamente ao mesmo tempo.

- Regra de backoff: 1s, 2s, 4s, 8s, até um limite (por exemplo, 30 a 60s)

- Adicione jitter: randomize esperas em cerca de 20% a 50%

- Cooldown: após 429s repetidos, pause todo o job por mais tempo (por exemplo, 2 a 5 minutos)

Coloque um corte rígido em retries. Uma regra como máximo de 5 tentativas por requisição, ou máximo de 10 minutos no total de retries, evita loops infinitos.

Exemplo: você está puxando 50.000 prospects e a página 37 retorna 429 com Retry-After: 15. Durma 15 a 20 segundos, reintente a mesma página uma vez e então continue. Se você der três 429s seguidos, pause brevemente em vez de bombardear a API.

Torne pulls reiniciáveis e seguros para repetir

Um pull estável é aquele que você pode parar, reiniciar e reexecutar sem mudar o resultado. Isso importa quando você atinge rate limits, recebe um timeout ou deploya uma correção no meio do processo.

Comece com gravações idempotentes. Em vez de “inserir toda linha”, use um upsert com uma chave clara de deduplicação e registre o que aconteceu. Chaves comuns incluem o person ID do provedor, email normalizado ou um fallback como domínio + nome completo.

Um conjunto previsível de regras de conflito:

- Se o provider ID bater, trate como o mesmo prospect e atualize campos.

- Se não, mas o email normalizado bater, faça merge e mantenha os campos mais recentemente atualizados.

- Senão, crie um novo registro de prospect e marque-o com o job_id do pull para rastreabilidade.

- Nunca sobrescreva uma flag de unsubscribe ou “do not contact” durante merges.

Torne o pull reiniciável com checkpoints. Armazene o último cursor/token confirmado e uma contagem de registros salvos para aquela página. Avance o checkpoint apenas depois de processar e commitar totalmente a página, assim uma queda reexecuta no máximo uma página.

Dados do provedor podem mudar por baixo: IDs são unidos, deletados ou reciclados. Mantenha uma tabela de mapeamento de “provider IDs vistos” para seu ID interno. Se um ID passar a apontar para outro email, coloque-o em quarentena para revisão em vez de atualizar silenciosamente.

Exemplo: você puxa 50.000 leads diariamente para sua stack de outbound (ou para uma plataforma como o LeadTrain). Se o job morrer na página 380, você reinicia a partir do último checkpoint, reprocessa a página 380 com segurança e ainda termina com os mesmos 50.000 registros, não 50.800 com duplicatas.

Cache e pulls incrementais para reduzir carga na API

Cache corta chamadas de API sem mudar o que você recebe. Ajuda muito quando você reexecuta um pull após uma falha, repete os mesmos lookups (domínios de empresa, cargos, locais) ou enriquece as mesmas pessoas várias vezes. Trate cache como uma medida de segurança, não apenas um truque de velocidade.

Uma abordagem simples é cachear por uma chave estável, como provider prospect ID ou email, e armazenar apenas os campos que você realmente usa para outreach. Então pule chamadas de API para registros que você já tem, a menos que seja provável que tenham mudado.

Noções básicas de TTL: por quanto tempo confiar no cache

TTL (time to live) deve casar com a rapidez com que os dados-fonte mudam e com o risco de dados obsoletos. Dados de contato mudam devagar, enquanto título e empresa podem mudar mais rápido.

- Identificadores estáveis (provider ID, email, domínio da empresa): TTL longo (dias a semanas)

- Detalhes de perfil (cargo, senioridade, localização): TTL médio (horas a alguns dias)

- Campos de status (unsubscribed, bounced, do-not-contact): TTL curto (minutos a horas)

Pulls incrementais: só novos ou atualizados

Em vez de re-puxar tudo, armazene um checkpoint como updated_at ou um token de cursor da última execução bem-sucedida. Na próxima vez, solicite apenas registros atualizados desde esse ponto. Isso reduz carga, diminui pressão de rate limit e torna reexecuções previsíveis.

A armadilha comum é dados obsoletos vazando para outreach. Proteja-se validando campos críticos no momento do envio (por exemplo, flags de do-not-contact) e atualizando registros antes que entrem em uma nova campanha.

Se você está alimentando prospects em um sistema de outbound como o LeadTrain, sync incremental mais TTLs curtos em campos relacionados a opt-out ajuda a manter listas frescas enquanto evita chamadas desnecessárias ao provedor.

Logging que torna pulls auditáveis

Quando um pull de prospects falha ou parece “estranho”, logs são como você prova o que aconteceu. Bons logs respondem perguntas simples rapidamente: o que requisitamos, o que a API retornou e em qual página as coisas mudaram?

Logue um conjunto consistente de campos para cada chamada de API. Mantenha estrutura (JSON é comum) para poder buscar e agrupar por job.

- Timestamp (início e fim), mais latência

- Endpoint e método, e parâmetros-chave da requisição (page/cursor, filtros, sort)

- Código de resposta e quaisquer headers de rate-limit

- Contagens de resultado (registros retornados, next cursor,

has_more) - Detalhes de erro (mensagem, retryable ou não, número da tentativa)

Adicione correlation IDs para traçar um pull através de centenas ou milhares de chamadas. Um padrão simples é um job_id para todo o pull e um request_id por chamada de API. Se você também armazenar o último cursor bem-sucedido com o job_id, consegue alinhar logs com pontos de restart.

Decida quanto da resposta armazenar. Respostas brutas facilitam auditorias, mas podem ser caras e arriscadas. Dados de prospect podem incluir informações pessoais, então preserve a privacidade.

Um compromisso prático é armazenar um resumo para cada chamada (contagens, cursores, hashes) e guardar corpos brutos só quando algo dá errado, ou só por uma janela curta de retenção. Se armazenar dados brutos, redija campos sensíveis e criptografe em repouso.

"Auditável" na prática: um sales ops pede para saber por que 2.000 prospects sumiram do pull de terça-feira passada. Com logs, você mostra os parâmetros de filtro exatos, a página onde o rate limiting começou, os retries que rodaram e o cursor final salvo.

Monitoramento e alertas para operações estáveis

Rate limits não são só um problema de código. Se você não vigiar pulls enquanto eles rodam, um pequeno hiccup da API pode silenciosamente virar prospects faltantes, duplicatas ou um pull que nunca termina. Monitoramento deve responder a uma pergunta rapidamente: este pull está saudável agora?

Use um punhado de métricas que façam sentido para times não técnicos:

- Requisições por minuto (e quão perto você está do limite)

- Taxa de erro (4xx vs 5xx)

- Taxa de retry (com que frequência você está dando backoff)

- Lag (o quão atrasado você está versus o tempo esperado de conclusão)

- Progresso (páginas ou registros puxados por minuto)

Alertas devem focar em padrões, não em eventos isolados. Um 429 é normal. Vinte 429s seguidos significa que você está bloqueado e desperdiçando tempo. O mesmo vale para 5xx repetidos, que geralmente indicam outage.

Triggers úteis incluem um pico em respostas 429, 5xx repetidos por mais de alguns minutos e paginação que para de avançar (cursor inalterado ou contagem de registros estagnada).

Dashboards não precisam ser sofisticados. Uma visão simples com status verde/amarelo/vermelho, velocidade atual do pull, último tipo de erro e tempo restante estimado já é suficiente para um gerente de SDR decidir ações.

Decida antes quando pausar automaticamente vs notificar uma pessoa:

- Auto-pausa em 429s sustentados ou quando o progresso está estagnado por uma janela definida

- Notifique uma pessoa quando o pull estiver pausado ou erros persistirem após cooldown

- Auto-resume apenas quando as taxas de erro caírem e o progresso voltar de forma segura

Exemplo: você puxa 50.000 prospects. Se 429s saltarem de 1% para 40%, auto-pause evita que dados parciais alimentem seu sistema de outreach e reduz o risco de importações inconsistentes.

Passo a passo: rodando um pull de prospects estável

Um pull estável é um runbook que você pode repetir. Mesmos inputs devem produzir mesmo output, mesmo que a API desacelere ou falhe no meio do caminho.

Fluxo básico:

- Planeje: escreva os filtros exatos da consulta, campos a requisitar, ordem de sort e janela de tempo (por exemplo, “created after 2026-01-01”). Decida sua chave única (normalmente um prospect ID).

- Dry run: puxe 1 a 2 páginas. Confirme o formato da resposta, campos obrigatórios e que sua chave está sempre presente.

- Full run: comece na página 1 com um cursor/offset salvo. Armazene cada página e registre o último cursor bem-sucedido para poder retomar.

- Verifique: compare contagens esperadas (da API, se disponível) com o que você salvou. Procure duplicatas e campos faltando.

- Exportar/importar: exporte um arquivo final deduplicado mais um pequeno manifesto de execução para que outra pessoa possa reexecutar depois.

Tamanho do lote e concorrência devem vir de sinais, não de suposições. Comece com page size de 50 a 100 e um worker. Se não houver respostas de rate-limit e a latência permanecer estável, aumente para 2 a 4 workers. Pare de aumentar quando 429s começarem a ser frequentes ou o tempo médio de resposta subir.

Para validação, faça uma revisão rápida por amostragem (20 a 50 registros) e então cheques simples: total de linhas, IDs únicos de prospect, percentuais com email/nome/empresa faltando e se alguma página foi salva duas vezes.

Documente cada pull em texto simples: quem rodou, quando, qual conta API foi usada, parâmetros exatos, page size, concorrência e o hash final ou contagem de linhas.

Exemplo: um grande pull consistente na prática

Você precisa puxar 50.000 prospects de um provedor em cerca de 2 horas para que o time de outbound comece amanhã. Define page size de 500, o que dá aproximadamente 100 páginas. O provedor impõe rate limit, então você paceia requisições e planeja 429s ocasionais e 5xx aleatórios.

O pull funciona assim: solicitar página 1, armazenar o cursor retornado (ou next page token) e escrever um checkpoint que diz “last_cursor=abc, pulled=500”. Depois seguir em frente. Se uma requisição falhar, não avance. Re-tente o mesmo cursor com backoff exponencial (por exemplo, 2s, 4s, 8s), adicione jitter e limite retries para não bombardear a API.

Na metade, a página 37 retorna 429. Seu log de auditoria para aquele momento é simples e específico:

{"run_id":"2026-01-17T10:00Z","cursor":"p37","status":"retry","error":"429","backoff_seconds":8,"attempt":3}

Após o backoff, a página 37 tem sucesso. O checkpoint só atualiza depois que a página é totalmente escrita no armazenamento.

Mais tarde, alguém reexecuta o mesmo pull porque suspeita de um bug. A rerun lê o último checkpoint, retoma da página 38 e usa writes idempotentes (por exemplo, keying por prospect_id + source). A lista final bate entre reruns: sem missing prospects, sem duplicatas e com um rastro claro mostrando exatamente onde os retries ocorreram.

Erros comuns e armadilhas a evitar

A maioria das falhas por rate limit é autoinfligida. A solução raramente é um código genial. É evitar algumas armadilhas previsíveis.

Um erro é tratar todo erro como retryable. Re-tentar requisições erradas (parâmetros errados, auth inválida, permissões faltando) pode bombardear a API e fazer você parecer abusivo. Retries devem focar em problemas temporários como 429 e muitos 5xx, e devem parar rapidamente quando o erro for claramente permanente.

Outra armadilha é concorrência demais. Mesmo com backoff exponencial, disparar 50 requisições paralelas pode manter você acima do limite para sempre. Prefira um pacing steady, não bursts. Um limiter compartilhado (uma fila para todos os workers) muitas vezes é melhor que backoff independente em cada thread.

A paginação também esconde problemas silenciosos. Paginação por offset em um dataset que muda pode pular ou duplicar prospects sem erro algum. Prefira ordenação estável mais cursor, ou use um filtro snapshot (por exemplo, puxar só registros criados antes de um timestamp fixo).

Por fim, muitos pulls não são reiniciáveis. Uma falha pequena em 80% força rerun completo, o que aumenta carga e eleva chance de duplicatas.

Sinais de alerta:

- Re-tentar 400/401/403 em vez de falhar rápido

- Paralelismo ilimitado que ignora limites globais

- Paginação por offset sem chave de ordenação estável

- Sem checkpoints (último cursor, último ID ou último timestamp)

- Sem regras de idempotência para gravar resultados

Exemplo: se você puxa prospects do Apollo e o job trava, um cursor salvo mais uma regra de “seen IDs” permite retomar limpo. Sem isso, você reexecuta tudo, duplica contatos e aciona mais limites.

Checklist rápido antes do próximo pull de API

Cinco checagens que evitam a maioria das falhas

Antes de apertar run, confirme:

- Limites anotados: requests por minuto, caps diários, regras de burst e quais endpoints contam mais.

- Paginação determinística: um método (cursor é o melhor quando houver), ordenação estável, janela de filtro fixa.

- Regras de retry seguras: backoff exponencial ligado, max retries definido e regra de pause-and-resume para 429s sustentados e 5xx temporários.

- O pull é reiniciável: checkpoint salvo (cursor ou último timestamp/ID visto) e deduplicação por uma chave única de prospect.

- Logging utilizável: run ID, janela de tempo, contagens de requisições, valores de página/cursor e um resumo final de execução.

Um teste rápido de repetibilidade

Faça um pull pequeno (por exemplo, 200 prospects) e reexecute com os mesmos parâmetros. A contagem total deve bater, duplicatas devem ser zero e quaisquer diferenças precisam ser explicáveis (como prospects recém-criados fora da janela fixa).

Se você está empurrando prospects para um sistema de outbound, verifique também o comportamento de gravação: quando o mesmo prospect reaparecer, atualize o registro existente em vez de criar um novo.

Próximos passos: de pulls estáveis a execução consistente de outreach

Um pull estável só importa se virar um workflow controlado. A pergunta final é sempre a mesma: como você passa de uma lista verificada para outreach sem alterar os dados, prejudicar deliverability ou perder rastreabilidade?

Congele a lista que pretende contatar. Salve timestamp do pull, filtros usados e contagem final de registros. Se for enriquecer ou deduplicar, faça isso uma vez, registre as regras e produza uma versão pronta para envio. Isso vira a fonte da verdade para a campanha.

Deliverability é a próxima barreira. Mesmo uma lista perfeita pode falhar se a configuração de envio estiver frágil. Use domínios autenticados (SPF/DKIM/DMARC), evite enviar em alta velocidade a partir de domínios novos e aqueça mailboxes antes de escalar.

Um handoff prático de “dados prontos” para “outreach rodando”:

- Atribua um dono para o pull e um dono para a campanha (podem ser a mesma pessoa).

- Guarde um runbook curto: onde a lista fica, como foi puxada e como rerodar com segurança.

- Importe apenas o arquivo congelado e pronto para envio para sua ferramenta de outreach.

- Comece com um lote pequeno e escale conforme replies e bounces se comportem bem.

- Rastreie resultados de volta ao pull: bounces, unsubscribes e taxas de reply por segmento.

Se quiser menos ferramentas, plataformas como o LeadTrain reúnem peças comuns de outbound (domínios, mailboxes, warm-up, sequências multi-step e classificação de replies) para que a passagem de construção de lista para envio se mantenha consistente. O ponto principal é o mesmo: repita as mesmas regras de pull, mesma validação e mesmos passos de lançamento, com um dono claro que consiga rerodar o processo sem adivinhar.

Perguntas Frequentes

Why do prospect pulls fail so often when rate limits kick in?

O rate limiting costuma quebrar pulls de maneiras que não parecem uma falha clara: o job morre no meio de uma página, re-tenta a mesma página sem deduplicação, ou "termina" depois de engolir erros. O resultado são registros faltantes, duplicatas, enriquecimento parcial e créditos de API desperdiçados.

What’s the difference between rate limits, quotas, and concurrency limits?

Uma rate limit define a velocidade máxima de requisições, uma quota define quantas requisições você pode fazer num período maior, e um limite de concorrência define quantas requisições podem estar em voo ao mesmo tempo. Você pode estar dentro da sua quota diária e ainda assim falhar se causar picos que atinjam limites por minuto ou de burst.

How do I know I’m hitting the API limit versus a normal outage?

Comece logando códigos de status e quaisquer headers de limite em cada chamada, especialmente Retry-After e sinais de remaining/reset. Faça um pequeno teste de pull para ver o comportamento real do provedor sob carga — limites documentados e enforcement de burst frequentemente diferem.

How do I paginate without skipping or duplicating prospects?

Prefira paginação baseada em cursor quando o API suportar, e sempre solicite uma ordenação estável para que a ordem não mude entre chamadas. Se o dataset puder mudar durante o pull, use um timestamp de corte fixo para que novos registros não desloquem páginas e causem pulos ou repetições.

What’s a safe retry strategy for 429 errors and timeouts?

Reexecute apenas falhas claramente temporárias como 429, timeouts e a maioria dos 5xx, e pare de tentar em erros permanentes como 400 ou problemas de autenticação. Ao receber 429, siga Retry-After, adicione um pouco de aleatoriedade e limite o tempo total de tentativas para não ficar preso em loops.

How can I rerun a failed pull without creating duplicates?

Faça writes idempotentes usando upsert com uma chave estável, como o prospect ID do provedor, e mantenha regras de merge consistentes para que reruns não alterem o resultado. Salve um checkpoint após cada página processada e commitada, assim uma queda reprocessa no máximo uma página e não gera duplicatas.

When should I use caching and incremental pulls instead of re-pulling everything?

Use cache para lookups repetidos e para dados de enriquecimento que não precisam ser atualizados a cada execução, e escolha TTLs que reflitam a velocidade de mudança de cada campo. Para sincronizações contínuas, pulls incrementais baseados em updated_at ou um cursor armazenado reduzem carga e a probabilidade de bater em rate limits.

What should I log to make a prospect pull auditable?

No mínimo, capture job ID, parâmetros da requisição, cursor ou token de página, contagens retornadas, latência, códigos de status e quaisquer headers de rate-limit. Assim você pode responder o que aconteceu exatamente na página em que as coisas mudaram e provar se dados faltantes vieram da fonte, do pull ou do passo de gravação.

What metrics and alerts actually catch pull problems early?

Monitore taxa de progresso, taxa de erro dividida entre 4xx/5xx, e com que frequência você está fazendo backoff — esses sinais mostram se você está avançando ou preso. Alerta em padrões como 429s sustentados, 5xx repetidos por vários minutos ou um cursor que não avança, pois esses são os sinais que geram listas parciais.

How does this affect my outreach workflow once prospects are imported into LeadTrain?

Uma cadência baixa e estável costuma vencer bursts, especialmente quando retries começam a se acumular. Se você empurra prospects para um workflow outbound como o LeadTrain, pulls estáveis importam porque duplicatas geram mensagens duplicadas e relatórios confusos, e gaps criam sequências e follow-ups inconsistentes.