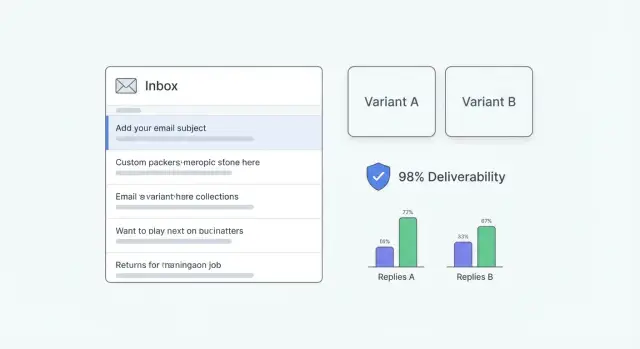

Tests A/B des emails à froid en toute sécurité : quoi tester en premier et comment

Apprenez à tester en A/B des emails à froid en toute sécurité : quoi tester en premier, comment garder les variables propres et comment interpréter de petits échantillons sans nuire à la délivrabilité.

Pourquoi les tests A/B peuvent nuire à la délivrabilité si vous les faites mal

Tester en A/B des emails à froid paraît anodin, mais les fournisseurs de boîtes de réception vous jugent sur des schémas. Si votre « test » est en fait un paquet de changements aléatoires sur différentes listes, heures d'envoi et styles de message, vous créez des signaux bruités. Cela peut ressembler à un comportement d'expéditeur incohérent, et l'incohérence est souvent traitée comme un risque.

Les problèmes de délivrabilité apparaissent généralement vite et discrètement. Vous constatez d'abord moins de réponses, puis les taux d'ouverture baissent, puis davantage de messages atterrissent en spam. Dans les cas plus graves, les fournisseurs ralentissent la livraison (throttling), différent les messages pendant des heures, ou vous bloquent carrément. Le plus dangereux est que vous pouvez continuer à envoyer pendant que la performance se dégrade parce que vous n'obtenez pas toujours une erreur claire.

Le cold email tolère peu d'erreurs. Un test de ligne d'objet qui augmente légèrement les plaintes pour spam peut effacer tout gain en réponses. Une nouvelle variante d"offre" qui semble trop insistante peut provoquer des suppressions rapides, un autre signal négatif.

L'erreur la plus fréquente est de tester trop de choses à la fois. Si la Variante B change l'objet, l'accroche, l'offre et le CTA, vous ne pouvez pas dire ce qui a provoqué le résultat. Vous risquez aussi de créer une version qui déclenche plus de signaux négatifs et qui tire la réputation du domaine vers le bas.

Mettez les tests en pause et corrigez les bases si vous voyez une montée soudaine des bounces ou désinscriptions, plus d'emails en dossier spam que d'habitude, des messages arrivant beaucoup plus tard que d'habitude, des variations jour-à-jour sans raison claire, ou si vous envoyez depuis de nouveaux domaines ou boîtes mail non warm-up.

Exemple : une petite équipe envoie 500 emails et « teste » cinq angles différents sur des sources de leads mélangées. Un angle déclenche quelques plaintes, et maintenant tous les envois futurs depuis ce domaine performent moins bien, y compris les bonnes versions.

Notions de délivrabilité à connaître avant de commencer les tests

La délivrabilité est simple : les fournisseurs observent votre comportement d'envoi et décident si vos emails semblent dignes de confiance. Si trop de personnes vous ignorent, vous signalent comme spam, ou si vous touchez beaucoup d'adresses invalides, vos prochains emails ont plus de chances d'atterrir en spam ou d'être bloqués.

Votre réputation est suivie à plusieurs niveaux. La réputation du domaine reflète la confiance globale du domaine d'envoi. La réputation de la boîte mail (ou de l'expéditeur) est liée à un compte précis et à son comportement récent. Les tests deviennent confus quand vous mélangez ces signaux. Si une variante part d'une boîte mail plus récente ou d'un domaine différent, vous ne testez plus la copie : vous testez la réputation.

Le warm-up et la montée en charge aident, mais ce n'est pas magique. Le warm-up construit un pattern d'envois normaux et d'engagements dans le temps. La montée en charge consiste à augmenter progressivement le volume pour ne pas ressembler à un nouvel expéditeur qui envoie des centaines d'emails du jour au lendemain. Aucun de ces éléments ne vous sauvera si votre liste est mauvaise ou si vous changez trop de choses en même temps.

La qualité de la liste est la façon la plus rapide de casser la délivrabilité. Un taux de rebond élevé indique aux fournisseurs que vous ne maintenez pas vos contacts.

Avant tout test, faites une passe d'hygiène rapide : éliminez les comptes de type rôle (info@, support@, sales@) sauf si vous avez une raison valable, évitez les leads périmés, surveillez les hard bounces et arrêtez d'envoyer aux mêmes adresses similaires, gardez un ciblage serré pour que les réponses correspondent à l'offre, et n'envoyez pas plusieurs variantes à la même personne.

La cohérence vaut mieux que la copie astucieuse au début. Si vous êtes sur un domaine neuf, gardez vos schémas d'envoi stables (volume, créneaux, nom de l'expéditeur) et testez une variable à la fois. Si vous doublez le volume quotidien et changez la ligne d'objet la même semaine, vous ne saurez pas si le « gagnant » a gagné parce qu'il était meilleur ou parce que la délivrabilité a changé.

Que tester d'abord : objet, offre ou CTA

Un ordre pratique : ligne d'objet d'abord, ensuite l'offre, puis le CTA. C'est moins risqué et plus simple à analyser.

1) Ligne d'objet en premier (impacte surtout les ouvertures)

Si les gens n'ouvrent pas, rien d'autre ne compte. Tester l'objet est aussi le changement le plus léger car le corps du message peut rester identique.

Gardez l'hypothèse simple et testable : « Ajouter un bénéfice concret augmentera les ouvertures » ou « Des objets plus courts amélioreront les ouvertures ». Ne changez pas le nom de l'expéditeur, l'heure d'envoi et la première phrase en même temps sinon vous ne saurez pas ce qui a provoqué le mouvement.

2) L'offre ensuite (impacte surtout les réponses)

Une fois les ouvertures correctes, c'est souvent l'offre qui pousse à répondre. L'offre est la raison de répondre, pas seulement la manière dont vous demandez un rendez-vous. Pensez : un audit rapide, un benchmark court, une étude de cas pertinente, ou une promesse claire de gain de temps.

Conservez les tests d'offre propres en ne changeant que la valeur proposée tout en gardant la structure, la longueur et le ton constants. Les tests d'offre produisent souvent des écarts plus importants que de petites modifications de texte.

3) Le CTA en dernier (impacte surtout les réponses positives)

Le CTA détermine la facilité de répondre. Testez d'abord l'engagement le plus faible : questions simples oui/non, « Ça vaut la peine d'en parler ? » vs « Mardi à 14h, ça vous va ? ». De petits changements de CTA peuvent améliorer la qualité des réponses sans modifier votre positionnement.

Évitez les réécritures complètes où l'objet, la première phrase, l'offre et le CTA changent tous d'un coup. Si vous voulez un apprentissage réel, choisissez une variable et notez ce que vous attendez comme effet (ouvertures ou réponses) avant d'envoyer.

Comment garder les variables propres et les comparaisons équitables

Des tests équitables sont ennuyeux par conception. Si deux versions diffèrent sur plus d'un point significatif, vous ne saurez pas ce qui a provoqué le résultat.

« Changer une seule chose » signifie une décision que le lecteur remarque. Si vous testez l'objet, maintenez le texte d'aperçu, la première phrase, l'offre, le CTA et le calendrier d'envoi identiques. Même un changement de ton (familier vs formel) peut devenir une seconde variable si cela modifie la perception de l'email.

Créez une version de contrôle que vous pouvez garder un moment. Choisissez votre email le plus performant actuel, verrouillez-le et nommez-le clairement (par exemple « Contrôle v1 »). Traitez-le comme une référence que vous ne remplacez que lorsqu'une nouvelle version gagne plus d'une fois. Cela vous évite de courir après le bruit en réécrivant tout chaque semaine.

Divisez votre audience de façon aléatoire. N'envoyez pas la Variante A aux fondateurs et la Variante B aux marketeurs puis appelez cela un test. Si votre liste a des segments clairs, stratifiez : partagez chaque segment en deux pour que les deux variantes reçoivent un mélange similaire.

Pendant le test, gardez la source des leads et les règles de filtrage, les jours et fenêtres d'envoi, les étapes et espacements des follow-ups, le domaine d'envoi et le pool de boîtes mail, ainsi que les règles de suppression (bounces, désinscriptions, do-not-contact) identiques.

Un groupe de contrôle (holdout) aide quand les conditions bougent. Garder 10 à 20 % en contrôle pendant que vous testez rend plus facile de détecter si la délivrabilité ou la qualité des leads a changé pour tout le monde.

Étape par étape : lancez votre premier test A/B en sécurité

Un premier test sûr est volontairement simple. Vous voulez un changement clair, un split propre et des règles d'arrêt pour ne pas troquer un petit gain contre des problèmes de délivrabilité à long terme.

-

Choisissez un objectif avant d'écrire quoi que ce soit. Les ouverts peuvent tromper sur des listes vraiment froides. Un choix pratique est le taux de réponse. Si votre équipe peut taguer les réponses de façon fiable, utilisez le taux de réponse positive (réponses intéressées divisées par emails délivrés).

-

Rédigez la Variante A et la Variante B avec une seule différence. Commencez par un seul levier, comme la ligne d'objet. Gardez le nom de l'expéditeur, l'accroche, l'offre, le CTA et la signature identiques.

-

Divisez équitablement. Même source de leads, mix de séniorité et de région similaires, et même fenêtre d'envoi. Si vous avez 400 prospects, scindez 200/200 aléatoirement. Si vous n'avez que 80, faites 40/40 et ajustez vos attentes.

-

Mettez des garde-fous pour ne pas griller une boîte mail. Décidez à l'avance de vos seuils d'arrêt. Si le taux de bounce grimpe, si des plaintes pour spam apparaissent ou si les désinscriptions augmentent par rapport à votre baseline, arrêtez et diagnostiquez.

-

Lancez, vérifiez quotidiennement et respectez vos règles d'arrêt. Surveillez livrés, bounces, plaintes, désinscriptions et réponses. Si un garde-fou est déclenché, stoppez le test et corrigez la cause (qualité de la liste, ciblage ou ton) avant d'en relancer un autre.

Exemple : une petite équipe SDR teste deux objets sur un nouveau segment industriel. Ils gardent exactement le même corps et CTA, divisent la liste équitablement et testent sur trois jours ouvrés. Un objet gagne de quelques réponses, mais les désinscriptions sont aussi plus élevées, donc ils conservent l'objet « perdant » et réécrivent l'accroche à la place.

Que mesurer pour ne pas choisir le mauvais gagnant

Si vous mesurez la mauvaise chose, vous pouvez « gagner » un test A/B et quand même perdre des rendez-vous, ou pire, abîmer votre réputation d'expéditeur. L'objectif n'est pas plus d'activité, mais de meilleures conversations avec les bonnes personnes.

Ouvertures : parfois utiles, souvent trompeuses

Les taux d'ouverture peuvent aider à repérer des problèmes évidents (comme un objet qui obtient presque zéro ouverture). Mais pour choisir un gagnant, les ouvertures sont fragiles. Beaucoup d'applications email préchargent les images, et certaines entreprises bloquent le tracking. « Ouvert » ne signifie pas toujours qu'un humain a lu votre message.

Considérez les ouvertures comme une alarme, pas comme un tableau de score. Si la Variante B a un peu plus d'ouvertures mais moins de réponses, ce sont les réponses qui doivent l'emporter.

Réponses, réponses positives et labels cohérents

Définissez les résultats avant d'envoyer, puis utilisez les mêmes labels pour chaque test. Un jeu simple suffit : réponse positive (intérêt clair ou proposition d'étapes suivantes), réponse neutre (pas maintenant, rappeler plus tard), réponse négative (pas intéressé), réponse administrative (hors bureau, mauvaise personne), et désinscription ou plainte.

Suivez à la fois le taux de réponse (toutes les réponses humaines) et le taux de réponse positive. Le taux de réponse indique si votre message invite à répondre. Les réponses positives indiquent si votre offre et votre ciblage fonctionnent.

Surveillez aussi la santé de la délivrabilité en parallèle. N'ignorez pas les bounces, les blocages, les plaintes pour spam et les désinscriptions sous prétexte que « le test est petit ». Une variante qui apporte quelques réponses supplémentaires mais double les plaintes est un mauvais trade.

Si possible, regardez la performance par boîte mail et par domaine, pas seulement globalement. Un expéditeur faible peut tirer les résultats vers le bas et masquer la vraie histoire.

Comment juger des résultats avec de petits échantillons

Les petits tests A/B peuvent mentir. Une version peut gagner parce qu'elle a reçu de meilleurs leads, ou parce qu'un expéditeur avait légèrement meilleure réputation cette semaine. Quand vous avez seulement quelques réponses, l'aléa joue un grand rôle.

Ne jugez pas un test sur les envois ou les ouvertures. Visez des résultats qui comptent, comme les réponses positives ou les rendez-vous pris. Si vous n'obtenez que 1 à 3 réponses au total, vous n'avez pas vraiment appris quelle version fonctionne.

Une façon pratique d'interpréter de petits résultats :

- Victoire directionnelle : clairement plus de réponses positives, mais les totaux sont encore faibles (2 vs 0). Traitez cela comme un indice.

- Victoire forte : un écart reproductible après plus d'événements (10 vs 4 réponses positives). Suffisamment pour choisir un gagnant.

- Pas de signal : les résultats sont proches ou varient selon le jour ou la boîte. Inconclusif.

Regrouper les données sur plusieurs jours et boîtes aide seulement si les conditions restent les mêmes : mêmes règles d'audience (même ICP et source), calendrier d'envoi similaire (mêmes étapes et espacements), et délivrabilité stable (pas de nouveau domaine, pas de changement de warm-up). Si vous changez quelque chose d'important comme l'offre, le ciblage ou le volume, relancez le test.

Faites tourner jusqu'à atteindre un seuil de réponses, pas jusqu'à une date butoir. Arrêtez tôt uniquement en cas de victoire forte. Sinon, continuez jusqu'à avoir assez de réponses pour faire confiance à la direction, ou déclarez le test non concluant et testez un changement plus important.

Comment tester sans endommager la réputation d'expéditeur

Les tests A/B ne servent que si votre réputation d'envoi reste stable. Si la délivrabilité chute en cours de test, vous pouvez finir par « apprendre » qu'une version est pire alors que c'est l'emplacement en boîte qui s'effondre.

Contrôlez le volume. Gardez les envois quotidiens stables et augmentez par petites étapes sur plusieurs jours au lieu de passer de 50 à 500 du jour au lendemain. Les pics soudains paraissent artificiels et peuvent déclencher du throttling ou du placement en spam.

Si vous avez besoin de plus de volume, augmentez la capacité de façon sûre : répartissez les envois sur plusieurs boîtes mail déjà warm-up plutôt que de pousser une seule boîte.

Pendant que vous testez l'email initial, gardez le reste de la séquence cohérent. Ne changez pas le timing des follow-ups, le texte des follow-ups ou le nombre de relances en plein test. Sinon vous testez le premier contact plus la « pression » de la séquence.

Évitez les changements cachés qui affectent l'emplacement en boîte : changement de domaine, modification des heures d'envoi, modification des réglages de tracking (surtout le suivi d'ouverture), ou changement de comportement de warm-up pendant la fenêtre de test.

Si des signaux d'arrêt apparaissent, mettez en pause et stabilisez avant de continuer : le taux de bounce dépasse votre baseline, les plaintes pour spam augmentent, beaucoup de messages sont retardés ou différés, les désinscriptions explosent, ou les réponses mentionnent spam ou « pourquoi je reçois ça ? ».

Exemple : une agence de deux personnes teste un nouvel objet. Ils gardent les envois à 40 par boîte par jour, répartissent sur trois boîtes warm-up et testent pendant une semaine. Ils mettent en pause dès que les bounces augmentent après l'upload d'un nouveau segment, nettoient la liste, puis reprennent.

Erreurs courantes qui rendent les tests A/B inutiles ou risqués

La plupart des « victoires » célébrées viennent de configurations brouillonnes, pas d'une meilleure copie.

La plus grosse erreur est de changer plusieurs choses à la fois. Si la Version A a un nouvel objet, une offre différente et un nouveau CTA, vous ne saurez pas ce qui a provoqué le changement. De gros écarts de formulation entre variantes peuvent aussi sembler comme un comportement d'envoi incohérent, ce qui nuit à la délivrabilité.

Autres erreurs :

- Changer discrètement l'audience entre A et B (taille d'entreprise, intitulés, géographie).

- Déclarer un gagnant sur 1 ou 2 réponses en plus.

- Sur-optimiser les ouvertures avec un objet de curiosité qui ne correspond pas au corps.

- Ignorer désinscriptions, plaintes et bounces parce que les réponses semblent bonnes.

Surveillez aussi la dérive de setup : envois à des heures différentes, utilisation de domaines différents, ou ajustement du warm-up en plein test.

Si vous voulez des résultats fiables, testez une variable par test, divisez les leads similaires équitablement et considérez désinscriptions et plaintes comme des signaux d'arrêt.

Exemple : une petite équipe testant des cold emails sur une liste limitée

Une petite équipe SDR dispose d'une liste de 500 prospects. Ils envoient depuis deux boîtes et utilisent une séquence simple en 3 étapes pour surveiller les résultats sans augmenter trop le volume.

Ils testent de manière sûre : un seul changement, tout le reste identique, et partage équitable de la liste. Ils assignent 250 prospects à la Variante A et 250 à la Variante B, en veillant à garder les mêmes industries et intitulés dans chaque groupe.

Test 1 : ligne d'objet A vs B

Ils ne testent que la ligne d'objet. Le corps, l'offre, le CTA, les heures d'envoi et les follow-ups restent identiques.

Après quelques jours, l'Objet B obtient plus d'ouvertures. Ils sont tentés de l'annoncer gagnant, mais les réponses sont à peu près identiques et la qualité des réponses n'augmente pas. Cela signifie généralement que l'objet a suscité de la curiosité, mais que le corps et l'offre n'ont pas délivré, ou que le CTA demandait trop. Ils conservent l'objet qui ouvre mieux, mais n'en font pas une percée décisive.

Test 2 : ajustement d'offre vs ajustement du CTA

Ensuite, ils choisissent en fonction du goulot d'étranglement. Puisque les ouvertures ont augmenté mais pas les réponses, ils se concentrent sur le corps et choisissent un test propre pour la prochaine salve, pas les deux.

Ils documentent chaque test dans une note partagée : hypothèse, copies exactes A et B, règles d'audience, résultats (ouvertures, réponses, réponses positives, désinscriptions) et la décision (conserver, abandonner ou retester). Ce registre les empêche de répéter les mêmes expériences.

Checklist rapide et étapes pratiques suivantes

Avant de lancer des tests A/B d'emails à froid, faites un contrôle de sanity. Beaucoup de « mauvais résultats » viennent d'un problème de liste ou de délivrabilité.

Avant d'envoyer, confirmez que l'authentification est en place (SPF, DKIM, DMARC), que les boîtes sont warm-up et envoient de façon régulière, que la liste est propre et pertinente, que les deux versions partent dans la même fenêtre jour/heure, et que votre séquence et la gestion des réponses fonctionnent de bout en bout.

Ensuite, simplifiez le test : changez une chose (objet ou offre ou CTA), divisez l'audience équitablement, choisissez un objectif (souvent le taux de réponse positive) et écrivez une règle d'arrêt à l'avance.

Après le lancement, ne sacrez pas un gagnant après quelques envois. Limitez le volume pendant les tests, surveillez quotidiennement bounces, désinscriptions et plaintes, et assurez-vous que les résultats ne sont pas portés par une seule boîte mail. Si les réponses sont trop peu nombreuses pour juger, prolongez le test ou testez un changement plus important (souvent l'offre).

Si vous voulez moins de pièces mobiles pendant des tests contrôlés, LeadTrain (leadtrain.app) garde domaines, boîtes mail, warm-up, séquences multi-étapes et classification des réponses en un seul endroit, ce qui réduit le risque de modifier involontairement la configuration pendant que vous testez la copie.

FAQ

Comment executes-je un test A/B sans nuire à la délivrabilité ?

Commencez par un seul changement, généralement la ligne d'objet, et gardez tout le reste identique : source de la liste, fenêtre d'envoi, domaine, pool de boîtes mail et étapes de la séquence. Définissez des seuils d'arrêt pour les bounces, désinscriptions et plaintes avant de lancer afin qu'une variante “gagnante” ne puisse pas endommager silencieusement la réputation.

Pourquoi les tests A/B peuvent-ils empirer la délivrabilité ?

Tester plusieurs éléments à la fois crée des schémas incohérents entre les envois, et les fournisseurs de boîte mail peuvent considérer cela comme un comportement à risque. Si une variante provoque plus de suppressions, de plaintes ou de bounces, elle peut tirer la réputation du domaine vers le bas et faire atterrir même vos bons messages en spam.

Que devrais-je tester en premier : la ligne d'objet, l'offre ou le CTA ?

Testez d'abord la ligne d'objet, puis l'offre, puis l'appel à l'action. Cet ordre réduit le risque et facilite la compréhension de ce qui a changé : les objets influencent surtout les ouvertures, les offres entraînent généralement les réponses, et le CTA affecte souvent la qualité des réponses.

Quel indicateur dois-je utiliser pour choisir le gagnant ?

Un bon choix par défaut est le taux de réponse positive basé sur les emails délivrés, car il s'aligne sur des résultats concrets. Les ouvertures peuvent alerter d'un problème évident, mais elles ne sont pas fiables pour choisir un gagnant en cold outreach parce que le tracking peut être bloqué ou faussé.

Quand dois-je mettre les tests en pause et réparer la délivrabilité d'abord ?

Si les bounces ou les désinscriptions augmentent, si les messages arrivent beaucoup plus tard que d'habitude, ou si la placement en spam augmente, arrêtez et corrigez d'abord les bases. Suspendez aussi si vous envoyez depuis de nouveaux domaines ou boîtes mail non warm-up, car les variations de réputation peuvent submerger votre test de copy.

Comment garder les variables propres pour que la comparaison soit équitable ?

Si vous changez la ligne d'objet, conservez le texte d'aperçu, la première phrase, l'offre, le CTA, la signature et le calendrier d'envoi identiques. Divisez la même audience au hasard (ou partagez chaque segment en deux) pour que la Variante A et la Variante B reçoivent des mixes similaires de postes, d'industries et de régions.

Qu'est-ce qu'un contrôle et pourquoi en ai-je besoin ?

Créez un email de référence unique (par exemple « Contrôle v1 ») et ne le modifiez pas pendant un certain temps. Ne le remplacez que lorsqu'une nouvelle version gagne plus d'une fois ; sinon vous risquez de courir après le bruit et de réinitialiser constamment ce que signifie la performance « normale ».

Comment juger les résultats d'un A/B test avec une petite liste ?

Ne vous fiez pas aux résultats d'une poignée de réponses ; l'aléa est important à faible volume. Considérez les petites victoires comme des indices directionnels, puis prolongez le test jusqu'à obtenir suffisamment de réponses positives pour être confiant, ou concluez que c'est non concluant et testez un changement plus substantiel (souvent l'offre).

Comment contrôler le volume pour ne pas être throttlé ou signalé ?

Maintenez un volume d'envois quotidien stable et évitez les sauts brutaux, surtout pendant un test. Si vous avez besoin de capacité, répartissez les envois sur plusieurs boîtes mail warm-up plutôt que de surcharger une seule boîte, et ne modifiez pas le comportement de warm-up en cours de test.

Comment LeadTrain peut-il m'aider à tester des emails à froid plus sûrement ?

LeadTrain centralise domaines, boîtes mail, warm-up, séquences et classification des réponses en un seul endroit, ce qui réduit la « dérive de setup » lors des tests. Ainsi, il est plus simple de garder le domaine d'envoi et le pool de boîtes mail constants pendant que vous ne changez qu'une seule variable dans la copie de votre email.