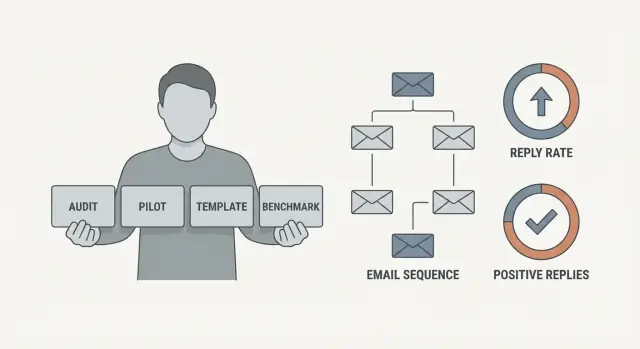

Test d'offres pour e-mails à froid : audit, pilote, modèle, benchmark

Cadre de test d'offres pour e-mails à froid afin de comparer équitablement audit, pilote, modèle et benchmark en utilisant la même qualité de liste et les mêmes métriques.

Pourquoi tester l'offre, pas seulement la ligne d'objet

Une ligne d'objet peut gagner l'ouverture, mais elle gagne rarement la réponse. La plupart des cold emails meurent après l'ouverture parce que l'offre est floue, semble risquée ou ne vaut tout simplement pas le temps de quelqu'un.

L'offre est la vraie décision : « Est-ce que je veux ça au point d'y répondre à un inconnu ? » Vous voyez cette décision dans la qualité des réponses, pas dans le taux d'ouverture. Une ligne d'objet maligne peut augmenter les ouvertures, mais une offre faible vous laisse le silence, des réponses vagues du type « peut-être plus tard », ou des refus rapides.

Différentes offres attirent aussi différents types de « oui ». Un audit attire ceux qui veulent un retour rapide. Un pilote attire des acheteurs prêts à essayer. Un modèle séduit les équipes qui veulent faire elles-mêmes. Un rapport benchmark attire les prospects qui veulent du contexte avant d'échanger.

Quand vous testez des offres, suivez des résultats qui reflètent une vraie intention :

- Réponses positives (intérêt clair, questions, demandes de détails)

- Intention de réunion (disponibilités, « on peut en parler ?»)

- Intérêt qualifié (bonne personne, vraie douleur)

- Signaux négatifs (non pertinent, cessez d'envoyer, désabonnements)

Les tests d'offre foirent quand la qualité de la liste change entre les tours. Si une offre est envoyée à de meilleurs comptes ou à des données plus fraîches, elle semblera gagnante même si ce n'est pas le cas. Ça crée une fausse confiance et des résultats qu'on ne peut pas reproduire.

Un exemple simple : vous testez un « audit gratuit » sur une liste propre d'entreprises mid-market qui recrutent activement, puis vous testez un « programme pilote » sur une liste mixte incluant de petites boîtes et des contacts anciens. L'audit « gagne », mais vous avez surtout testé la qualité de la liste, pas l'offre.

Gardez l'objectif précis : apprenez quelle offre obtient le plus de réponses positives auprès du même type de prospect.

Les quatre offres et ce qu'elles signalent aux prospects

Quand vous changez l'offre, vous changez ce que le lecteur pense que vous lui demandez. Pas seulement de l'argent, mais du temps, de la confiance et de l'attention. Un bon test compare des offres qui paraissent significativement différentes tout en gardant le reste du mail identique.

Audit : diagnostic à faible engagement

Un audit est une offre « dites-moi ce qui cloche ». Il marche mieux quand le périmètre est étroit et le livrable concret, comme « une checklist d'une page sur la délivrabilité » ou « 3 lacunes précises dans votre séquence de relance ».

Le signal envoyé est peu d'effort côté prospect et un effort modéré pour vous. Ça peut créer vite de la confiance parce que vous offrez un aperçu avant de demander un appel. Mais si c'est vague (« audit gratuit »), ça peut sembler un piège menant directement à un pitch.

Pilote : essai limité dans le temps

Un pilote dit « Essayons cela à petite échelle et en sécurité. » Il peut être payant ou gratuit, mais il devrait être limité en temps ou en taille, par exemple « 2 semaines », « une équipe » ou « un segment ». Indiquez qui peut en bénéficier pour que ça ne ressemble pas à une demande désespérée.

Le signal demande plus de confiance mais donne une valeur perçue plus élevée. Un pilote implique que vous ferez du vrai travail et produirez des résultats. Il peut aussi créer de la friction si l'étape suivante paraît lourde (contrats, mise en place, réunions).

Modèle : un actif prêt à l'emploi

Un modèle, c'est « voici quelque chose que vous pouvez utiliser aujourd'hui ». Pensez scripts, checklists, calculateurs ou un court playbook. Dites le travail qu'il aide à faire, pas le type de fichier, par exemple « une séquence de 5 e-mails pour réactiver des leads dormants ».

Le signal est une valeur rapide pour un effort très faible. Les modèles peuvent générer des réponses rapides, mais aussi attirer des chasseurs de freebies. Il vaut mieux rendre le modèle spécifique à leur rôle ou situation.

Benchmark : rapport comparatif

Un benchmark, c'est « voici comment vous vous situez ». Il peut être basé sur votre jeu de données, des sources publiques, ou sur quelques inputs qu'ils fournissent. Ce qui compte, c'est le cadrage, par exemple « taux de réponse moyen dans votre niche » ou « raisons courantes pour lesquelles les prospects disent non ».

Le signal est crédibilité et autorité, mais aussi examen critique. Les gens se demanderont d'où viennent les chiffres. Si la source des données n'est pas claire, l'offre peut sembler inventée.

Sur les quatre, vous testez la même chose : quelle promesse vaut une réponse. L'audit mise sur la clarté, le pilote sur l'engagement, le modèle sur la vitesse, et le benchmark sur la preuve.

Garder la qualité de la liste identique pour un test juste

La façon la plus rapide d'obtenir un « gagnant » factice est d'envoyer chaque offre à un type de prospect différent. Un audit aura l'air incroyable s'il est envoyé à des entreprises déjà en recherche d'aide, tandis qu'un modèle paraîtra faible s'il est envoyé à des personnes qui ne touchent jamais ce problème.

Commencez par une audience ciblée et 1–2 personas. Faites simple : un rôle nommé, une douleur principale, une raison pour laquelle ils s'en soucient maintenant.

Puis verrouillez votre source de liste. Choisissez un endroit d'où vous tirerez les prospects et ne mélangez pas les sources pendant le test. Différentes sources signifient fraîcheur et précision différentes, ce qui peut changer les résultats plus que l'offre elle-même.

Écrivez les règles d'inclusion avant de construire la liste et appliquez-les aux quatre variantes : rôle et séniorité, industrie, région/langue et taille d'entreprise. Nettoyez la liste de la même façon à chaque fois aussi. Retirez clients actuels, partenaires et toute personne avec qui vous avez eu une vraie conversation récemment. Ces personnes répondent différemment et faussent les résultats.

Enfin, randomisez une fois et répartissez équitablement pour que chaque offre reçoive un mélange similaire d'industries, tailles et titres.

Décidez ce qui reste fixe et ce que vous mesurerez

Les tests d'offre fonctionnent seulement si vous les traitez comme une expérience contrôlée. Si vous changez trois choses à la fois, vous ne saurez pas si l'audit « a gagné » parce qu'il était meilleur ou parce qu'il avait un autre nom d'expéditeur, une séquence plus longue ou une demande plus forte.

Choisissez une métrique principale. Pour la plupart des équipes, le choix le plus propre est le taux de réponses positives : des réponses montrant clairement de l'intérêt, pas seulement « merci » ou « arrêtez ». Ça reflète l'intention et est moins bruité que les ouvertures ou clics.

Ajoutez quelques métriques secondaires pour repérer les coûts cachés : taux total de réponses, réunions bookées (ou appels qualifiés), désabonnements/plaintes (si disponibles) et taux de rebond comme vérification rapide de la qualité de la liste.

Maintenez la « plomberie » constante pour les quatre offres : même identité d'expéditeur et domaine d'envoi, même longueur et timing de séquence (par exemple 3 étapes sur 7–10 jours), même style de CTA, mêmes règles de ciblage, et volume quotidien similaire pour que la délivrabilité ne varie pas.

Que devez-vous changer ? Seulement l'offre et un petit élément de preuve qui la soutient.

Créez des e-mails comparables pour audit, pilote, modèle, benchmark

Pour un test juste, les e-mails doivent se sentir comme des proches, pas des étrangers. Rédigez un e-mail de base et remplacez uniquement le bloc d'offre.

Commencez par une phrase de problème centrale que vous pouvez réutiliser mot pour mot. Choisissez un problème spécifique et douloureux, mais répandu dans toute la liste. Gardez-le identique dans les quatre versions pour tester l'offre, pas le cadrage.

Maintenez le même pattern d'ouverture, la forme du CTA, la longueur, le ton et l'identité de l'expéditeur. Puis écrivez la valeur spécifique à l'offre en 1–2 phrases. Visez à rendre chaque offre aussi facile à comprendre et similaire en effort pour le lecteur.

Exemples de lignes d'offre avec la même structure :

- Audit : « Je peux faire un audit rapide de vos e-mails de relance et pointer 3 lacunes précises qui coûtent des réponses. »

- Pilote : « Je peux mettre en place un petit pilote de 2 semaines sur un segment limité pour que vous voyiez les résultats avant de vous engager. »

- Modèle : « Je peux partager le modèle exact de relance que nous utilisons, adapté à votre produit et audience. »

- Benchmark : « Je peux envoyer un court rapport benchmark montrant les taux de réponse pour des équipes similaires, plus 2 corrections pratiques. »

Ajoutez un seul point de preuve par offre et restez simple (délai de livraison, format, périmètre). Évitez d'empiler les preuves jusqu'à ce qu'une variante semble plus forte pour des raisons non liées à l'offre.

Gardez le CTA identique en forme pour les quatre versions. Une question claire marche souvent le mieux : « Je vous l'envoie ? » ou « Je dois envoyer le draft ? »

Étape par étape : lancez le test d'offre comme une expérience contrôlée

Faites-en un seul test, pas quatre campagnes séparées

Commencez par une seule liste de prospects, mélangez-la, puis divisez-la en quatre groupes égaux. Chaque groupe doit se ressembler : même mix de rôles, tailles d'entreprise, industries et géographies.

Assignez une offre par groupe (audit, pilote, modèle, benchmark) et ne changez pas l'affectation pendant le test. Si vous « aidez » une offre en lui donnant de meilleurs comptes, vous ne testez plus l'offre.

Flux simple :

- Randomisez la liste et divisez en quatre buckets égaux

- Assignez une offre à chaque bucket et étiquetez-les

- Envoyez la même structure de séquence à tous les buckets (mêmes étapes, mêmes délais)

- Geler les autres expériences pendant la fenêtre

- Terminer le test uniquement après que chaque bucket ait atteint la taille d'échantillon prévue

Gardez tout le reste fixe

Utilisez les mêmes domaines et boîtes d'envoi, le même volume quotidien, les mêmes heures d'envoi et la même cadence de relance. Maintenez le niveau de personnalisation constant et le format du CTA identique.

Décidez de la règle d'arrêt avant de commencer

Choisissez une taille d'échantillon minimale par groupe et une fenêtre temporelle, puis tenez-vous-y. S'arrêter tôt parce qu'une offre « a l'air bien » est la façon de se tromper.

Visez à courir au moins un cycle complet de séquence pour que les réponses tardives comptent.

Comment lire les résultats sans se tromper

Les tests d'offre sont souvent « gagnés » par le mauvais e-mail quand les équipes se focalisent sur les ouvertures ou les réponses totales. Décidez à l'avance ce qu'est un bon résultat, puis notez toutes les réponses de la même façon.

Définissez une réponse positive en termes simples. « Ça a l'air intéressant » n'est pas la même chose que « Oui, prenons rendez-vous ». Si la définition change en cours de test, vous choisirez l'offre qui vous plaît personnellement.

Une façon pratique de scorer les réponses :

- Positif qualifié : demande un appel, les prix, le planning ou les prochaines étapes

- Positif mou : intéressé mais veut plus d'infos ou un suivi plus tard

- Neutre : absence automatique, réponses hors bureau

- Négatif : pas intéressé, pas pertinent, cessez d'envoyer

- Redirection : renvoie vers la bonne personne

Suivez aussi les négatifs cachés qui peuvent nuire à la suite : désabonnements, plaintes pour spam et réponses agressives.

Comparez ensuite les résultats de deux façons : par offre et par segment de persona. Un modèle peut mieux fonctionner pour des fondateurs, tandis qu'un benchmark peut parler davantage à un responsable marketing. Si vous regardez seulement le total, vous pouvez rater un vrai gagnant par persona.

Quand vous choisissez le gagnant, pesez volume et qualité. Si l'Offre A obtient 12 positifs mais seulement 2 qualifiés, tandis que l'Offre B obtient 8 positifs dont 6 qualifiés, l'Offre B est généralement meilleure pour générer des réunions.

Scénario exemple : une liste, quatre offres, un gagnant clair

Maya est une SDR qui vend un logiciel RH aux entreprises mid-size. Elle veut tester des offres sans changer la qualité de la liste, alors elle extrait un segment propre : Directeurs RH dans des entreprises de 200 à 1 000 personnes dans le retail et la logistique. Même source de données, mêmes filtres, même volume d'envoi.

Elle reste sur une seule douleur pour toutes les offres : les équipes RH perdent des heures chaque semaine à courir après des étapes d'onboarding manquantes, et les transitions cassent quand les embauches montent en flèche.

Elle cadre la même douleur de quatre façons :

- Audit : « Je peux revoir votre flux d'onboarding et pointer où les étapes sont manquées (pas de préparation, juste un appel rapide). »

- Pilote : « Choisissez un site ou un manager et lancez un pilote de 14 jours pour prouver le temps économisé. »

- Modèle : « Je peux partager la checklist d'onboarding plus des modèles d'e-mails qui fonctionnent pour des équipes similaires. »

- Benchmark : « Je peux envoyer un court benchmark comparant votre process aux pairs (time-to-first-day, taux de complétion, points de chute). »

Après deux semaines, les taux d'ouverture sont similaires, mais les réponses diffèrent. Le Modèle gagne en réponses positives totales et en rapidité vers la réunion. L'Audit suscite de la curiosité polie mais moins de prises de rendez-vous. Le Pilote attire de plus grandes entreprises mais ralentit avec des questions procurement. Le Benchmark sonne trop “consultant” et provoque plus de déviations.

Elle améliore la séquence gagnante sans relancer tout le test : email 1 propose le modèle, email 2 pose une question de qualification (« L'onboarding est-il géré par les RH ou par chaque département ? »), et email 3 n'introduit le pilote qu'après engagement.

Erreurs courantes qui rendent les tests inutiles

La plupart des tests échouent parce qu'ils changent trop de choses à la fois ou choisissent un gagnant sur le mauvais signal.

Erreurs fréquentes :

- Changer l'offre et la ligne d'objet (ou la première phrase) en même temps

- Donner à une offre une meilleure tranche de la liste (titres à plus forte intention, données plus propres)

- S'arrêter tôt après quelques réponses

- Juger par les ouvertures ou les clics plutôt que par les réponses positives et les réunions

- Ignorer les désabonnements, plaintes et dommages à la délivrabilité

Un correctif simple : choisissez une métrique principale (réponses positives pouvant mener à une réunion), suivez les effets secondaires (désabonnements et plaintes), et gardez les conditions d'envoi constantes.

Surveillez aussi comment les réponses sont étiquetées. Une boîte de réception en bazar facilite le comptage des « peut-être » comme des victoires.

Checklist rapide et prochaines étapes

Avant d'envoyer, assurez-vous que votre test est vraiment un test :

- Divisez la liste aléatoirement et équitablement

- Verrouillez les constantes (expéditeur, cadence, nombre de relances, style de CTA)

- Définissez les métriques de succès à l'avance

- Mettez-vous d'accord sur ce qui compte comme réponse positive

- Vérifiez la délivrabilité de base (domaine authentifié, boîte chaude, pas de tracking cassé)

Pendant le test, ne modifiez pas le copy en cours. Si vous changez le moteur en roulant, vous ne saurez pas ce qui a causé le résultat.

Après le test, utilisez une règle claire pour désigner le gagnant : taux de réponses positives le plus élevé, avec assez de volume pour s'y fier, et niveaux de désabonnement/plaintes acceptables.

Si vous voulez moins de variables pendant des tests comme celui-ci, LeadTrain (leadtrain.app) met domaines, boîtes, warm-up, séquences et classification des réponses au même endroit pour que chaque variante d'offre puisse tourner dans les mêmes conditions.

FAQ

Why should I test the offer instead of only testing subject lines?

Testez l'offre quand vous visez des réponses et des rendez-vous, pas seulement des ouvertures. Une ligne d'objet peut attirer l'attention, mais c'est l'offre qui fait décider si ça vaut la peine de répondre et d'aller plus loin.

How do I keep list quality the same across offer variants?

Commencez par une audience propre et une seule source de données, puis randomisez la liste une fois et divisez-la équitablement. Appliquez les mêmes règles d'inclusion pour chaque variante afin de ne pas tester involontairement des « meilleurs comptes » contre des « pires comptes ».

What’s the best metric to pick a winning offer?

Utilisez le taux de réponses positives comme métrique principale, défini à l'avance en termes clairs. Contrôlez ensuite avec l'intention de réunion, les réponses qualifiées, les désabonnements/complaints et le taux de rebond pour éviter de choisir un "gagnant" qui nuira aux envois futurs.

What exactly should stay constant in an offer test?

Gardez tout le reste identique : identité de l'expéditeur, domaine d'envoi, longueur de la séquence, timing, règles de ciblage et volume. Changez uniquement le bloc d'offre et un petit élément de preuve assorti pour isoler l'offre elle-même.

How many emails or prospects do I need per offer to trust the result?

Une règle pratique est de laisser au moins un cycle complet de séquence et suffisamment d'envois par variante pour obtenir un signal stable, pas seulement quelques réponses. Fixez une taille d'échantillon minimale et une date de fin avant de commencer, et ne vous arrêtez pas tôt parce qu'une variante semble en avance.

How should I score replies so I don’t fool myself?

Rédigez une règle de scoring simple avant le lancement et appliquez-la de façon constante. Considérez « prendre rendez-vous » et « demander un tarif » comme de vrais positifs, et gardez l'intérêt mitigé, les absences automatiques et les refus polis dans des catégories séparées pour ne pas gonfler les résultats.

When should I use an audit vs a pilot vs a template vs a benchmark?

Choisissez l'offre selon l'action que vous voulez obtenir ensuite. Les audits fonctionnent quand vous pouvez fournir un résultat concret rapidement, les pilotes quand vous pouvez limiter le périmètre et le risque, les modèles quand la rapidité compte, et les benchmarks quand votre histoire de données est crédible et claire.

What if the “winning” offer also increases unsubscribes or angry replies?

Les désabonnements et les plaintes sont un coût, pas seulement du bruit, et ils peuvent dégrader la délivrabilité dans le temps. Si une offre gagne en réponses mais augmente aussi les signaux négatifs, resserrez le ciblage, clarifiez la promesse et adoucissez la demande avant de la scaler.

How do I tell if results are skewed by deliverability or bad data?

Un taux de rebonds élevé signifie souvent que la source ou la liste a changé, pas que l'offre est moins bonne. Stoppez le scaling, nettoyez et validez les données, puis relancez le test en appliquant les mêmes règles de liste pour comparer les offres de façon juste.

What should I do after I find the best-performing offer?

Utilisez le gagnant comme nouveau témoin, puis itérez en changeant une seule chose à la fois, par exemple ajouter une question de qualification dans les relances ou ajuster la ligne de preuve. Pour plus de cohérence, des outils comme LeadTrain peuvent aider à garder domaines, warm-up, séquences et classification des réponses uniformes pendant les tests.