Playbook sur les limites d'API pour des extractions stables de listes de prospects

Playbook sur les limites d'API pour la prospection : pagination, retries, cache et journalisation pour des extractions de listes stables, répétables et auditables.

Pourquoi les extractions de listes de prospects échouent sous les limites de taux

Les extractions de prospects échouent souvent de façons ennuyeuses et prévisibles : une intégration atteint une limite d'API, le job ralentit, et quelqu'un le relance sans savoir ce qui s'est déjà passé. Ça ressemble à un « problème de l'API », mais le vrai problème est que l'extraction n'était pas conçue pour bien se comporter sous pression.

Quand une extraction rencontre des limites de taux, quelques modes d'échec reviennent sans cesse :

- Des enregistrements manquants parce que le job expire au milieu d'une page et ne reprend jamais proprement

- Des doublons parce que des pages sont retentées sans stratégie idempotente

- Des mises à jour partielles où certains prospects sont enrichis et d'autres restent vides

- Des trous silencieux quand des erreurs sont avalées et que l'extraction « se termine » quand même

- Du gaspillage de crédits quand les mêmes endpoints sont appelés à répétition

Cette instabilité coûte cher. Vous payez deux fois (ou plus) pour les mêmes données, les séquences deviennent désordonnées (le même lead importé ou contacté deux fois), et les rapports deviennent difficiles à croire. À grande échelle, de petites incohérences de liste se transforment en problèmes de délivrabilité et de relances confuses.

L'objectif est simple : des extractions stables, répétables et auditables.

- Stables : les grandes extractions se terminent sans surveillance.

- Répétables : les relances ne changent pas les résultats sauf si la source a changé.

- Auditable : plus tard, vous pouvez dire quelles appels ont eu lieu, ce qui a été importé et pourquoi.

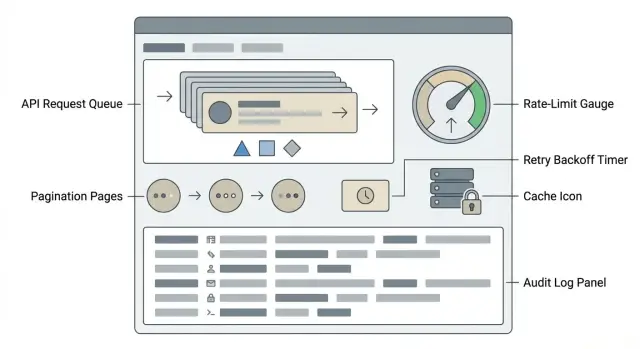

Les éléments pratiques sont : une pagination qui n'oublie ni ne double des éléments, des retries qui récupèrent sans empirer la situation, du caching et des extractions incrémentales qui réduisent la charge API, et des logs qui rendent chaque exécution explicable. Si vous extrayez des prospects depuis des fournisseurs comme Apollo vers un système d'outbound (par exemple pour alimenter des séquences dans LeadTrain), ces garde-fous empêchent que la croissance ne vire au chaos.

Connaître les limites avant d'extraire

Avant de lancer une extraction importante, clarifiez ce que l'API autorise. Cette étape « ennuyeuse » évite des listes à moitié terminées, des pages manquantes et des imports en double plus tard.

Les rate limits concernent la vitesse. Les quotas concernent le volume total. Les limites de concurrence concernent combien de requêtes vous exécutez en même temps.

- Rate limit : nombre max de requêtes par seconde ou par minute (exemple : 60 requêtes/min)

- Quota : nombre max de requêtes par jour ou par mois (exemple : 10 000/jour)

- Limite de concurrence : nombre max de requêtes en vol (exemple : 5 requêtes parallèles)

La plupart des APIs exposent des signaux de limite via des en-têtes de réponse et quelques codes d'état courants. Quand vous vous intégrez à un fournisseur, capturez ces signaux tôt pendant une petite extraction de test.

Schémas typiques :

- HTTP 429 (Too Many Requests) et parfois 403 pour l'application des limites

Retry-Afterindiquant combien de temps attendreX-RateLimit-Limit,X-RateLimit-Remaining,X-RateLimit-Reset(les noms varient)- En-têtes spécifiques au fournisseur comme

RateLimit-*ouX-Quota-*

Surveillez aussi les limites de rafale. Vous pouvez être autorisé à 60 requêtes/min, mais être bloqué si vous en envoyez 20 en une seconde. Les rafales surviennent facilement avec des workers parallèles, des retries ou une boucle de pagination serrée.

Pour la planification du débit, commencez prudemment. Prenez la limite publiée et visez 60% à 80% de celle-ci. Si la limite est 60/min et que chaque requête retourne 100 prospects, ciblez environ 40 à 45 requêtes/min (environ 4 000 à 4 500 prospects/min) et gardez peu de requêtes parallèles (souvent 1 à 3) pour éviter les pics.

Pagination qui n'oublie ni ne duplique les prospects

La pagination est la source de la plupart des trous et doublons « aléatoires ». L'objectif est des extractions de pages déterministes, même si de nouveaux prospects sont ajoutés pendant la lecture.

La pagination par offset (page=7, limit=100) est simple, mais risquée quand le jeu de données change. Si des enregistrements sont ajoutés ou modifiés en cours d'exécution, la « page 7 » peut bouger, ce qui provoque des omissions ou des répétitions. La pagination par curseur (un token next_cursor) est généralement plus sûre car elle vous dit exactement où continuer, mais elle dépend quand même que l'API retourne un ordre stable.

Pour garder les pages cohérentes, demandez un tri stable et conservez des filtres fixes pendant toute l'exécution. Une approche courante est de trier par un champ monotone comme created_at, avec un tie-breaker comme id pour que deux enregistrements créés au même instant ne changent pas d'ordre entre les appels.

Si les données peuvent changer pendant votre extraction, « geler l'univers ». Enregistrez un timestamp de coupure au départ (par exemple, created_at <= 2026-01-17T10:00Z) et appliquez-le à chaque page. Des nouveaux enregistrements peuvent arriver, mais ils ne remueront pas les pages que vous lisez.

Les règles d'arrêt et les vérifications de cohérence vous aident à savoir quand terminer et quand enquêter :

- Arrêter seulement quand l'API ne renvoie aucun item, ou qu'il n'y a plus de

next_cursor. - Suivre les IDs uniques vus et alerter si les doublons dépassent un petit seuil.

- Signaler les baisses soudaines de la taille des pages.

- Garder un total courant et le comparer au total rapporté par l'API quand il est disponible.

- Persister le curseur (ou la dernière clé de tri) après chaque page pour reprendre en toute sécurité.

Retries qui récupèrent sans empirer

Les retries aident quand le problème est temporaire. Ils aggravent la situation quand la requête est incorrecte ou que vous poussez déjà trop l'API. Faites des retries prévisibles, limités et polis.

Séparez les erreurs à retenter de celles à corriger :

- Retry : 429 (rate limited), 408 (timeout), la plupart des 5xx (erreurs serveur) et les problèmes réseau (reset de connexion, DNS)

- Ne pas retry : 400 (bad request), 401/403 (auth/permission), 404 (endpoint incorrect ou ressource manquante) et les erreurs de validation

Pour les 429, respectez les instructions du serveur. Si vous recevez Retry-After, faites une pause pendant cette durée (plus un peu d'aléa) puis reprenez. Ignorer Retry-After transforme un ralentissement en panne, ou pire, en bannissement temporaire.

Le backoff exponentiel avec jitter signifie que vous attendez de plus en plus longtemps après chaque échec et ajoutez un petit délai aléatoire afin que de nombreux workers ne retentent pas exactement au même moment.

- Règle de backoff : 1s, 2s, 4s, 8s, jusqu'à un plafond (par exemple 30 à 60s)

- Ajouter du jitter : randomiser les attentes d'environ 20% à 50%

- Période de refroidissement : après des 429 répétés, mettre le job entier en pause plus longtemps (par exemple 2 à 5 minutes)

Mettez une limite stricte sur les retries. Une règle comme 5 tentatives max par requête, ou 10 minutes max de retry total, évite les boucles infinies.

Exemple : vous extrayez 50 000 prospects et la page 37 renvoie 429 avec Retry-After: 15. Dormez 15 à 20 secondes, retentez cette même page une fois, puis continuez. Si vous encaissez trois 429 d'affilée, faites une pause courte au lieu d'inonder l'API.

Rendre les extractions redémarrables et sûres à répéter

Une extraction stable est une extraction que vous pouvez arrêter, redémarrer et relancer sans changer le résultat. C'est important quand vous touchez des limites, qu'un timeout survient, ou que vous déployez un correctif à mi-chemin.

Commencez par des écritures idempotentes. Au lieu de « insérer chaque ligne », utilisez un upsert avec une clé de déduplication claire, puis enregistrez ce qui s'est passé. Clés communes : l'ID personne du fournisseur, l'e-mail normalisé, ou un fallback comme le domaine + nom complet.

Un ensemble de règles de conflit qui reste prévisible :

- Si l'ID du fournisseur correspond, considérez-le comme le même prospect et mettez à jour les champs.

- Sinon, si l'e-mail normalisé correspond, fusionnez et conservez les champs les plus récemment mis à jour.

- Sinon, créez un nouveau prospect et taguez-le avec l'ID du job d'extraction pour la traçabilité.

- Ne jamais écraser un flag d'unsubscribe ou « do not contact » pendant les fusions.

Rendez l'extraction redémarrable avec des checkpoints. Stockez le dernier token de curseur/page confirmé et un compteur des enregistrements sauvegardés pour cette page. N'avancez le checkpoint qu'après avoir traité et commit la page entièrement, ainsi un crash rejoue au plus une page.

Les données fournisseur peuvent changer sous vos pieds : des IDs sont fusionnés, supprimés ou réutilisés. Gardez une table de mapping des « IDs fournisseur vus » vers votre ID interne. Si un ID pointe soudainement vers un e-mail différent, mettez-le en quarantaine pour examen au lieu de mettre à jour silencieusement.

Exemple : vous importez 50 000 leads chaque nuit dans votre pile outbound (ou dans une plateforme comme LeadTrain). Si le job meurt à la page 380, vous redémarrez depuis le dernier checkpoint, rejouez la page 380 en toute sécurité, et vous retrouvez avec les mêmes 50 000 enregistrements, pas 50 800 avec des doublons.

Caching et extractions incrémentales pour réduire la charge API

Le caching réduit les appels API sans changer ce que vous obtenez. Il sert surtout quand vous relancez une extraction après un échec, répétez les mêmes recherches (domaines d'entreprise, intitulés, lieux), ou enrichissez plusieurs fois les mêmes personnes. Traitez le cache comme une fonctionnalité de sécurité, pas juste un coup de vitesse.

Une approche simple : cachez par une clé stable comme l'ID prospect du fournisseur ou l'e-mail, et stockez seulement les champs que vous utilisez réellement pour l'outreach. Ensuite, sautez les appels API pour les enregistrements déjà connus sauf s'ils sont susceptibles d'avoir changé.

Bases du TTL : combien de temps faire confiance au cache

Le TTL (time to live) doit correspondre à la rapidité de changement des données source et au risque des données obsolètes. Les coordonnées changent lentement, tandis que le poste ou l'entreprise peuvent évoluer plus vite.

- Identifiants stables (ID fournisseur, e-mail, domaine entreprise) : TTL long (jours à semaines)

- Détails de profil (poste, niveau, localisation) : TTL moyen (heures à quelques jours)

- Champs statutaires (unsubscribed, bounce, do-not-contact) : TTL court (minutes à heures)

Extractions incrémentales : ne prendre que le nouveau ou le modifié

Au lieu de retravailler tout, stockez un checkpoint comme updated_at ou un token de curseur du dernier run réussi. La fois suivante, demandez seulement les enregistrements modifiés depuis ce point. Cela réduit la charge, diminue la pression sur les limites de taux et rend les relances prévisibles.

Le piège courant est la fuite de données obsolètes dans l'outreach. Protégez-vous en validant les champs critiques au moment d'envoyer (par exemple, les flags de do-not-contact) et en rafraîchissant les enregistrements avant qu'ils n'entrent dans une nouvelle campagne.

Si vous alimentez des prospects dans un système d'outbound comme LeadTrain, la sync incrémentale + des TTL courts sur les champs liés aux opt-outs aide à garder les listes fraîches tout en évitant des appels fournisseurs inutiles.

Logging qui rend les extractions auditables

Quand une extraction échoue ou semble « étrange », les logs sont la preuve de ce qui s'est passé. De bons logs répondent vite à des questions simples : qu'avons-nous demandé, qu'a renvoyé l'API, et sur quelle page les choses ont changé ?

Loggez un ensemble cohérent de champs pour chaque appel API. Gardez-les structurés (JSON est courant) pour pouvoir chercher et grouper par job.

- Timestamp (début et fin), plus latence

- Endpoint et méthode, et paramètres clés de la requête (page/curseur, filtres, tri)

- Code de statut de la réponse et en-têtes de rate-limit

- Comptes de résultat (enregistrements retournés, next cursor,

has_more) - Détails d'erreur (message, retryable ou non, numéro de tentative)

Ajoutez des IDs de corrélation pour tracer une extraction à travers des centaines ou milliers d'appels. Un pattern simple : un job_id pour toute l'extraction et un request_id par appel API. Si vous stockez aussi le dernier curseur réussi avec le job_id, vous pouvez aligner les logs avec les points de reprise.

Décidez combien de la réponse stocker. Les réponses brutes facilitent l'audit, mais elles peuvent être coûteuses et risquées. Les données de prospects peuvent inclure des informations personnelles, gardez donc la confidentialité en tête.

Un compromis pratique : stocker un résumé pour chaque appel (comptes, curseurs, hash) et ne conserver les corps bruts qu'en cas d'erreur, ou seulement pour une courte rétention. Si vous stockez des données brutes, redactez les champs sensibles et chiffrez au repos.

« Auditable » en pratique : un responsable sales ops demande pourquoi 2 000 prospects manquent sur l'extraction de mardi dernier. Avec des logs, vous pouvez montrer les paramètres de filtre exacts, la page où la limitation de taux a commencé, les retries qui ont eu lieu et le curseur final sauvegardé.

Monitoring et alertes pour une exploitation stable

Les limites de taux ne sont pas qu'un problème de code. Si vous ne surveillez pas les extractions en cours, un petit hic API peut silencieusement devenir des prospects manquants, des doublons ou un job qui ne finit jamais. Le monitoring doit répondre à une question rapidement : cette extraction est-elle saine maintenant ?

Utilisez un petit nombre de métriques compréhensibles par des équipes non techniques :

- Requêtes par minute (et à quel point vous êtes proche de la limite)

- Taux d'erreur (4xx vs 5xx)

- Taux de retry (à quelle fréquence vous reculez)

- Retard (à quel point vous êtes en retard sur le temps d'achèvement attendu)

- Progression (pages ou enregistrements extraits par minute)

Les alertes doivent viser des motifs, pas des événements isolés. Un 429 est normal. Vingt 429 d'affilée signifient que vous êtes bloqué et que vous perdez du temps. Il en va de même pour des 5xx répétés qui indiquent souvent une panne.

Déclencheurs utiles : un pic de réponses 429, des 5xx répétés pendant plusieurs minutes, et une pagination qui n'avance plus (curseur inchangé ou compte d'enregistrements qui n'augmente pas).

Les dashboards n'ont pas besoin d'être sophistiqués. Une vue simple avec statut vert/jaune/rouge, vitesse actuelle, dernier type d'erreur et temps estimé restant suffit pour qu'un manager SDR prenne une décision.

Décidez à l'avance quand mettre en pause automatiquement vs notifier une personne :

- Auto-pause en cas de 429 soutenus ou quand la progression est plate pendant une fenêtre définie

- Notifier une personne quand l'extraction est en pause ou que les erreurs persistent après cooldown

- Auto-reprise seulement quand les taux d'erreur diminuent et que la progression reprend en sécurité

Exemple : vous extrayez 50 000 prospects depuis une API fournisseur. Si les 429 passent de 1% à 40%, l'auto-pause empêche que des données partielles alimentent votre système d'outreach et réduit le risque d'importations incohérentes.

Étape par étape : exécuter une extraction de prospects stable

Une extraction stable est un runbook reproductible. Les mêmes entrées doivent produire le même résultat, même si l'API ralentit ou échoue en cours d'exécution.

Un flux basique :

- Planifier : notez la requête exacte, les champs à demander, l'ordre de tri et la fenêtre temporelle (par exemple « créés après 2026-01-01 »). Décidez votre clé unique (généralement un ID prospect).

- Dry run : extrayez 1 à 2 pages. Confirmez la forme de la réponse, les champs requis et que votre clé est toujours présente.

- Exécution complète : partez de la page 1 avec un curseur/offset sauvegardé. Stockez chaque page et enregistrez le dernier curseur réussi pour pouvoir reprendre.

- Vérifier : comparez les comptes attendus (depuis l'API, si disponible) à ce que vous avez sauvegardé. Cherchez doublons et champs manquants.

- Export/import : exportez un fichier final dédupliqué plus un petit manifeste d'exécution pour que quelqu'un puisse le relancer plus tard.

La taille des lots et la concurrence doivent venir des signaux, pas de suppositions. Commencez avec une page de 50 à 100 et un worker. Si vous ne voyez pas de réponses de rate-limit et que la latence reste stable, augmentez à 2 à 4 workers. Arrêtez d'augmenter quand les 429 deviennent fréquents ou que le temps de réponse moyen augmente.

Pour la validation, faites un examen d'échantillon rapide (20 à 50 enregistrements) puis des totaux simples : lignes totales, IDs prospect uniques, pourcentage sans e-mail/nom/entreprise, et si une page a été sauvegardée deux fois.

Documentez chaque extraction en texte clair : qui l'a lancée, quand, quel compte API a été utilisé, paramètres exacts, taille de page, concurrence et le hash final ou le nombre de lignes en sortie.

Exemple : une extraction volumineuse réaliste et cohérente

Vous devez extraire 50 000 prospects d'un fournisseur en environ 2 heures pour que votre équipe outbound commence demain. Vous fixez une taille de page à 500, soit environ 100 pages. Le fournisseur impose une limite de taux, donc vous cadencer les requêtes et prévoyez de rares 429 et quelques 5xx aléatoires.

L'extraction se déroule ainsi : demandez la page 1, stockez le curseur retourné (ou le token de page suivant) et écrivez un checkpoint « last_cursor=abc, pulled=500 ». Puis passez à la page suivante. Si une requête échoue, ne passez pas à la suite. Retentez le même curseur avec un backoff exponentiel (par exemple 2s, 4s, 8s), ajoutez du jitter et plafonnez les retries pour ne pas bombarder l'API.

À mi-parcours, la page 37 renvoie un 429. Votre log d'audit pour ce moment est simple et précis :

{"run_id":"2026-01-17T10:00Z","cursor":"p37","status":"retry","error":"429","backoff_seconds":8,"attempt":3}

Après backoff, la page 37 réussit. Le checkpoint n'est mis à jour qu'après que cette page soit écrite complètement dans le stockage.

Plus tard, quelqu'un relance la même extraction car il soupçonne un bug. Le rerun lit le dernier checkpoint, reprend à la page 38 et utilise des écritures idempotentes (par exemple, clé prospect_id + source). La liste finale correspond entre les runs : pas de prospects manquants, pas de doublons, et une trace claire montrant où les retries ont eu lieu.

Erreurs courantes et pièges à éviter

La plupart des échecs liés aux limites sont auto-infligés. La solution est rarement du code malin. C'est éviter quelques pièges prévisibles.

Une erreur est de traiter chaque erreur comme retryable. Retenter des requêtes mal formées (mauvaises parameters, auth invalide, permissions manquantes) peut inonder l'API et vous faire paraître abusif. Les retries doivent cibler les problèmes temporaires comme les 429 et beaucoup de 5xx, et s'arrêter rapidement quand l'erreur est clairement permanente.

Un autre piège est une concurrence excessive. Même avec backoff exponentiel, lancer 50 requêtes parallèles peut vous maintenir au-dessus de la limite pour toujours. Vous voulez un rythme régulier, pas des rafales. Un limiteur partagé (une file unique pour tous les workers) bat souvent un backoff indépendant par thread.

La pagination est aussi l'endroit où se cachent des problèmes de données silencieux. La pagination par offset sur un jeu de données changeant peut sauter ou dupliquer des prospects sans erreur. Préférez un ordre stable + pagination par curseur, ou utilisez un filtre snapshot (par exemple, ne tirer que les enregistrements créés avant un timestamp fixé).

Enfin, beaucoup d'extractions ne sont pas redémarrables. Un petit échec à 80% force un rerun complet, ce qui augmente la charge et accroît le risque de doublons.

Signaux d'alerte à surveiller :

- Retenter des erreurs 400/401/403 au lieu d'échouer vite

- Parallélisme illimité qui ignore les limites globales

- Pagination par offset sans clé de tri stable

- Absence de checkpoints (dernier curseur, dernier ID ou dernier timestamp)

- Absence de règles d'idempotence pour l'écriture des résultats

Exemple : si vous extrayez des prospects depuis Apollo et que le job plante, un curseur sauvegardé + une règle « IDs vus » vous permet de reprendre proprement. Sans cela, vous relancez tout, importez les contacts en double et déclenchez plus de limites.

Checklist rapide avant votre prochaine extraction API

Cinq vérifications qui évitent la plupart des échecs

Avant de lancer, confirmez :

- Les limites sont notées : requêtes par minute, plafonds journaliers, règles de rafale et endpoints qui comptent le plus.

- La pagination est déterministe : une méthode (le curseur est préférable), tri stable, fenêtre de filtre fixe.

- Les règles de retry sont sûres : backoff exponentiel activé, nombre max de retries défini, et règle pause/reprise pour 429 soutenus et 5xx temporaires.

- L'extraction est redémarrable : un checkpoint est stocké (curseur ou dernier timestamp/ID vu) et vous dédupliquez par une clé unique prospect.

- Les logs sont exploitables : run ID, fenêtre temporelle, comptes de requêtes, valeurs de page/curseur, et un résumé simple de fin d'exécution.

Un test rapide de répétabilité

Faites une petite extraction (par exemple 200 prospects) et relancez-la avec les mêmes paramètres. Le total doit correspondre, aucun doublon ne doit apparaître, et toute différence doit être explicable (par ex. nouveaux prospects créés hors de la fenêtre fixe).

Si vous poussez des prospects vers un outil d'envoi, vérifiez aussi le comportement d'écriture : lorsqu'un même prospect réapparaît, mettez à jour l'enregistrement existant plutôt que d'en créer un nouveau.

Étapes suivantes : des extractions stables à une exécution outbound cohérente

Une extraction stable n'a d'importance que si elle devient un workflow contrôlé. La question finale est toujours la même : comment passer d'une liste vérifiée à un outreach sans altérer les données, nuire à la délivrabilité ou perdre la trace des actions ?

Gelez la liste que vous comptez contacter. Sauvegardez le timestamp d'extraction, les filtres utilisés et le compte final d'enregistrements. Si vous devez enrichir ou dédupliquer, faites-le une fois, enregistrez les règles et produisez une version propre prête à l'envoi. Cela devient la source de vérité pour la campagne.

La délivrabilité est la porte suivante. Même une liste parfaite peut échouer si la configuration d'envoi est fragile. Utilisez des domaines authentifiés (SPF/DKIM/DMARC), évitez d'envoyer depuis des domaines tout neufs à pleine vitesse, et warm-up les boîtes avant de monter en charge.

Un transfert pratique de « données prêtes » à « outreach en cours » :

- Assignez un propriétaire pour l'extraction et un propriétaire pour la campagne (peut être la même personne).

- Stockez un bref runbook : où se trouve la liste, comment elle a été extraite et comment la relancer en sécurité.

- Importez uniquement le fichier gelé prêt à l'envoi dans votre outil d'outreach.

- Commencez par un petit lot, puis montez progressivement le volume selon la santé des réponses et des bounces.

- Suivez les résultats en les reliant à l'extraction : bounces, désabonnements et taux de réponse par segment.

Si vous voulez moins d'outils, des plateformes comme LeadTrain regroupent les pièces communes de l'outbound (domaines, boîtes mail, warm-up, séquences multi-étapes et classification des réponses) pour que la transition de la construction de liste à l'envoi reste cohérente. Le point principal reste le même : répétez les mêmes règles d'extraction, les mêmes validations et les mêmes étapes de lancement, avec un propriétaire clair qui peut relancer le processus sans deviner.

FAQ

Why do prospect pulls fail so often when rate limits kick in?

La limitation de débit casse généralement les extractions de façons qui ne ressemblent pas à des erreurs nettes : le job s'arrête au milieu d'une page, relance la même page sans dé-duplication, ou termine silencieusement après avoir ignoré des erreurs. Le résultat : enregistrements manquants, doublons, enrichissements partiels et crédits API gaspillés.

What’s the difference between rate limits, quotas, and concurrency limits?

Une rate limit définit la vitesse à laquelle vous pouvez faire des requêtes, un quota définit le volume total sur une fenêtre plus longue, et une limite de concurrence définit combien de requêtes peuvent être en vol en même temps. Vous pouvez rester sous votre quota journalier mais échouer si vous générez des pics de concurrence et écrasez les limites par minute ou les règles de rafale.

How do I know I’m hitting the API limit versus a normal outage?

Commencez par logger les codes d'état et tous les en-têtes de limitation à chaque appel, en particulier Retry-After et les signaux remaining/reset. Faites une petite extraction de test pour observer le comportement réel du fournisseur sous charge, car la documentation et l'application des limites en rafales diffèrent souvent.

How do I paginate without skipping or duplicating prospects?

Préférez la pagination par curseur quand l'API la supporte et demandez toujours un tri stable pour que l'ordre ne change pas entre les appels. Si le jeu de données peut changer pendant l'extraction, utilisez un timestamp de coupure fixe pour que les nouveaux enregistrements n'altèrent pas la pagination et n'entraînent pas d'omissions ou de doublons.

What’s a safe retry strategy for 429 errors and timeouts?

Retryez seulement les échecs clairement temporaires comme les 429, les timeouts et la plupart des 5xx, et arrêtez de réessayer les erreurs permanentes comme les 400 ou les problèmes d'authentification. À la réception d'un 429, respectez Retry-After, ajoutez un peu d'aléa et plafonnez le temps total de retry pour éviter de tourner en boucle.

How can I rerun a failed pull without creating duplicates?

Rendez vos écritures idempotentes en faisant des upserts sur une clé stable comme l'ID prospect du fournisseur, et conservez des règles de fusion constantes pour que les reruns n'altèrent pas les résultats. Sauvegardez un checkpoint après chaque page complètement traitée pour qu'un crash ne rejoue au plus qu'une seule page et n'engendre pas de doublons.

When should I use caching and incremental pulls instead of re-pulling everything?

Utilisez le cache pour les recherches répétées et pour les enrichissements que vous n'avez pas besoin d'actualiser à chaque exécution, et appliquez un TTL adapté à la vitesse de changement des champs. Pour les synchronisations continues, préférez des extractions incrémentales basées sur updated_at ou un curseur stocké pour réduire la charge et limiter les risques de triggering des limites.

What should I log to make a prospect pull auditable?

Au minimum, capturez l'ID du job, les paramètres de la requête, le curseur ou token de page, le nombre retourné, la latence, les codes d'état et les en-têtes de limitation. Cela permet de montrer ce qui s'est passé précisément sur la page où le comportement a changé et de prouver si des données manquaient côté source, côté extraction ou lors de l'écriture.

What metrics and alerts actually catch pull problems early?

Surveillez le taux d'avancement, le taux d'erreur ventilé 4xx/5xx et la fréquence des backoffs, car ils indiquent si vous progressez ou si vous êtes bloqué. Alertez sur des motifs : 429 soutenus, erreurs 5xx répétées pendant plusieurs minutes, ou un curseur qui n'avance plus — ce sont des signaux qui produisent des listes partielles.

How does this affect my outreach workflow once prospects are imported into LeadTrain?

Une cadence stable et à faible concurrence évite souvent les pics, surtout lorsque les retries s'accumulent. Si vous poussez des prospects vers un flux d'envoi comme LeadTrain, des extractions stables évitent les doublons qui entraînent des messages multiples et des rapports confus, et préviennent les trous qui désynchronisent les séquences et relances.