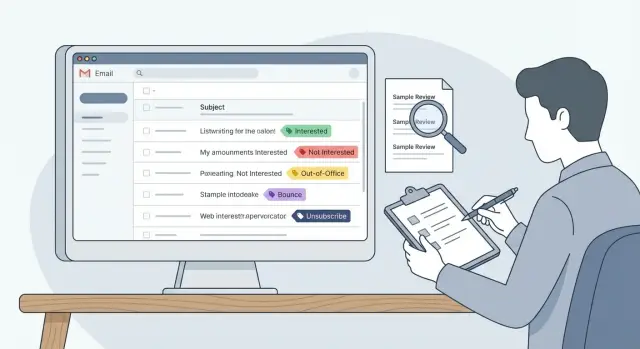

Étiquetage des réponses IA avec revue humaine pour un reporting fiable

L'étiquetage des réponses avec une boucle humaine maintient la précision du reporting cold email. Utilisez échantillonnage, files de revue, une taxonomie claire et retours pour réduire les erreurs.

Pourquoi l'étiquetage des réponses a besoin d'une vérification humaine

L'étiquetage des réponses consiste à classer les réponses reçues en compartiments pour pouvoir rendre compte de ce qui s'est passé. Dans le cold email, ces compartiments sont généralement : Intéressé, Pas intéressé, Absent, Échec de livraison et Désinscription. Les étiquettes paraissent simples. Les réponses réelles ne le sont pas.

L'IA est excellente pour lire chaque message et le catégoriser rapidement. Le problème, c'est que les réponses les plus difficiles à étiqueter sont souvent les plus importantes. Une légère étape de relecture humaine n'est pas un manque de confiance. C'est la manière de garder les décisions et les rapports ancrés dans la réalité.

Les erreurs d'étiquetage arrivent pour des raisons prévisibles :

- Les réponses courtes comme « non » ou « peut‑être » manquent presque totalement de contexte.

- L'intention mixte est fréquente : « Pas maintenant, retentez le trimestre prochain » n'est pas un refus clair.

- Les gens utilisent le sarcasme (« Bien sûr, j'adore le spam ») ou posent une question tout en disant non.

- Les fils deviennent confus : réponses transférées, réponses automatiques qui ressemblent à des messages humains, ou un collègue qui répond à la place d'un autre.

De mauvaises étiquettes ne rendent pas juste un tableau de bord légèrement faux. Elles changent les priorités :

- Si Intéressé est sur‑étiqueté, la conversion paraît excellente et vous déployez une campagne faible.

- Si Pas intéressé est sur‑étiqueté, vous arrêtez des relances qui auraient pu déboucher sur des réunions.

- Si les Échecs de livraison sont sous‑étiquetés, vous continuez d'envoyer depuis des boîtes qui se dégradent.

- Si les Désinscriptions sont mal lues, vous risquez des problèmes de conformité et vous perdez la confiance.

La relecture humaine est la plus utile quand le système a le plus de chances de se tromper. Ajoutez une boucle de revue quand vous :

- lancez une nouvelle campagne ou changez l'offre

- entrez sur un nouveau marché avec des schémas de langage différents

- changez le ton de votre copy (plus décontracté, plus direct, plus d'humour)

- commencez à utiliser de nouvelles sources de données ou règles de ciblage

- remarquez des changements de métriques qui ne correspondent pas à ce que l'équipe voit dans la boîte de réception

Exemple : après être passé à un premier email plus court et percutant, une équipe commence à recevoir plus de réponses en une ligne comme « envoyez les détails ». Si celles‑ci sont étiquetées Intéressé plutôt que Besoin d'infos, l'équipe célèbre une hausse factice. Un rapide passage d'échantillonnage humain le détecte tôt, met à jour les définitions et maintient l'honnêteté des rapports, que vous étiquetiez manuellement ou que vous utilisiez une plateforme comme LeadTrain qui classe automatiquement les réponses.

Fixez des objectifs et une responsabilité avant de changer le workflow

« Assez précis » signifie des choses différentes pour des équipes différentes. Avant d'ajouter des revues, mettez‑vous d'accord sur ce qu'est une bonne précision en chiffres simples. Par exemple : « Sur un échantillon hebdomadaire, les erreurs d'étiquetage sur les catégories principales restent sous 3 % et nous pouvons expliquer une dérive en un jour ouvré. » Cela vous donne un objectif d'erreur et un délai de réaction.

Décidez aussi de ce qui compte le plus. Vous n'avez généralement pas besoin de la perfection sur chaque cas limite. Concentrez‑vous sur les étiquettes qui pilotent les décisions. Si vos tableaux contrôlent les relances et les prévisions, vous tenez surtout à ce que Intéressé soit vraiment intéressé, et que les Échecs de livraison et Désinscriptions soient bien comptés.

Gardez la portée simple :

- Étiquettes principales (doivent être correctes) : Intéressé, Pas intéressé, Échec de livraison, Désinscription

- Étiquettes optionnelles (bien à avoir) : Absent, Mauvaise personne, Renvoi, Revenir plus tard

- À revoir : tout ce qui est confus ou à intention mixte

- Une règle pour « Autre » : ce que cela inclut et quand c'est autorisé

La responsabilité est l'étape décisive. Si personne ne possède les règles, chaque réviseur invente silencieusement ses propres standards et vos métriques tanguent. Choisissez un propriétaire qui peut décider des changements et les documenter (souvent RevOps, un responsable SDR ou un manager commercial). Les réviseurs peuvent proposer des mises à jour, mais le propriétaire publie la décision finale pour que les rapports restent cohérents.

Définissez une cadence adaptée à votre volume et à votre risque. Une vérification quotidienne attrape des pannes soudaines (comme un nouveau template qui déclenche plus d'autoresponders). Un audit hebdomadaire repère une dérive plus lente.

Une cadence que beaucoup d'équipes peuvent tenir :

- Quotidien : vérification express de 10 minutes des nouvelles étiquettes Intéressé et Désinscription

- Hebdomadaire : revue plus approfondie d'un échantillon plus large plus tous les items À revoir

- Après changements : revue renforcée pendant 2–3 jours après une nouvelle séquence, une source de listes ou la configuration d'un domaine

Si vous utilisez un classifieur IA (y compris des outils comme LeadTrain), l'objectif reste le même : vous ne révisez pas tout. Vous possédez la définition de « correct » et vous la vérifiez assez souvent pour que le tableau de bord reste crédible.

Construisez une taxonomie d'étiquettes que l'on puisse appliquer de manière cohérente

Un processus de revue échoue si les gens ne sont pas d'accord sur la signification de chaque étiquette. L'objectif est un petit jeu d'étiquettes stable dans le temps, afin que les rapports ne bougent pas à chaque nouveau cas limite.

Commencez par un cœur resserré qui couvre la plupart des réponses. Gardez les étiquettes mutuellement exclusives quand c'est possible, et rédigez une définition en une phrase qu'un nouveau collègue pourrait suivre.

- Intéressé : La personne demande une réunion, un tarif, un calendrier ou une étape suivante claire.

- Pas intéressé : La personne décline maintenant et ne propose pas d'alternatives.

- Absent : Message d'absence automatisé avec date de retour ou indication claire « je suis absent ».

- Échec de livraison : Échec de distribution ou boîte inexistante (texte généré par le système indiquant l'échec).

- Désinscription : Toute demande d'arrêt des emails, y compris « remove me » ou « ne me contactez pas ».

L'étiquette qui fait généralement le plus de dégâts est Intéressé. Définissez‑la étroitement pour que le taux de réunions et le reporting du pipeline restent honnêtes. « Ça a l'air intéressant » n'est pas suffisant en soi. Une règle simple : s'il n'y a pas d'étape suivante claire, basculez vers À revoir au lieu de forcer un gain ou une perte.

Gardez une étiquette tampon, comme À revoir (ou Autre) pour les réponses qui ne rentrent pas proprement dans une case. Cela protège la taxonomie pendant que vous apprenez et vous donne une file ciblée à auditer quand les réponses évoluent.

Les réponses à intention multiple sont fréquentes, donc décidez des règles de départage à l'avance et appliquez‑les :

- Si une réponse inclut Désinscription, étiquetez‑la Désinscription quoi qu'il arrive.

- Si c'est Absent mais qu'il y a une vraie question, étiquetez Absent et marquez pour relance plus tard.

- Si c'est une recommandation (« Email Alex ») plus un « ce n'est pas moi », étiquetez Pas intéressé (et suivez la recommandation séparément si vous le traquez).

Si vous devez ajouter une nouvelle étiquette, faites‑le délibérément et reconstituez un petit échantillon historique pour que les tendances restent comparables.

Choisissez une méthode d'échantillonnage qui attrape les erreurs les plus nuisibles

Un petit échantillon aléatoire révèle si tout va globalement bien, mais il peut manquer les erreurs qui faussent les décisions. Échantillonnez de façon à trouver les erreurs à fort coût : les mauvaises étiquettes qui changent vos décomptes d'Intéressé, d'Échec de livraison et de Désinscription.

Un dispositif pratique mélange généralement trois types d'échantillonnage, plus des déclencheurs qui forcent une revue supplémentaire quand quelque chose change.

Options d'échantillonnage (et ce pour quoi elles sont utiles)

L'échantillonnage aléatoire vous donne une base et attrape les cas limites bizarres au fil du temps.

L'échantillonnage ciblé évite de compter sur la chance pour attraper des étiquettes rares mais importantes :

- Échantillon aléatoire à travers toutes les réponses pour estimer la justesse globale

- Échantillon stratifié par étiquette (surtout Intéressé, Désinscription, Échec de livraison)

- Échantillon basé sur le risque pour les réponses faciles à mal lire (messages très courts, argot, langues mélangées, sarcasme)

- Échantillon déclenché par un changement après une modification de workflow (nouveau domaine, nouvelle offre, nouvelle séquence, nouveau template)

- Échantillon de désaccord quand le modèle semble incertain ou inverse souvent les catégories (si votre outil expose cette information)

Si vous utilisez une plateforme comme LeadTrain qui classe automatiquement les réponses, les échantillons stratifiés et basés sur le risque sont généralement là où vous trouvez les problèmes qui faussent discrètement votre tableau de bord.

Définissez une taille d'échantillon hebdomadaire que votre équipe fera vraiment

La meilleure taille d'échantillon est celle qui est réellement faite chaque semaine. Commencez petit, faites‑en une routine, puis augmentez.

- Choisissez une contrainte de temps fixe (par exemple 30 à 60 minutes par semaine)

- Visez 30 à 100 revues par réviseur et par semaine, selon le volume

- Assurez‑vous que chaque étiquette clé obtienne un compte minimum (par exemple au moins 10 Intéressé et 10 Désinscription quand c'est possible)

- Augmentez l'échantillonnage pour les nouvelles campagnes pendant les 1–2 premières semaines

Une règle simple : si les réponses Intéressé sont rares, l'échantillonnage aléatoire les manquera. Mettez‑les volontairement dans la file de revue.

Un workflow étape par étape pour l'échantillonnage et la revue

Un bon workflow rend les erreurs visibles sans transformer votre équipe en police des étiquettes à plein temps. L'objectif est simple : détecter les mauvaises étiquettes tôt, corriger la règle qui a causé l'erreur et garder les rapports honnêtes.

Le workflow

Créez une petite file de revue régulière. Puisez‑y votre échantillon quotidien et incluez tout ce qui est risqué (nouveau copy, pics inhabituels, réponses incertaines).

Une boucle que la plupart des équipes peuvent gérer en 15 à 30 minutes par jour :

- Construisez la file de revue à partir de votre échantillon et de tous les items À revoir.

- Appliquez les définitions écrites, pas des opinions personnelles.

- Enregistrez l'étiquette corrigée et ajoutez une note d'une phrase expliquant la raison.

- Quand les réviseurs ne sont pas d'accord, décidez vite et mettez la règle à jour en langage clair.

- Injectez les corrections dans les règles de reporting et tout processus d'entraînement que vous maintenez.

Après le passage, cherchez des motifs : Intéressé est‑il confondu avec Pas intéressé ? Les messages d'absence sont‑ils classés en Pas intéressé ? Ces erreurs changent discrètement les taux de conversion.

Suivez ce qui s'améliore (et ce qui ne s'améliore pas)

Vous n'avez besoin que de quelques chiffres :

- Taux d'erreur global dans l'échantillon

- Taux d'erreur par étiquette (surtout Intéressé et Désinscription)

- Principales paires de confusion (comme Intéressé vs Pas intéressé)

- Délai de résolution des désaccords

- Volume quotidien d'items À revoir

Exemple : vous changez des objets et voyez un pic d'Intéressé. La file de revue montre que beaucoup sont en réalité des autoresponders d'absence déclenchés par un nouveau mot‑clé. Vous mettez à jour la règle, corrigez l'échantillon et votre tableau de bord cesse de raconter une fausse histoire.

Rendre les revues cohérentes entre les personnes

Les gens liront la même réponse et ne seront pas d'accord, surtout pour des emails courts ou vagues. L'objectif n'est pas l'accord parfait, mais des décisions prévisibles pour que les rapports restent stables d'une semaine à l'autre.

Commencez par des vérifications à deux personnes sur un petit sous‑ensemble. Choisissez 20–50 réponses par semaine (ou par campagne) et faites les étiqueter indépendamment par deux réviseurs. Comparez les résultats. Quand il y a désaccord, discutez brièvement et notez la règle qui manque.

Utilisez une petite grille pour laisser une trace :

- Étiquette

- Confiance (élevée ou faible)

- Phrase déclencheuse (les mots exacts qui ont motivé le choix)

- Note d'une phrase pour les cas limites

Un petit « ensemble d'or » maintient la calibration des réviseurs. C'est un dossier d'exemples connus avec l'étiquette attendue que les nouveaux réviseurs évaluent avant d'accéder aux données en direct. Actualisez‑le quand les campagnes ou offres changent.

Une approche de calibration pratique :

- Gardez 25–40 exemples couvrant les étiquettes courantes

- Incluez au moins 5 cas délicats (non poli, renvoi, vague peut‑être)

- Mettez d'accord l'étiquette attendue et une raison en une ligne

- Re‑testez les nouveaux réviseurs et ceux sous l'objectif d'accord

Enfin, enregistrez les cas limites dans une note partagée, rédigée comme des règles. Avec le temps, cela devient votre playbook et facilite la ré‑formation ou l'ajustement des catégories.

Erreurs communes qui faussent discrètement vos métriques

La plupart des problèmes de reporting ne viennent pas d'une grosse panne. Ils proviennent d'habitudes d'étiquetage mineures qui plient lentement vos chiffres jusqu'à ce que le tableau de bord paraisse sûr alors qu'il est faux.

Les mauvaises étiquettes qui font le plus de dégâts

Ces erreurs pèsent bien plus que leur nombre :

- Mélanger le sentiment et l'intention. « Merci, ce n'est pas une priorité maintenant » peut sembler chaleureux, mais c'est un non. Si c'est étiqueté Intéressé, votre taux positif est gonflé.

- Traiter les renvois comme des rejets. « Parlez à Sarah des opérations » n'est pas un « pas intéressé ». Si vous le suivez, étiquetez‑le séparément pour mesurer la fréquence des transferts.

- Mettre tout dans Autre. Autre est utile pour des cas rares, mais quand il devient fréquent, il cache des motifs (réclamation sur le prix, mauvais timing, verrouillage chez un concurrent) qui devraient orienter votre prochaine campagne.

- Changer les définitions en plein trimestre sans note. Si Intéressé voulait dire « a posé une question » le mois dernier et « a booké une réunion » ce mois‑ci, vos séries temporelles deviennent fictives.

- Ignorer les bounces et désinscriptions parce que c'est opérationnel. Ils font partie de la délivrabilité et de la santé des listes. S'ils manquent ou sont mal étiquetés, vous surestimez votre portée et sous‑estimez le risque.

Un garde‑fou simple : dès que les réviseurs voient le même cas « Autre » 10 à 20 fois, promouvez‑le en catégorie réelle et documentez‑le.

Vérifications rapides avant de faire confiance au tableau de bord

Les tableaux de bord paraissent précis, mais les étiquettes dérivent petit à petit. Avant d'agir sur un pic d'Intéressé ou une baisse de Pas intéressé, faites quelques vérifs qui prennent des minutes.

1) Cherchez des pics d'étiquettes après des changements

Une étiquette qui bondit juste après le lancement d'une nouvelle séquence, un changement de copy ou d'audience est un signal d'alarme. Les performances réelles changent, mais les décalages d'étiquetage sont tout aussi fréquents.

Comparez le jour avant et le jour après. Si une seule étiquette a bougé (par exemple, les Absent doublent alors que le total des réponses reste stable), vous avez probablement un problème d'étiquetage.

2) Spot‑check Intéressé et Pas intéressé

Lisez 10–20 réponses récentes étiquetées Intéressé. Cherchez les faux positifs comme :

- remerciements polis (« Merci »)

- reports de calendrier (« Trimestre prochain »)

- renvois (« Parlez à mon collègue »)

- demandes vagues (« Envoyez des infos ») sans étape suivante

Ensuite, parcourez 10–20 réponses Pas intéressé et posez‑vous une question pratique : certaines de ces personnes ont‑elles ensuite réservé après un suivi raisonnable ? Si oui, votre définition de Pas intéressé est peut‑être trop large, ou l'équipe traite cela comme un arrêt définitif alors que ce n'est pas le cas.

3) Assurez‑vous que les bounces et désinscriptions ne se cachent pas dans Absent

Les Échecs de livraison et Désinscriptions sont des signaux opérationnels, pas des signaux de conversation. S'ils sont mal classés en Absent, le reporting paraît plus sain qu'il ne l'est.

Parcourez un petit lot de réponses Absent et repérez des mots‑indices comme « undeliverable », « delivery failed », « blocked », « unsubscribe » ou « remove me ».

4) Revoyez les réponses très courtes

Les réponses d'une à trois mots sont la source la plus fréquente d'erreurs silencieuses : « No. », « Maybe. », « Who? », « Ok. », « Stop. » Elles dépendent du contexte.

Prenez 15 réponses courtes réparties sur vos principales étiquettes et confirmez qu'elles correspondent à l'intention. Si vous voyez de la confusion, ajoutez une règle simple (par exemple : « Ok » n'est pas Intéressé sauf si c'est une acceptation d'un horaire proposé).

Exemple : corriger des mauvaises étiquettes après un changement de campagne

Une petite équipe SDR lance une nouvelle séquence en 3 étapes. Le copy est plus direct, la proposition est une courte prise de contact. Deux jours plus tard, le tableau de bord affiche une grosse hausse d'Intéressé. Tout le monde est content jusqu'à ce que le nombre de réunions reste plat.

Ils font une vérification simple : échantillonner les réponses récentes étiquetées Intéressé et les lire dans le contexte du fil. Le motif est clair. Beaucoup de réponses ne traduisent pas une intention d'achat réelle. Ce sont des « envoyez les infos » du type « Oui, envoyez les détails » ou « Envoyez-moi une présentation ». D'autres sont des polies mises à distance comme « Pas le bon moment, mais tenez‑moi informé ».

Le modèle ne s'est pas subitement dégradé. Le changement de campagne a produit plus de réponses ambiguës et la définition de Intéressé était trop lâche. Ils resserrent la taxonomie et rédigent des règles exploitables.

Leurs définitions mises à jour :

- Intéressé exige une intention de réunion ou une étape suivante claire (prendre rendez‑vous, proposer des créneaux, demander une proposition, confirmer l'adéquation).

- « Envoyez les infos » reste hors Intéressé sauf si la réponse inclut une étape suivante (par exemple « Envoyez les détails et je bloque un créneau cette semaine »).

- « Peut‑être plus tard » couvre les reports temporels (trimestre prochain, après un lancement, de nouveau dans quelques mois).

- Pas intéressé est un non clair, incluant « stop » et « remove me ».

Ils ajoutent aussi une règle de traitement : « Peut‑être plus tard » est suivi séparément pour ne pas gonfler l'intention de réunion. L'action de suivi reste cohérente : noter la raison, programmer un rappel et éviter d'insister pour une réunion dans le même fil.

Pendant les deux semaines suivantes, ils gardent une boucle de revue légère. Chaque jour, ils échantillonnent quelques réponses Intéressé et Peut‑être plus tard pour confirmer la justesse des étiquettes. Si ils utilisent un outil comme LeadTrain, cela s'accorde bien avec la classification IA des réponses car les réviseurs peuvent se concentrer sur les quelques catégories qui pilotent les décisions.

À la fin de la deuxième semaine, le taux d'erreur sur Intéressé chute et le reporting du taux de réunions cesse de varier à chaque petit changement de copy.

Prochaines étapes : commencez petit et maintenez la boucle

Faites un pilote que vous pouvez finir. Choisissez une campagne active et exécutez la boucle de revue pendant une semaine. C'est assez long pour repérer des motifs (nouvelles objections, plus d'autoresponders d'absence) sans en faire un travail à plein temps.

Gardez la mise en place limitée dans le temps. En 15 minutes, vous pouvez aligner les réviseurs en rédigeant des définitions en langage clair et en passant 5–10 exemples réels de votre boîte. Si quelqu'un ne peut pas étiqueter une réponse avec confiance après avoir lu une définition une fois, la définition doit être améliorée.

Un plan de démarrage gérable :

- Utilisez l'étiquette IA comme valeur par défaut, puis révisez un petit échantillon hebdomadaire (par exemple 30–50 réponses).

- Priorisez les catégories à fort impact : Intéressé, Désinscription, Échec de livraison, Pas intéressé.

- Marquez tout ce qui est flou plutôt que de forcer une étiquette, et rassemblez ces cas pour une mise à jour rapide des définitions.

- Enregistrez seulement deux choses pour les corrections : l'étiquette d'origine et l'étiquette corrigée.

- Arrêtez au bout de 30 minutes et planifiez la session suivante plutôt que d'essayer de résorber le retard.

Si vous utilisez LeadTrain (leadtrain.app), une bonne approche est de traiter sa classification IA comme base et de garder cette boucle de revue légère par‑dessus. Vous conservez la vitesse tout en gardant vos catégories alignées sur la façon dont votre équipe vend aujourd'hui.

Pour maintenir la boucle en bonne santé, ajoutez un court point mensuel :

- Mettez à jour les définitions en fonction des réponses les plus souvent floues.

- Passez en revue les principales confusions d'étiquettes.

- Décidez si votre taille d'échantillon doit augmenter, diminuer ou rester la même.

- Partagez un enseignement avec l'équipe pour que tout le monde étiquette avec la même intention.

Petites revues, petites corrections et des métriques fiables semaine après semaine.

FAQ

Dois‑je vraiment avoir des humains qui vérifient les réponses étiquetées par l'IA ?

Commencez par l'IA comme défaut, puis ajoutez une petite étape d'échantillonnage humain qui se concentre sur les étiquettes à fort impact comme Intéressé, Désinscription et Échec de livraison. L'objectif est d'attraper les erreurs qui changent les décisions, pas de tout relabeler manuellement.

Pourquoi l'IA se trompe‑t‑elle si souvent sur les réponses cold email ?

Parce que les réponses les plus utiles sont souvent les plus ambiguës. Les réponses d'une seule ligne, le sarcasme, l'intention mixte et les fils confus sont faciles à mal lire, et de petites erreurs sur Intéressé ou Désinscription peuvent fausser vos rapports et priorités de suivi.

Quelle est la définition la plus sûre de « Intéressé » ?

Restez strict : Intéressé doit signifier que la personne demande une réunion, un tarif, un calendrier ou une action claire suivante. S'il n'y a pas d'étape suivante claire, traitez‑la comme À revoir ou une catégorie séparée comme Besoin d'infos, afin que vos mesures d'intention de réunion restent honnêtes.

Comment étiqueter les réponses à intention mixte (par exemple “Not now, try next quarter”) ?

Utilisez une règle de départ simple et écrivez‑la. Un défaut pratique : si la réponse contient « stop », « remove me » ou équivalent, étiquetez‑la Désinscription quoi qu'il arrive.

Quelles étiquettes faut‑il absolument bien faire ?

Priorisez les catégories qui affectent la délivrabilité et la conformité, et celles que vos tableaux de bord utilisent pour agir. La plupart des équipes doivent considérer Intéressé, Pas intéressé, Échec de livraison et Désinscription comme « doivent être correctes », et garder le reste en option ou À revoir.

Quelle taille devrait avoir notre échantillon hebdomadaire de revue ?

Une boîte de temps hebdomadaire simple fonctionne bien : relisez 30–50 réponses, et assurez‑vous d'observer un nombre minimum pour les étiquettes clés (par exemple, au moins 10 Intéressé et 10 Désinscription si vous en avez). Si Intéressé est rare, échantillonnez‑le délibérément au lieu d'espérer le tomber au hasard.

Quelle est la meilleure méthode pour échantillonner les réponses afin d'attraper les erreurs coûteuses ?

Mélangez l'échantillonnage aléatoire et l'échantillonnage ciblé. L'aléatoire donne une base, tandis que le ciblé se concentre sur les zones à risque comme les replies très courtes, les pics d'une catégorie après un changement de copy, et tout ce qui est étiqueté Intéressé, Désinscription ou Échec de livraison.

Qui doit être responsable des règles d'étiquetage et des changements ?

Désignez un propriétaire (souvent RevOps, un responsable SDR ou un manager des ventes) qui publie les définitions finales et les règles de départage. Les réviseurs peuvent proposer des changements, mais une seule personne doit décider et documenter les mises à jour pour éviter que les métriques ne tanguent semaine après semaine.

Comment savoir si mon tableau de bord est faussé par des mauvaises étiquettes ?

Faites des vérifications rapides : lisez 10–20 réponses récentes étiquetées Intéressé et confirmez qu'il y a bien une prochaine étape réelle, et scannez les Absent pour y déceler des bounces ou demandes de désinscription cachées. Si une étiquette explose juste après un changement de campagne, partez du principe qu'il s'agit d'un décalage d'étiquetage jusqu'à preuve du contraire.

Peut‑on utiliser LeadTrain tout en faisant de la revue humaine ?

Oui. La classification de réponses par IA de LeadTrain peut servir de base, et une boucle légère de revue humaine aide à maintenir les catégories alignées sur la façon dont votre équipe vend aujourd'hui. Vous conservez la vitesse tout en réduisant les faux « succès », les suivis manqués et les erreurs de conformité liées aux désinscriptions mal lues.