Pruebas A/B de ofertas: un plan claro más allá de las líneas de asunto

Aprende un plan práctico para probar A/B ofertas: controla variables, elige tamaños de muestra honestos y lee los resultados sin sacar conclusiones ruidosas.

Por qué las pruebas A/B de ofertas suelen dar resultados confusos

Las pruebas de oferta en outreach frío suelen parecer aleatorias porque la bandeja de entrada es un lugar desordenado. No estás probando en un laboratorio. Estás probando contra personas ocupadas, prioridades cambiantes, filtros de spam y listas de leads que nunca son perfectamente iguales.

Una razón común por la que los resultados confunden: la gente dice que prueba la oferta, pero en privado también cambia el copy. Si una versión es más corta, más clara, más segura o tiene un llamado a la acción más fuerte, ya no aprendes sobre la oferta. Estás aprendiendo sobre redacción.

Aunque intentes aislarla, la oferta está ligada al contexto. Un “auditoría gratuita” puede parecer valiosa para un segmento y trabajo extra para otro. Si tus dos variantes terminan alcanzando distintos cargos, tamaños de empresa o industrias, los resultados se mueven y culpas a la oferta.

La mayoría de los “ganadores dramáticos” son solo ruido que aparece como:

- Oscilaciones semana a semana porque los prospectos eran distintos, no porque la oferta fuera mejor.

- Muestras pequeñas donde unas pocas respuestas extra crean un falso ganador.

- Cambios en entregabilidad (nuevos dominios, problemas de warm-up, cambios de autenticación) que alteran quién siquiera ve el correo.

- Efectos de timing como festivos, cierre de trimestre o un ciclo de noticias en la industria.

- Manejo inconsistente de las respuestas, donde una versión recibe más “ahora no” y lo cuentas como éxito.

Un escenario conocido: haces una prueba de oferta, la Variante B recibe 6 respuestas un lunes y la declaras ganadora. Luego te das cuenta de que esas respuestas eran mayormente fuera de la oficina y postergaciones corteses, y el resto de la semana queda en silencio. No fue magia. Fue varianza.

El objetivo no es la certeza. Una prueba de oferta limpia reduce la incertidumbre para que puedas tomar una mejor decisión. Si tratas cada test como evidencia, no como veredicto final, dejas de perseguir ganadores falsos y empiezas a construir ofertas que se mantengan con el tiempo.

Qué cuenta como la oferta (y qué no)

Cuando la gente dice que quiere probar ofertas, a menudo se refiere a “cambiar el email y ver qué pasa.” Eso normalmente mezcla demasiadas variables. Empieza por definir la oferta.

Una oferta es el intercambio que propones: qué pides al lector que haga, qué recibe a cambio y por qué tiene sentido ahora.

Las partes que son la oferta

Piensa en la oferta como un paquete pequeño. Cambiar cualquiera de estos cambia la oferta:

- CTA (la petición): “Responde SÍ”, “Elige un horario”, “Envíame el contacto correcto”, “¿Quieres que le eche un vistazo?”

- Ángulo de valor (la promesa): ahorrar tiempo, reducir costes, obtener más leads, arreglar entregabilidad, mejorar conversión

- Incentivo: auditoría gratuita, paquete de plantillas, informe comparativo, tarjeta regalo, prueba extendida

- Nivel de compromiso: “responde con un número” vs llamada de 5 minutos vs demo de 30 minutos

- Timing/urgencia: “esta semana”, “antes de fin de mes”, “mientras aún tenemos 3 plazas”

Ejemplos concretos de variantes verdaderas de oferta:

- “Auditoría gratuita de 10 minutos de tus emails outbound” vs “Demo de producto de 15 minutos”

- “Prueba gratuita de 7 días” vs “estudio de caso de una página adaptado a tu empresa”

- “Te envío una lista corta de mejoras rápidas” vs “Te preparo un mini plan para tu próxima secuencia”

Qué no es la oferta

Estos pueden cambiar mucho los resultados, pero son pruebas separadas:

- Línea de asunto y texto de preview

- Nombre del remitente, dirección de envío, estilo de firma

- Factores de entregabilidad: edad del dominio, warm-up del buzón, colocación en spam

- Mezcla de audiencia: industria, nivel de seniority, fuente del lead

- Momento de envío: día de la semana, hora del día

Si tu objetivo es aprender qué oferta funciona, mantén constantes los elementos no relacionados con la oferta y cambia solo el intercambio que propones.

Elige una métrica objetivo que puedas medir limpiamente

Si quieres probar ofertas (no solo líneas de asunto), elige una métrica principal. Una basta. Varias métricas “principales” invitan a seleccionar resultados después de verlos.

Escoge la métrica que corresponda al resultado que realmente te importa:

- Tasa de respuestas positivas: cualquier respuesta humana que no sea rebote o cancelación de suscripción

- Tasa de interés calificado: respuestas que muestran un caso de uso real, no solo “envía info”

- Tasa de reuniones agendadas: el resultado de negocio más limpio, pero más lento de medir

- Coste por respuesta calificada: si rastreas gasto por fuente de leads

Sea cual sea, define etiquetas para que cada respuesta se cuente igual. Escribe las reglas antes de empezar. Por ejemplo:

- “Interesado” = pregunta por precios, plazos, encaje o próximos pasos

- “No interesado” = no claro

- “Fuera de la oficina” = aplazamiento automático sin compromiso

También define por adelantado tu ventana de respuesta. Una regla práctica para cold email es contar respuestas que lleguen dentro de 7 a 10 días después del primer envío (o dentro de 7 a 10 días de cada paso, si comparas ofertas dentro de una secuencia). Las respuestas tardías añaden ruido y pueden favorecer a la variante que estuvo activa más tiempo.

Evita usar aperturas y clics como métrica principal. Las aperturas están infladas por funciones de privacidad, y los clics pueden reflejar curiosidad más que intención.

Cómo aislar la oferta y mantener todo lo demás estable

Las pruebas limpias de oferta fallan por una razón simple: cambian dos cosas a la vez. Si quieres que tus resultados signifiquen algo, necesitas una diferencia clara entre A y B, y todo lo demás debe ser aburridamente consistente.

Mantén el contexto fijo

Bloquea el contexto antes de escribir una sola línea. Las mismas personas deben recibir A y B de la misma manera, durante la misma ventana. De lo contrario estarás probando calidad de lista, timing o entregabilidad.

Mantén constantes:

- Fuente y filtros de la lista: mismo proveedor, mismos cargos, mismo tamaño de empresa

- Persona y caso de uso: no mezcles fundadores con managers de marketing en un mismo test

- Estructura de la secuencia: mismos pasos, mismos retrasos, misma lógica de seguimiento

- Horario de envío: mismos días, mismas horas, mismos límites de volumen diario

- Configuración de entregabilidad: mismo dominio y salud del buzón

También iguala la estructura del correo. Si la oferta A son dos frases cortas y la oferta B un párrafo largo con pruebas extra, cambiaste más que la oferta. Mantén el formato alineado: longitud similar, número similar de líneas, mismo tipo de CTA.

Cambia una cosa a propósito

Define cada oferta en una frase y edita solo el mínimo texto necesario para reflejar el intercambio.

Ejemplo:

- Oferta A: “Auditoría de 15 minutos con 3 correcciones”

- Oferta B: “Paquete de plantillas gratis más una breve demostración”

Mantén la apertura, el dolor y el tono iguales. Solo intercambia el trade.

Si descubres un problema no relacionado a mitad de prueba (campo de personalización roto, pico de rebotes, problema de dominio), no lo remiendes y sigas. Pausa, arregla y reinicia con una nueva división y una nota de lo que cambió. Si no, mezclarás “impacto de la oferta” con “impacto del incidente”.

Paso a paso: prepara la prueba desde la idea hasta el lanzamiento

Empieza por hacer cada oferta lo bastante simple como para decirla en una frase. Si no puedes, no puedes probarla.

Escribe dos ofertas que difieran en valor, no solo en redacción. Por ejemplo:

- “Auditoría gratis de 10 minutos de tus emails outbound”

- “Te enviaré un plan de 3 diapositivas para añadir 10 reuniones calificadas este mes”

Luego construye dos versiones de la misma secuencia. Mantén la estructura idéntica: mismo número de pasos, mismos días de envío, mismo enfoque de personalización, mismo formato de CTA. Solo cambia la(s) línea(s) donde se presenta el valor.

Un plan de construcción simple:

- Redacta Oferta A y Oferta B en una frase cada una.

- Duplica la secuencia y cambia solo las frases relacionadas con la oferta.

- Usa la misma definición de audiencia y la misma fuente de lista.

- Divide prospectos 50/50 al azar para que cada variante vea personas comparables.

- Ejecuta ambas variantes al mismo tiempo.

Define tus reglas antes de enviar:

- Regla de parada: fecha final fija o tamaño de muestra entregada por variante.

- Métrica de éxito: la métrica principal que elegiste.

- Etiquetas de respuesta: las definiciones que usarás.

Antes de lanzar, haz una última revisión de cordura:

- Ambas versiones piden el mismo tipo de respuesta.

- La única diferencia real es la oferta.

- La división es aleatoria y simultánea.

- La regla de parada está escrita y no cambiará durante la ejecución.

Tamaño de muestra y tiempo que mantienen los resultados honestos

Las pruebas pequeñas aman mentir. Con solo unas pocas respuestas, una “sí” extra (o una respuesta enfadada) puede mover tus tasas un 50% o más.

Números prácticos que suelen comportarse

Si puedes, apunta a 300 a 500 prospectos entregados por variante. Eso suele ser suficiente para que unas pocas respuestas aleatorias no nombren un falso ganador.

Si no llegas a ese volumen:

- No finjas que mides diferencias pequeñas.

- Solo confía en desplazamientos grandes (por ejemplo, una oferta recibiendo ~2x las respuestas positivas).

- Mantén solo dos variantes. Más versiones dispersan demasiado tu volumen.

El tiempo importa tanto como el volumen. El rendimiento de cold email cambia según el día de la semana, festivos y fatiga de la bandeja. Si ejecutas un test durante dos días, podrías estar midiendo lunes vs miércoles más que Oferta A vs Oferta B.

Un tiempo mínimo más seguro es 7 días completos. Para audiencias lentas en responder (empresas grandes, fundadores, líderes ocupados), 10 a 14 días suele ser más realista.

La mayor trampa es mirar resultados continuamente. Si revisas a diario y paras cuando una oferta va por delante, eliges el ganador en el punto más ruidoso.

Elige una regla de parada y cúmplela:

- Fecha final fija (ej.: 14 días), o

- Tamaño de muestra entregada fijo (ej.: 400 entregados por variante)

Si el volumen es bajo, ajusta el plan en vez de forzar un resultado “limpio”. Ejecuta por más tiempo, prueba menos cosas al mismo tiempo y acepta que buscas victorias obvias, no subidas del 5%.

Cómo leer resultados sin sobrerreaccionar

Empieza con la métrica que elegiste antes del lanzamiento. Si el objetivo fue “respuestas interesadas”, compara eso primero e ignora el resto por un momento. Mezclar métricas es cómo te convences de un ganador que no es real.

Luego separa impacto de confianza:

- Un efecto puede ser real pero demasiado pequeño para importar (2.0% a 2.3% de respuestas interesadas quizá no cambie el pipeline).

- Un gran incremento en una muestra pequeña puede seguir siendo inestable.

Antes de declarar un ganador, comprueba que los dos grupos fueron realmente parecidos. Una distribución desigual crea falsos aumentos, sobre todo si una variante consiguió más cargos senior o más de una industria de alto rendimiento.

Revisiones rápidas de cordura:

- División de la audiencia: cargos, tamaño de empresa, industria, región

- Timing: ¿una variante cayó en una semana de festivo o días distintos de envío?

- Señales de entregabilidad: rebotes y quejas de spam

- Mezcla de respuestas, no sólo el conteo

La mezcla de respuestas importa porque “más respuestas” puede significar “más objeciones”. Si puedes, revisa las respuestas por categoría (interesado, no interesado, fuera de la oficina, cancelar suscripción). Una variante que aumenta “no interesado” quizá solo sea más clara, no mejor.

Cuando termines la prueba, escribe una breve nota de decisión:

- Qué crees ahora (basado en la métrica primaria)

- Qué no sabes aún (tamaño de muestra, sesgo, timing)

- Qué harás después (desplegar, repetir o ajustar la variación)

Eso mantiene la experimentación serena y repetible cuando los números están cerca.

Errores comunes que crean conclusiones ruidosas

La mayoría de las pruebas “fallidas” no fallaron porque la oferta fuera mala. Fallaron porque el test mezcló señales.

Cambiar más que la oferta es el error principal. Si ajustas la oferta, la línea de asunto y la audiencia a la vez, cualquier resultado es confuso.

Diferencias de entregabilidad son el asesino silencioso. Si la Variante A sale desde una configuración ya warmeada y la Variante B desde un dominio o buzón nuevo o cambiado, no estás probando la oferta. Estás probando la colocación en la bandeja. Bloquea tu configuración de envío durante la prueba.

Deriva en los seguimientos es otro clásico. Divides el Email 1 limpiamente, luego alguien edita el seguimiento #2 solo para una versión o cambia el CTA. Ahora comparas dos secuencias diferentes, no dos ofertas.

Otras fuentes comunes de ruido:

- Mezclar audiencias para que una variante obtenga leads más limpios o cuentas más grandes

- Enviar en días distintos o a volúmenes muy dispares

- Pausar una variante a mitad de ejecución tras ver resultados tempranos “buenos”

- Declarar ganador porque una cuenta grande respondió (los outliers mueven muestras pequeñas)

- Contar “respuestas” sin separar interesado vs no interesado

Lista rápida antes del lanzamiento

Antes de enviar, asegúrate de que realmente estás probando la oferta, no un montón de pequeños cambios.

- Una sola diferencia de oferta. Decide el cambio único (auditoría vs demo, prueba gratis vs informe, CTA de baja fricción vs pedir calendario). Mantén lo demás lo más parecido posible.

- Mismas reglas de audiencia, misma fuente de lista. Misma fuente y filtros para ambas variantes.

- Misma secuencia y horario. Mismos pasos, tiempos, días y volumen.

- Regla de parada escrita. Decide la fecha final o tamaño de muestra antes de lanzar.

- Etiquetas de respuesta claras. Define qué cuenta como positivo y qué cuenta como calificado, incluyendo casos límite como “no ahora”.

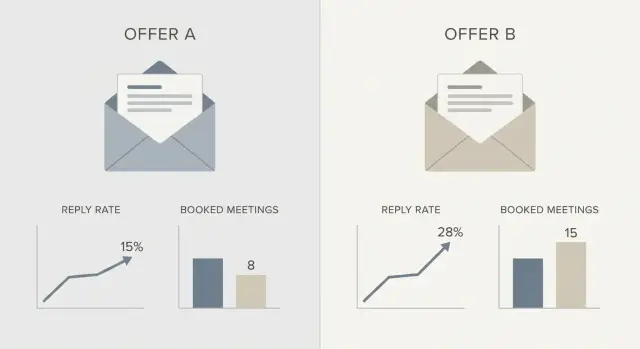

Ejemplo: probar dos ofertas en una secuencia de cold email

Un SDR se contacta con líderes financieros (VP Finance, Controller, Head of FP&A) en empresas SaaS de tamaño medio. La meta es aprender qué oferta genera más interés genuino, no cuál línea de asunto obtiene más aperturas.

Dos ofertas:

- Oferta A: una auditoría de 15 minutos de sus emails outbound, seguida por 3 correcciones específicas que pueden aplicar.

- Oferta B: un informe comparativo corto que los sitúa frente a equipos SaaS similares, seguido por una llamada de revisión de 10 minutos.

Para aislar la oferta, todo lo demás permanece igual: filtros de audiencia, configuración de envío y estructura del correo. Solo cambia el intercambio.

Mantén constante en ambas variantes:

- Reglas de lista (rol, tamaño de empresa, industria, geografía)

- Esqueleto del copy (línea de apertura, línea de credibilidad, formato del CTA, longitud)

- Método de personalización (una frase basada en rol o stack tecnológico)

- Cadencia de follow-up (mismos pasos, retrasos, días de envío)

- Identidad del remitente y salud del dominio

Divide prospectos 50/50 al inicio de la secuencia y ejecuta ambas variantes simultáneamente.

Decide el ganador usando dos números que puedas defender:

- Primario: tasa de interés (respuestas interesadas dividido por emails entregados)

- Secundario: reuniones agendadas, tratado como feedback más lento

Si la Oferta A tiene mayor tasa de interés y genera al menos las mismas reuniones tras el mismo número de días, mantenla e itera. Si una oferta obtiene más respuestas pero la mayoría son “no interesados”, probablemente esté atrayendo el tipo equivocado de atención.

Siguientes pasos: iterar con calma y facilitar las pruebas

Una vez tengas un ganador, trátalo como un nuevo valor por defecto, no como un trofeo. Haz de esa oferta la línea base para la siguiente ronda y cambia un solo ángulo de la oferta a la vez.

Lleva un registro simple de experimentos para no repetir pruebas ni olvidar resultados:

- Hipótesis

- Reglas de audiencia

- Fechas y tamaño de muestra

- Resultados (métrica primaria más notas cortas)

- Decisión (mantener, revertir, repetir)

Antes de juzgar cualquier oferta, confirma que la entregabilidad esté estable. Si la colocación en bandeja está inestable porque un buzón es nuevo, se detuvo el warm-up o cambió la autenticación, arregla eso primero.

Si la medición consistente es un cuello de botella para tu equipo, una plataforma todo-en-uno puede ayudar al mantener configuración y seguimiento en un solo lugar. Por ejemplo, LeadTrain (leadtrain.app) combina dominios de envío, warm-up, secuencias multi‑paso y clasificación de respuestas (interesado, no interesado, fuera de la oficina, rebote, cancelar suscripción) para que compares variantes sin tanto trabajo manual.

Al decidir qué probar después, elige el cambio más pequeño en la oferta que responda una pregunta real. Si tu ganador actual recibe respuestas pero pocas reuniones, prueba el nivel de compromiso en lugar de reescribir todo: CTA de menor fricción vs pedir calendario, auditoría vs llamada de 10 minutos, o la misma oferta con distinta prueba.

Avanza un paso a la vez. Aprendizaje constante y estable supera al movimiento frenético.

Preguntas Frecuentes

¿Por qué las pruebas A/B de ofertas en cold email se sienten tan inconsistentes?

Las pruebas de oferta parecen aleatorias cuando más de la oferta cambia o cuando A y B llegan a distintos tipos de prospectos. Mantén la audiencia, el momento, la estructura de la secuencia y la configuración de envío idénticos para que la única diferencia significativa sea la propuesta que ofreces.

¿Qué cuenta exactamente como la “oferta” en un cold email?

La oferta es el intercambio: lo que pides al lector, lo que recibe y por qué tiene sentido hacerlo ahora. Cambiar el CTA, el incentivo, el nivel de compromiso o la urgencia equivale a cambiar la oferta, incluso si gran parte del correo sigue igual.

¿Qué cambios no forman parte de una prueba de oferta aunque cambien los resultados?

Líneas de asunto, nombre del remitente, longitud del correo, tono, pruebas sociales, momento de envío y factores de entregabilidad no son la oferta, aunque muevan los números. Si cambias alguno de esos elementos mientras “pruebas la oferta”, estarás aprendiendo sobre redacción o colocación en la bandeja, no sobre la oferta.

¿Cuál es la mejor métrica de éxito para una prueba de oferta?

Elige una métrica primaria que refleje lo que realmente quieres. Para la mayoría, “interés calificado” o “reuniones agendadas” es más útil que la tasa bruta de respuestas, porque reduce la posibilidad de premiar respuestas vacías o negativas.

¿Cómo debo etiquetar respuestas para que los resultados no se distorsionen?

Escribe reglas sencillas para etiquetar respuestas antes de enviar y aplícalas igual a todas. Decide de antemano si fuera de la oficina, “no ahora” o “envía info” cuentan como éxito, para no coronar un ganador por una puntuación inconsistente.

¿Cómo me aseguro de que la Variante A y la B lleguen a prospectos comparables?

Ejecuta ambas variantes al mismo tiempo, divide prospectos al 50/50 al azar y usa la misma fuente y filtros de lista. Si una variante obtiene más cargos senior o un segmento más limpio, estarás probando la mezcla de la lista, no la oferta.

¿Cuántos correos necesito por variante para confiar en el resultado?

Apunta a aproximadamente 300 a 500 entregados por variante si puedes; las muestras pequeñas oscilan mucho. Si estás por debajo, solo confía en diferencias grandes y evita añadir variantes extra que diluyan tu volumen.

¿Cuánto tiempo debería durar una prueba de oferta antes de decidir?

Cuenta respuestas en una ventana fija como 7 a 10 días tras el primer envío y mantén el tiempo total suficiente para cubrir variaciones normales. No pares temprano sólo porque una versión parece delante un lunes; eso suele ser ruido.

¿Qué hago si la entregabilidad o el copy cambian a mitad del test?

Pausa y reinicia si cambia algo fundamental durante la prueba: un problema de entregabilidad, un campo de personalización roto o ediciones en seguimientos solo para una variante. Si parcheas a mitad de prueba y sigues, mezclarás “impacto de la oferta” con “impacto del incidente”.

¿Cómo puede LeadTrain ayudarme a ejecutar pruebas A/B de ofertas más limpias?

Usa un flujo de trabajo que mantenga la configuración de envío estable, haga cumplir secuencias idénticas y aplique categorías de respuesta consistentes entre variantes. LeadTrain está construido en torno a esa idea al combinar dominios, buzones, warm-up, secuencias y clasificación automática de respuestas en un mismo lugar para que pases menos tiempo limpiando datos y más comparando la oferta en sí.