Etiquetado de respuestas de IA con intervención humana para informes fiables

El etiquetado de respuestas de IA con intervención humana mantiene precisos los informes de email en frío. Usa muestreo, colas de revisión, categorías claras y feedback para reducir errores de etiquetado.

Por qué el etiquetado de respuestas necesita una verificación humana

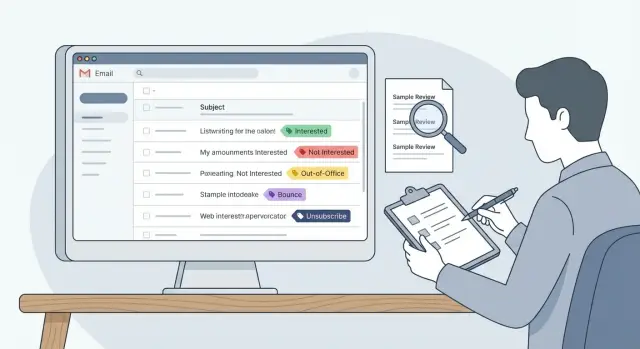

El etiquetado de respuestas consiste en clasificar las respuestas de correo entrantes en categorías para poder informar qué ocurrió. En el email en frío, esas categorías suelen ser: interesado, no interesado, fuera de la oficina, rebote y darse de baja. Las etiquetas parecen sencillas. Las respuestas reales no lo son.

La IA es excelente leyendo cada mensaje y categorizándolo rápidamente. El problema es que las respuestas más difíciles de etiquetar suelen ser las más importantes. Un ligero paso de revisión humana no se trata de desconfianza. Es la forma de mantener las decisiones y los informes alineados con la realidad.

Los errores de etiquetado ocurren por razones previsibles:

- Las respuestas cortas como "no" o "tal vez" tienen casi ningún contexto.

- La intención mixta es común: "Ahora no, inténtalo el próximo trimestre" no es un rechazo claro.

- La gente usa sarcasmo ("Claro, me encanta el spam") o hace una pregunta mientras rechaza la oferta.

- Los hilos se enredan: respuestas reenviadas, respuestas automáticas que parecen humanas o un compañero respondiendo por otra persona.

Las etiquetas erróneas no solo desajustan ligeramente un panel. Cambian prioridades:

- Si "Interesado" está sobre-etiquetado, la conversión parece excelente y escalas una campaña débil.

- Si "No interesado" está sobre-etiquetado, dejas de hacer seguimientos que podrían haberse convertido en reuniones.

- Si los rebotes están sub-etiquetados, sigues enviando desde buzones que están dañando la reputación.

- Si las bajas se interpretan mal, arriesgas problemas de cumplimiento y pierdes confianza.

La revisión humana importa más cuando el sistema tiene mayor probabilidad de fallar. Añade un bucle de revisión cuando:

- lanzas una nueva campaña o cambias la oferta

- entras a un nuevo mercado con patrones de lenguaje diferentes

- cambias el tono de tu copy (más informal, más directo, más humor)

- empiezas a usar nuevas fuentes de datos o reglas de segmentación

- notas desviaciones en métricas que no coinciden con lo que el equipo ve en la bandeja de entrada

Ejemplo: tras pasar a un primer email más corto y directo, un equipo empieza a recibir más respuestas de una línea como "envía detalles." Si eso se etiqueta como "Interesado" en lugar de "Necesita información", el equipo celebra un aumento falso. Una revisión humana por muestreo lo detecta pronto, actualiza las definiciones y mantiene honestos los informes, ya etiquetes manualmente o uses una plataforma como LeadTrain que clasifica respuestas automáticamente.

Establece objetivos y responsabilidades antes de cambiar el flujo de trabajo

"Suficientemente preciso" significa cosas diferentes para equipos distintos. Antes de añadir revisiones, ponos de acuerdo en qué es bueno en números claros. Por ejemplo: "En una muestra semanal, los errores en categorías centrales se mantienen por debajo del 3% y podemos explicar la deriva en un día hábil." Eso te da un objetivo de error y un tiempo de respuesta.

Decide también qué importa más. Normalmente no necesitas perfección en cada caso límite. Enfócate en las etiquetas que impulsan decisiones. Si tus paneles controlan seguimientos y previsiones, te importará especialmente que "Interesado" signifique realmente interés, y que rebotes y bajas se cuenten correctamente.

Mantén el alcance sencillo:

- Etiquetas centrales (deben estar correctas): Interesado, No interesado, Rebote, Darse de baja

- Etiquetas opcionales (útiles): Fuera de la oficina, Persona equivocada, Referencia, Revisar más tarde

- Necesita revisión: cualquier cosa poco clara o con intención mixta

- Una regla para "Otro": qué incluye y cuándo está permitida

La propiedad es el paso decisivo. Si nadie se responsabiliza de las reglas, cada revisor inventa silenciosamente sus propios estándares y tus métricas tiemblan. Elige un responsable que pueda decidir cambios y documentarlos (a menudo RevOps, un líder SDR o un gerente de ventas). Los revisores pueden sugerir actualizaciones, pero el responsable publica la decisión final para mantener la coherencia en los informes.

Fija una cadencia que coincida con tu volumen y el riesgo. Una revisión diaria detecta fallos súbitos (como una plantilla nueva que dispara más respuestas automáticas). Una auditoría semanal captura derivas más lentas.

Una cadencia que muchos equipos pueden mantener:

- Diario: comprobación puntual de 10 minutos de nuevas etiquetas Interesado y Darse de baja

- Semanal: revisión más profunda de una muestra mayor y cualquier elemento "Necesita revisión"

- Tras cambios: revisión extra durante 2–3 días después de una nueva secuencia, fuente de lista o configuración de dominio

Si usas un clasificador de IA (incluyendo herramientas como LeadTrain), el objetivo sigue siendo el mismo: no revisas todo. Posees la definición de "correcto" y la verificas lo suficientemente a menudo para que el panel siga siendo creíble.

Diseña una taxonomía de etiquetas que la gente pueda aplicar de forma consistente

Un proceso de revisión falla si la gente no se pone de acuerdo sobre lo que significa cada etiqueta. La meta es un conjunto pequeño de etiquetas que se mantenga estable en el tiempo, para que los informes no cambien cada vez que aparece un caso límite.

Comienza con un núcleo ajustado que cubra la mayoría de respuestas. Mantén las etiquetas mutuamente exclusivas cuando puedas y escribe una definición de una frase que un compañero nuevo pueda seguir.

- Interesado: La persona solicita una reunión, precios, plazos o un siguiente paso claro.

- No interesado: La persona rechaza ahora y no pide alternativas.

- Fuera de la oficina: Mensaje automático de ausencia con fecha de regreso o aviso claro de "estoy fuera".

- Rebote: Fallo de entrega o buzón inexistente (lenguaje generado por el sistema).

- Darse de baja: Cualquier petición para dejar de recibir correos, incluyendo "elimíname" o "no contactar".

La etiqueta que suele causar más daño es Interesado. Defínela de forma estricta para que la tasa de reuniones y los informes de pipeline sean honestos. "Suena interesante" no basta por sí mismo. Una regla simple: si no hay un siguiente paso claro, dirígela a Necesita revisión en lugar de forzar una victoria o una pérdida.

Mantén una etiqueta de retención, como Necesita revisión (o Otro) para respuestas que no encajan limpiamente. Esto protege la taxonomía mientras aprendes y te da una cola enfocada para auditar cuando las respuestas cambian.

Las respuestas con intención mixta son comunes, así que decide los desempates por adelantado y cúmplelos:

- Si una respuesta incluye Darse de baja, etiquéitala como Darse de baja sin importar qué más diga.

- Si es Fuera de la oficina y además contiene una pregunta real, etiquéitala como Fuera de la oficina y márcala para seguimiento posterior.

- Si es una referencia ("Email a Alex") más un "no soy yo", etiquéitala como No interesado (y registra la referencia por separado si lo haces).

Si debes añadir una etiqueta nueva, hazlo deliberadamente y re-etiqueta una pequeña muestra para que las tendencias sigan siendo comparables.

Elige un método de muestreo que detecte los errores más dañinos

Una muestra aleatoria de respuestas te dice si, en general, las cosas van bien, pero puede pasar por alto errores que distorsionan decisiones. Muestrea de forma que encuentres errores de alto costo: los que cambian tus conteos de respuestas interesadas, rebotes y bajas.

Una configuración práctica suele mezclar tres tipos de muestreo, además de disparadores que obligan a una revisión extra cuando algo cambia.

Opciones de muestreo (y para qué sirven)

El muestreo aleatorio te da una base y detecta casos raros con el tiempo.

El muestreo dirigido asegura que no dependas de la suerte para detectar etiquetas raras pero importantes:

- Muestra aleatoria entre todas las respuestas para estimar la corrección general

- Muestra estratificada por etiqueta (especialmente Interesado, Darse de baja, Rebote)

- Muestra basada en riesgo de respuestas fáciles de malinterpretar (mensajes muy cortos, jerga, idiomas mixtos, sarcasmo)

- Muestra desencadenada por cambios tras una alteración del flujo (nuevo dominio, nueva oferta, nueva secuencia, nueva plantilla)

- Muestra por desacuerdo cuando el modelo parece inseguro o cambia categorías con frecuencia (si tu herramienta lo expone)

Si usas una plataforma como LeadTrain que clasifica respuestas automáticamente, las muestras estratificadas y basadas en riesgo suelen ser donde encuentras los problemas que sesgan el panel silenciosamente.

Fija un tamaño de muestra semanal que tu equipo realmente hará

El mejor tamaño de muestra es el que se hace cada semana. Empieza pequeño, hazlo rutinario y luego escala.

- Elige un tiempo fijo (por ejemplo, 30 a 60 minutos por semana)

- Apunta a 30–100 revisiones por revisor por semana, según volumen

- Asegura que cada etiqueta clave tenga un recuento mínimo (por ejemplo, al menos 10 Interesado y 10 Darse de baja cuando sea posible)

- Aumenta el muestreo para nuevas campañas durante las primeras 1–2 semanas

Una regla simple: si las respuestas Interesado son raras, el muestreo aleatorio las fallará. Inclúyelas deliberadamente en la cola de revisión.

Un flujo de trabajo paso a paso para muestreo y revisión

Un buen flujo hace visibles los errores sin convertir a tu equipo en policías de etiquetas a tiempo completo. El objetivo es sencillo: detectar etiquetas erróneas temprano, corregir la regla que las causó y mantener honestos los informes.

El flujo

Crea una cola de revisión pequeña y constante. Extrae de tu muestra diaria e incluye cualquier elemento de "Necesita revisión" o cualquier cosa de riesgo (copy nuevo, picos inusuales, respuestas que parecen inciertas).

Un bucle que la mayoría de equipos puede ejecutar en 15–30 minutos al día:

- Construye la cola de revisión desde tu muestra y cualquier respuesta "Necesita revisión".

- Aplica las definiciones escritas, no opiniones personales.

- Registra la etiqueta corregida y añade una nota de una frase con la razón.

- Cuando los revisores discrepan, decide rápido y actualiza la regla en lenguaje claro.

- Alimenta las correcciones de vuelta a las reglas de informes y a cualquier proceso de entrenamiento que mantengas.

Después del pase, busca patrones: ¿se confunde “Interesado” con “Más tarde”? ¿Se marcan respuestas de fuera de la oficina como “No interesado”? Esos errores cambian silenciosamente las tasas de conversión.

Mide qué mejora (y qué no)

Solo necesitas unos pocos números:

- Tasa de error global en la muestra

- Tasa de error por etiqueta (especialmente Interesado y Darse de baja)

- Principales pares de confusión (por ejemplo, Interesado vs No interesado)

- Tiempo de resolución de los desacuerdos

- Volumen diario de elementos Necesita revisión

Ejemplo: cambias asuntos y ves un salto en “Interesado”. La cola de revisión muestra que muchas respuestas son en realidad autorrespondedores de fuera de la oficina activados por una palabra clave nueva. Actualizas la regla, corriges la muestra y tu panel deja de contar la historia equivocada.

Haz que las revisiones sean consistentes entre personas

La gente leerá la misma respuesta y discrepará, especialmente en correos cortos o vagos. La meta no es acuerdo perfecto. Es decisiones predecibles para que los informes sean estables semana a semana.

Comienza con revisiones a dos personas en una pequeña muestra. Elige 20–50 respuestas por semana (o por campaña) y pide a dos revisores que las etiqueten de forma independiente. Compara resultados. Cuando discrepen, hablen brevemente y anoten la regla que faltaba.

Usa un rubrica mínima para que cada decisión deje rastro:

- Etiqueta

- Confianza (alta o baja)

- Frase desencadenante (las palabras exactas que motivaron la decisión)

- Nota de una frase para casos límite

Un pequeño “conjunto dorado” mantiene calibrados a los revisores. Es una carpeta con respuestas conocidas y la etiqueta esperada que los revisores nuevos deben calificar antes de tocar datos en vivo. Actualízalo cuando cambien campañas u ofertas.

Un enfoque práctico de calibración:

- Mantén 25–40 ejemplos que cubran etiquetas comunes

- Incluye al menos 5 casos complicados (un no cortés, una referencia, un tal vez vago)

- Acuerda la etiqueta esperada y una razón de una línea

- Reevalúa a los revisores nuevos y a quienes estén por debajo del objetivo de acuerdo

Finalmente, registra los casos límite en una nota compartida, escrita como reglas. Con el tiempo, esto será tu manual y facilitará el reentrenamiento o los ajustes de categorías.

Errores comunes que rompen tus métricas sin que lo notes

La mayoría de los problemas de informes no vienen de un fallo grande. Provienen de pequeños hábitos de etiquetado que doblan tus números hasta que el panel parece confiado pero está equivocado.

Errores de etiquetado que más dañan

Estos errores suelen tener impacto mayor del que parecen:

- Confundir sentimiento con intención. "Gracias, no es prioridad ahora" puede sonar cordial, pero sigue siendo un no. Si se etiqueta como "Interesado", tu tasa positiva se infla.

- Tratar referencias como rechazo. "Habla con Sarah de operaciones" no es "no interesado". Si la rastreas, etiquéitala aparte para medir cuántas veces el correo llega a la persona adecuada.

- Meter todo en Otro. "Otro" sirve para casos raros, pero cuando se convierte en un cubo común, esconde patrones (objeciones de precio, mal timing, bloqueo por competencia) que deberían guiar tu próxima campaña.

- Cambiar definiciones a mitad de trimestre sin anotarlo. Si "Interesado" significaba "hizo una pregunta" el mes pasado y ahora "reservó una reunión", las series temporales se convierten en ficción.

- Ignorar rebotes y bajas porque parecen operativos. Son señales de entregabilidad y salud de lista. Si faltan o están mal etiquetados, sobreestimas el alcance y subestimas el riesgo.

Una regla simple: cada vez que los revisores vean el mismo caso de "Otro" 10–20 veces, promuévelo a categoría real y documéntalo.

Comprobaciones rápidas antes de confiar en el panel

Los paneles parecen precisos, pero las etiquetas derivan en pequeños detalles que se acumulan. Antes de actuar por un pico en "Interesado" o una caída en "No interesado", ejecuta unas comprobaciones que toman minutos.

1) Busca picos de etiquetas tras cambios

Una etiqueta que sube justo después de lanzar una secuencia nueva, cambiar copy o ajustar segmentación es una señal roja. Los cambios reales de rendimiento ocurren, pero los cambios de etiquetado son igual de comunes.

Compara el día anterior y el día posterior. Si solo una etiqueta se movió mucho (por ejemplo, fuera de la oficina se duplica mientras las respuestas totales se mantienen), probablemente hay un problema de etiquetado.

2) Revisa por muestreo Interesado y No interesado

Lee 10–20 respuestas recientes etiquetadas como Interesado. Busca falsos positivos como:

- agradecimientos corteses ("Gracias")

- aplazamientos de agenda ("El próximo trimestre")

- referencias ("Habla con mi colega")

- peticiones vagas de información ("Envíame info") sin siguiente paso claro

Luego revisa 10–20 respuestas etiquetadas como No interesado y pregúntate: ¿alguno de estos contactos reservó más tarde tras un seguimiento razonable? Si es así, tu definición de No interesado puede ser demasiado amplia o el equipo lo trata como un paro definitivo cuando no debería.

3) Asegura que rebotes y bajas no estén escondidos como fuera de la oficina

Los rebotes y las bajas son señales operativas, no de conversación. Si se etiquetan como fuera de la oficina, los informes parecen más saludables de lo que son.

Escanea un lote pequeño de respuestas Fuera de la oficina y busca palabras reveladoras como "undeliverable", "delivery failed", "blocked", "unsubscribe" o "remove me."

4) Revisa respuestas muy cortas

Las respuestas de una a tres palabras son la fuente más común de errores silenciosos: "No." "Quizás." "¿Quién?" "Ok." "Stop." Dependen del contexto.

Toma 15 respuestas cortas entre tus etiquetas principales y confirma que coinciden con la intención. Si hay confusión, añade una regla simple (por ejemplo: "Ok" no es Interesado a menos que acepte una hora propuesta).

Ejemplo: corregir etiquetas tras un cambio de campaña

Un pequeño equipo SDR lanza una secuencia nueva de 3 pasos. El copy es más directo, el seguimiento más enfático y la oferta es una llamada corta. Dos días después, el panel muestra un gran aumento en respuestas Interesado. Todos celebran hasta que el número de reuniones no sube.

Hacen una comprobación simple: muestrean respuestas recientes etiquetadas como Interesado y las leen en contexto, incluyendo el hilo. El patrón es claro. Muchas respuestas no son intención de compra real. Son "envía información" como "Claro, envía detalles" o "¿Puedes mandarme un deck?" Otras son deferencias corteses: "Ahora no, recuerda en unos meses."

El modelo no empeoró de golpe. El cambio en la campaña produjo respuestas más ambiguas y la definición de Interesado era demasiado laxa. Ajustan la taxonomía y escriben reglas claras y aplicables.

Sus definiciones actualizadas:

- Interesado requiere intención de reunión o un siguiente paso claro (reservar una llamada, proponer horarios, pedir propuesta, confirmar encaje).

- "Enviar info" queda fuera de Interesado a menos que la respuesta incluya un paso siguiente (por ejemplo, "Envíame detalles y reservaré tiempo esta semana").

- "Quizás más tarde" cubre aplazamientos de tiempo (próximo trimestre, tras un lanzamiento, en unos meses).

- No interesado es un no claro, incluyendo "stop" y "elimíname."

También añaden una regla de manejo: "Quizás más tarde" se rastrea por separado para que no infle el reporte de intención de reunión. La acción de seguimiento es consistente: registra la razón, fija una fecha de recordatorio y evita presionar por una reunión en el mismo hilo.

Durante las siguientes dos semanas mantienen un bucle de revisión ligero. Cada día muestrean un puñado de respuestas Interesado y Quizás más tarde para confirmar si la etiqueta es correcta. Si usan una herramienta como LeadTrain, esto funciona bien con la clasificación automática, porque los revisores pueden centrarse en las pocas categorías que impulsan decisiones.

Al final de la segunda semana, la tasa de error en Interesado baja y la métrica de reuniones deja de oscilar con pequeños cambios de copy.

Próximos pasos: empieza pequeño y mantén el bucle

Haz un piloto que puedas terminar. Elige una campaña activa y ejecuta el bucle de revisión durante una semana. Es tiempo suficiente para ver patrones (nuevas objeciones, más respuestas fuera de la oficina) sin convertirlo en un trabajo a tiempo completo.

Mantén el tiempo de configuración limitado. En 15 minutos, puedes alinear a los revisores escribiendo definiciones en lenguaje claro y revisando 5–10 ejemplos reales de tu bandeja. Si alguien no puede etiquetar una respuesta con confianza después de leer una definición una vez, la definición necesita mejoras.

Un plan inicial manejable:

- Usa la etiqueta de IA como predeterminada y luego revisa una pequeña muestra semanal (por ejemplo, 30–50 respuestas).

- Prioriza las categorías de alto impacto primero: Interesado, Darse de baja, Rebote, No interesado.

- Marca lo que sea poco claro en lugar de forzar una suposición, y recoge esos casos para una actualización rápida de definiciones.

- Registra solo dos cosas para las correcciones: la etiqueta original y la etiqueta corregida.

- Para después de 30 minutos y programa la siguiente sesión en lugar de intentar eliminar el backlog.

Si estás usando LeadTrain (leadtrain.app), un buen enfoque es tratar su clasificación de respuestas por IA como tu base y mantener este bucle ligero encima. Aún consigues velocidad, pero tus categorías se mantienen alineadas con cómo vende tu equipo actualmente.

Para mantener el bucle sano, añade un breve control mensual:

- Actualiza definiciones según las respuestas más frecuentes y poco claras.

- Revisa los patrones principales de error.

- Decide si tu tamaño de muestra debe crecer, reducirse o mantenerse.

- Comparte un aprendizaje con el equipo para que todos etiqueten con la misma intención.

Revisiones pequeñas, correcciones pequeñas y métricas de las que puedas fiarte semana tras semana.

Preguntas Frecuentes

Do I really need humans to review AI-labeled replies?

Start with AI as the default, then add a small human sampling step that focuses on high-impact labels like Interesado, Darse de baja, and Rebote. The goal is to catch the mistakes that change decisions, not to manually re-label everything.

Why does AI mislabel cold email replies so often?

Because the most valuable replies are often the most ambiguous. One-line responses, sarcasm, mixed intent, and messy threads are easy to misread, and small errors in Interesado or Darse de baja can skew your reporting and follow-up priorities.

What’s the safest definition of “Interested”?

Keep it narrow: Interesado should mean the person is asking for a meeting, pricing, timing, or a clear next step. If there’s no next step, treat it as Necesita revisión or a separate category like “Necesita información”, so your meeting-intent metrics stay honest.

How should we label replies with mixed intent (like “Not now, try next quarter”)?

Use a simple tie-breaker rule and write it down. A practical default is: if the reply includes “stop,” “remove me,” or anything similar, label it Darse de baja no matter what else is in the message.

Which labels matter most to get right?

Prioritize categories that affect deliverability and compliance, and the ones your dashboards drive actions from. Most teams should treat Interesado, No interesado, Rebote, and Darse de baja as “must be correct,” and keep everything else as optional or Necesita revisión.

How big should our weekly review sample be?

A simple weekly time box works well: review 30–50 replies, and make sure you include minimum counts for key labels (for example, at least 10 Interesado and 10 Darse de baja if you have them). If Interesado is rare, sample it deliberately instead of relying on random picks.

What’s the best way to sample replies so we catch costly mistakes?

Mix random sampling with targeted sampling. Random gives you a baseline, while targeted sampling focuses on risky areas like very short replies, category spikes after a copy change, and anything labeled Interesado, Darse de baja, or Rebote.

Who should own the labeling rules and changes?

Assign one owner (often RevOps, an SDR lead, or a sales manager) who publishes the final definitions and tie-breakers. Reviewers can suggest changes, but one person should decide and document updates so metrics don’t wobble week to week.

How can I tell if my dashboard is being skewed by mislabels?

Run quick checks: read 10–20 recent replies labeled Interesado and confirm there’s a real next step, and scan Fuera de la oficina for hidden bounces or unsubscribe requests. If one label spikes right after a campaign change, assume a labeling shift until you prove it’s real performance.

Can we use LeadTrain and still do human-in-the-loop review?

Yes. LeadTrain’s AI reply classification can be your baseline, and a light review loop helps keep categories aligned with how your team sells right now. You still get speed, but you reduce false “wins,” missed follow-ups, and compliance mistakes from misread unsubscribes.