Playbook zu API-Rate-Limits für stabile Abrufe von Interessentenlisten

Playbook zu API-Rate-Limits fürs Prospecting: Paginierung, Retries, Caching und Logging-Pattern, die Listen-Abrufe stabil, wiederholbar und auditierbar machen.

Warum Prospect-Abrufe bei Rate-Limits scheitern

Prospect-Abrufe scheitern meist auf langweilige, vorhersehbare Weise: Eine Integration trifft ein API-Limit, der Job verlangsamt sich, und jemand startet ihn neu, ohne zu wissen, was bereits passiert ist. Es sieht aus wie „die API war unzuverlässig“, aber das eigentliche Problem ist, dass der Abruf nicht dafür ausgelegt war, unter Last gut zu funktionieren.

Wenn ein Abruf auf Rate-Limits trifft, treten immer wieder ähnliche Fehlerbilder auf:

- Fehlende Datensätze, weil der Job mitten auf einer Seite abläuft und nicht sauber fortgesetzt wird

- Duplikate, weil Seiten ohne idempotente Strategie erneut angefragt werden

- Partielle Updates, bei denen einige Prospects angereichert und andere leer bleiben

- Stille Lücken, wenn Fehler geschluckt werden und der Abruf trotzdem „fertig“ meldet

- Kreditverschwendung, wenn dieselben Endpunkte wiederholt abgefragt werden

Diese Instabilität ist teuer. Du zahlst mehrfach für dieselben Daten, Abläufe werden chaotisch (der gleiche Lead wird zweimal importiert oder kontaktiert) und Reports werden schwer vertrauenswürdig. Bei größerem Umfang können kleine Inkonsistenzen in Listen zu Zustellbarkeitsproblemen und verwirrten Follow-ups führen.

Das Ziel ist einfach: Abrufe, die stabil, wiederholbar und auditierbar sind.

- Stabil: große Abrufe laufen ohne ständiges Eingreifen durch.

- Wiederholbar: erneute Läufe ändern Ergebnisse nicht, sofern die Quelldaten gleich geblieben sind.

- Auditierbar: du kannst später nachvollziehen, welche Aufrufe stattfanden, was importiert wurde und warum.

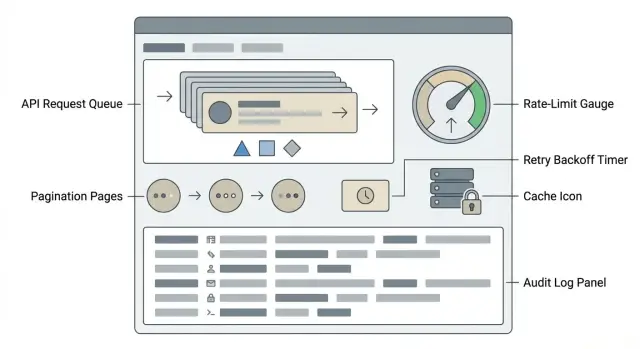

Die praktischen Bausteine sind Paginierung, die nicht überspringt oder doppelt zählt, Retries, die sicher wiederherstellen, Caching und inkrementelle Abrufe, die API-Last reduzieren, sowie Logging, das jeden Lauf erklärbar macht. Wenn du Prospects von Anbietern wie Apollo in ein Outbound-System ziehst (zum Beispiel, um Sequenzen in LeadTrain zu befüllen), sorgen diese Schutzmaßnahmen dafür, dass Wachstum nicht in Chaos ausartet.

Kenne die Limits, bevor du abziehst

Bevor du einen großen Prospect-Abruf startest, kläre, was die API erlaubt. Dieser eine „langweilige“ Schritt verhindert halb fertige Listen, fehlende Seiten und doppelte Importe später.

Rate-Limits betreffen die Geschwindigkeit. Quotas betreffen das Gesamtvolumen. Concurrency-Limits betreffen, wie viele Anfragen gleichzeitig laufen.

- Rate-Limit: maximale Anfragen pro Sekunde oder Minute (Beispiel: 60 requests/min)

- Quota: maximale Anfragen pro Tag oder Monat (Beispiel: 10.000/day)

- Concurrency-Limit: maximale gleichzeitige Anfragen (Beispiel: 5 parallele Anfragen)

Die meisten APIs geben Limit-Signale über Response-Header und einige gängige Statuscodes aus. Wenn du dich an einen Provider anschließt, erfasse diese Signale früh während eines kleinen Test-Abrufs.

Typische Muster:

- HTTP 429 (Too Many Requests) und manchmal 403 zur Durchsetzung von Limits

Retry-After, das sagt, wie lange du warten sollstX-RateLimit-Limit,X-RateLimit-Remaining,X-RateLimit-Reset(Namen variieren)- Vendor-spezifische Header wie

RateLimit-*oderX-Quota-*

Achte auch auf Burst-Limits. Du darfst vielleicht 60 Anfragen/Minute, wirst aber blockiert, wenn du 20 in einer Sekunde schickst. Bursts entstehen leicht mit parallelen Arbeitern, Retries oder einer engen Paginierungsschleife.

Für Durchsatzplanung starte konservativ. Nimm das veröffentlichte Limit und ziele auf 60–80% davon. Wenn das Limit 60/min ist und jede Anfrage 100 Prospects zurückliefert, ziele auf rund 40–45 Anfragen/min (etwa 4.000 bis 4.500 Prospects/min) und halte parallele Anfragen niedrig (oft 1 bis 3), um Spitzen zu vermeiden.

Paginierung, die keine Prospects verpasst oder dupliziert

Paginierung ist die Quelle der meisten „zufälligen“ Lücken und Duplikate. Das Ziel sind deterministische Seitenabrufe, selbst wenn während des Lesens neue Prospects hinzukommen.

Offset-basierte Paginierung (page=7, limit=100) ist einfach, aber riskant, wenn sich das Dataset ändert. Wenn Datensätze während des Laufs hinzugefügt oder bearbeitet werden, verschiebt sich die „7. Seite“ und es entstehen übersprungene Items oder Wiederholungen. Cursor-basierte Paginierung (ein next_cursor-Token) ist meist sicherer, weil sie dir genau sagt, wo du weitermachen sollst, jedoch hängt sie davon ab, dass die API eine stabile Reihenfolge zurückgibt.

Um Seiten konsistent zu halten, fordere eine stabile Sortierung an und belasse Filter für den gesamten Lauf. Ein gängiger Ansatz ist das Sortieren nach einem monotonen Feld wie created_at mit einem Tie-Breaker wie id, damit zwei gleichzeitig erstellte Datensätze nicht zwischen den Aufrufen ihre Reihenfolge tauschen.

Wenn sich die Daten während deines Abrufs ändern können, friere das Universum ein. Notiere einen Cutoff-Zeitstempel zu Beginn (zum Beispiel created_at <= 2026-01-17T10:00Z) und wende ihn auf jede Seite an. Neue Datensätze können eintreffen, aber sie verschieben nicht die Seiten, die du gerade liest.

Stop-Regeln und Plausibilitätsprüfungen helfen zu entscheiden, wann zu beenden ist und wann zu untersuchen:

- Stoppe nur, wenn die API keine Items zurückgibt oder kein

next_cursorvorhanden ist. - Verfolge eindeutige IDs und alarmiere, wenn Duplikate einen kleinen Schwellwert überschreiten.

- Markiere plötzliche Einbrüche in der Seitengröße.

- Halte eine laufende Summe und vergleiche sie mit der von der API gemeldeten Gesamtzahl, falls vorhanden.

- Persistiere den Cursor (oder den letzten Sortierschlüssel) nach jeder Seite, damit du sicher fortsetzen kannst.

Retries, die wiederherstellen, ohne alles schlimmer zu machen

Retries helfen, wenn das Problem temporär ist. Sie verschlimmern die Lage, wenn die Anfrage falsch ist oder du die API bereits überlastest. Mache Retries vorhersehbar, begrenzt und höflich.

Trenne Fehler, die du wiederholen solltest, von solchen, die du beheben musst:

- Wiederholen: 429 (rate limited), 408 (timeout), die meisten 5xx (Server-Fehler) und Netzwerkprobleme (Connection Reset, DNS-Hiccup).

- Nicht wiederholen: 400 (Bad Request), 401/403 (Auth/Permission), 404 (falscher Endpoint oder fehlende Ressource) und Validierungsfehler.

Bei 429s respektiere die Serveranweisungen. Wenn du Retry-After erhältst, pausiere so lange (plus etwas Zufall) und fahre dann fort. Ignorieren von Retry-After verwandelt eine Verlangsamung in einen Ausfall oder schlimmer, in eine temporäre Sperre.

Exponentielles Backoff mit Jitter bedeutet, dass du nach jedem Fehler länger wartest und eine kleine zufällige Verzögerung hinzufügst, damit viele Worker nicht gleichzeitig erneut anfragen.

- Backoff-Regel: 1s, 2s, 4s, 8s, bis zu einer Obergrenze (z. B. 30–60s)

- Jitter hinzufügen: Wartezeiten um etwa 20–50% randomisieren

- Cooldown: Nach wiederholten 429s den ganzen Job länger pausieren (z. B. 2–5 Minuten)

Setze eine harte Grenze für Retries. Eine Regel wie max. 5 Versuche pro Anfrage oder maximal 10 Minuten Gesamt-Wiederholzeit verhindert Endlosschleifen.

Beispiel: Du ziehst 50.000 Prospects und Seite 37 gibt 429 mit Retry-After: 15 zurück. Schlafe 15–20 Sekunden, wiederhole diese Seite einmal und fahre dann fort. Wenn du drei 429s hintereinander triffst, pausiere kurz, statt die API zu überfluten.

Abrufe restartbar und sicher wiederholbar machen

Ein stabiler Abruf ist einer, den du stoppen, neu starten und erneut ausführen kannst, ohne dass sich das Ergebnis ändert. Das ist wichtig, wenn du auf Rate-Limits triffst, einen Timeout bekommst oder mitten im Lauf einen Fix ausrollst.

Beginne mit idempotenten Writes. Anstatt „jede Zeile einfügen“, nutze ein Upsert mit einem klaren De-Deduplizierungsschlüssel und protokolliere, was geschah. Gängige Schlüssel sind die Provider-Personen-ID, normalisierte Email oder ein Fallback wie Domain + voller Name.

Ein vorhersehbares Konflikt-Regelwerk:

- Wenn die Provider-ID übereinstimmt, behandle es als denselben Prospect und aktualisiere Felder.

- Falls die normalisierte Email übereinstimmt, merge und behalte die zuletzt aktualisierten Felder.

- Andernfalls erstelle einen neuen Prospect-Datensatz und versehe ihn mit der Pull-Job-ID zur Nachverfolgbarkeit.

- Überschreibe niemals ein Unsubscribe- oder „do not contact“-Flag während Merges.

Mache den Abruf mit Checkpoints wiederanlaufbar. Speichere das zuletzt bestätigte Cursor-/Page-Token und die Anzahl der für diese Seite gespeicherten Datensätze. Schalte den Checkpoint nur vor, wenn die Seite vollständig verarbeitet und committed ist, sodass ein Absturz höchstens eine Seite erneut abspielt.

Provider-Daten können sich unter dir ändern: IDs werden zusammengeführt, gelöscht oder wiederverwendet. Führe eine Mapping-Tabelle von „gesehenen Provider-IDs“ zu deiner internen ID. Wenn eine ID plötzlich auf eine andere Email zeigt, isoliere sie zur Prüfung, statt stillschweigend zu überschreiben.

Beispiel: Du ziehst 50.000 Leads nachts in deinen Outbound-Stack (oder in eine Plattform wie LeadTrain). Wenn der Job bei Seite 380 abstürzt, startest du ab dem letzten Checkpoint neu, spielst Seite 380 sicher erneut ab und landest immer noch bei denselben 50.000 Datensätzen, nicht bei 50.800 mit Duplikaten.

Caching und inkrementelle Abrufe zur Reduzierung der API-Last

Caching reduziert API-Aufrufe, ohne das Ergebnis zu verändern. Es hilft besonders, wenn du einen Abruf nach einem Fehler erneut startest, dieselben Lookups (Firmendomains, Titel, Standorte) wiederholst oder dieselben Personen mehrfach anreicherst. Betrachte Caching als Sicherheitsmaßnahme, nicht nur als Performance-Trick.

Ein einfacher Ansatz ist Caching nach einem stabilen Schlüssel, z. B. Provider-Prospect-ID oder Email, und nur die Felder zu speichern, die du tatsächlich für Outreach brauchst. Überspringe API-Aufrufe für Datensätze, die du bereits hast, sofern sie nicht wahrscheinlich geändert wurden.

TTL-Basics: Wie lange du gecachte Daten vertraust

TTL (Time to Live) sollte zur Änderungsrate der Quelldaten und zum Risiko veralteter Daten passen. Kontaktdaten ändern sich langsam, während Titel und Firma schneller wechseln können.

- Harte Identifikatoren (Provider-ID, Email, Firmendomain): lange TTL (Tage bis Wochen)

- Profildetails (Titel, Seniorität, Standort): mittlere TTL (Stunden bis wenige Tage)

- Statusfelder (unsubscribed, bounced, do-not-contact): kurze TTL (Minuten bis Stunden)

Inkrementelle Abrufe: nur neue oder aktualisierte Datensätze

Anstatt alles neu zu ziehen, speichere einen Checkpoint wie updated_at oder ein Cursor-Token vom letzten erfolgreichen Lauf. Fordere beim nächsten Mal nur Datensätze an, die seit diesem Punkt aktualisiert wurden. Das reduziert Last, verringert Rate-Limit-Druck und macht Wiederholungen vorhersehbar.

Die häufige Falle ist, dass veraltete Daten in Outreach gelangen. Schütze dich, indem du kritische Felder zur Versandzeit validierst (z. B. do-not-contact-Flags) und Datensätze vor Kampagnen-Start aktualisierst.

Wenn du Prospects in ein Outbound-System wie LeadTrain fütterst, hilft die Kombination aus inkrementellem Sync und kurzen TTLs für Opt-out-Felder, Listen frisch zu halten und unnötige Provider-Aufrufe zu vermeiden.

Logging, das Abrufe auditierbar macht

Wenn ein Prospect-Abruf fehlschlägt oder „komisch“ aussieht, sind Logs der Weg, zu beweisen, was passiert ist. Gute Logs beantworten einfache Fragen schnell: Was haben wir angefragt, was hat die API zurückgegeben und auf welcher Seite hat sich etwas geändert?

Logge eine konsistente Menge Felder für jeden API-Call. Halte es strukturiert (JSON ist üblich), damit du nach Job gruppieren und suchen kannst.

- Timestamp (Start und Ende) plus Latenz

- Endpoint und Methode sowie wichtige Request-Parameter (page/cursor, Filter, Sort)

- Response-Statuscode und alle Rate-Limit-Header

- Ergebniszahlen (zurückgegebene Datensätze, next cursor,

has_more) - Fehlerdetails (Message, ob retrybar, Retry-Nummer)

Füge Korrelation-IDs hinzu, damit du einen Abruf über hunderte oder tausende Calls hinweg verfolgen kannst. Ein einfaches Muster ist eine job_id für den gesamten Pull und eine request_id pro API-Call. Wenn du zudem den zuletzt erfolgreichen Cursor mit der job_id speicherst, kannst du Logs mit Restart-Punkten abgleichen.

Entscheide, wie viel der Antwort du speichern willst. Rohantworten erleichtern Audits, können aber teuer und risikobehaftet sein. Prospect-Daten enthalten möglicherweise persönliche Daten, also beachte Privacy-Regeln.

Ein praktischer Kompromiss ist, für jeden Call eine Zusammenfassung zu speichern (Counts, Cursors, Hashes) und Rohkörper nur zu speichern, wenn etwas schiefgeht, oder nur für ein kurzes Aufbewahrungsfenster. Wenn du Rohdaten speicherst, redigiere sensible Felder und verschlüssele sie im Ruhezustand.

„Auditierbar“ in der Praxis: Ein Sales-Ops-Verantwortlicher fragt, warum 2.000 Prospects aus dem letzten Dienstag fehlen. Mit Logs kannst du die genauen Filter-Parameter zeigen, die Seite, auf der die Rate-Limits begannen, die ausgeführten Retries und den final gespeicherten Cursor.

Monitoring und Alerts für stabile Abläufe

Rate-Limits sind nicht nur ein Coding-Problem. Wenn du Abrufe nicht während der Laufzeit überwachst, kann ein kleiner API-Hänger stillschweigend zu fehlenden Prospects, Duplikaten oder einem nie fertig werdenden Abruf werden. Monitoring sollte eine Frage schnell beantworten: Ist dieser Abruf gerade gesund?

Nutze eine Handvoll Metriken, die auch nicht-technische Teams verstehen:

- Requests pro Minute (und wie nah du am Limit bist)

- Error-Rate (4xx vs 5xx)

- Retry-Rate (wie oft du zurückfährst)

- Lag (wie weit hinter dem erwarteten Abschluss du bist)

- Fortschritt (Seiten oder Datensätze pro Minute)

Alarme sollten auf Muster, nicht einzelne Events reagieren. Ein einzelner 429 ist normal. Zwanzig 429s in Folge bedeuten, dass du blockiert bist und Zeit verschwendest. Gleiches gilt für wiederholte 5xx-Fehler, die oft auf einen Provider-Ausfall hinweisen.

Nützliche Trigger sind ein Sprung in 429-Antworten, wiederholte 5xx-Fehler über mehrere Minuten und Paginierung, die nicht mehr vorankommt (Cursor unverändert oder Datensatzanzahl steigt nicht).

Dashboards müssen nicht aufwändig sein. Eine einfache Ansicht mit Ampel-Status, aktueller Abrufgeschwindigkeit, letztem Fehlertyp und geschätzter verbleibender Zeit reicht für einen SDR-Manager, um Entscheidungen zu treffen.

Lege vorher fest, wann automatisch pausiert und wann eine Person benachrichtigt wird:

- Auto-Pause bei anhaltenden 429s oder wenn der Fortschritt über ein definiertes Fenster flachläuft

- Benachrichtige eine Person, wenn der Abruf pausiert oder Fehler nach Cooldown bestehen bleiben

- Auto-Resume nur, wenn die Fehlerquote sinkt und der Fortschritt sicher zurückkehrt

Beispiel: Du ziehst 50.000 Prospects. Wenn 429s von 1% auf 40% springen, verhindert Auto-Pause, dass partielle Daten dein Outreach-System füttern und reduziert das Risiko inkonsistenter Importe.

Schritt-für-Schritt: Einen stabilen Prospect-Abruf ausführen

Ein stabiler Abruf ist ein Runbook, das du wiederholen kannst. Dieselben Eingaben sollten dasselbe Ergebnis liefern, auch wenn die API langsamer wird oder mitten im Lauf ausfällt.

Ein Basisfluss:

- Plan: Notiere die genauen Query-Filter, die zu fordernden Felder, Sortierreihenfolge und das Zeitfenster (z. B. „created after 2026-01-01"). Entscheide den eindeutigen Schlüssel (meist Prospect-ID).

- Dry Run: Ziehe 1–2 Seiten. Bestätige Response-Form, erforderliche Felder und dass dein Schlüssel immer vorhanden ist.

- Voller Lauf: Starte bei Seite 1 mit gespeichertem Cursor/Offset. Speichere jede Seite und notiere den zuletzt erfolgreichen Cursor, damit du fortsetzen kannst.

- Verifizieren: Vergleiche erwartete Counts (falls von der API gemeldet) mit dem, was du gespeichert hast. Prüfe auf Duplikate und fehlende Felder.

- Export/Import: Exportiere eine finale, deduplizierte Datei plus ein kleines Run-Manifest, damit jemand anderes den Lauf später nachvollziehen kann.

Batch-Größe und Parallelität sollten von Signalen kommen, nicht von Vermutungen. Starte mit einer Page-Size von 50–100 und einem Worker. Wenn du keine Rate-Limit-Antworten siehst und die Latenz stabil bleibt, erhöhe auf 2–4 Worker. Hör auf zu skalieren, wenn 429s häufig werden oder die durchschnittliche Antwortzeit steigt.

Zur Validierung mache eine Stichprobe (20–50 Datensätze) und einfache Totals: Gesamtreihen, eindeutige Prospect-IDs, Prozent ohne Email/Name/Firma und ob eine Seite doppelt gespeichert wurde.

Dokumentiere jeden Abruf in einfachem Text: Wer ihn gestartet hat, wann, welches API-Konto verwendet wurde, exakte Parameter, Page-Size, Parallelität und die finale Output-Hash oder Zeilenzahl.

Beispiel: Ein realistischer großer Abruf, der konsistent bleibt

Du musst 50.000 Prospects in ~2 Stunden ziehen, damit dein Outbound-Team morgen starten kann. Du setzt eine Page-Size von 500 (etwa 100 Seiten). Der Provider hat ein Rate-Limit, also drosselst du Requests und planst gelegentliche 429s und zufällige 5xx-Fehler ein.

Der Ablauf: Anfrage Seite 1, speichere den zurückgegebenen Cursor (oder next page token) und schreibe einen Checkpoint „last_cursor=abc, pulled=500“. Dann weitermachen. Falls eine Anfrage fehlschlägt, springe nicht vor. Wiederhole denselben Cursor mit exponentiellem Backoff (z. B. 2s, 4s, 8s), füge Jitter hinzu und begrenze Retries, damit du die API nicht bombardierst.

Zur Halbzeit gibt Seite 37 ein 429 zurück. Dein Audit-Log für diesen Moment ist einfach und präzise:

{"run_id":"2026-01-17T10:00Z","cursor":"p37","status":"retry","error":"429","backoff_seconds":8,"attempt":3}

Nach dem Backoff gelingt Seite 37. Der Checkpoint wird erst aktualisiert, nachdem diese Seite vollständig in den Storage geschrieben wurde.

Später startet jemand denselben Abruf neu, weil er einen Bug vermutet. Der Rerun liest den letzten Checkpoint, setzt bei Seite 38 an und verwendet idempotente Writes (z. B. Schlüssel prospect_id + source). Die finale Liste stimmt zwischen den Läufen überein: keine fehlenden Prospects, keine Duplikate und eine klare Spur, die genau zeigt, wo Retries auftraten.

Häufige Fehler und Fallen

Die meisten Rate-Limit-Probleme sind selbst verschuldet. Die Lösung ist selten cleverer Code. Es geht darum, einige vorhersehbare Fallen zu vermeiden.

Ein Fehler ist, jeden Fehler als retrybar zu behandeln. Das Wiederholen fehlerhafter Anfragen (falsche Parameter, ungültige Auth, fehlende Berechtigungen) kann die API belasten und dich als missbräuchlich erscheinen lassen. Retries sollten sich auf temporäre Probleme wie 429 und viele 5xx-Antworten konzentrieren und schnell stoppen, wenn der Fehler offensichtlich permanent ist.

Eine weitere Falle ist zu viel Parallelität. Selbst mit exponentiellem Backoff kann das Abschicken von 50 parallelen Requests dich dauerhaft über dem Limit halten. Eine gleichmäßige Drosselung schlägt oft unabhängige Backoffs in jedem Thread. Ein gemeinsamer Limiter (eine Queue für alle Worker) funktioniert meistens besser.

Paginierung ist auch ein Ort, an dem stille Datenprobleme stecken. Offset-Paginierung auf einem sich ändernden Dataset kann Prospects überspringen oder duplizieren, ohne Fehler zu werfen. Bevorzuge stabile Sortierung plus Cursor-Paginierung oder benutze einen Snapshot-Filter (z. B. nur Datensätze, die vor einem festen Timestamp erstellt wurden).

Schließlich sind viele Abrufe nicht restartbar. Ein kleiner Fehler bei 80% zwingt zu einem kompletten Neulauf, was die Last erhöht und die Chance auf Duplikate steigert.

Warnsignale:

- 400/401/403-Fehler werden wiederholt statt schnell zu fehlschlagen

- Unbegrenzte Parallelität, die globale Rate-Limits ignoriert

- Offset-Paginierung ohne stabilen Sortierschlüssel

- Keine Checkpoints (letzter Cursor, letzte ID oder letzter Timestamp)

- Keine Idempotenzregeln für Writes

Beispiel: Wenn du Prospects aus Apollo ziehst und der Job abstürzt, erlaubt ein gespeicherter Cursor plus eine „gesehenen IDs“-Regel ein sauberes Fortsetzen. Ohne das musst du alles neu ziehen, Kontakte doppelt importieren und triggerst mehr Limits.

Schnell-Checkliste vor deinem nächsten API-Abruf

Fünf Checks, die die meisten Fehler verhindern

Vor dem Start prüfe:

- Limits sind dokumentiert: Requests pro Minute, Tageslimits, Burst-Regeln und welche Endpunkte am meisten zählen.

- Paginierung ist deterministisch: eine Methode (Cursor ist ideal), stabile Sortierung, festes Filter-Fenster.

- Retry-Regeln sind sicher: exponentielles Backoff aktiviert, max. Retries gesetzt und eine Pause-/Resume-Regel bei anhaltenden 429s und temporären 5xx-Fehlern.

- Der Abruf ist restartbar: Ein Checkpoint ist gespeichert (Cursor oder letzter Zeitstempel/ID) und du de-duplizierst anhand eines eindeutigen Prospect-Schlüssels.

- Logging ist brauchbar: Run-ID, Zeitfenster, Request-Counts, Page/Cursor-Werte und eine einfache End-of-Run-Zusammenfassung.

Ein schneller Repeatability-Test

Mache einen kleinen Abruf (z. B. 200 Prospects) und führe ihn mit denselben Parametern erneut aus. Die Gesamtanzahl sollte übereinstimmen, Duplikate sollten null sein, und alle Unterschiede sollten erklärbar sein (z. B. neu erstellte Prospects, die außerhalb eines fixierten Fensters liegen).

Wenn du Prospects in ein Outbound-Tool schreibst, prüfe auch das Write-Verhalten: Wenn derselbe Prospect erneut auftaucht, sollte der bestehende Datensatz aktualisiert werden, statt einen neuen anzulegen.

Nächste Schritte: Von stabilen Abrufen zu konsistenter Outreach-Ausführung

Ein stabiler Abruf zählt nur, wenn er in einen kontrollierten Workflow überführt wird. Die abschließende Frage lautet immer: Wie gehst du von einer verifizierten Liste zur Outreach-Ausführung, ohne Daten zu verändern, Deliverability zu gefährden oder den Überblick zu verlieren?

Friere die Liste ein, die du kontaktieren willst. Speichere Pull-Zeitstempel, verwendete Filter und finale Datensatzanzahl. Wenn du anreicherst oder de-duplizierst, mache es einmal, dokumentiere die Regeln und produziere eine sendefertige, saubere Version. Das wird die Quelle der Wahrheit für die Kampagne.

Deliverability ist die nächste Hürde. Selbst eine perfekte Liste kann scheitern, wenn das Sende-Setup mangelhaft ist. Nutze authentifizierte Domains (SPF/DKIM/DMARC), vermeide es, mit brandneuen Domains sofort großes Volumen zu senden, und wärme Mailboxen vor dem Skalieren auf.

Ein praktischer Handoff vom „Daten sind bereit“ zum „Outreach läuft":

- Weise einen Owner für den Pull und einen Owner für die Kampagne zu (kann dieselbe Person sein).

- Lege ein kurzes Runbook ab: Wo die Liste liegt, wie sie gezogen wurde und wie man sie sicher neu ausführt.

- Importiere nur die eingefrorene, sendefertige Datei in dein Outreach-Tool.

- Starte mit einer kleinen Charge und erhöhe das Volumen, sobald Replies und Bounces gesund aussehen.

- Verknüpfe Ergebnisse zurück zum Pull: Bounces, Unsubscribes und Reply-Raten nach Segment.

Wenn du weniger Tools nutzen willst, bündeln Plattformen wie LeadTrain gängige Outbound-Elemente (Domains, Mailboxes, Warm-up, Mehrschritt-Sequenzen und Reply-Klassifikation), sodass der Übergang von Listenbau zu Versand konsistent bleibt. Kernpunkt bleibt: Wiederhole dieselben Pull-Regeln, dieselben Validierungen und dieselben Launch-Schritte mit einer klaren Verantwortlichkeit, die den Prozess ohne Raten neu starten kann.

FAQ

Warum schlagen Prospect-Abrufe so oft fehl, wenn Rate-Limits greifen?

Rate-Limits brechen Abrufe oft auf Arten, die nicht wie ein klarer Fehler aussehen: Der Job läuft mitten auf einer Seite aus, wiederholt dieselbe Seite ohne De-Deduplizierung oder beendet sich stillschweigend nach geschluckten Fehlern. Das Ergebnis sind fehlende Datensätze, Duplikate, unvollständige Anreicherungen und verschwendete API-Credits.

Was ist der Unterschied zwischen Rate-Limits, Quotas und Concurrency-Limits?

Ein Rate-Limit beschreibt, wie schnell du Anfragen machen kannst, ein Quota beschreibt, wie viele Anfragen du über ein längeres Fenster machen darfst, und ein Concurrency-Limit beschreibt, wie viele gleichzeitige Anfragen du haben darfst. Du kannst unter deinem Tages-Quota liegen und trotzdem fehlschlagen, wenn du kurzfristig Per-Minute- oder Burst-Limits durch hohe Parallelität überschreitest.

Woran erkenne ich, ob ich das API-Limit treffe oder ob ein normaler Ausfall vorliegt?

Logge Statuscodes und alle Limit-Header bei jedem Aufruf, besonders Retry-After und Remaining/Reset-Signale. Mach zuerst einen kleinen Test-Abruf, um das Verhalten des Providers unter Last zu sehen — dokumentierte Limits und tatsächliche Burst-Politik weichen oft ab.

Wie paginiere ich, ohne Prospects zu überspringen oder zu duplizieren?

Bevorzuge cursor-basierte Paginierung, wenn die API sie anbietet, und fordere immer eine stabile Sortierung an, damit sich die Reihenfolge nicht zwischen den Aufrufen verschiebt. Wenn sich das Dataset während des Abrufs ändern kann, nutze einen fixierten Cutoff-Zeitstempel, damit neue Datensätze die gelesenen Seiten nicht verschieben und zu Lücken oder Wiederholungen führen.

Was ist eine sichere Retry-Strategie für 429-Errors und Timeouts?

Wiederhole nur klar temporäre Fehler wie 429, Timeouts und die meisten 5xx-Fehler; höre bei permanenten Fehlern (400 oder Auth-Problemen) schnell auf. Bei einem 429 folge Retry-After, füge etwas Zufall hinzu und setze eine Obergrenze für Gesamt-Wartezeit, damit du nicht in Schleifen hängenbleibst.

Wie kann ich einen fehlgeschlagenen Abruf erneut ausführen, ohne Duplikate zu erzeugen?

Gestalte Writes idempotent, z. B. Upserts auf einem stabilen Schlüssel wie der Provider-Prospect-ID, und definiere konsistente Merge-Regeln, damit Wiederholungen das Ergebnis nicht verändern. Speichere nach jeder vollständig verarbeiteten Seite einen Checkpoint, sodass ein Absturz höchstens eine Seite erneut abspielt und keine Duplikate erzeugt.

Wann sollte ich Caching und inkrementelle Abrufe statt kompletter Neuauszüge verwenden?

Nutze Caching für wiederholte Lookups und Anreicherungsdaten, die nicht bei jedem Lauf aktualisiert werden müssen, und wähle TTLs passend zur Änderungsrate der Felder. Für laufende Synchronisationen reduzieren inkrementelle Abrufe (basierend auf updated_at oder einem gespeicherten Cursor) die Last und verringern die Wahrscheinlichkeit, dass Rate-Limits ausgelöst werden.

Was sollte ich loggen, damit ein Prospect-Abruf auditierbar ist?

Minimiere: Job-ID, Request-Parameter, Cursor oder Page-Token, zurückgegebene Counts, Latenz, Statuscodes und alle Rate-Limit-Header. Damit kannst du genau zeigen, auf welcher Seite etwas geschah und ob fehlende Daten von der Quelle, dem Abruf oder dem Schreibschritt stammen.

Welche Metriken und Alerts erkennen Probleme bei Abrufen frühzeitig?

Beobachte Fortschrittsrate, Error-Rate (aufgeteilt in 4xx/5xx) und wie oft du backoffst — das zeigt, ob du vorankommst oder steckenbleibst. Alarme sollten Muster fangen, z. B. anhaltende 429s, wiederholte 5xx-Fehler über mehrere Minuten oder ein nicht mehr weiterwandernder Cursor, denn das sind Signale für partielle Listen.

Wie wirkt sich das auf meinen Outreach-Workflow aus, nachdem Prospects in LeadTrain importiert wurden?

Eine ruhige, niedrige Parallelität schlägt oft Burst-Strategien, besonders wenn Retries beginnen zu stapeln. Wenn du Prospects in ein Outbound-Workflow wie LeadTrain schiebst, sind stabile Abrufe wichtig: Duplikate führen zu Doppel-Messaging und unübersichtlichen Reports, Lücken erzeugen inkonsistente Sequenzen und Follow-ups.