Human-in-the-loop KI-Antwortkennzeichnung für verlässliche Berichte

Human-in-the-loop KI-Antwortkennzeichnung hält Cold-Email-Reporting genau. Verwenden Sie Stichproben, Review-Queues, klare Kategorien und Feedback, um Fehlkennzeichnungen zu reduzieren.

Warum Antwort-Labels einen menschlichen Backstop brauchen

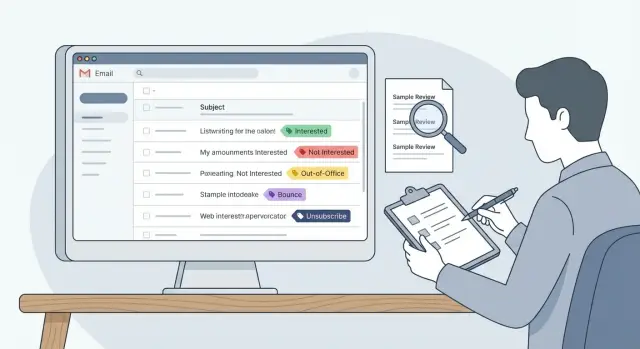

Antwort-Labels bedeuten, eingehende E-Mail-Antworten in Kategorien zu sortieren, damit Sie berichten können, was passiert ist. Im Cold Email-Bereich sind diese Kategorien typischerweise: Interessiert, Nicht interessiert, Abwesenheitsnotiz, Zustellfehler und Abmeldung. Die Labels klingen einfach. Reale Antworten sind es nicht.

KI ist hervorragend darin, jede Nachricht schnell zu lesen und zu kategorisieren. Das Problem ist: Die schwierigsten Antworten zu labeln sind oft die wichtigsten. Ein kurzer menschlicher Review-Schritt ist kein Misstrauen — es ist, wie Sie Entscheidungen und Reporting an der Realität ausrichten.

Fehlklassifizierungen passieren aus vorhersehbaren Gründen:

- Kurze Antworten wie „nein“ oder „vielleicht“ liefern kaum Kontext.

- Gemischte Absichten sind üblich: „Nicht jetzt, probier’s nächstes Quartal“ ist kein klares Ablehnen.

- Menschen verwenden Sarkasmus (»Klar, ich liebe Spam«) oder stellen eine Frage und sagen gleichzeitig nein.

- Threads werden unordentlich: Weitergeleitete Antworten, automatische Antworten, die wie echte Mails wirken, oder Kolleg:innen, die für jemand anders antworten.

Falsche Labels machen das Dashboard nicht nur minimal ungenau. Sie verändern Prioritäten:

- Wenn „Interessiert“ zu häufig vergeben wird, sieht die Conversion fantastisch aus und Sie skalieren eine schwache Kampagne.

- Wenn „Nicht interessiert“ zu oft vergeben wird, brechen Sie Nachfassaktionen ab, die Meetings hätten werden können.

- Wenn Zustellfehler untererfasst sind, senden Sie weiter von Mailboxen, die Schaden nehmen.

- Wenn Abmeldungen falsch gelesen werden, riskieren Sie Compliance-Probleme und verlieren Vertrauen.

Menschliche Reviews sind am wichtigsten, wenn das System am ehesten falsch liegt. Fügen Sie eine Review-Schleife hinzu, wenn Sie:

- eine neue Kampagne starten oder das Angebot ändern

- in einen neuen Markt mit anderen Sprachmustern eintreten

- den Ton Ihrer Copy ändern (locker, direkter, humorvoller)

- neue Datenquellen oder Targeting-Regeln verwenden

- Metrics-Verschiebungen bemerken, die nicht mit dem übereinstimmen, was das Team im Postfach sieht

Beispiel: Nach dem Wechsel zu einer kürzeren, knackigeren Erstmail erhält ein Team mehr einzeilige Antworten wie „Details senden“. Wenn diese als Interessiert statt als „braucht Info“ gelabelt werden, feiert das Team einen falschen Anstieg. Ein schneller menschlicher Stichprobencheck erkennt das früh, aktualisiert die Definitionen und hält das Reporting ehrlich — egal ob Sie manuell labeln oder eine Plattform wie LeadTrain nutzen, die Antworten auto-klassifiziert.

Ziele und Verantwortlichkeiten festlegen, bevor Sie den Workflow ändern

„Genug genau“ bedeutet für verschiedene Teams etwas Unterschiedliches. Bevor Sie Reviews hinzufügen, einigen Sie sich in klaren Zahlen, wie „gut“ aussieht. Zum Beispiel: „In einer wöchentlichen Stichprobe bleiben Fehlklassifizierungen bei Kernkategorien unter 3 % und Drift ist innerhalb eines Arbeitstages erklärbar.“ Das gibt Ihnen ein Fehlerziel und eine Reaktionszeit.

Entscheiden Sie außerdem, was am wichtigsten ist. Sie brauchen normalerweise keine Perfektion bei jeder Randbedingung. Konzentrieren Sie sich auf Labels, die Entscheidungen treiben. Wenn Ihre Dashboards Follow-ups und Forecasts steuern, interessiert Sie vor allem, ob Interessiert wirklich interessiert ist und ob Zustellfehler und Abmeldungen korrekt gezählt werden.

Halten Sie den Umfang einfach:

- Kern-Labels (müssen korrekt sein): Interessiert, Nicht interessiert, Zustellfehler, Abmeldung

- Optionale Labels (nice to have): Abwesenheitsnotiz, Falsche Person, Referral, Später nochmal nachfragen

- Braucht Review: alles Unklare oder mit gemischter Absicht

- Eine Regel für „Andere“: was es beinhaltet und wann es erlaubt ist

Zuständigkeit ist der entscheidende Schritt. Wenn niemand die Regeln besitzt, erfindet jede:r Reviewer:in stillschweigend eigene Standards und Ihre Metriken schwanken. Wählen Sie eine:n Owner, der Änderungen entscheiden und dokumentieren kann (oft RevOps, ein SDR-Lead oder ein Vertriebsleiter). Reviewer können Updates vorschlagen, aber der Owner veröffentlicht die endgültige Entscheidung, damit das Reporting konsistent bleibt.

Setzen Sie eine Kadenz, die zu Ihrem Volumen und Risiko passt. Eine tägliche Prüfung fängt plötzliche Fehler ein (z. B. eine neue Vorlage, die mehr Auto-Antworten auslöst). Ein wöchentliches Audit fängt langsamere Drift.

Eine Kadenz, an die sich viele Teams halten können:

- Täglich: 10-minütiger Spot-Check neuer Interessiert- und Abmeldung-Labels

- Wöchentlich: tiefere Prüfung einer größeren Stichprobe plus aller „Braucht Review“-Items

- Nach Änderungen: zusätzliche Prüfung für 2–3 Tage nach einer neuen Sequenz, Quellenliste oder Domain-Einrichtung

Wenn Sie einen KI-Klassifikator einsetzen (einschließlich Tools wie LeadTrain), bleibt das Ziel gleich: Sie prüfen nicht alles. Sie definieren „korrekt“ und prüfen es oft genug, damit das Dashboard glaubwürdig bleibt.

Eine Label-Taxonomie bauen, die jeder konsistent anwenden kann

Ein Review-Prozess scheitert, wenn Leute sich nicht einig sind, was jedes Label bedeutet. Ziel ist eine kleine Menge Labels, die über die Zeit stabil bleibt, damit Reporting sich nicht bei jedem neuen Edge-Case verschiebt.

Starten Sie mit einem engen Kern, der die meisten Antworten abdeckt. Machen Sie Labels möglichst gegenseitig exklusiv und schreiben Sie eine Ein-Satz-Definition, der eine neue Kolleg:in folgen könnte.

- Interessiert: Die Person fordert ein Meeting, Preise, Zeitangaben oder einen klaren nächsten Schritt an.

- Nicht interessiert: Die Person lehnt jetzt ab und fragt nicht nach Alternativen.

- Abwesenheitsnotiz: Automatische Abwesenheitsmeldung mit Rückkehrdatum oder klarer Abwesenheitsangabe.

- Zustellfehler: Zustellfehler oder Mailbox existiert nicht (systemgenerierte Fehlermeldung).

- Abmeldung: Jede Bitte, keine E-Mails mehr zu erhalten, einschließlich „entfernen Sie mich“ oder „nicht kontaktieren".

Das Label, das am meisten Schaden anrichten kann, ist meist Interessiert. Definieren Sie es eng, damit Meeting-Rate und Pipeline-Reporting ehrlich bleiben. „Klingt interessant“ reicht allein nicht. Eine einfache Regel: Wenn kein klarer nächster Schritt vorhanden ist, routen Sie es zu Needs review statt zu einem Sieg oder einer Niederlage zu zwingen.

Behalten Sie ein Halte-Label wie Needs review (oder Andere) für Antworten, die nicht sauber passen. Das schützt die Taxonomie, während Sie lernen, und gibt Ihnen eine fokussierte Queue zum Prüfen, wenn sich Antworten verschieben.

Multi-Intent-Antworten sind üblich — legen Sie Tie-Breaker vorher fest und halten Sie sich daran:

- Wenn eine Antwort Abmeldung enthält, labeln Sie sie Abmeldung, egal was sonst noch drinsteht.

- Wenn es Abwesenheitsnotiz plus eine echte Frage ist, labeln Sie Abwesenheitsnotiz und markieren Sie für späteres Follow-up.

- Wenn es eine Weiterleitung („Schreib Alex“) plus „nicht ich“ ist, labeln Sie Nicht interessiert (und verfolgen Sie die Weiterleitung separat, falls Sie das tun).

Wenn Sie ein neues Label hinzufügen müssen, tun Sie das bewusst und backfillen eine kleine Stichprobe, damit Trends vergleichbar bleiben.

Wählen Sie eine Stichprobenmethode, die die schädlichsten Fehler findet

Eine zufällige Handvoll Antworten sagt Ihnen, ob im Großen und Ganzen alles OK ist, aber sie kann Fehler übersehen, die Entscheidungen verzerren. Stichproben Sie so, dass Sie hochkosten Fehler finden: Fehlklassifizierungen, die Ihre Zählung von Interessierten, Zustellfehlern und Abmeldungen ändern.

Ein praktisches Setup mischt normalerweise drei Stichprobenarten plus Trigger, die bei Änderungen eine extra Prüfung erzwingen.

Stichprobenoptionen (und wozu sie gut sind)

Zufallsstichproben geben eine Basis und fangen seltsame Edge-Cases über die Zeit ein.

Gezielte Stichproben sorgen dafür, dass Sie sich nicht auf Glück verlassen, um seltene, aber wichtige Labels zu finden:

- Zufällige Stichprobe über alle Antworten, um die allgemeine Korrektheit zu schätzen

- Schichtweise (stratified) Stichprobe nach Label (insbesondere Interessiert, Abmeldung, Zustellfehler)

- Risk-basierte Stichprobe aus Antworten, die leicht misszuverstehen sind (sehr kurze Nachrichten, Slang, gemischte Sprachen, Sarkasmus)

- Änderungsgetriggerte Stichprobe nach Workflow-Änderungen (neue Domain, neues Angebot, neue Sequenz, neue Vorlage)

- Disagreement-Stichprobe, wenn das Modell unsicher ist oder Kategorien oft wechselt (wenn Ihr Tool das anzeigt)

Wenn Sie eine Plattform wie LeadTrain verwenden, die Antworten auto-kategorisiert, finden Sie die Probleme meist in schichtweisen und risk-basierten Stichproben, weil diese Fehler Ihr Dashboard heimlich verzerren.

Legen Sie eine wöchentliche Stichprobengröße fest, die Ihr Team tatsächlich macht

Die beste Stichprobengröße ist die, die jede Woche erledigt wird. Starten Sie klein, machen Sie es zur Routine und skalieren Sie dann.

- Wählen Sie ein festes Zeitfenster (z. B. 30–60 Minuten pro Woche)

- Ziel: 30–100 Reviews pro Reviewer und Woche, je nach Volumen

- Sorgen Sie dafür, dass jedes Schlüssel-Label eine Mindestanzahl erreicht (z. B. mindestens 10 Interessiert und 10 Abmeldung, wenn möglich)

- Erhöhen Sie die Stichprobe für neue Kampagnen in den ersten 1–2 Wochen

Eine einfache Regel: Wenn Interessiert selten ist, wird Zufall es übersehen. Nehmen Sie diese Antworten gezielt in die Review-Queue auf.

Ein Schritt-für-Schritt-Stichproben- und Review-Workflow

Ein guter Workflow macht Fehler sichtbar, ohne Ihr Team zu Vollzeit-Label-Polizisten zu machen. Das Ziel ist klar: Falsche Labels früh fangen, die Regel, die den Fehler verursacht hat, korrigieren und das Reporting ehrlich halten.

Der Workflow

Erstellen Sie eine kleine, konstante Review-Queue. Ziehen Sie daraus Ihre tägliche Stichprobe und alles Riskante (neue Copy, ungewöhnliche Spitzen, unsichere Antworten).

Eine Schleife, die die meisten Teams in 15–30 Minuten pro Tag laufen können:

- Bauen Sie die Review-Queue aus Ihrer Stichprobe und allen „Needs review“-Antworten auf.

- Wenden Sie die schriftlichen Definitionen an, nicht persönliche Meinungen.

- Erfassen Sie das korrigierte Label und fügen Sie eine einzeilige Begründung hinzu.

- Wenn Reviewer:innen uneinig sind, entscheiden Sie schnell und aktualisieren Sie die Regel in Klartext.

- Füttern Sie Korrekturen zurück in Reporting-Regeln und in jeden Trainingsprozess, den Sie pflegen.

Nach dem Durchgang schauen Sie nach Mustern: Wird Interessiert mit Nicht interessiert verwechselt? Werden Abwesenheitsnotizen als „Nicht interessiert“ markiert? Diese Fehler verändern leise Ihre Conversion-Raten.

Verfolgen Sie, was sich verbessert (und was nicht)

Sie brauchen nur wenige Kennzahlen:

- Gesamter Fehleranteil in der Stichprobe

- Fehlerquote nach Label (insbesondere Interessiert und Abmeldung)

- Top-Verwechslungs-Paare (z. B. Interessiert vs Nicht interessiert)

- Time-to-resolution für Meinungsverschiedenheiten

- Volumen der „Needs review“-Items pro Tag

Beispiel: Sie ändern Betreffzeilen und sehen einen Anstieg bei Interessiert. Die Review-Queue zeigt, dass viele Antworten tatsächlich Abwesenheits-Autoresponder sind, ausgelöst durch ein neues Stichwort. Sie passen die Regel an, korrigieren die Stichprobe und das Dashboard erzählt nicht länger die falsche Geschichte.

Reviews über Personen hinweg konsistent machen

Menschen lesen dieselbe Antwort und sind uneins, besonders bei kurzen oder vagen Mails. Das Ziel ist keine perfekte Übereinstimmung, sondern vorhersehbare Entscheidungen, damit Reports Woche für Woche stabil bleiben.

Starten Sie mit Zweipersonen-Checks an einer kleinen Untermenge. Wählen Sie 20–50 Antworten pro Woche (oder pro Kampagne) und lassen Sie zwei Reviewer diese unabhängig labeln. Vergleichen Sie die Ergebnisse. Bei Uneinigkeit sprechen Sie kurz und schreiben die Regel auf, die Sie gern gehabt hätten.

Nutzen Sie ein kleines Rubric, damit jede Entscheidung eine Spur hinterlässt:

- Label

- Confidence (hoch oder niedrig)

- Trigger-Phrase (die genauen Worte, die die Wahl beeinflusst haben)

- Ein-Satz-Notiz für Edge-Cases

Ein kleines „Gold-Set“ hält Reviewer kalibriert. Das ist ein Ordner mit bekannten Antworten und den erwarteten Labels, den neue Reviewer durchgehen, bevor sie Live-Daten bearbeiten. Aktualisieren Sie es, wenn Kampagnen oder Angebote sich ändern.

Ein praktischer Kalibrierungsansatz:

- Bewahren Sie 25–40 Beispiele, die gängige Labels abdecken

- Fügen Sie mindestens 5 knifflige Fälle ein (höfliches Nein, Referral, vages Vielleicht)

- Stimmen Sie sich auf das erwartete Label und eine Ein-Satz-Begründung ab

- Testen Sie neue Reviewer und alle unterhalb Ihres Übereinstimmungsziels erneut

Zuletzt: Erfassen Sie Edge-Cases in einer gemeinsamen Notiz, geschrieben wie Regeln. Mit der Zeit wird das Ihr Playbook und macht Retraining oder Kategorie-Anpassungen sicherer.

Häufige Fehler, die Ihre Metriken leise brechen

Die meisten Reporting-Probleme entstehen nicht durch einen großen Ausfall, sondern durch kleine Label-Gewohnheiten, die Ihre Zahlen langsam verbiegen, bis das Dashboard selbstsicher, aber falsch aussieht.

Fehlklassifizierungen, die am meisten schaden

Diese Fehler haben oft überproportionalen Einfluss:

- Sentiment mit Intent verwechseln. „Danke, ist jetzt nicht prioritär“ klingt freundlich, ist aber trotzdem ein Nein. Wenn das als „Interessiert" gelabelt wird, steigt Ihre Positiv-Rate künstlich an.

- Referrals als Ablehnung behandeln. „Reden Sie mit Sarah aus dem Betrieb“ ist kein „nicht interessiert“. Wenn Sie das tracken, labeln Sie es separat, damit Sie messen können, wie oft Mails an die richtige Person vermitteln.

- Alles in „Andere“ schütten. Andere ist ok für seltene Fälle, aber wenn es zur regelmäßigen Ablage wird, versteckt es Muster (Preis-Einwände, schlechtes Timing, Wettbewerberbindung), die Ihre nächste Kampagne formen sollten.

- Definitionen mittendrin ändern ohne Notiz. Wenn „Interessiert" letzten Monat „Frage gestellt“ und diesen Monat „Meeting gebucht“ bedeutete, werden Ihre Trendlinien zur Fiktion.

- Zustellfehler und Abmeldungen ignorieren, weil sie „operational“ wirken. Sie gehören zur Zustellbarkeit und Listengesundheit. Wenn sie fehlen oder falsch gelabelt sind, überschätzen Sie Reichweite und unterschätzen Risiko.

Eine einfache Leitplanke: Wenn Reviewer denselben „Andere“-Fall 10–20 Mal sehen, machen Sie daraus eine echte Kategorie und dokumentieren Sie sie.

Schnelle Checks, bevor Sie dem Dashboard vertrauen

Dashboards wirken präzise, aber Labels driften in kleinen Schritten, die sich aufsummieren. Bevor Sie auf einen Ausschlag bei Interessiert reagieren oder einen Einbruch bei Nicht interessiert, führen Sie ein paar Minuten-Checks durch.

1) Nach plötzlichen Label-Spitzen nach Änderungen suchen

Ein Label, das direkt nach dem Start einer neuen Sequenz, Copy-Änderung oder Zielanpassung springt, ist ein Warnsignal. Echte Performance-Änderungen kommen vor, aber Label-Verschiebungen sind genauso wahrscheinlich.

Vergleichen Sie den Tag davor und den Tag danach. Bewegt sich nur ein Label stark (z. B. Abwesenheitsnotizen verdoppeln sich, während Gesamtantworten konstant bleiben), haben Sie wahrscheinlich ein Label-Problem.

2) Interested und Not interested stichprobenartig prüfen

Lesen Sie 10–20 aktuelle Antworten, die als Interessiert gelabelt sind. Achten Sie auf False Positives wie:

- höfliche Anerkennungen („Danke")

- Terminverschiebungen („Nächstes Quartal")

- Referrals („Sprich mit meiner Kollegin")

- vage Bitten („Sende Infos") ohne nächsten Schritt

Scannen Sie dann 10–20 „Nicht interessiert“-Antworten und fragen Sie praktisch: Hat einer dieser Leads nach angemessenem Follow-up später doch noch gebucht? Wenn ja, ist Ihre „Nicht interessiert“-Definition zu breit oder Ihr Team behandelt es als endgültigen Stopp, obwohl Nachfassen sinnvoll wäre.

3) Sicherstellen, dass Zustellfehler und Abmeldungen nicht als Abwesenheitsnotiz versteckt sind

Zustellfehler und Abmeldungen sind operationale Signale, keine Konversationssignale. Wenn sie als Abwesenheitsnotiz gelabelt werden, sieht das Reporting besser aus, als es ist.

Scannen Sie eine kleine Stichprobe von Abwesenheitsnotizen und achten Sie auf Hinweise wie „undeliverable“, „delivery failed", „blocked", „unsubscribe" oder „remove me".

4) Sehr kurze Antworten prüfen

Ein- bis dreizeilige Antworten sind die häufigste Quelle leiser Fehler: „Nein.“ „Vielleicht.“ „Wer?“ „Ok.“ „Stopp." Sie hängen stark vom Kontext ab.

Nehmen Sie 15 kurze Antworten aus Ihren Hauptlabels und bestätigen Sie, dass sie die Intention treffen. Sehen Sie Verwirrung, fügen Sie eine einfache Regel hinzu (z. B. „Ok“ ist nicht Interessiert, es sei denn, es bestätigt eine vorgeschlagene Zeit).

Beispiel: Fehlklassifizierungen nach einer Kampagnenänderung beheben

Ein kleines SDR-Team startet eine neue 3-Schritt-Sequenz. Die Copy ist kürzer, direkter und das Angebot ein kurzes Gespräch. Zwei Tage später zeigt das Dashboard einen deutlichen Anstieg bei Interessiert. Alle freuen sich, bis die Meeting-Zahlen ausbleiben.

Sie führen einen einfachen Check durch: Sie sampeln die jüngsten Interessiert-Antworten und lesen sie vollständig, inklusive Thread-Kontext. Das Muster ist klar. Viele Antworten sind keine echten Kaufabsichten. Es sind „Sende Infos“-Verzögerer wie „Sicher, schicken Sie Details“ oder „Schicken Sie eine Präsentation“. Andere sind höfliche Abschläge wie „Nicht die richtige Zeit, aber halten Sie mich auf dem Laufenden."

Das Modell ist nicht plötzlich schlecht geworden. Die Kampagnenänderung erzeugte mehr mehrdeutige Antworten, und die Interessiert-Definition war zu locker. Sie schärfen die Taxonomie und schreiben Regeln, denen die Leute folgen können.

Ihre aktualisierten Definitionen:

- Interessiert erfordert Meeting-Intent oder einen klaren nächsten Schritt (Terminvereinbarung, Zeitvorschläge, Angebot anfordern, Fit bestätigen).

- „Sende Infos“ bleibt außerhalb von Interessiert, es sei denn, die Antwort enthält einen nächsten Schritt (z. B. „Sende Details und ich buche diese Woche Zeit").

- „Vielleicht später“ deckt Zeitverzögerungen ab (nächstes Quartal, nach einem Launch, in ein paar Monaten).

- Nicht interessiert ist ein klares Nein, inklusive „stopp“ und „entfernen Sie mich".

Sie fügen außerdem eine Handhaberegel hinzu: „Vielleicht später“ wird separat getrackt, damit es die Meeting-Intent-Metriken nicht aufbläht. Die Folgeaktion bleibt konsistent: Grund dokumentieren, Erinnerungsdatum setzen und nicht im selben Thread auf ein Meeting drängen.

In den folgenden zwei Wochen behalten sie eine leichte Review-Schleife bei. Täglich sampeln sie einige Interessiert- und Vielleicht später-Antworten und bestätigen, ob das Label korrekt ist. Wenn sie ein Tool wie LeadTrain verwenden, passt das gut zur KI-Antwortklassifizierung, weil Reviewer sich auf die wenigen Kategorien konzentrieren können, die Entscheidungen treiben.

Am Ende der zweiten Woche sinkt die Fehlerquote bei Interessiert und die Meeting-Rate stabilisiert sich, statt bei kleinen Copy-Änderungen zu schwanken.

Nächste Schritte: Klein anfangen und die Schleife laufen halten

Führen Sie ein Pilotprojekt durch, das Sie abschließen können. Wählen Sie eine aktive Kampagne und laufen Sie die Review-Schleife für eine Woche. Das ist lang genug, um Muster zu sehen (neue Einwände, mehr Abwesenheitsantworten), ohne es zum Vollzeitjob zu machen.

Halten Sie das Setup zeitlich begrenzt. In 15 Minuten können Reviewer:innen an einem Strang sein, indem Sie Klartext-Definitionen schreiben und 5–10 echte Beispiele aus dem Postfach durchgehen. Wenn jemand nach einmaliger Definitionseinweisung eine Antwort nicht sicher labeln kann, braucht die Definition Überarbeitung.

Ein Starter-Plan, der überschaubar bleibt:

- Nehmen Sie das KI-Label als Default und prüfen Sie dann eine kleine wöchentliche Stichprobe (z. B. 30–50 Antworten).

- Priorisieren Sie hoch wirkende Kategorien zuerst: Interessiert, Abmeldung, Zustellfehler, Nicht interessiert.

- Markieren Sie alles Unklare statt eine Vermutung zu erzwingen, und sammeln Sie diese Fälle für eine schnelle Definitionsergänzung.

- Erfassen Sie bei Korrekturen nur zwei Dinge: das ursprüngliche Label und das korrigierte Label.

- Stoppen Sie nach 30 Minuten und planen Sie die nächste Sitzung, anstatt den Rückstau aufzuräumen.

Wenn Sie LeadTrain (leadtrain.app) verwenden, ist ein guter Ansatz, dessen KI-gestützte Antwortklassifizierung als Basis zu sehen und diese leichte Review-Schleife oben drauf zu legen. So behalten Sie Geschwindigkeit und sorgen gleichzeitig dafür, dass Ihre Kategorien zur aktuellen Verkaufspraxis passen.

Um die Schleife gesund zu halten, fügen Sie einen kurzen monatlichen Checkpoint hinzu:

- Aktualisieren Sie Definitionen basierend auf den häufigsten unklaren Antworten.

- Prüfen Sie die Top-Fehlklassifizierungs-Muster.

- Entscheiden Sie, ob Ihre Stichprobengröße wachsen, schrumpfen oder gleich bleiben soll.

- Teilen Sie eine Erkenntnis mit dem Team, damit alle mit derselben Absicht labeln.

Kleine Reviews, kleine Korrekturen und Metriken, denen Sie Woche für Woche vertrauen können.

FAQ

Brauchen wir wirklich Menschen, die AI-gekennzeichnete Antworten prüfen?

Beginnen Sie mit der KI als Standard und fügen Sie dann eine kleine menschliche Stichprobenprüfung hinzu, die sich auf hochwirksame Labels wie Interessiert, Abmeldung und Zustellfehler konzentriert. Das Ziel ist, Fehler zu fangen, die Entscheidungen verändern — nicht alles manuell neu zu labeln.

Warum kennzeichnet KI Cold-Email-Antworten so oft falsch?

Weil die wertvollsten Antworten oft mehrdeutig sind. Einzeilige Antworten, Sarkasmus, gemischte Intentionslagen und unordentliche Threads sind leicht fehlzuinterpretieren, und kleine Fehler bei Interessiert oder Abmeldung können Ihr Reporting und die Priorisierung verfälschen.

Was ist die sicherste Definition von „Interessiert“?

Halten Sie es eng: Interessiert sollte bedeuten, dass die Person um ein Meeting, Preise, Zeitangaben oder einen klaren nächsten Schritt bittet. Fehlt ein klarer nächster Schritt, behandeln Sie die Antwort als Needs review oder als eigene Kategorie wie „Braucht Info“, damit Metriken zur Meeting-Absicht ehrlich bleiben.

Wie sollen wir Antworten mit gemischter Absicht labeln (z. B. „Nicht jetzt, probieren Sie es nächstes Quartal“)?

Nutzen Sie eine einfache Tie-Breaker-Regel und halten Sie sie fest. Ein praktischer Standard lautet: Wenn die Antwort ein „stop“, „remove me“ oder Ähnliches enthält, labeln Sie sie unabhängig vom Rest als Abmeldung.

Welche Labels sind am wichtigsten, richtig zu setzen?

Priorisieren Sie Kategorien, die die Zustellbarkeit und Compliance betreffen und die von Ihren Dashboards Aktionen auslösen. Die meisten Teams sollten Interessiert, Nicht interessiert, Zustellfehler und Abmeldung als „müssen korrekt sein“ behandeln; der Rest bleibt optional oder als Needs review.

Wie groß sollte unsere wöchentliche Prüf-Stichprobe sein?

Ein einfaches Wochen-Zeitfenster funktioniert gut: Prüfen Sie 30–50 Antworten und sorgen Sie dafür, dass Mindestzahlen für Schlüssel-Labels enthalten sind (z. B. mindestens 10 Interessiert und 10 Abmeldung, wenn vorhanden). Wenn Interessiert selten ist, nehmen Sie es gezielt in die Stichprobe auf, statt auf Zufall zu setzen.

Wie sollten wir Antworten stichprobenartig auswählen, um teure Fehler zu finden?

Mischen Sie zufällige Stichproben mit zielgerichteten Prüfungen. Zufall gibt einen Basisüberblick; gezielte Proben fokussieren riskante Bereiche wie sehr kurze Antworten, Label-Spikes nach Copy-Änderungen und alles, was als Interessiert, Abmeldung oder Zustellfehler klassifiziert wurde.

Wer sollte die Regeln und Änderungen an den Labels verantworten?

Bestimmen Sie einen Owner (häufig RevOps, ein SDR-Lead oder ein Vertriebsleiter), der die endgültigen Definitionen und Tie-Breaker veröffentlicht. Reviewer können Änderungen vorschlagen, aber eine Person sollte entscheiden und Updates dokumentieren, damit die Metriken nicht wöchentlich schwanken.

Woran erkenne ich, ob mein Dashboard durch Fehl-Labels verzerrt ist?

Führen Sie kurze Checks durch: Lesen Sie 10–20 aktuelle Antworten mit dem Label Interessiert und prüfen Sie, ob ein echter nächster Schritt vorhanden ist. Scannen Sie Abwesenheitsnotizen nach versteckten Zustellfehlern oder Abmeldehinweisen. Wenn ein Label direkt nach einer Kampagnenänderung stark ansteigt, gehen Sie von einer Label-Verschiebung aus, bis Sie nachweisen, dass es echte Performance ist.

Kann man LeadTrain verwenden und trotzdem Human-in-the-loop-Review machen?

Ja. LeadTrain’s KI-Antwortklassifizierung kann Ihre Grundlage sein; eine leichte menschliche Review-Schleife sorgt dafür, dass die Kategorien mit der Art übereinstimmen, wie Ihr Team aktuell verkauft. So behalten Sie Geschwindigkeit, reduzieren aber falsche „Wins“, verpasste Nachfassaktionen und Compliance-Fehler durch falsch gelesene Abmeldungen.