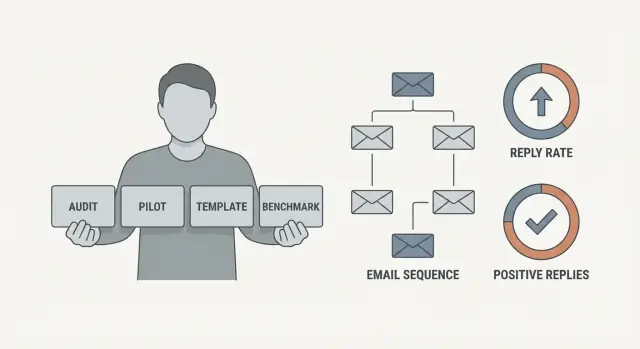

Angebotstests für Kaltakquise‑E‑Mails: Audit, Pilot, Vorlage, Benchmark

Framework für Angebotstests von Cold Emails: Vergleiche Audit, Pilot, Vorlage und Benchmark fair, mit gleicher Listenqualität und denselben Metriken.

Warum das Angebot testen — nicht nur die Betreffzeile

Eine Betreffzeile kann das Öffnen gewinnen, aber selten die Antwort. Die meisten Cold E-Mails sterben nach dem Öffnen, weil das Angebot unklar ist, riskant wirkt oder schlicht nicht die Zeit wert ist.

Das Angebot ist die eigentliche Entscheidung: „Will ich das so sehr, dass ich einem Fremden antworte?“ Diese Entscheidung siehst du in der Qualität der Antworten, nicht in der Open-Rate. Eine clevere Betreffzeile kann Öffnungen steigern, aber ein schwaches Angebot bringt immer noch Stille, vage „vielleicht später“-Antworten oder schnelle Abwehrreaktionen.

Verschiedene Angebote ziehen auch unterschiedliche Arten von „Ja“ an. Ein Audit holt Leute, die schnelle Rückmeldung wollen. Ein Pilot zieht Käufer an, die bereit sind, etwas auszuprobieren. Eine Vorlage spricht Do‑it‑yourself‑Teams an. Ein Benchmark‑Report zieht Interessenten an, die erst Kontext wollen, bevor sie sprechen.

Wenn du Angebote testest, verfolge Ergebnisse, die echte Absicht widerspiegeln:

- Positive Antworten (klare Interesse, Fragen, Detailanfragen)

- Meeting‑Absicht (Verfügbarkeiten, „können wir reden?“)

- Qualifiziertes Interesse (richtige Persona, echtes Problem)

- Negative Signale (nicht relevant, „stoppt das Mailen“, Abmeldungen)

Angebotstests gehen schief, wenn sich die Listenqualität zwischen den Runden ändert. Wenn ein Angebot an bessere Accounts oder frischere Daten geht, wirkt es automatisch wie der Gewinner, auch wenn das nicht am Angebot liegt. Das erzeugt falsches Vertrauen und Ergebnisse, die sich nicht reproduzieren lassen.

Ein einfaches Beispiel: Du testest ein „kostenloses Audit“ auf einer sauberen Liste von Mid‑Market‑Firmen mit aktiver Einstellung und testest dann ein „Pilotprogramm“ auf einer gemischten Liste, die kleine Firmen und alte Kontakte enthält. Das Audit „gewinnt“, aber du hast größtenteils Listenqualität getestet, nicht das Angebot.

Halte das Ziel eng: Finde heraus, welches Angebot die meisten positiven Antworten vom gleichen Typ von Prospect bringt.

Die vier Angebote und was sie beim Empfänger signalisieren

Wenn du das Angebot änderst, veränderst du, was der Leser denkt, was du von ihm willst — nicht nur Geld, sondern Zeit, Vertrauen und Aufmerksamkeit. Ein guter Test vergleicht Angebote, die sich sinnvoll unterscheiden, während der Rest der E‑Mail gleich bleibt.

Audit: geringes Commitment, Diagnose

Ein Audit ist ein „Zeig mir, was falsch ist“-Angebot. Es funktioniert am besten, wenn der Umfang eng ist und das Ergebnis konkret, z. B. „eine einseitige Deliverability‑Checkliste“ oder „3 konkrete Lücken in eurer Follow‑up‑Sequenz“.

Das Signal an den Empfänger ist geringer Aufwand für sie und moderater Aufwand für dich. Es kann schnell Vertrauen aufbauen, weil du Einsicht anbietest, bevor du um ein Gespräch bittest. Ist es aber vage („kostenloses Audit“), kann es wie eine Falle wirken, die direkt in ein Sales‑Pitch führt.

Pilot: zeitlich begrenzter Test

Ein Pilot sagt: „Lasst uns das in kleinem, sicheren Rahmen ausprobieren.“ Er kann bezahlt oder kostenlos sein, sollte aber zeitlich oder in der Größe begrenzt sein, z. B. „2 Wochen“, „ein Team“ oder „ein Segment“. Sag, wer qualifiziert ist, damit es nicht wie reine Bettelei klingt.

Das Signal verlangt mehr Vertrauen, bietet aber höheren Wahrgenommenen Wert. Ein Pilot impliziert, dass ihr echte Arbeit macht und Ergebnisse liefert. Er kann aber auch Reibung erzeugen, wenn der nächste Schritt schwer wirkt (Verträge, Setup, Meetings).

Vorlage: sofort einsetzbares Asset

Eine Vorlage ist „hier ist etwas, das ihr heute benutzen könnt“. Denk an Scripts, Checklisten, Rechner oder ein kurzes Playbook. Benenne die Aufgabe, die sie löst, nicht den Dateityp, z. B. „eine 5‑Mail‑Reaktivierungssequenz für inaktive Leads“.

Das Signal ist schneller Nutzen bei sehr geringem Aufwand. Vorlagen bringen oft schnelle Antworten, ziehen aber auch Freebie‑Sucher an. Es hilft, die Vorlage spezifisch für deren Rolle oder Situation zu machen.

Benchmark: Vergleichsbericht

Ein Benchmark ist „so vergleicht ihr euch“. Er kann auf eurem Datensatz, öffentlichen Quellen oder einer kleinen Menge Eingaben basieren, die sie liefern. Wichtig ist die Formulierung, z. B. „durchschnittliche Antwortrate in eurer Nische“ oder „häufige Gründe, warum Interessenten nein sagen“.

Das Signal ist Glaubwürdigkeit und Autorität, aber auch Prüflust. Leute werden fragen, woher die Zahlen stammen. Ist die Datenquelle unklar, kann das Angebot erfunden wirken.

Bei allen vier testest du im Kern dieselbe Frage: Welches Versprechen ist eine Antwort wert? Audit setzt auf Klarheit, Pilot auf Commitment, Vorlage auf Schnelligkeit und Benchmark auf Beweise.

Halte die Listenqualität gleich, damit der Test fair ist

Der schnellste Weg zu einem falschen „Gewinner“ ist, jedes Angebot an einen anderen Kundentyp zu senden. Ein Audit wirkt großartig, wenn es an Firmen geht, die bereits nach Hilfe suchen, während eine Vorlage schwach wirkt, wenn sie an Leute geht, die dieses Problem nie angehen.

Starte mit einem engen Publikum und 1–2 Personas. Halte es simpel: eine Rolle, die du benennen kannst, ein Hauptproblem, ein Grund, warum es sie jetzt kümmern sollte.

Sperr die Listenquelle. Wähle einen Ort, von dem du Prospects ziehst, und mische während des Tests nicht mehrere Quellen. Unterschiedliche Quellen bedeuten unterschiedliche Frische und Genauigkeit — das verändert Ergebnisse oft mehr als das Angebot.

Schreib die Einschlussregeln auf, bevor du die Liste baust, und wende sie auf alle vier Varianten an: Rolle und Seniorität, Branche, Region/Sprache und Unternehmensgröße. Bereinige die Liste immer gleich. Entferne bestehende Kunden, Partner und jeden, mit dem du kürzlich ein echtes Gespräch hattest. Diese Leute antworten anders und können Ergebnisse verfälschen.

Randomisiere dann einmal und teile gleichmäßig, sodass jedes Angebot eine ähnliche Mischung aus Branchen, Größen und Titeln bekommt.

Entscheide, was fix bleibt und was du misst

Angebotstests funktionieren nur, wenn du sie wie ein kontrolliertes Experiment behandelst. Ändere nicht drei Dinge auf einmal — dann weißt du nicht, ob das Audit „gewonnen“ hat, weil es besser war oder weil ein anderer Absendername, eine längere Sequenz oder eine stärkere Bitte den Unterschied machte.

Wähle eine Primärmetrik. Für die meisten Teams ist die sauberste Wahl die positive Antwortrate: Antworten, die eindeutig Interesse zeigen, nicht nur „danke“ oder „stop“. Sie bildet Absicht ab und ist weniger verrauscht als Opens oder Klicks.

Füge ein paar Sekundärmetriken hinzu, um versteckte Kosten zu erkennen: Gesamtantwortrate, gebuchte Meetings (oder qualifizierte Calls), Abmeldungen/Spam‑Beschwerden (falls verfügbar) und Bounce‑Rate als schneller Check der Listenqualität.

Halte die „Technik“ bei allen vier Angeboten konstant: gleicher Absender und Sending‑Domain, gleiche Sequenzlänge und Timing (z. B. 3 Schritte über 7–10 Tage), gleicher CTA‑Stil, gleiche Targeting‑Regeln und ähnliches tägliches Volumen, damit die Zustellbarkeit stabil bleibt.

Was sich ändern darf? Nur das Angebot und eine kleine Proof‑Zeile, die es unterstützt.

Vergleichbare E‑Mails für Audit, Pilot, Vorlage, Benchmark erstellen

Für einen fairen Test sollten die E‑Mails wie Geschwister wirken, nicht wie Fremde. Schreib eine Basis‑E‑Mail und tausche nur den Angebotsblock aus.

Beginne mit einer Kernproblem‑Aussage, die du Wort für Wort wiederverwenden kannst. Wähle ein spezifisches, schmerzhaftes, aber verbreitetes Problem. Halte das in allen vier Versionen identisch, damit du das Angebot testest, nicht das Framing.

Behalte Eröffnungsstil, CTA‑Form, Länge, Ton und Absenderidentität bei. Schreibe dann den Angebots‑spezifischen Nutzen in 1–2 Sätzen. Ziel ist, jedes Angebot gleich leicht verständlich und ähnlich im Aufwand für den Leser zu machen.

Beispiel‑Angebotszeilen mit gleicher Struktur:

- Audit: „Ich kann ein kurzes Audit eurer Follow‑up‑Mails machen und 3 konkrete Lücken zeigen, die Antworten kosten.“

- Pilot: „Ich kann einen kleinen 2‑wöchigen Pilot mit einem begrenzten Segment aufsetzen, damit ihr Ergebnisse seht, bevor ihr euch verpflichtet.“

- Vorlage: „Ich kann die genaue Follow‑up‑Vorlage teilen, die wir nutzen, angepasst an euer Produkt und Publikum.“

- Benchmark: „Ich kann einen kurzen Benchmark‑Report senden, der zeigt, wie Antwortraten für ähnliche Teams aussehen, plus 2 praktische Fixes."

Füge pro Angebot einen einfachen Proof‑Punkt hinzu (Lieferzeit, Format, Umfang). Vermeide es, Proof‑Punkte zu stapeln, bis eine Variante aus anderen Gründen stärker aussieht als das Angebot selbst.

Halte den CTA in allen vier Versionen gleich geformt. Eine klare Frage funktioniert meist am besten: „Soll ich ihn dir rüberschicken?“ oder „Soll ich den Entwurf senden?“

Schritt für Schritt: Führe den Angebotstest als ein kontrolliertes Experiment durch

Führe es als einen Test, nicht als vier separate Kampagnen

Starte mit einer Prospect‑Liste, mische sie und teile sie dann in vier gleiche Gruppen. Jede Gruppe sollte gleich aussehen: gleiche Mischung aus Rollen, Unternehmensgrößen, Branchen und Regionen.

Ordne jeder Gruppe ein Angebot zu (Audit, Pilot, Vorlage, Benchmark) und ändere die Zuordnung während des Tests nicht. Wenn du einem Angebot bessere Accounts gibst, testest du nicht mehr das Angebot.

Ein einfacher Ablauf:

- Liste randomisieren und in vier gleiche Buckets teilen

- Jedem Bucket ein Angebot zuordnen und beschriften

- Dieselbe Sequenzstruktur an alle Buckets senden (gleiche Schritte, gleiche Pausen)

- Andere Experimente während des Fensters pausieren

- Den Test erst beenden, nachdem jeder Bucket die geplante Stichprobengröße erreicht hat

Halte alles andere fix

Nutze dieselben Sending‑Domains und Postfächer, dasselbe tägliche Volumen, dieselben Versandzeiten und dieselbe Follow‑up‑Kadenz. Halte das Personalisierungsniveau und das CTA‑Format konsistent.

Lege die Abbruchregel vorher fest

Wähle eine Mindeststichprobe pro Gruppe und ein Zeitfenster und halte dich daran. Frühes Stoppen, weil eine Variante „gut aussieht“, ist Selbstbetrug.

Strebe an, mindestens einen vollen Sequenzzyklus laufen zu lassen, damit auch späte Antworten gezählt werden.

Ergebnisse lesen, ohne sich selbst zu täuschen

Angebotstests werden oft vom falschen E‑Mail „gewonnen“, wenn Teams sich auf Opens oder Gesamtantworten konzentrieren. Entscheide vorher, wie ein gutes Ergebnis aussieht, und bewerte alle Antworten gleich.

Definiere eine positive Antwort in klaren Worten. „Klingt interessant“ ist nicht dasselbe wie „Ja, Termin buchen“. Wenn sich die Definition während des Tests ändert, wählst du am Ende das Angebot, das dir persönlich besser passt.

Eine praktische Bewertungsmethode:

- Qualifiziert positiv: fragt nach Call, Preisen, Timeline oder nächsten Schritten

- Weich positiv: interessiert, braucht mehr Infos oder späteres Follow‑up

- Neutral: Abwesenheitsmeldungen, Auto‑Replies

- Negativ: nicht interessiert, nicht relevant, stoppt Mails

- Weiterleitung: verweist an die richtige Person

Verfolge auch versteckte Negative: Abmeldungen, Spam‑Beschwerden und verärgerte Antworten.

Vergleiche die Ergebnisse nach Angebot und nach Persona‑Segment. Eine Vorlage kann bei Gründern am besten funktionieren, während ein Benchmark‑Report bei einer Marketing‑Leitung besser ankommt. Wenn du nur das Gesamtbild betrachtest, verpasst du möglicherweise einen klaren Persona‑Sieg.

Beim Wählen des Gewinners bewerte sowohl Quantität als auch Qualität. Wenn Angebot A 12 Positive hat, aber nur 2 davon qualifiziert sind, während Angebot B 8 Positive mit 6 Qualifizierten erzielt, ist Angebot B meist die bessere Grundlage für Meetings.

Beispiel: eine Liste, vier Angebote, ein klarer Gewinner

Maya ist SDR und verkauft HR‑Software an mittelgroße Firmen. Sie will Angebote testen, ohne die Listenqualität zu ändern, also zieht sie ein sauberes Segment: HR‑Direktoren in Firmen mit 200–1.000 Mitarbeitern in Handel und Logistik. Gleiche Datenquelle, gleiche Filter, gleiches Send‑Volumen.

Sie hält sich an einen Schmerzpunkt: HR‑Teams verlieren Stunden pro Woche, weil Onboarding‑Schritte fehlen und Übergaben bei Einstellungs‑Spitzen scheitern.

Sie formuliert denselben Schmerz auf vier Arten:

- Audit: „Ich kann euren Onboarding‑Flow prüfen und zeigen, wo Schritte fehlen (keine Vorbereitung nötig, nur ein kurzes Gespräch).“

- Pilot: „Wählt einen Standort oder einen Hiring‑Manager und führt einen 14‑tägigen Pilot durch, um Zeitersparnis zu beweisen.“

- Vorlage: „Ich kann die Onboarding‑Checkliste plus E‑Mail‑Vorlagen teilen, die wir bei ähnlichen Teams sehen.“

- Benchmark: „Ich kann einen kurzen Benchmark senden, der euren Prozess mit Peers vergleicht (Time‑to‑first‑day, Completion‑Rate, Drop‑offs)."

Nach zwei Wochen sind die Open‑Raten ähnlich, aber die Antworten nicht. Die Vorlage gewinnt bei den gesamten positiven Antworten und bietet die schnellste Time‑to‑Meeting. Das Audit erzeugt höfliche Neugier, aber weniger Kalenderbuchungen. Der Pilot zieht größere Firmen an, stockt aber oft bei Einkaufsfragen. Der Benchmark klingt zu „beraterisch“ und führt häufiger zu Weiterleitungen.

Sie verbessert die Gewinner‑Sequenz, ohne den ganzen Test neu zu starten: E‑Mail 1 bietet die Vorlage an, E‑Mail 2 stellt eine Qualifikationsfrage („Liegt Onboarding bei HR oder bei den Fachabteilungen?“), und E‑Mail 3 führt den Pilot erst nach Engagement ein.

Häufige Fehler, die Angebotstests nutzlos machen

Die meisten Tests scheitern, weil zu viele Dinge gleichzeitig geändert werden oder weil der Sieger nach dem falschen Signal gewählt wird.

Häufige Fehler:

- Angebot und Betreff (oder erste Zeile) gleichzeitig ändern

- Einer Variante bessere Listenschnitte geben (höhere Intent‑Titel, sauberere Daten)

- Zu früh stoppen nach wenigen Antworten

- Nach Opens oder Klicks urteilen statt nach positiven Antworten und Meetings

- Abmeldungen, Beschwerden und Zustellbarkeits‑Schäden ignorieren

Eine einfache Lösung: Wähle eine Primärmetrik (positive Antworten, die zu Meetings führen können), tracke die Nachteile (Abmeldungen und Beschwerden) und halte die Versandbedingungen konstant.

Achte auch darauf, wie Antworten gelabelt werden. Ein chaotisches Postfach macht es leicht, „vielleicht“-Antworten als Erfolge zu zählen.

Schnelle Checkliste und nächste Schritte

Bevor du auf Senden drückst, prüfe, ob dein Test wirklich ein Test ist:

- Liste zufällig und gleichmäßig aufteilen

- Konstanten sperren (Absender, Kadenz, Anzahl Follow‑ups, CTA‑Stil)

- Erfolgsmetriken vorher definieren

- Vereinbaren, was als positive Antwort gilt

- Zustellbarkeits‑Basics prüfen (authentifizierte Domain, erwärmtes Postfach, kein kaputtes Tracking)

Während des Laufs: ändere die Texte nicht mittendrin. Wenn du den Motor beim Fahren veränderst, weißt du nicht, was das Ergebnis verursacht hat.

Nach dem Lauf: wende eine klare Siegerregel an — höchste positive Antwortrate, mit ausreichendem Volumen, und akzeptable Abmelde/ Beschwerde‑Level.

Wenn du weniger bewegliche Teile beim Testen willst, hilft LeadTrain (leadtrain.app): Domains, Postfächer, Warm‑up, Sequenzen und Antwortklassifizierung an einem Ort, damit jede Angebotsvariante unter denselben Bedingungen laufen kann.

FAQ

Warum sollte ich das Angebot testen anstatt nur Betreffzeilen zu testen?

Teste das Angebot, wenn es dir um Antworten und Meetings geht, nicht nur um Opens. Eine Betreffzeile kann Aufmerksamkeit bringen, aber das Angebot entscheidet, ob jemand antwortet und einen nächsten Schritt macht.

Wie halte ich die Listenqualität über Angebotsvarianten hinweg gleich?

Starte mit einem sauberen Publikum und einer Datenquelle, randomisiere die Liste einmal und teile sie gleichmäßig. Halte die gleichen Aufnahme-Regeln für jede Variante, damit du nicht versehentlich „bessere Accounts“ gegen „schlechtere Accounts“ testest.

Was ist die beste Metrik, um ein Sieger-Angebot zu wählen?

Nutze die positive Antwortrate als primäre Metrik und definiere sie vorher klar in einfachen Worten. Kontrolliere zusätzlich Meetings, qualifizierte Antworten, Abmeldungen/ Beschwerden und Bounce-Rate, damit du keinen „Gewinner“ wählst, der zukünftiges Senden schadet.

Was genau sollte in einem Angebotstest konstant bleiben?

Alles andere muss gleich bleiben: Absender-Identität, Sending-Domain, Sequenzlänge, Timing, Targeting-Regeln und Volumen. Tausche nur den Angebotsblock und eine kleine passende Proof-Zeile aus, damit der Test das Angebot isoliert.

Wie viele E-Mails oder Prospects brauche ich pro Angebot, um dem Ergebnis zu vertrauen?

Als praktische Vorgabe: mindestens ein kompletter Sequenzzyklus und genug Sends pro Variante, um ein stabiles Signal zu bekommen. Lege eine Mindeststichprobe und ein Enddatum vor dem Start fest und stoppe nicht früh, nur weil eine Variante vorn scheint.

Wie sollte ich Antworten bewerten, damit ich mich nicht selbst täusche?

Schreib eine einfache Bewertungsregel vor dem Start und wende sie konsistent an. Behandle „Termin vereinbaren“ und „Preis anfragen“ als echte Positive und halte Soft-Interest, Abwesenheitsmeldungen und höfliche Absagen in eigenen Kategorien, damit du die Ergebnisse nicht aufblähst.

Wann sollte ich ein Audit vs. Pilot vs. Vorlage vs. Benchmark verwenden?

Wähle das Angebot nach der gewünschten nächsten Handlung. Audits funktionieren, wenn du schnell ein konkretes Ergebnis versprechen kannst, Pilots, wenn du Scope und Risiko begrenzen kannst, Vorlagen, wenn Geschwindigkeit zählt, und Benchmarks, wenn deine Datengeschichte glaubwürdig und klar ist.

Was, wenn das „gewinnende“ Angebot auch Abmeldungen oder verärgerte Antworten erhöht?

Abmeldungen und Beschwerden sind Kosten, keine bloßen Nebengeräusche, und sie können die Zustellbarkeit langfristig senken. Wenn ein Angebot bei Antworten gewinnt, aber negative Signale stark ansteigen, engere Zielgruppe, klarere Versprechen und ein soften Ask vor dem Skalieren einsetzen.

Wie erkenne ich, ob Ergebnisse durch Zustellbarkeit oder schlechte Daten verzerrt sind?

Hohe Bounce-Raten deuten oft auf List- oder Quellenprobleme hin, nicht darauf, dass das Angebot schlecht ist. Stoppe das Skalieren, bereinige und validiere die Daten und wiederhole den Test mit denselben List-Regeln, damit du Angebote fair vergleichen kannst.

Was soll ich tun, nachdem ich das bestperformende Angebot gefunden habe?

Nutze den Gewinner als neue Kontrolle und iteriere mit kleinen Änderungen: eine qualifizierende Frage in Follow-ups, Beweiszeile anpassen oder den Pilot erst nach Engagement einführen. Wenn du Konsistenz willst, kann LeadTrain helfen, Domains, Warm-up, Sequenzen und Antwortklassifizierung einheitlich zu halten.