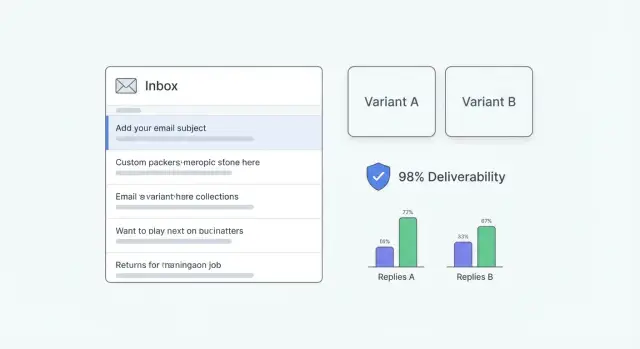

A/B‑Tests für Kaltakquise‑E‑Mails sicher durchführen: Was zuerst testen und wie

Lernen Sie, wie Sie A/B‑Tests für Cold‑Emails sicher durchführen: Was Sie zuerst testen, wie Sie Variablen sauber halten und wie Sie kleine Stichproben beurteilen, ohne die Zustellbarkeit zu gefährden.

Warum A/B‑Tests bei Cold‑Emails die Zustellbarkeit schädigen können, wenn man es falsch macht

A/B‑Tests für Cold‑Emails klingen harmlos, aber Mailprovider beurteilen Sie anhand von Mustern. Wenn Ihr „Test" in Wirklichkeit ein Haufen zufälliger Änderungen über verschiedene Listen, Versandzeiten und Stilrichtungen ist, erzeugen Sie laute Signale. Das kann wie inkonsistentes Sendverhalten wirken — und Inkonsistenz wird oft als Risiko eingestuft.

Zustellbarkeitsprobleme zeigen sich meist schnell und leise. Sie bemerken zuerst weniger Antworten, dann sinken Öffnungsraten, und schließlich landen mehr Nachrichten im Spam. In schlimmen Fällen verlangsamen Provider die Zustellung (Throttling), verzögern Nachrichten um Stunden oder blockieren Sie komplett. Das Gefährliche: Sie können dennoch weitersenden, während die Performance schlechter wird, weil nicht immer ein klarer Fehler angezeigt wird.

Bei Cold‑Email ist die Fehlertoleranz gering. Ein Betrefftest, der leicht mehr Spam‑Beschwerden verursacht, kann jeden Mehrwert an Antworten zunichtemachen. Eine neue Angebotsvariante, die aufdringlich wirkt, kann schnelle Löschungen hervorrufen — ein weiteres negatives Signal.

Der häufigste Fehler ist, zu viele Dinge gleichzeitig zu testen. Wenn Variante B Betreff, Eröffner, Angebot und CTA ändert, können Sie nicht feststellen, was das Ergebnis verursacht hat. Außerdem riskieren Sie, dass eine Version mehr negative Signale auslöst und die Reputation der gesamten Domain nach unten zieht.

Halten Sie das Testen an und beheben Sie die Grundlagen, wenn Sie einen plötzlichen Anstieg von Bounces oder Abmeldungen sehen, mehr Spam‑Platzierungen als üblich, Nachrichten deutlich später ankommen als normal, wilde Tag‑zu‑Tag‑Schwankungen ohne klaren Grund auftreten oder Sie von neuen Domains/Mailboxes senden, die nicht warmgelaufen sind.

Beispiel: Ein kleines Team sendet 500 E‑Mails und „testet" fünf verschiedene Ansätze über gemischte Lead‑Quellen. Ein Ansatz löst ein paar Beschwerden aus — und plötzlich schneiden alle zukünftigen Sends dieser Domain schlechter ab, auch die guten Versionen.

Zustellbarkeitsgrundlagen, die Sie vor dem Testen brauchen

Zustellbarkeit ist einfach: Mailprovider beobachten Ihr Sendverhalten und entscheiden, ob Ihre Mails vertrauenswürdig wirken. Wenn zu viele Leute Sie ignorieren, Sie als Spam markieren oder Sie viele ungültige Adressen erreichen, landen Ihre nächsten Mails eher im Spam oder werden blockiert.

Ihre Reputation wird an mehreren Stellen getrackt. Die Domain‑Reputation ist das allgemeine Vertrauen in die Domain, von der Sie senden. Die Mailbox‑ (oder Sender‑) Reputation ist an ein konkretes Konto und dessen jüngstes Verhalten gebunden. Tests werden kompliziert, wenn Sie diese Signale vermischen. Wenn eine Variante aus einer neueren Mailbox oder einer anderen Domain versendet wird, testen Sie nicht mehr nur Text — Sie testen Reputation.

Warm‑up und schrittweises Hochfahren helfen, sind aber kein Allheilmittel. Warm‑up baut über die Zeit ein Muster normalen Sendens und Engagements auf. Ramping bedeutet, das Volumen langsam zu erhöhen, damit Sie nicht wie ein brandneuer Sender wirken, der über Nacht Hunderte E‑Mails verschickt. Keines davon rettet Sie, wenn Ihre Liste schlecht ist oder Sie zu viele Dinge auf einmal ändern.

Die Listenqualität ist der schnellste Weg, die Zustellbarkeit zu zerstören. Hohe Bounce‑Raten signalisieren Providern, dass Sie Ihre Kontakte nicht pflegen.

Führen Sie vor jedem Test einen kurzen Hygiene‑Check durch: entfernen Sie Roll‑Accounts (info@, support@, sales@) außer es gibt einen guten Grund, vermeiden Sie veraltete Leads, achten Sie auf Hard‑Bounces und stoppen Sie Senden an ähnliche Adressen, halten Sie das Targeting eng, damit Antworten zum Angebot passen, und senden Sie nicht dieselbe Person mehrfach über Varianten hinweg.

Konsistenz schlägt clevere Texte am Anfang. Wenn Sie auf einer neuen Domain sind, halten Sie Ihre Sendegewohnheiten stabil (Volumen, Timing, From‑Name) und testen Sie nur eine Variable zur Zeit. Wenn Sie das tägliche Volumen verdoppeln und in derselben Woche die Betreffzeile ändern, wissen Sie nicht, ob der „Gewinner" besser war oder die Zustellbarkeit sich verändert hat.

Was zuerst testen: Betreff, Angebot oder CTA

Eine praktische Reihenfolge ist: zuerst Betreff, dann Angebot, dann CTA. Das ist weniger riskant und leichter zu lernen.

1) Betreff zuerst (beeinflusst hauptsächlich Öffnungen)

Wenn Leute nicht öffnen, ist alles andere egal. Betreff‑Tests sind außerdem die kleinste Änderung, weil Sie den E‑Mail‑Body unverändert lassen können.

Halten Sie die Hypothese einfach und testbar: „Ein konkretes Ergebnis erhöht Öffnungen" oder „Kürzere Betreffe verbessern Öffnungen." Ändern Sie nicht gleichzeitig Sendername, Versandzeit und Eröffner, sonst wissen Sie nicht, was die Bewegung verursacht hat.

2) Angebot als Nächstes (beeinflusst meist Antworten)

Wenn die Öffnungen passen, treibt das Angebot normalerweise die Antworten. Das Angebot ist der Grund zu antworten, nicht die Formulierung, mit der Sie um ein Meeting bitten. Denken Sie an: ein kurzer Audit, ein Benchmark, eine relevante Fallstudie oder ein klares Versprechen von Zeitersparnis.

Halten Sie Angebotstests sauber, indem Sie nur den Wert ändern und Struktur, Länge und Ton gleich lassen. Angebotstests erzeugen oft größere Ausschläge als feine Textänderungen.

3) CTA zuletzt (beeinflusst meist positive Antworten)

Der CTA bestimmt, wie einfach es sich anfühlt zu antworten. Testen Sie zuerst die kleinste Verpflichtung: einfache Ja/Nein‑Fragen, „Worth a chat?“ vs. „Geht Dienstag um 14 Uhr?" Kleine CTA‑Änderungen können die Antwortqualität heben, ohne Ihre Positionierung zu ändern.

Vermeiden Sie komplette Überarbeitungen, bei denen Betreff, Eröffner, Angebot und CTA gleichzeitig wechseln. Wenn Sie wirklich lernen wollen, wählen Sie eine Variable und notieren Sie vorher, was Sie bewegen erwarten (Öffnungen oder Antworten).

Wie Sie Variablen sauber halten und Vergleiche fair machen

Faire Tests sind absichtlich langweilig. Wenn zwei Versionen sich in mehr als einer relevanten Weise unterscheiden, können Sie nicht feststellen, was das Ergebnis verursacht hat.

„Eine Sache ändern" bedeutet eine Entscheidung, die ein Leser bemerkt. Wenn Sie den Betreff testen, behalten Sie Vorschautext, ersten Satz, Angebot, CTA und Versandplan bei. Selbst ein Tonwechsel (freundlich vs. formell) kann zur zweiten Variable werden, wenn sich dadurch das Gefühl der Mail ändert.

Erstellen Sie eine Kontrollversion, die Sie eine Weile behalten. Wählen Sie Ihre aktuell am besten performende E‑Mail, sperren Sie sie und benennen Sie sie klar (Control v1). Behandeln Sie sie wie eine Basislinie, die Sie nur ersetzen, wenn eine neue Version mehr als einmal gewinnt. Das verhindert, dass Sie dem Rauschen hinterherjagen und jede Woche alles umschreiben.

Teilen Sie Ihr Publikum zufällig auf. Senden Sie Variante A nicht an Gründer und Variante B an Marketer und nennen Sie das einen Test. Wenn Ihre Liste klare Segmente hat, stratifizieren Sie: Teilen Sie jedes Segment in zwei Hälften, sodass beide Varianten eine ähnliche Mischung erhalten.

Während des Tests halten Sie Lead‑Quelle und Filterregeln, Versandtage und Zeitfenster, Follow‑up‑Schritte und Abstände, Sending‑Domain und Mailbox‑Pool sowie Suppressionsregeln (Bounces, Abmeldungen, Do‑Not‑Contact) gleich.

Eine Holdout‑Gruppe hilft, wenn sich Bedingungen verschieben. 10–20 % als Control zurückzuhalten macht es leichter zu erkennen, ob Zustellbarkeit oder Lead‑Qualität für alle gesunken ist.

Schritt für Schritt: So führen Sie Ihren ersten sicheren A/B‑Test durch

Ein sicherer erster Test ist bewusst schlicht. Sie wollen eine klare Änderung, eine saubere Aufteilung und Abbruchregeln, damit Sie einen kleinen Gewinn nicht gegen langfristige Zustellbarkeit tauschen.

-

Wählen Sie vor dem Schreiben eine Zielmetrik. Öffnungen können bei wirklich kalten Listen irreführen. Eine praktische Wahl ist Antwortquote. Wenn Ihr Team Antworten zuverlässig taggen kann, nutzen Sie positive Antwortrate (interessierte Antworten geteilt durch zugestellte E‑Mails).

-

Schreiben Sie Variante A und Variante B mit nur einem Unterschied. Beginnen Sie mit einem Hebel, z. B. der Betreffzeile. Halten Sie Sendername, Eröffner, Angebot, CTA und Signatur identisch.

-

Teilen Sie fair. Gleiche Lead‑Quelle, ähnliche Mixquote bei Seniorität und Region, und dasselbe Versandfenster. Bei 400 Prospects teilen Sie 200/200 zufällig. Bei nur 80 teilen Sie 40/40 und haben bescheidene Erwartungen.

-

Setzen Sie Schutzregeln, damit Sie keine Mailbox verbrennen. Legen Sie Pauseschwellen im Voraus fest. Wenn die Bounce‑Rate steigt, Beschwerden auftauchen oder Abmeldungen gegenüber dem Baseline zunehmen — stoppen und diagnostizieren.

-

Starten, täglich prüfen und die Stopp‑Regeln befolgen. Beobachten Sie Zustellungen, Bounces, Beschwerden, Abmeldungen und Antworten. Wenn Schutzregeln greifen, stoppen Sie den Test und beheben Sie die Ursache (Listenqualität, Targeting oder Ton), bevor Sie neu starten.

Beispiel: Ein kleines SDR‑Team testet zwei Betreffe in einem neuen Branchen‑Segment. Sie behalten denselben Body und CTA, teilen die Liste gleichmäßig und laufen den Test über drei Werktage. Ein Betreff gewinnt knapp bei ein paar Antworten, aber Abmeldungen sind ebenfalls höher — also behalten sie den „verlierenden" Betreff nicht, sondern schreiben stattdessen den Eröffner um.

Was Sie messen sollten, damit Sie nicht den falschen Gewinner wählen

Wenn Sie das Falsche messen, können Sie einen A/B‑Test „gewinnen" und trotzdem Meetings verlieren oder schlimmer: Ihre Sender‑Reputation schädigen. Das Ziel ist nicht höhere Aktivität, sondern bessere Gespräche mit den richtigen Leuten.

Öffnungen: manchmal nützlich, oft irreführend

Öffnungsraten helfen, offensichtliche Probleme zu erkennen (z. B. ein Betreff, der fast null Öffnungen erzielt). Aber für die Wahl eines Gewinners sind Öffnungen wackelig. Viele Mailapps laden Bilder vor, und manche Firmen blockieren Tracking. „Geöffnet" heißt nicht immer, dass ein Mensch die Mail gelesen hat.

Behandeln Sie Öffnungen wie einen Rauchmelder, nicht als Punktestand. Wenn Variante B leicht mehr Öffnungen hat, aber weniger Antworten, sollten die Antworten entscheiden.

Antworten, positive Antworten und konsistente Labels

Definieren Sie Ergebnisse, bevor Sie senden, und verwenden Sie für jeden Test dieselben Labels. Eine einfache Einteilung reicht: positive Antwort (klare Interessenbekundung oder Vorschlag für nächste Schritte), neutrale Antwort (nicht jetzt, später melden), negative Antwort (kein Interesse), administrative Antwort (Abwesenheitsmeldung, falsche Person) und Abmeldung oder Beschwerde.

Verfolgen Sie sowohl die Antwortquote (alle menschlichen Antworten) als auch die positive Antwortrate. Antwortquote zeigt, ob Ihre Nachricht zum Reagieren einlädt. Positive Antworten zeigen, ob Angebot und Targeting passen.

Überwachen Sie außerdem die Zustellungs‑Gesundheit parallel zu den Ergebnissen. Ignorieren Sie nicht Bounces, Blocks, Beschwerden und Abmeldungen nur weil „der Test klein ist." Eine Variante, die ein paar Antworten mehr bringt, aber die Beschwerden verdoppelt, ist ein schlechter Tausch.

Wenn möglich, schauen Sie auf Performance pro Mailbox und pro Domain, nicht nur insgesamt. Ein schwächerer Sender kann die Ergebnisse nach unten ziehen und die wahre Geschichte verbergen.

Wie Sie Ergebnisse bei kleinen Stichproben beurteilen

Kleine A/B‑Tests können irreführen. Eine Version gewinnt vielleicht, weil sie bessere Leads bekam oder weil ein Sender in dieser Woche eine bessere Reputation hatte. Bei nur wenigen Antworten spielt Zufall eine große Rolle.

Beurteilen Sie einen Test nicht nach Sends oder Öffnungen. Zielen Sie auf Ergebnisse, die zählen, wie positive Antworten oder gebuchte Calls. Bei nur 1–3 Gesamantworten haben Sie kaum etwas gelernt.

Eine praktische Einordnung kleiner Ergebnisse:

- Richtungsweisender Sieg: deutlich mehr positive Antworten, aber Totals noch niedrig (2 vs. 0). Als Hinweis behandeln.

- Starker Sieg: wiederholbare Lücke nach mehr Ereignissen (10 vs. 4 positive Antworten). Meist ausreichend, um einen Gewinner zu wählen.

- Kein Signal: Ergebnisse sind nah beieinander oder wechseln je nach Tag/Inbox. Als nicht schlüssig bewerten.

Pooling über Tage und Inboxes hilft nur, wenn Bedingungen gleich bleiben: gleiche Audience‑Regeln (gleiches ICP und Quelle), ähnlicher Versandplan (gleiche Schritte und Abstände) und stabile Zustellbarkeit (keine neue Domain, kein Warm‑up‑Wechsel). Wenn Sie etwas Wichtiges ändern — Angebot, Targeting oder Volumen — starten Sie den Test neu.

Führen Sie den Test, bis Sie eine Antwort‑Schwelle erreicht haben, nicht bis zu einem Kalenderdatum. Früh stoppen nur bei einem starken Sieg. Ansonsten weitermachen, bis Sie genug Antworten haben, um der Richtung zu vertrauen, oder den Test als nicht schlüssig erklären und eine größere Änderung testen.

Wie Sie testen, ohne die Sender‑Reputation zu schädigen

A/B‑Testing ist nur nützlich, wenn Ihre Sender‑Reputation stabil bleibt. Wenn die Zustellbarkeit mitten im Test einbricht, können Sie fälschlich lernen, dass eine Variante schlechter ist, obwohl die Inbox‑Platzierung zusammengebrochen ist.

Kontrollieren Sie das Volumen. Halten Sie tägliche Sends stabil und erhöhen Sie in kleinen Schritten über mehrere Tage, statt über Nacht von 50 auf 500 zu springen. Plötzliche Ausschläge wirken unnatürlich und können Throttling oder Spam‑Platzierung auslösen.

Wenn Sie mehr Volumen brauchen, fügen Sie Kapazität auf sicherem Weg hinzu: verteilen Sie Sends über mehrere erwärmte Mailboxen, statt eine Inbox zu überlasten.

Während Sie die erste E‑Mail testen, behalten Sie den Rest der Sequenz konsistent. Ändern Sie nicht Follow‑up‑Timing, Follow‑up‑Texte oder Anzahl der Follow‑ups mitten im Test — sonst testen Sie die erste Ansprache plus „Sequenzdruck."

Vermeiden Sie versteckte Änderungen, die die Inbox‑Platzierung beeinflussen: Domainwechsel, andere Versandzeiten, Änderungen bei Tracking‑Einstellungen (insbesondere Open‑Tracking) oder verändertes Warm‑up‑Verhalten während des Testfensters.

Falls Stop‑Signale auftreten, pausieren und stabilisieren, bevor Sie weitermachen: Bounce‑Rate steigt über Baseline, Beschwerden nehmen zu, viele Nachrichten werden verzögert oder deferred, Abmeldungen steigen oder Antworten enthalten Hinweise wie „Warum bekomme ich das?" oder „Spam?".

Beispiel: Eine Zwei‑Personen‑Agentur testet eine neue Betreffzeile. Sie halten 40 Sends pro Mailbox und Tag, rotieren über drei erwärmte Inboxes und laufen den Test eine Woche. Sie pausieren, sobald Bounces nach dem Hochladen eines neuen Segments steigen, bereinigen die Liste und nehmen den Test wieder auf.

Häufige Fehler, die A/B‑Tests nutzlos oder riskant machen

Die meisten „Erfolge", die Leute feiern, kommen aus schlampigen Setups, nicht aus besserem Text.

Der größte Fehler ist, mehrere Dinge auf einmal zu ändern. Wenn Version A einen neuen Betreff, ein anderes Angebot und einen neuen CTA hat, wissen Sie nicht, was die Änderung ausgelöst hat. Große Wortwahl‑Sprünge zwischen Varianten können außerdem wie inkonsistentes Senden wirken — schlecht für Cold‑Email‑Zustellbarkeit.

Weitere Fehler, die Tests ruinieren:

- Stillschweigende Änderung der Zielgruppe zwischen A und B (Firmengröße, Jobtitel, Geografie).

- Einen Gewinner anhand von 1–2 zusätzlichen Antworten ausrufen.

- Überoptimieren auf Öffnungen mit einem neugierigen Betreff, der nicht zum Body passt.

- Abmeldungen, Beschwerden und Bounces ignorieren, weil Antworten gut aussehen.

Achten Sie auch auf Setup‑Drift: unterschiedliche Versandzeiten, verschiedene Domains oder Warm‑up‑Anpassungen mitten im Test.

Wenn Sie vertrauenswürdige Ergebnisse wollen, ändern Sie nur eine Variable pro Test, teilen Sie ähnliche Leads gleichmäßig auf und behandeln Sie Abmeldungen sowie Beschwerden als harte Stoppsignale.

Beispiel: Kleines Team testet Cold‑Emails mit begrenzter Liste

Ein kleines SDR‑Team hat 500 Prospects. Sie senden aus zwei Inboxes und nutzen eine einfache 3‑Stufen‑Sequenz, um Ergebnisse zu beobachten, ohne das Volumen zu erhöhen.

Sie testen sicher: eine Sache ändern, alles andere gleich lassen und die Liste gleichmäßig teilen. 250 Prospects zu Version A, 250 zu Version B, mit denselben Branchen und Jobtiteln in beiden Gruppen.

Test 1: Betreff A vs B

Sie testen nur die Betreffzeile. Body, Angebot, CTA, Versandzeiten und Follow‑ups bleiben identisch.

Nach ein paar Tagen hat Betreff B mehr Öffnungen. Die Versuchung ist groß, ihn zum Sieger zu erklären, aber die Antworten sind praktisch gleich und die Antwortqualität verbessert sich nicht. Das bedeutet meist, dass der Betreff Neugier erzeugt hat, der Body oder das Angebot das nicht eingelöst haben, oder der CTA zu viel verlangt. Sie behalten die besser öffnende Betreffzeile, behandeln sie aber nicht als Durchbruch.

Test 2: Angebotstweak vs CTA‑Tweak

Als Nächstes wählen sie je nach Engpass. Da die Öffnungen gestiegen sind, aber die Antworten nicht, konzentrieren sie sich auf den Body und testen eine saubere Änderung — nicht beides.

Sie dokumentieren jeden Test in einer gemeinsamen Notiz: Hypothese, exakte Texte für A und B, Audience‑Regeln, Ergebnisse (Öffnungen, Antworten, positive Antworten, Abmeldungen) und die Entscheidung (behalten, verwerfen oder neu testen). Dieses Protokoll verhindert, dass sie dieselben Experimente wiederholen.

Schnelle Checkliste und praktische nächste Schritte

Bevor Sie A/B‑Tests für Cold‑Emails starten, machen Sie einen kurzen Plausibilitätscheck. Viele „schlechte Ergebnisse" sind Listen‑ oder Zustellbarkeitsprobleme.

Vor dem Senden prüfen Sie: Authentifizierung ist eingerichtet (SPF, DKIM, DMARC), Mailboxes sind warmgelaufen und senden stabil, die Liste ist sauber und relevant, beide Versionen gehen im selben Tages-/Zeitfenster raus und Ihre Sequenz sowie die Antwortverarbeitung funktionieren End‑to‑End.

Dann halten Sie den Test simpel: eine Sache ändern (Betreff oder Angebot oder CTA), Publikum fair teilen, eine Zielmetrik wählen (häufig positive Antwortrate) und eine Stoppregel vorher aufschreiben.

Nach dem Start krönen Sie nicht nach ein paar Sends einen Gewinner. Begrenzen Sie das Volumen beim Testen, überwachen Sie täglich Bounces, Abmeldungen und Beschwerden und stellen Sie sicher, dass die Ergebnisse nicht von einer einzigen Inbox getrieben werden. Wenn Antworten zu selten sind, verlängern Sie den Test oder testen Sie eine größere Änderung (meist das Angebot).

Wenn Sie weniger bewegliche Teile wollen, bündelt LeadTrain (leadtrain.app) Domains, Mailboxes, Warm‑up, mehrstufige Sequenzen und Antwortklassifikation an einem Ort, sodass Sie weniger wahrscheinlich das Setup unabsichtlich ändern, während Sie Copy testen.

FAQ

Wie führe ich einen A/B-Test durch, ohne die Zustellbarkeit zu gefährden?

Beginnen Sie mit nur einer Veränderung — meist der Betreffzeile — und halten Sie alles andere identisch: Listenquelle, Versandfenster, Domain, Mailbox‑Pool und Sequenzschritte. Legen Sie vor dem Start Schwellenwerte für Bounces, Abmeldungen und Beschwerden fest, damit eine „gewinnende“ Variante nicht heimlich die Reputation beschädigt.

Warum kann A/B‑Testing die Zustellbarkeit verschlechtern?

Wenn Sie zu viele Faktoren gleichzeitig testen, entstehen inkonsistente Muster bei den Sends, die Provider als riskant einstufen können. Wenn eine Variante mehr Löschungen, Beschwerden oder Bounces auslöst, kann das die Reputation der gesamten Domain herunterziehen und auch gute E‑Mails in den Spam verschieben.

Was sollte ich zuerst testen: Betreff, Angebot oder CTA?

Testen Sie zuerst die Betreffzeile, dann das Angebot und zuletzt den CTA. Diese Reihenfolge ist weniger riskant und macht die Ergebnisse leichter interpretierbar: Betreffzeilen beeinflussen hauptsächlich Öffnungen, Angebote treiben meistens Antworten und CTAs beeinflussen oft die Qualität der Antworten.

Welche Metrik sollte ich verwenden, um den Gewinner zu wählen?

Ein gängiger Standard ist die positive Antwortrate bezogen auf zugestellte E‑Mails, weil sie mit realen Ergebnissen übereinstimmt. Öffnungsraten sind ein Warnsignal, aber für kalte Outreach‑Tests nicht zuverlässig, da Tracking blockiert oder verfälscht sein kann.

Wann sollte ich das Testen pausieren und erst die Zustellbarkeit beheben?

Pausieren Sie und beheben Sie die Zustellbarkeitsprobleme, wenn Bounces oder Abmeldungen steigen, Nachrichten deutlich später als normal ankommen oder die Platzierung im Spam‑Ordner zulegt. Stoppen Sie auch, wenn Sie von neuen Domains oder Mailboxes senden, die nicht warmgelaufen sind — Reputationseffekte können Ihre Copy‑Tests überlagern.

Wie halte ich Variablen sauber, damit der Vergleich fair ist?

Wenn Sie die Betreffzeile ändern, behalten Sie Vorschautext, ersten Satz, Angebot, CTA, Signatur und Versandplan bei. Teilen Sie die gleiche Zielgruppe zufällig auf (oder teilen Sie jedes Segment halbiert), damit Variante A und B eine ähnliche Mischung aus Jobtiteln, Branchen und Regionen erhalten.

Was ist ein Control und warum brauche ich es?

Erstellen Sie eine Baseline‑E‑Mail (z. B. „Control v1“) und lassen Sie sie eine Weile unverändert. Ersetzen Sie sie nur, wenn eine neue Variante mehr als einmal gewinnt. Ohne Control jagen Sie dem Rauschen hinterher und setzen ständig neu, was „normal“ ist.

Wie beurteile ich A/B‑Testergebnisse bei kleiner Liste?

Verlassen Sie sich nicht auf Ergebnisse aus nur wenigen Antworten; bei niedrigen Volumina spielt Zufall eine große Rolle. Betrachten Sie kleine Erfolge als Hinweise: verlängern Sie den Test, bis Sie genug positive Antworten haben, oder erklären Sie ihn als nicht schlüssig und testen Sie eine größere Änderung (meist das Angebot).

Wie kontrolliere ich das Volumen, damit ich nicht gedrosselt oder markiert werde?

Halten Sie das tägliche Sendvolumen stabil und vermeiden Sie plötzliche Sprünge, besonders während eines Tests. Wenn Sie mehr Kapazität brauchen, verteilen Sie das Volumen auf mehrere erwärmte Mailboxen, anstatt eine Inbox zu überlasten, und ändern Sie das Warm‑up‑Verhalten nicht mitten im Test.

Wie kann LeadTrain mir helfen, Cold‑Email‑A/B‑Tests sicherer durchzuführen?

LeadTrain sammelt Domains, Mailboxes, Warm‑up, Sequenzen und Antwortklassifikation an einem Ort, wodurch unbeabsichtigte Setup‑Änderungen während Tests seltener werden. So behalten Sie Domain und Mailbox‑Pool konsistent, während Sie nur eine Variable im Text ändern.