A/B‑Tests für Angebote: Ein klarer Plan jenseits von Betreffzeilen

Lerne einen praktischen Plan für A/B‑Tests von Angeboten: Variablen kontrollieren, ehrliche Stichprobengrößen wählen und Ergebnisse lesen, ohne in verrauschte Schlussfolgerungen zu springen.

Warum Angebots-A/B-Tests oft verwirrende Ergebnisse liefern

Angebotstests in Cold Outreach wirken oft willkürlich, weil der Posteingang ein unordentlicher Ort ist. Du testest nicht im Labor. Du testest gegen beschäftigte Menschen, wechselnde Prioritäten, Spamfilter und Lead-Listen, die nie perfekt gleich sind.

Ein häufiger Grund, warum Ergebnisse verwirrend wirken: Leute sagen, sie testen das Angebot, ändern aber stillschweigend auch den Text. Wenn eine Variante kürzer, klarer, selbstbewusster ist oder einen stärkeren Call-to-Action hat, lernst du nicht mehr übers Angebot. Du lernst übers Schreiben.

Selbst wenn du versuchst, es zu isolieren, ist das Angebot an den Kontext gebunden. Ein „kostenloses Audit“ kann für ein Segment wertvoll und für ein anderes nach zusätzlicher Arbeit aussehen. Wenn deine zwei Varianten schließlich unterschiedliche Jobtitel, Firmengrößen oder Branchen erreichen, schwanken die Ergebnisse und du gibst dem Angebot die Schuld.

Die meisten „dramatischen Gewinner“ sind nur Rauschen, das sich zeigt als:

- Woche-zu-Woche-Schwankungen, weil die Prospects anders waren, nicht weil das Angebot besser war.

- Kleine Stichproben, bei denen ein paar zusätzliche Antworten einen falschen Sieger erzeugen.

- Zustellbarkeitsveränderungen (neue Domains, Warm-up-Probleme, Änderungen an der Authentifizierung), die beeinflussen, wer die E-Mail überhaupt sieht.

- Timing-Effekte wie Feiertage, Quartalsende oder ein Branchenthema.

- Inkonsistente Antwortbehandlung, bei der eine Version mehr „nicht jetzt“-Antworten bekommt und du das als Erfolg zählst.

Ein vertrautes Szenario: Du führst einen Angebotstest durch, Variante B bekommt montags 6 Antworten, und du erklärst sie zum Gewinner. Dann merkst du, dass diese Antworten größtenteils Abwesenheitsnotizen und höfliche Verschiebungen waren, und der Rest der Woche bleibt es ruhig. Das war keine Magie. Das war Varianz.

Das Ziel ist nicht Gewissheit. Ein sauberer Angebotstest reduziert die Unsicherheit, damit du eine bessere Wette abschließen kannst. Wenn du jeden Test als Beweis behandelst, nicht als endgültiges Urteil, hörst du auf, falschen Gewinnern hinterherzulaufen, und beginnst, Angebote zu bauen, die über die Zeit bestehen.

Was als Angebot zählt (und was nicht)

Wenn Leute sagen, sie wollen Angebote testen, meinen sie oft „ändere die E-Mail und sieh, was passiert“. Das vermischt meist zu viele Variablen. Fang damit an, das Angebot zu definieren.

Ein Angebot ist der Tausch, den du vorschlägst: was du vom Leser verlangst, was er dafür bekommt und warum es jetzt Sinn macht.

Die Teile, die zum Angebot gehören

Denk an das Angebot wie an ein kleines Paket. Wenn du eines dieser Elemente änderst, änderst du das Angebot:

- CTA (die Aufforderung): „Antwort YES“, „Wähle eine Zeit“, „Sende mir den richtigen Kontakt“, „Soll ich mal drüberschauen?"

- Wertwinkel (das Versprechen): Zeit sparen, Kosten senken, mehr Leads, Zustellbarkeit beheben, Conversion verbessern

- Anreiz: kostenloses Audit, Template-Paket, Benchmark-Report, Geschenkkarte, verlängerte Testphase

- Commitment-Level: „antworten mit einer Zahl" vs. 5-minütiger Call vs. 30-minütige Demo

- Timing/Dringlichkeit: „diese Woche“, „vor Monatsende“, „wir haben noch 3 Slots"

Konkrete Beispiele echter Angebotsvarianten:

- „Kostenloser 10‑minütiger Teardown deiner Outbound-Emails" vs. „15‑minütige Produktdemo"

- „7‑tägige kostenlose Testphase" vs. „einseitige Fallstudie, zugeschnitten auf euer Unternehmen"

- „Ich schicke eine kurze Liste mit Quick Wins" vs. „Ich erstelle einen Mini-Plan für deine nächste Sequenz"

Was nicht das Angebot ist

Diese Dinge können die Ergebnisse stark verändern, sind aber separate Tests:

- Betreffzeile und Preheader

- Absendername, Sendeadresse, Signaturstil

- Zustellbarkeitsfaktoren: Domain-Alter, Mailbox-Warm-up, Spam-Platzierung

- Publikumsmix: Branche, Seniorität, Lead-Quelle

- Sendezeitpunkt: Wochentag, Uhrzeit

Wenn dein Ziel ist zu lernen, welches Angebot funktioniert, halte die Nicht‑Angebots‑Elemente stabil und ändere nur den Tausch, den du vorschlägst.

Wähle eine Zielmetrik, die du sauber messen kannst

Wenn du Angebote testen willst (nicht nur Betreffzeilen), wähle eine primäre Erfolgsmetrik. Eine reicht. Mehrere „Haupt“-Metriken laden danach zum Cherry-Picking ein.

Wähle die Metrik, die dem Ergebnis entspricht, das du wirklich willst:

- Positive-Antwort-Rate: jede menschliche Antwort, die kein Bounce oder Abmelden ist

- Quote qualifizierten Interesses: Antworten, die einen echten Use Case zeigen, nicht nur „Infos senden"

- Gebuchte-Meetings-Rate: das sauberste Geschäftsergebnis, aber langsamer zu messen

- Kosten pro qualifizierter Antwort: wenn du Ausgaben pro Lead-Quelle verfolgst

Was auch immer du wählst, definiere Labels, sodass jede Antwort gleich gezählt wird. Schreib die Regeln auf, bevor du startest. Zum Beispiel:

- „Interessiert" = fragt nach Preis, Zeitplan, Passung oder nächsten Schritten

- „Nicht interessiert" = klares Nein

- „Abwesenheit" = automatische Verschiebung ohne Engagement

Definiere außerdem dein Bewertungsfenster im Voraus. Eine praktische Regel für Cold Email ist, Antworten zu zählen, die innerhalb von 7 bis 10 Tagen nach dem ersten Versand eintreffen (oder innerhalb von 7 bis 10 Tagen nach jedem Schritt, wenn du Angebote innerhalb einer Sequenz vergleichst). Späte Antworten passieren, aber sie erzeugen Rauschen und können die Variante bevorzugen, die länger gelaufen ist.

Vermeide, Opens und Clicks als primäre Angebotsmetrik zu verwenden. Opens werden durch Privacy-Features aufgebläht, und Klicks können Neugier statt Intent widerspiegeln.

Wie du das Angebot isolierst und alles andere stabil hältst

Saubere Angebotstests scheitern aus einem einfachen Grund: zwei Dinge ändern sich gleichzeitig. Wenn du willst, dass deine Ergebnisse etwas bedeuten, brauchst du einen klaren Unterschied zwischen A und B, und alles andere sollte langweilig konsistent sein.

Halte den Kontext fix

Sichere den Kontext, bevor du auch nur eine Zeile schreibst. Dieselben Personen sollten A und B auf dieselbe Weise und im selben Zeitfenster erhalten. Ansonsten testest du Listenqualität, Timing oder Zustellbarkeit.

Halte diese Punkte konstant:

- Listenquelle und Filter: gleicher Anbieter, gleiche Jobtitel, gleiche Firmengröße

- Persona und Use Case: mische nicht Gründer mit Marketingmanagern in einem Test

- Sequenzstruktur: gleiche Schritte, gleiche Verzögerungen, gleiche Follow-up-Logik

- Sendeplan: gleiche Tage, gleiche Stunden, gleiche tägliche Volumenlimits

- Zustellbarkeits-Setup: dieselbe Sending-Domain und Mailbox-Gesundheit

Passe auch die E-Mail-Struktur an. Wenn Angebot A aus zwei kurzen Sätzen besteht und Angebot B ein langer Absatz mit zusätzlichem Proof ist, hast du mehr als das Angebot verändert. Halte das Format ähnlich: ähnliche Länge, ähnliche Anzahl Zeilen, gleiche CTA-Form.

Ändere gezielt nur eine Sache

Definiere jedes Angebot in einem Satz und bearbeite dann nur den minimalen Text, der nötig ist, um den Tausch zu zeigen.

Beispiel:

- Angebot A: „15‑minütiges Audit mit 3 Fixes"

- Angebot B: „kostenloses Template-Paket plus kurze Walkthrough"

Behalte das Opening, das Pain und den Ton gleich. Tausche nur die Trade-Komponente.

Wenn du mitten im Test ein unzusammenhängendes Problem entdeckst (kaputtes Personalisierungsfeld, Bounce‑Spike, Domainproblem), patch das nicht und mach weiter. Pausiere, behebe, starte neu mit einem frischen Split und notiere, was sich geändert hat. Ansonsten vermischst du „Angebotswirkung“ mit „Vorfallwirkung."

Schritt für Schritt: Testaufbau von Idee bis Launch

Fang damit an, jedes Angebot so einfach zu machen, dass du es in einem Satz sagen kannst. Wenn dir das nicht gelingt, kannst du es nicht testen.

Schreibe zwei Angebote, die sich im Wert unterscheiden, nicht nur in der Wortwahl. Zum Beispiel:

- „Kostenloser 10‑minütiger Teardown deiner Outbound-Emails"

- „Ich schicke einen 3‑Folien‑Plan, um 10 qualifizierte Meetings diesen Monat hinzuzufügen"

Baue dann zwei Versionen derselben Sequenz. Halte die Struktur identisch: gleiche Anzahl Schritte, gleiche Sendetage, gleiche Personalisierungsvorgehensweise, gleiche CTA‑Form. Ändere nur die Angebotszeile(n), in denen der Wert präsentiert wird.

Ein einfacher Build‑Plan:

- Formuliere Angebot A und Angebot B jeweils in einem Satz.

- Dupliziere die Sequenz und ändere nur die angebotsbezogenen Satzteile.

- Nutze dieselbe Zielgruppendefinition und dieselbe Listenquelle.

- Teile Prospects zufällig 50/50, sodass jede Variante vergleichbare Empfänger sieht.

- Fahre beide Varianten gleichzeitig.

Setze deine Regeln bevor du sendest:

- Stoppregel: ein festes Enddatum oder eine fixe zugestellte Stichprobengröße pro Variante.

- Erfolgsmetrik: die eine Metrik, die du gewählt hast.

- Antwort‑Labels: die Definitionen, die du verwenden wirst.

Vor dem Start mache einen letzten Sinn‑Check:

- Beide Versionen fragen nach derselben Art von Antwort.

- Der einzige wirkliche Unterschied ist das Angebot.

- Der Split ist zufällig und simultan.

- Die Stoppregel steht schriftlich und wird nicht mittendrin geändert.

Stichprobengröße und Laufzeit, die Ergebnisse ehrlich halten

Kleine Tests lügen gern. Bei nur wenigen Antworten kann ein zusätzliches „Ja" (oder eine wütende Antwort) deine Raten um 50% oder mehr verschieben.

Praktische Zahlen, die sich meist verhalten

Wenn möglich, ziele auf 300 bis 500 zugestellte Prospects pro Variante. Das ist oft genug, damit ein paar zufällige Antworten nicht einen falschen Sieger krönen.

Wenn du dieses Volumen nicht erreichst:

- Tu nicht so, als würdest du winzige Unterschiede messen.

- Vertraue nur großen Differenzen (zum Beispiel, ein Angebot erhält etwa 2x so viele positive Antworten).

- Begrenze dich auf zwei Varianten. Mehr Versionen streuen dein Volumen zu sehr.

Timing ist genauso wichtig wie Volumen. Cold‑Email‑Leistung ändert sich je nach Wochentag, Feiertagen und Inbox‑Müdigkeit. Wenn du einen Test zwei Tage laufen lässt, misst du vielleicht Montag vs. Mittwoch mehr als Angebot A vs. Angebot B.

Eine sicherere Mindestlaufzeit sind 7 volle Tage. Für langsamere Zielgruppen (Enterprise, Gründer, viel beschäftigte Führungskräfte) sind 10 bis 14 Tage oft realistischer.

Die größte Falle ist das tägliche „Peeking“. Wenn du täglich nachschaust und abbrichst, sobald eine Variante vorne liegt, wählst du den Gewinner im lautesten Rausch.

Lege eine Stoppregel fest und halte dich daran:

- Festes Enddatum (z. B. 14 Tage), oder

- Fixe zugestellte Stichprobengröße (z. B. 400 zugestellte pro Variante)

Wenn das Volumen niedrig ist, passe den Plan an statt eine „saubere“ Entscheidung zu erzwingen. Lauf länger, teste weniger Dinge gleichzeitig und akzeptiere, dass du nach offensichtlichen Siegern suchen solltest, nicht nach 5%-Hebeln.

Wie du Ergebnisse liest, ohne überzureagieren

Beginne mit der einen Metrik, die du vor dem Start gewählt hast. War das Zielmetric „interessierte Antworten“, vergleiche zuerst diese und ignoriere alles andere für einen Moment. Zusätzliche Metriken zu mischen ist ein Weg, sich einen falschen Gewinner schönzureden.

Trenne dann Wirkung von Zuverlässigkeit:

- Ein Effekt kann echt, aber zu klein sein, um zu zählen (2,0% vs. 2,3% interessierte Antworten verändert vielleicht die Pipeline nicht).

- Eine groß aussehende Steigerung bei kleiner Stichprobe kann trotzdem wacklig sein.

Bevor du einen Gewinner erklärst, prüfe, ob die beiden Gruppen wirklich ähnlich waren. Ungleiche Verteilung erzeugt falsche Anstiege, besonders wenn eine Variante mehr Senior‑Titel oder mehr einer gut performenden Branche traf.

Schnelle Plausibilitätschecks:

- Audience‑Split: Titel, Firmengröße, Branche, Region

- Timing: Traf eine Variante eine Feiertagswoche oder andere Sendetage?

- Zustellbarkeits‑Signale: Bounces und Spam‑Beschwerden

- Antwortmix, nicht nur Anzahl der Antworten

Der Antwortmix ist wichtig, weil „mehr Antworten" auch „mehr Einwände" bedeuten kann. Wenn möglich, prüfe Antworten nach Kategorien (interessiert, nicht interessiert, Abwesenheit, Abmeldung). Eine Variante, die mehr „nicht interessiert"‑Antworten erhöht, ist vielleicht nur klarer, nicht besser.

Wenn du den Test abschließt, schreibe eine kurze Entscheidungsnotiz:

- Was du jetzt glaubst (basierend auf der primären Metrik)

- Was du noch nicht weißt (Stichprobengröße, Schieflage, Timing)

- Was du als Nächstes tun wirst (ausrollen, erneut testen oder Variation einschränken)

Das hält Experimente ruhig und wiederholbar, wenn die Zahlen nahe beieinander liegen.

Häufige Fehler, die zu verrauschten Schlussfolgerungen führen

Die meisten „gescheiterten" Tests scheiterten nicht, weil das Angebot schlecht war. Sie scheiterten, weil der Test Signale vermischte.

Mehr als das Angebot ändern ist der häufigste Fehler. Wenn du Angebot, Betreffzeile und Audience gleichzeitig änderst, ist jedes Ergebnis ein Brei.

Zustellbarkeitsunterschiede sind der stille Killer. Wenn Variante A aus einer etablierten Umgebung rausgeht und Variante B von einer neuen oder kürzlich geänderten Domain oder Mailbox, testest du nicht das Angebot. Du testest Inbox‑Platzierung. Sperre dein Sending‑Setup während des Tests.

Drift bei Follow‑ups ist ein weiterer Klassiker. Du splittest E-Mail 1 sauber und dann editiert jemand Follow‑up #2 nur für eine Version oder ändert den CTA. Jetzt vergleichst du zwei verschiedene Sequenzen, nicht zwei Angebote.

Weitere Rauschquellen:

- Audiencemischung, sodass eine Variante sauberere Leads oder größere Accounts bekommt

- Verschiedene Sendetage oder sehr unterschiedliche Volumen

- Eine Variante nach frühem Erfolg pausieren

- Einen Gewinner ausrufen, weil ein großer Account geantwortet hat (Ausreißer verzerren kleine Stichproben)

- „Antworten" zählen, ohne zwischen interessiert und nicht interessiert zu unterscheiden

Kurze Pre‑Launch‑Checkliste

Bevor du auf Senden drückst, stell sicher, dass du wirklich das Angebot testest und nicht eine Ansammlung kleiner Änderungen.

- Nur ein Angebotsunterschied. Entscheide die einzelne Änderung (Audit vs. Demo, Testphase vs. Report, Low‑Friction‑CTA vs. Kalenderanfrage). Halte den Rest so nah wie möglich.

- Gleiche Audience‑Regeln, gleiche Listenquelle. Dieselbe Lead‑Quelle und Filter für beide Varianten.

- Gleiche Sequenz und Zeitplan. Gleiche Schritte, Timing, Tage und Volumen.

- Schriftliche Stoppregel. Lege Enddatum oder zugestellte Stichprobengröße vor dem Start fest.

- Klare Antwortlabels. Definiere, was als positiv und was als qualifiziert gilt, einschließlich Randfälle wie „nicht jetzt".

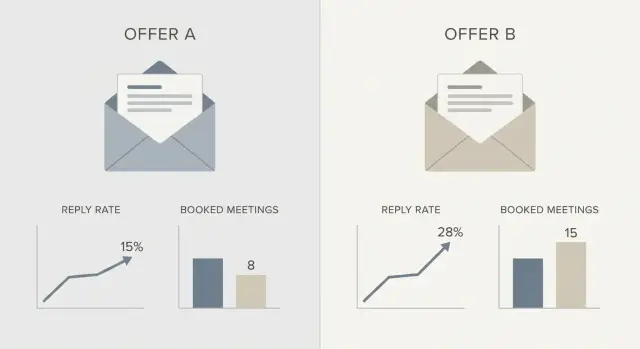

Beispiel: Zwei Angebote in einer Cold‑Email‑Sequenz testen

Ein SDR kontaktiert Finance‑Leiter (VP Finance, Controller, Head of FP&A) bei mittelgroßen SaaS‑Firmen. Ziel ist zu lernen, welches Angebot mehr echtes Interesse erzeugt, nicht welche Betreffzeile mehr Opens bringt.

Zwei Angebote:

- Angebot A: ein 15‑minütiger Teardown ihrer Outbound‑E‑Mails, gefolgt von 3 konkreten Fixes, die sie anwenden können.

- Angebot B: ein kurzer Benchmark‑Report, der sie mit ähnlichen SaaS‑Teams vergleicht, gefolgt von einem 10‑minütigen Review‑Call.

Um das Angebot zu isolieren, bleibt sonst alles gleich: Audience‑Filter, Sending‑Setup und E‑Mail‑Struktur. Nur der Tausch ändert sich.

Konstant halten für beide Varianten:

- Lead‑Listen‑Regeln (Rolle, Firmengröße, Branche, Geografie)

- Copy‑Skelett (Eröffnungszeile, Glaubwürdigkeitszeile, CTA‑Format, Länge)

- Personalisierungs‑Methode (ein Satz basierend auf Rolle oder Tech‑Stack)

- Follow‑up‑Cadence (gleiche Schritte, gleiche Verzögerungen, gleiche Sendetage)

- Absenderidentitäten und Domain‑Gesundheit

Teile Prospects 50/50 zu Beginn der Sequenz und fahre beide gleichzeitig.

Entscheide den Gewinner anhand von zwei verteidigbaren Zahlen:

- Primär: Interested‑Rate (interessierte Antworten geteilt durch zugestellte E‑Mails)

- Sekundär: Gebuchte Meetings, als langsameres Feedback

Wenn Angebot A eine höhere Interested‑Rate hat und nach derselben Anzahl Tage mindestens genauso viele Meetings liefert, behalte es und iteriere. Wenn ein Angebot mehr Antworten bekommt, diese aber überwiegend „nicht interessiert" sind, zieht es wahrscheinlich die falsche Art von Aufmerksamkeit an.

Nächste Schritte: ruhig iterieren und Tests einfacher machen

Sobald du einen Gewinner hast, behandle ihn wie den neuen Standard, nicht wie eine Trophäe. Mach dieses Angebot zur Basis für die nächste Runde und ändere wieder nur einen Angebotswinkel auf einmal.

Führe ein einfaches Experiment‑Log, damit du Tests nicht wiederholst oder Ergebnisse verwechselst:

- Hypothese

- Audience‑Regeln

- Daten und Stichprobengröße

- Ergebnisse (Primärmetrik plus kurze Notizen)

- Entscheidung (beibehalten, zurückrollen, erneut testen)

Bevor du ein Angebot bewertest, bestätige, dass die Zustellbarkeit stabil ist. Wenn die Inbox‑Platzierung schwankt, weil eine Mailbox neu ist, das Warm‑up gestoppt wurde oder die Authentifizierung geändert wurde, behebe das zuerst.

Wenn konsistente Messung für dein Team ein Engpass ist, kann eine All‑in‑one‑Plattform helfen, indem Setup und Tracking an einem Ort bleiben. Zum Beispiel kombiniert LeadTrain (leadtrain.app) Sending‑Domains, Warm‑up, mehrstufige Sequenzen und Antwortklassifikation (interessiert, nicht interessiert, Abwesenheit, Bounce, Abmeldung), sodass du Varianten vergleichen kannst, ohne viel manuell sortieren zu müssen.

Wenn du entscheidest, was als Nächstes getestet werden soll, wähle die kleinste Angebotsänderung, die eine echte Frage beantwortet. Wenn dein aktueller Gewinner Antworten bringt, aber wenige Meetings, teste das Commitment‑Level statt das ganze Pitch neu zu schreiben: niedrigere Hürde vs. Kalenderanfrage, Audit vs. 10‑minütiger Call oder dasselbe Angebot mit anderer Social‑Proof‑Form.

Geh einen Schritt nach dem anderen. Stetiges Lernen ist besser als ständige Bewegung.

FAQ

Warum wirken A/B-Angebots-Tests in Cold Email so inkonsistent?

Angebots-Tests wirken zufällig, wenn mehr als nur das Angebot geändert wird oder wenn A und B unterschiedliche Arten von Prospects erreichen. Halte Zielgruppe, Timing, Sequenzstruktur und Sending-Setup identisch, sodass der einzige sinnvolle Unterschied der vorgeschlagene Tausch ist.

Was genau zählt als „Angebot" in einer Cold Email?

Das Angebot ist der Tausch: was du vom Leser verlangst, was er bekommt und warum es jetzt sinnvoll ist. Wenn du den CTA, den Anreiz, das Commitment-Level oder die Dringlichkeit änderst, veränderst du das Angebot — selbst wenn der Großteil der E-Mail gleich bleibt.

Welche Änderungen gehören nicht zu einem Angebotstest, auch wenn sie die Zahlen bewegen?

Betreffzeilen, Absendername, E-Mail-Länge, Ton, Proof-Elemente, Timing und Zustellbarkeit gehören nicht zum Angebot, obwohl sie Ergebnisse stark beeinflussen können. Wenn du eines davon änderst, während du „das Angebot testest“, lernst du eigentlich etwas über Schreiben oder Inbox-Platzierung.

Was ist die beste Erfolgsmetrik für einen Angebotstest?

Wähle eine primäre Metrik, die dem entspricht, was du wirklich willst, und bleib während des gesamten Tests dabei. Für die meisten Teams ist „qualifiziertes Interesse“ oder „gebuchte Meetings“ nützlicher als die rohe Antwortquote, weil so weniger riskante oder leere Antworten belohnt werden.

Wie sollte ich Antworten labeln, damit die Ergebnisse nicht verzerrt werden?

Schreibe vor dem Versand einfache Label-Regeln und wende sie bei jeder Antwort gleich an. Entscheide vorher, ob Abwesenheitsmeldungen, „nicht jetzt“ oder „Infos schicken" als Erfolg zählen, damit du nicht versehentlich einen Gewinner aufgrund inkonsistenter Bewertung krönst.

Wie stelle ich sicher, dass Variante A und B vergleichbare Prospects erreichen?

Lass beide Varianten gleichzeitig laufen, teile Prospects zufällig 50/50 und verwende dieselbe Listenzuordnung und Filter. Wenn eine Variante mehr Senior-Titel oder eine sauberere Branche bekommt, testest du die Listenmischung, nicht das Angebot.

Wie viele E-Mails brauche ich pro Variante, um dem Ergebnis zu vertrauen?

Ziele auf ungefähr 300–500 zugestellte Prospects pro Variante, wenn möglich, denn kleine Stichproben schwanken stark. Liegt dein Volumen darunter, vertraue nur großen Unterschieden und vermeide zusätzliche Varianten, die dein Volumen zu sehr streuen.

Wie lange sollte ich einen Angebotstest laufen lassen, bevor ich entscheide?

Zähle Antworten in einem festen Fenster wie 7–10 Tage nach dem ersten Versand und halte die Laufzeit so, dass normale Tages-zu-Tages-Schwankungen abgedeckt sind. Brich nicht früh ab, nur weil eine Version montags vorn liegt — das ist oft Rauschen.

Was soll ich tun, wenn Zustellbarkeit oder Text sich während des Tests ändern?

Pausiere und starte neu, wenn sich etwas Grundlegendes ändert — zum Beispiel Zustellbarkeitsprobleme, ein kaputtes Personalisierungsfeld oder wenn Follow-ups nur in einer Variante editiert wurden. Wenn du mittendrin flickst und weitermachst, vermischst du „Angebotswirkung" mit „Vorfallwirkung" und weißt nicht, was die Änderung verursacht hat.

Wie kann LeadTrain mir helfen, sauberere A/B-Angebotstests durchzuführen?

Nutze einen Workflow, der das Sending-Setup stabil hält, identische Sequenzen erzwingt und konsistente Antwortkategorien auf Varianten anwendet. LeadTrain kombiniert Domains, Mailboxes, Warm-up, Sequenzen und automatisierte Antwortklassifikation an einem Ort, damit du weniger Zeit mit Datenbereinigung und mehr Zeit mit dem Vergleich des eigentlichen Angebots verbringst.